没有合适的资源?快使用搜索试试~ 我知道了~

Flink安装配置(2)1

资源推荐

资源详情

资源评论

Flink(二)CentOS7.5 搭建 Flink1.6.1 分布式集群

一. Flink 的下载

安装包下载地址:http://flink.apache.org/downloads.html ,选择对应 Hadoop 的 Flink 版本

下载

[admin@bigdata11 software]$ wget

http://mirrors.tuna.tsinghua.edu.cn/apache/flink/flink-1.6.1/flink-

1.6.1-bin-hadoop27-scala_2.11.tgz

[admin@bigdata11 software]$ ll

-rw-rw-r-- 1 admin admin 301867081 Sep 15 15:47 flink-1.6.1-bin-

hadoop27-scala_2.11.tgz

Flink 有三种部署模式,分别是 Local、Standalone Cluster 和 Yarn Cluster。

二. Local 模式

对于 Local 模式来说,JobManager 和 TaskManager 会公用一个 JVM 来完成 Workload。如

果要验证一个简单的应用,Local 模式是最方便的。实际应用中大多使用 Standalone 或者

Yarn Cluster,而 local 模式只是将安装包解压启动(./bin/start-local.sh)即可,在这里不在演

示。

三. Standalone 模式

快速入门教程地址:https://ci.apache.org/projects/flink/flink-docs-release-

1.6/quickstart/setup_quickstart.html

1. 软件要求

� Java 1.8.x 或更高版本,

� ssh(必须运行 sshd 才能使用管理远程组件的 Flink 脚本)

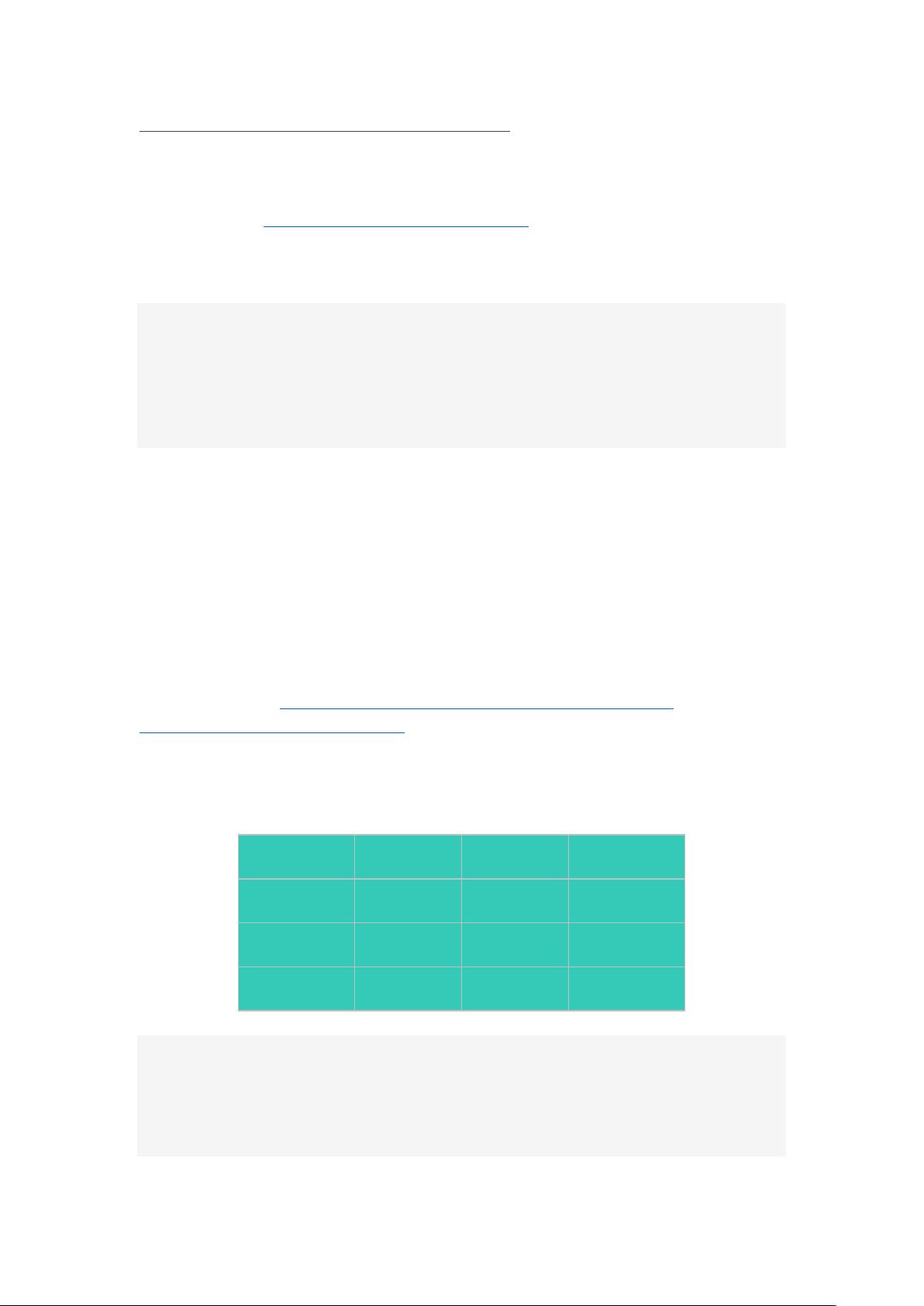

集群部署规划

节点名称

master

worker

zookeeper

bigdata11

master

zookeeper

bigdata12

master

worker

zookeeper

bigdata13

worker

zookeeper

2. 解压

[admin@bigdata11 software]$ tar zxvf flink-1.6.1-bin-hadoop27-

scala_2.11.tgz -C /opt/module/

[admin@bigdata11 software]$ cd /opt/module/

[admin@bigdata11 module]$ ll

drwxr-xr-x 8 admin admin 125 Sep 15 04:47 flink-1.6.1

3. 修改配置文件

[admin@bigdata11 conf]$ ls

flink-conf.yaml log4j-console.properties log4j-yarn-

session.properties logback.xml masters sql-client-

defaults.yaml

log4j-cli.properties log4j.properties logback-console.xml

logback-yarn.xml slaves zoo.cfg

修改 flink/conf/masters,slaves,flink-conf.yaml

[admin@bigdata11 conf]$ sudo vi masters

bigdata11:8081

[admin@bigdata11 conf]$ sudo vi slaves

bigdata12

bigdata13

[admin@bigdata11 conf]$ sudo vi flink-conf.yaml

taskmanager.numberOfTaskSlots:2

jobmanager.rpc.address: bigdata11

可选配置:

� 每个 JobManager(jobmanager.heap.mb)的可用内存量,

� 每个 TaskManager(taskmanager.heap.mb)的可用内存量,

� 每台机器的可用 CPU 数量(taskmanager.numberOfTaskSlots),

� 集群中的 CPU 总数(parallelism.default)和

� 临时目录(taskmanager.tmp.dirs)

4. 拷贝安装包到各节点

[admin@bigdata11 module]$ scp -r flink-1.6.1/ admin@bigdata12:`pwd`

[admin@bigdata11 module]$ scp -r flink-1.6.1/ admin@bigdata13:`pwd`

5. 配置环境变量

配置所有节点 Flink 的环境变量

[admin@bigdata11 flink-1.6.1]$ sudo vi /etc/profile

export FLINK_HOME=/opt/module/flink-1.6.1

export PATH=$PATH:$FLINK_HOME/bin

[admin@bigdata11 flink-1.6.1]$ source /etc/profile

6. 启动 flink

[admin@bigdata11 flink-1.6.1]$ ./bin/start-cluster.sh

Starting cluster.

Starting standalonesession daemon on host bigdata11.

Starting taskexecutor daemon on host bigdata12.

Starting taskexecutor daemon on host bigdata13.

jps 查看进程

7. WebUI 查看

http://bigdata11:8081

8. Flink 的 HA

首先,我们需要知道 Flink 有两种部署的模式,分别是 Standalone 以及 Yarn Cluster 模式。对

于 Standalone 来说,Flink 必须依赖于 Zookeeper 来实现 JobManager 的 HA(Zookeeper 已

经成为了大部分开源框架 HA 必不可少的模块)。在 Zookeeper 的帮助下,一个 Standalone

的 Flink 集群会同时有多个活着的 JobManager,其中只有一个处于工作状态,其他处于

Standby 状态。当工作中的 JobManager 失去连接后(如宕机或 Crash),Zookeeper 会从

Standby 中选举新的 JobManager 来接管 Flink 集群。

对于 Yarn Cluaster 模式来说,Flink 就要依靠 Yarn 本身来对 JobManager 做 HA 了。其实这

里完全是 Yarn 的机制。对于 Yarn Cluster 模式来说,JobManager 和 TaskManager 都是被

Yarn 启动在 Yarn 的 Container 中。此时的 JobManager,其实应该称之为 Flink Application

Master。也就说它的故障恢复,就完全依靠着 Yarn 中的 ResourceManager(和 MapReduce

的 AppMaster 一样)。由于完全依赖了 Yarn,因此不同版本的 Yarn 可能会有细微的差异。这

里不再做深究。

1) 修改配置文件

修改 flink-conf.yaml,HA 模式下,jobmanager 不需要指定,在 master file 中配置,由

zookeeper 选出 leader 与 standby。

#jobmanager.rpc.address: bigdata11

high-availability:zookeeper

#指定高可用模式(必须)

high-availability.zookeeper.quorum:bigdata11:2181,bigdata12:2181,bigdata13:2181

#ZooKeeper 仲裁是 ZooKeeper 服务器的复制组,它提供分布式协调服务(必

须)

high-availability.storageDir:hdfs:///flink/ha/

#JobManager 元数据保存在文件系统 storageDir 中,只有指向此状态的指针存

储在 ZooKeeper 中(必须)

剩余10页未读,继续阅读

资源评论

坑货两只

- 粉丝: 65

- 资源: 290

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功