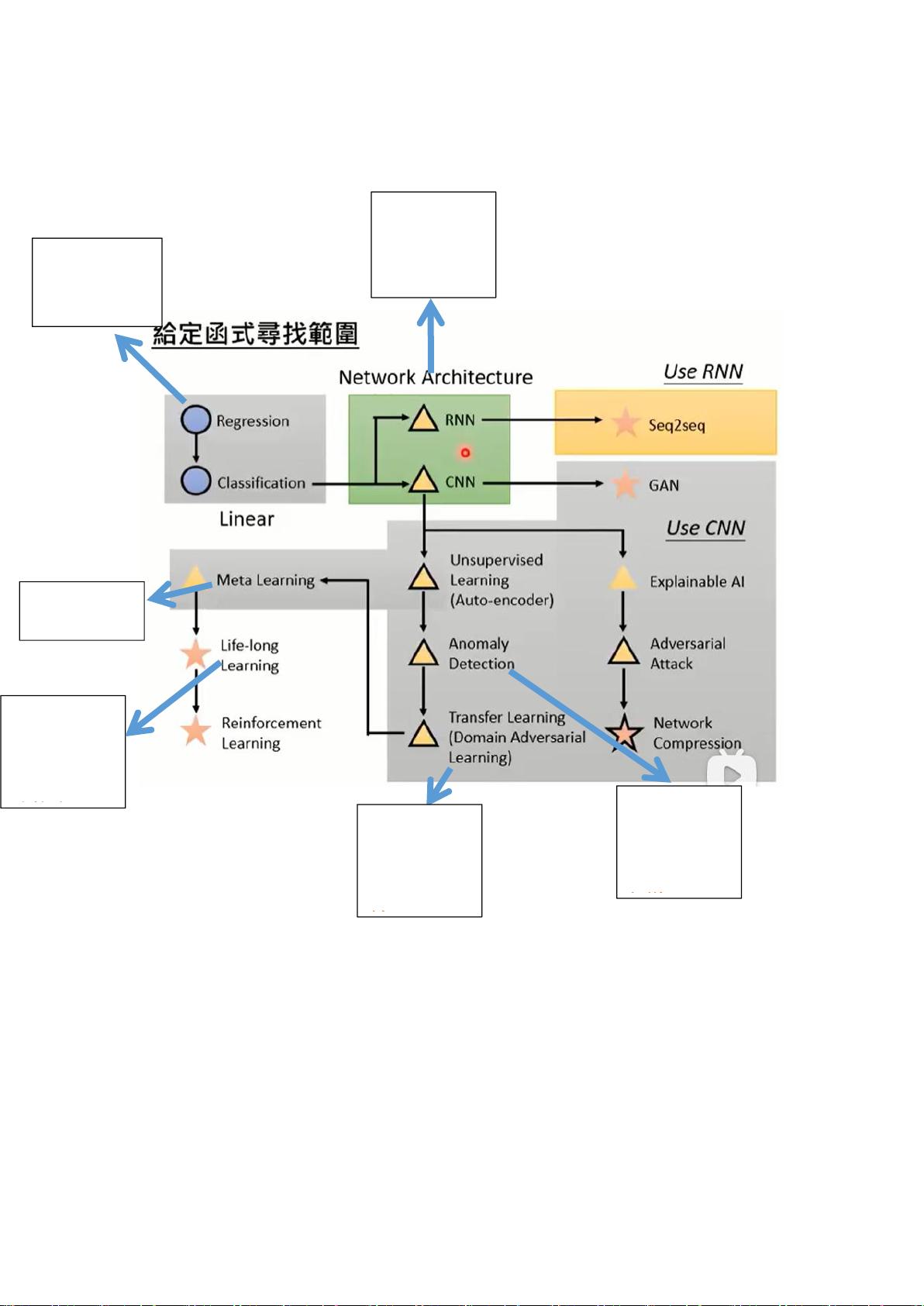

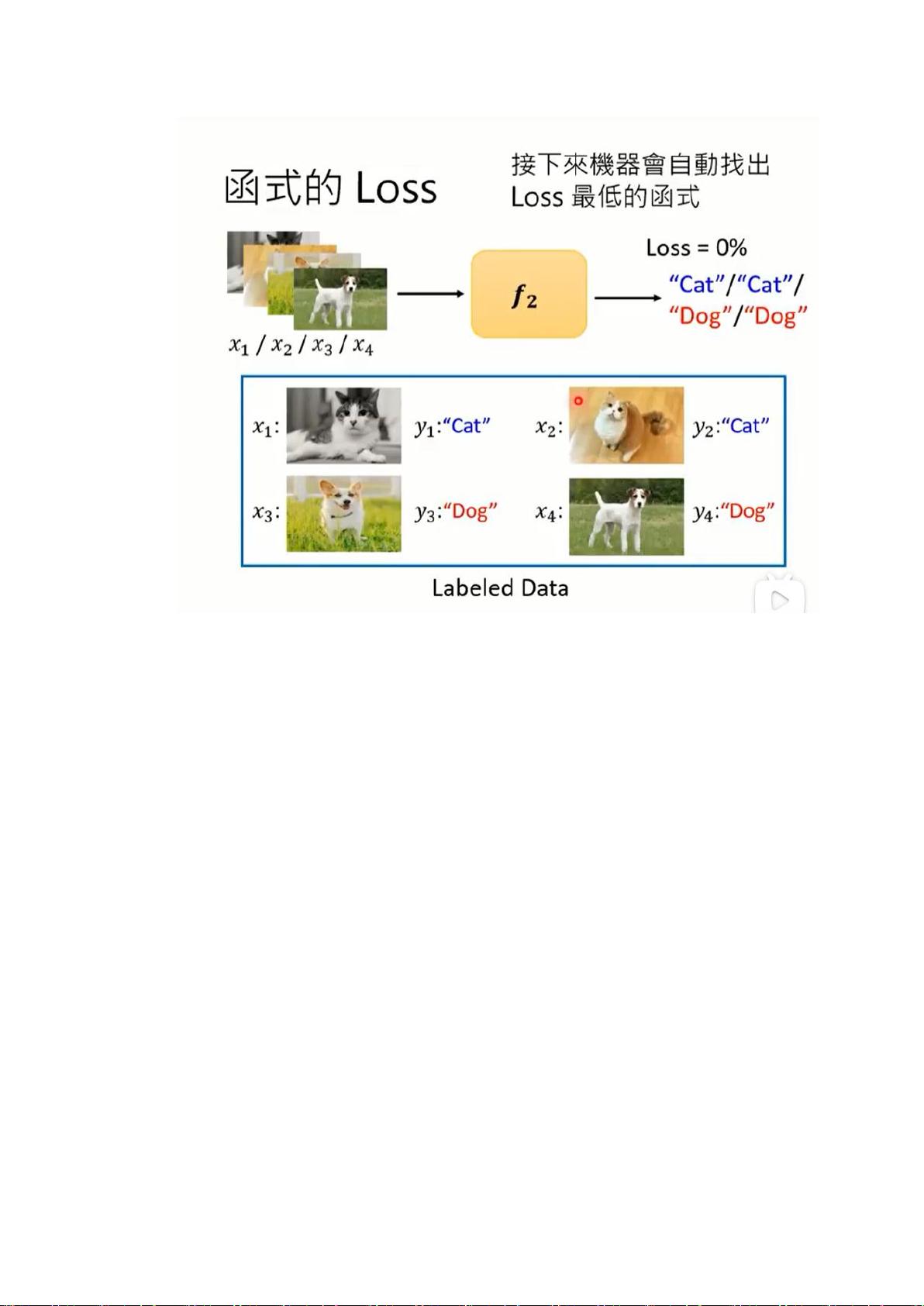

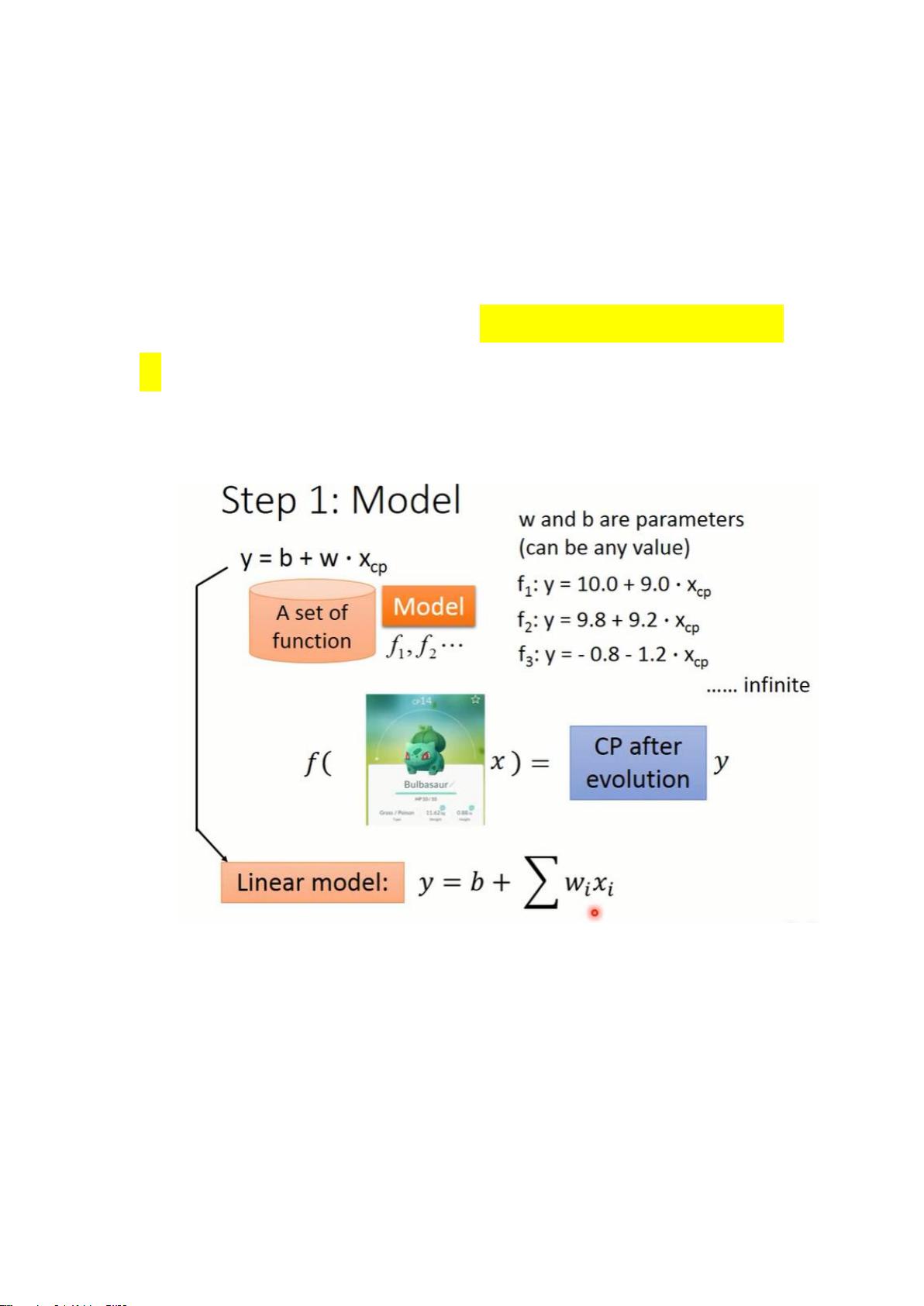

机器学习是一种人工智能技术,它的目的是让机器能够自动学习规律,并用这些规律去预测或者决定某些行为。机器学习的一个核心概念是“让机器学会如何学习”,这包括了让机器通过学习算法自动找到数据中的函数关系,以及让机器发明自己的学习算法。在机器学习领域,迁移学习、异常检测、监督学习和无监督学习是几种重要的学习方式。 监督学习是机器学习中的一种方法,它需要给机器提供已经标记好的训练数据(例如图片及对应正确的分类标签),机器通过这些训练资料去学习规律,并利用这些规律去预测新的、未标记的数据。与之不同的是无监督学习,例如强化学习,机器在这种情况下并不需要标记好的资料,而是通过与环境的交互或自我对弈来学习。 回归分析是机器学习中的一个基本概念,其目的是根据输入变量来预测连续的输出变量。在回归分析的步骤中,首先需要选择一个合适的模型,这可以是一元一次方程或更高阶的方程。接下来评估函数的好坏,通常用损失函数来评价,损失函数越小表示模型越准确。通过梯度下降法等优化算法,找到使损失函数最小的函数。 梯度下降法是一种优化算法,它的目的是在模型的参数空间中寻找损失函数的最小值。其过程包括随机选择参数的初始值,然后利用损失函数对参数的偏导数来更新这些参数,重复这个过程直到收敛。不过梯度下降法也存在缺点,比如如果初始参数选择不当,可能会陷入局部最小值而不是全局最小值。在实际应用中,可以使用TensorFlow等深度学习框架来进行梯度下降法的练习和应用。 误差来源可以分为偏差(bias)和方差(variance)。偏差是指模型与真实函数之间的偏差,而方差则指的是模型在训练集和测试集上的表现差异。如果模型在训练集上都无法很好地拟合,那么模型的偏差较大,如果模型在训练集上表现良好但在测试集上表现不佳,则可能是方差较大。解决偏差问题通常需要重新选择模型,而解决方差问题则可能需要更多的数据。 分类是机器学习中的另一个核心问题,它跟回归分析的区别在于,分类是预测离散值,而非连续值。分类问题的模型设计同样可以通过梯度下降法等优化算法来求解最佳的参数。 逻辑回归是一种广泛应用于分类问题的统计方法,其基本思想是将分类问题转化为概率问题,通过逻辑函数来预测结果属于某一类的概率。逻辑回归的步骤包括选择合适的函数集合,评估函数的好坏,以及找到最佳的函数。 深度学习是机器学习的一个分支,它通过建立深层的神经网络模型来模拟人脑进行分析和学习。深度学习的步骤包括定义一组函数,评估这组函数的好坏,以及从这组函数中挑选出最佳的函数。深度学习过程的技巧包括选用合适的激活函数、使用不同的优化算法如RMSProp、Momentum,以及应用正则化和Dropout来防止过拟合。 在深度学习中,有许多激活函数可供选择,ReLU、Maxout、RMSProp等都是近年来提出的新型激活函数。每种激活函数都有其特定的优点和适用场景,比如ReLU函数能够缓解梯度消失的问题,而Maxout可以看作是ReLU的一个推广,RMSProp则是一种自适应学习率的优化算法。Momentum和Regularization是优化算法中用来加速学习和防止过拟合的方法,而Dropout是一种正则化技术,用于随机丢弃神经网络中的一部分,从而减少模型对特定训练数据的依赖。 以上内容概述了机器学习的基础知识,从机器学习的定义、监督学习和无监督学习的区别、回归分析的步骤、梯度下降法及其应用,到模型误差的来源以及分类问题的解决,再到逻辑回归和深度学习的原理和技术细节。这些知识构成了机器学习领域的基础架构,对于理解更高级的机器学习技术和应用至关重要。

剩余24页未读,继续阅读

- 粉丝: 79

- 资源: 1

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功