没有合适的资源?快使用搜索试试~ 我知道了~

温馨提示

试读

12页

机器学习数学基础:线性代数+微积分+概率统计+优化算法 机器学习作为现代科技的璀璨明珠,正在逐渐改变我们的生活。而在这背后,数学扮演着至关重要的角色。线性代数、微积分、概率统计和优化算法,这四大数学领域为机器学习提供了坚实的理论基础。 线性代数是机器学习中的基础语言。矩阵和向量作为线性代数中的核心概念,是数据表示和计算的基础。在机器学习中,我们经常需要将数据转化为矩阵形式,通过矩阵运算提取数据的特征。特征提取是机器学习模型训练的关键步骤,而线性代数则为我们提供了高效处理数据的工具。 微积分则是机器学习模型优化的得力助手。在机器学习中,我们通常需要找到一种模型,使得它在给定数据集上的性能达到最优。这就需要我们对模型进行求导,分析模型参数对性能的影响,进而调整参数以优化模型。微积分中的导数概念为我们提供了分析模型性能变化的方法,帮助我们找到最优的模型参数。 概率统计则是机器学习数据处理和模型评估的基石。在机器学习中,数据往往带有噪声和不确定性,而概率统计可以帮助我们评估数据的分布和特征,进而构建更加稳健的模型。同时,概率统计也为我们提供了模型评估的方法,通过计算模型的准确率、召回率

资源推荐

资源详情

资源评论

###

第一章 数学基础

1.1 向量和矩阵

1.1.1 标量、向量、矩阵、张量之间的联系

1.1.2 张量与矩阵的区别

1.1.3 矩阵和向量相乘结果

1.1.4 向量和矩阵的范数归纳

1.1.5 如何判断一个矩阵为正定

1.2 导数和偏导数

1.2.1 导数偏导计算

1.2.2 导数和偏导数有什么区别?

1.3 特征值和特征向量

1.3.1 特征值分解与特征向量

1.3.2 奇异值与特征值有什么关系

1.4 概率分布与随机变量

1.4.1 机器学习为什么要使用概率

1.4.2 变量与随机变量有什么区别

1.4.3 随机变量与概率分布的联系

1.4.4 离散型随机变量和概率质量函数

1.4.5 连续型随机变量和概率密度函数

1.4.6 举例理解条件概率

1.4.7 联合概率与边缘概率联系区别

1.4.8 条件概率的链式法则

1.4.9 独立性和条件独立性

1.5 常见概率分布

1.5.1 Bernoulli分布

1.5.2 高斯分布

1.5.3 何时采用正态分布

1.5.4 指数分布

1.5.5 Laplace 分布

1.5.6 Dirac分布和经验分布

1.6 期望、方差、协方差、相关系数

1.6.1 期望

1.6.2 方差

1.6.3 协方差

1.6.4 相关系数

参考文献

第一章 数学基础

深度学习通常又需要哪些数学基础?深度学习里的数学到底难在哪里?通常初学者都会有这些问题,在

网络推荐及书本推荐里,经常看到会列出一系列数学科目,比如微积分、线性代数、概率论、复变函

数、数值计算、优化理论、信息论等等。这些数学知识有相关性,但实际上按照这样的知识范围来学

习,学习成本会很久,而且会很枯燥,本章我们通过选举一些数学基础里容易混淆的一些概念做以介

绍,帮助大家更好的理清这些易混淆概念之间的关系。

1.1 向量和矩阵

1.1.1 标量、向量、矩阵、张量之间的联系

标量(scalar)

一个标量表示一个单独的数,它不同于线性代数中研究的其他大部分对象(通常是多个数的数组)。我

们用斜体表示标量。标量通常被赋予小写的变量名称。

向量(vector)

一个向量表示一组有序排列的数。通过次序中的索引,我们可以确定每个单独的数。通常我们赋予向量

粗体的小写变量名称,比如xx。向量中的元素可以通过带脚标的斜体表示。向量$X$的第一个元素是

$X_1$,第二个元素是$X_2$,以此类推。我们也会注明存储在向量中的元素的类型(实数、虚数

等)。

矩阵(matrix)

矩阵是具有相同特征和纬度的对象的集合,表现为一张二维数据表。其意义是一个对象表示为矩阵中的

一行,一个特征表示为矩阵中的一列,每个特征都有数值型的取值。通常会赋予矩阵粗体的大写变量名

称,比如$A$。

张量(tensor)

在某些情况下,我们会讨论坐标超过两维的数组。一般地,一个数组中的元素分布在若干维坐标的规则

网格中,我们将其称之为张量。使用 $A$ 来表示张量“A”。张量$A$中坐标为$(i,j,k)$的元素记作

$A_{(i,j,k)}$。

四者之间关系

标量是0阶张量,向量是一阶张量。举例:

标量就是知道棍子的长度,但是你不会知道棍子指向哪儿。

向量就是不但知道棍子的长度,还知道棍子指向前面还是后面。

张量就是不但知道棍子的长度,也知道棍子指向前面还是后面,还能知道这棍子又向上/下和左/

右偏转了多少。

1.1.2 张量与矩阵的区别

从代数角度讲, 矩阵它是向量的推广。向量可以看成一维的“表格”(即分量按照顺序排成一排),

矩阵是二维的“表格”(分量按照纵横位置排列), 那么$n$阶张量就是所谓的$n$维的“表格”。 张

量的严格定义是利用线性映射来描述。

从几何角度讲, 矩阵是一个真正的几何量,也就是说,它是一个不随参照系的坐标变换而变化的

东西。向量也具有这种特性。

张量可以用3×3矩阵形式来表达。

表示标量的数和表示向量的三维数组也可分别看作1×1,1×3的矩阵。

1.1.3 矩阵和向量相乘结果

若使用爱因斯坦求和约定(Einstein summation convention),矩阵$A$, $B$相乘得到矩阵$C$可以

用下式表示:

$$ a{ik}*b{kj}=c{ij} \tag{1.3-1} $$

其中

,

$a{ik}$, $b{kj}$, $c{ij}$分别表示矩阵$A, B, C$的元素,$k$出现两次,是一个哑变量(Dummy

Variables)表示对该参数进行遍历求和。

而矩阵和向量相乘可以看成是矩阵相乘的一个特殊情况,例如:矩阵$B$是一个$n \times 1$的矩阵。

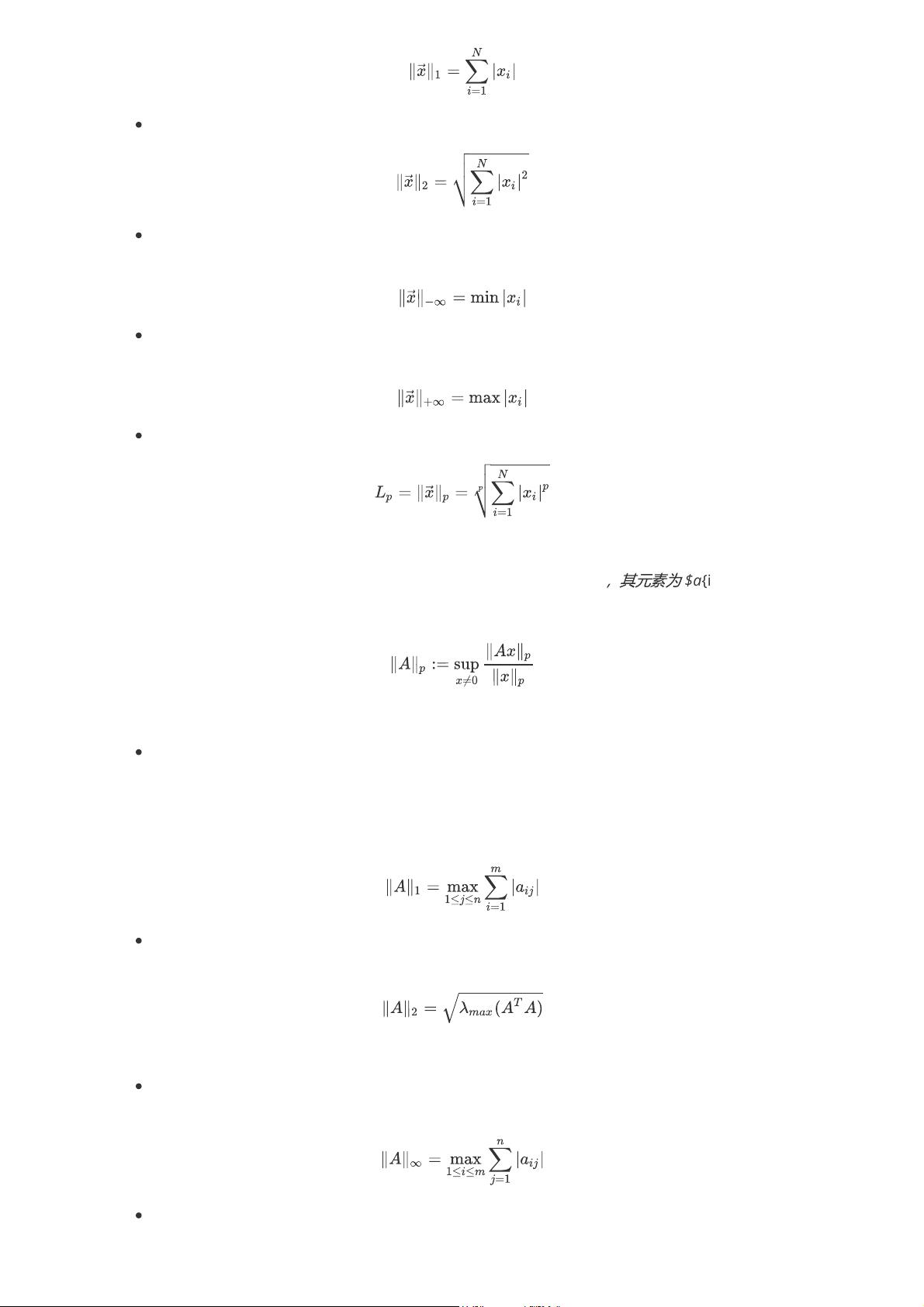

1.1.4 向量和矩阵的范数归纳

向量的范数(norm)

定义一个向量为:$\vec{a}=[-5, 6, 8, -10]$。任意一组向量设为$\vec{x}=(x_1,x_2,...,x_N)$。其不同

范数求解如下:

向量的1范数:向量的各个元素的绝对值之和,上述向量$\vec{a}$的1范数结果就是:29。

向量的2范数:向量的每个元素的平方和再开平方根,上述$\vec{a}$的2范数结果就是:15。

向量的负无穷范数:向量的所有元素的绝对值中最小的:上述向量$\vec{a}$的负无穷范数结果就

是:5。

向量的正无穷范数:向量的所有元素的绝对值中最大的:上述向量$\vec{a}$的正无穷范数结果就

是:10。

向量的p范数:

矩阵的范数

定义一个矩阵$A=[-1, 2, -3; 4, -6, 6]$。 任意矩阵定义为:$A{m\times n}$

,

其元

素

为

$a{ij}$。

矩阵的范数定义为

当向量取不同范数时, 相应得到了不同的矩阵范数。

矩阵的1范数(列范数):矩阵的每一列上的元

素绝对值先求和,再从中取个最大的,(列和最大),上述矩阵$A$的1范数先得到$[5,8,9]$,再取

最大的最终结果就是:9。

矩阵的2范数:矩阵$A^TA$的最大特征值开平方根,上述矩阵$A$的2范数得到的最终结果是:

10.0623。

其中, $\lambda_{max}(A^T A)$ 为 $A^T A $ 的特征值绝对值的最大值。

矩阵的无穷范数(行范数):矩阵的每一行上的元素绝对值先求和,再从中取个最大的,(行和最

大),上述矩阵$A$的行范数先得到$[6;16]$,再取最大的最终结果就是:16。

矩阵的核范数:矩阵的奇异值(将矩阵svd分解)之和,这个范数可以用来低秩表示(因为最小化

核范数,相当于最小化矩阵的秩——低秩),上述矩阵A最终结果就是:10.9287。

剩余11页未读,继续阅读

资源评论

fighting的码农(zg)-GPT

- 粉丝: 345

- 资源: 34

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功