没有合适的资源?快使用搜索试试~ 我知道了~

温馨提示

试读

48页

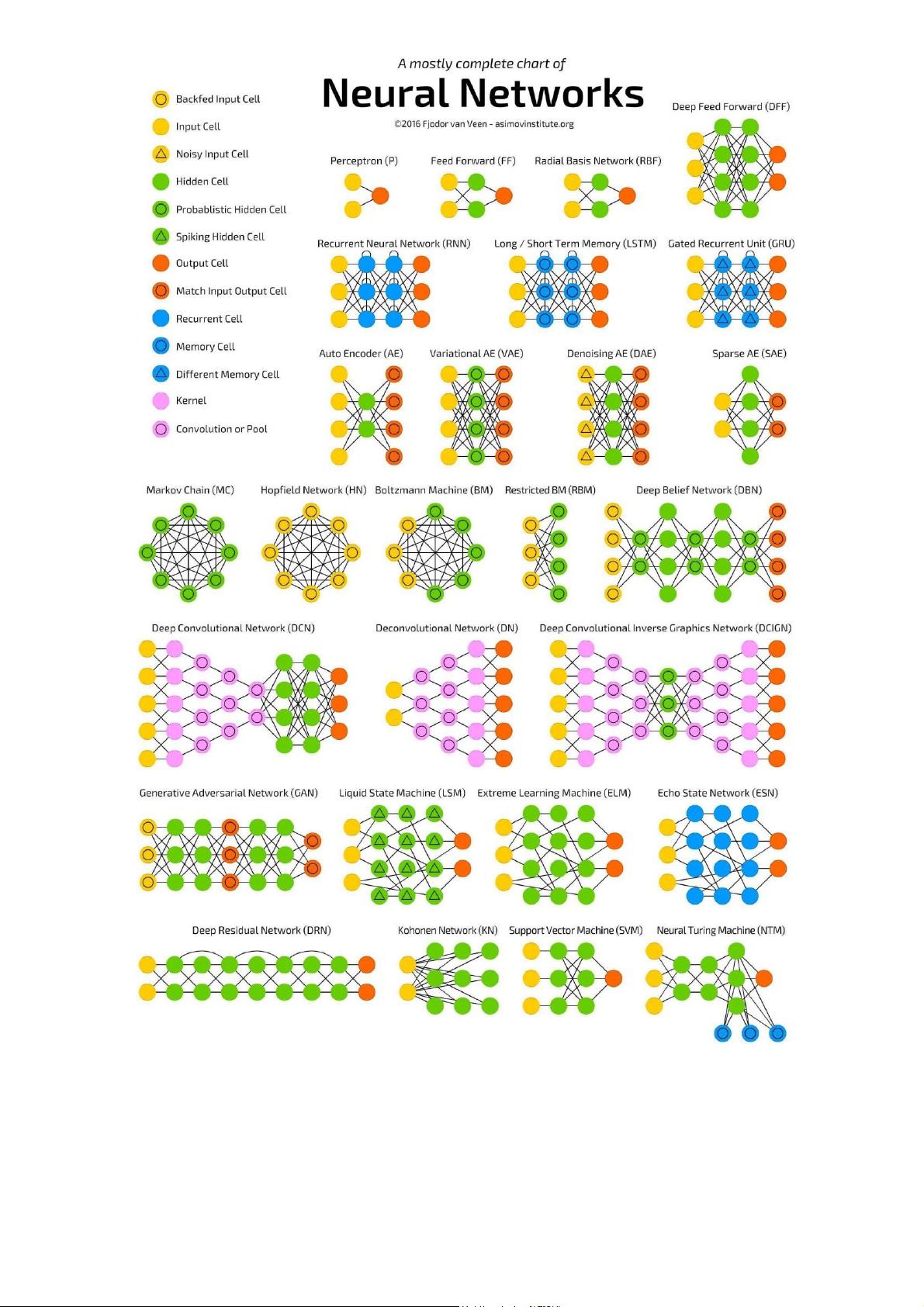

深度学习基础:神经网络+激活函数+反向传播+优化算法 深度学习,作为机器学习的一个重要分支,以其强大的特征学习和表示能力,在图像识别、自然语言处理等领域取得了显著的成果。要深入理解并应用深度学习,掌握其基础知识显得尤为重要。其中,神经网络、激活函数、反向传播和优化算法是深度学习的四大基础要素。 神经网络是深度学习模型的核心。它模仿人脑神经元的连接方式,通过多层网络结构,逐层提取数据的特征。理解神经网络的结构和原理,是构建高效深度学习模型的关键。 激活函数为神经网络引入了非线性因素,使得模型能够学习并表示复杂的数据模式。常用的激活函数包括Sigmoid、ReLU等,它们各自具有不同的特点和适用场景。正确选择和使用激活函数,对于提升模型的性能至关重要。 反向传播是深度学习模型训练的核心算法。它通过计算损失函数对模型参数的梯度,指导模型参数的更新方向。掌握反向传播的原理和实现方法,有助于我们更好地理解深度学习模型的训练过程,并有效地调整模型参数。 优化算法则是用于调整模型参数的具体方法。常见的优化算法包括梯度下降、Adam等。这些算法通过不同的方式调整学习率和参数更新策略,以加速模

资源推荐

资源详情

资源评论

第三章 深度学习基础

3.1 基本概念

3.1.1 神经网络组成?

3.1.2 神经网络有哪些常用模型结构?

3.1.3 如何选择深度学习开发平台?

3.1.4 为什么使用深层表示?

3.1.5 为什么深层神经网络难以训练?

3.1.6 深度学习和机器学习有什么不同?

3.2 网络操作与计算

3.2.1 前向传播与反向传播?

3.2.2 如何计算神经网络的输出?

3.2.3 如何计算卷积神经网络输出值?

3.2.4 如何计算 Pooling 层输出值输出值?

3.2.5 实例理解反向传播

3.2.6 神经网络更“深”有什么意义?

3.3 超参数

3.3.1 什么是超参数?

3.3.2 如何寻找超参数的最优值?

3.3.3 超参数搜索一般过程?

3.4 激活函数

3.4.1 为什么需要非线性激活函数?

3.4.2 常见的激活函数及图像

3.4.3 常见激活函数的导数计算?

3.4.4 激活函数有哪些性质?

3.4.5 如何选择激活函数?

3.4.6 使用 ReLu 激活函数的优点?

3.4.7 什么时候可以用线性激活函数?

3.4.8 怎样理解 Relu(< 0 时)是非线性激活函数?

3.4.9 Softmax 定义及作用

3.4.10 Softmax 函数如何应用于多分类?

3.4.11 交叉熵代价函数定义及其求导推导

3.4.12 为什么Tanh收敛速度比Sigmoid快?

3.5 Batch_Size

3.5.1 为什么需要 Batch_Size?

3.5.2 Batch_Size 值的选择

3.5.3 在合理范围内,增大Batch_Size有何好处?

3.5.4 盲目增大 Batch_Size 有何坏处?

3.5.5 调节 Batch_Size 对训练效果影响到底如何?

3.6 归一化

3.6.1 归一化含义?

3.6.2 为什么要归一化?

3.6.3 为什么归一化能提高求解最优解速度?

3.6.4 3D 图解未归一化

3.6.5 归一化有哪些类型?

3.6.6 局部响应归一化作用

3.6.7 理解局部响应归一化

3.6.8 什么是批归一化(Batch Normalization)

3.6.9 批归一化(BN)算法的优点

3.6.10 批归一化(BN)算法流程

3.6.11 批归一化和群组归一化比较

3.6.12 Weight Normalization和Batch Normalization比较

3.6.13 Batch Normalization在什么时候用比较合适?

3.7 预训练与微调(fine tuning)

3.7.1 为什么无监督预训练可以帮助深度学习?

3.7.2 什么是模型微调fine tuning

3.7.3 微调时候网络参数是否更新?

3.7.4 fine-tuning 模型的三种状态

3.8 权重偏差初始化

3.8.1 全都初始化为 0

3.8.2 全都初始化为同样的值

3.8.3 初始化为小的随机数

3.8.4 用 $ 1/\sqrt n $ 校准方差

3.8.5 稀疏初始化(Sparse Initialazation)

3.8.6 初始化偏差

3.9 学习率

3.9.1 学习率的作用

3.9.2 学习率衰减常用参数有哪些

3.9.3 分段常数衰减

3.9.4 指数衰减

3.9.5 自然指数衰减

3.9.6 多项式衰减

3.9.7 余弦衰减

3.12 Dropout 系列问题

3.12.1 为什么要正则化?

3.12.2 为什么正则化有利于预防过拟合?

3.12.3 理解dropout正则化

3.12.4 dropout率的选择

3.12.5 dropout有什么缺点?

3.13 深度学习中常用的数据增强方法?

3.14 如何理解 Internal Covariate Shift?

参考文献

第三章 深度学习基础

3.1 基本概念

3.1.1 神经网络组成?

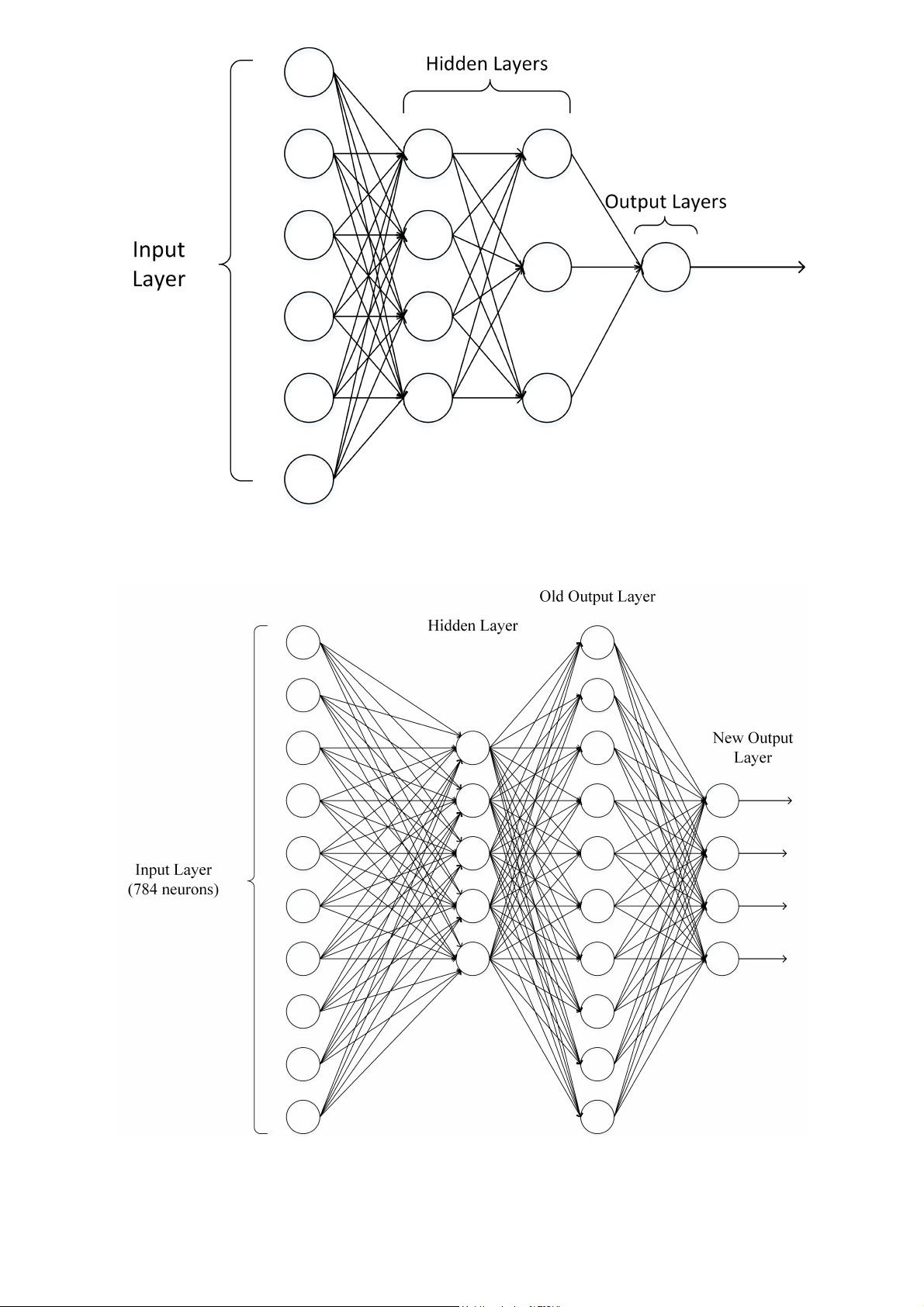

神经网络类型众多,其中最为重要的是多层感知机。为了详细地描述神经网络,我们先从最简单的神经

网络说起。

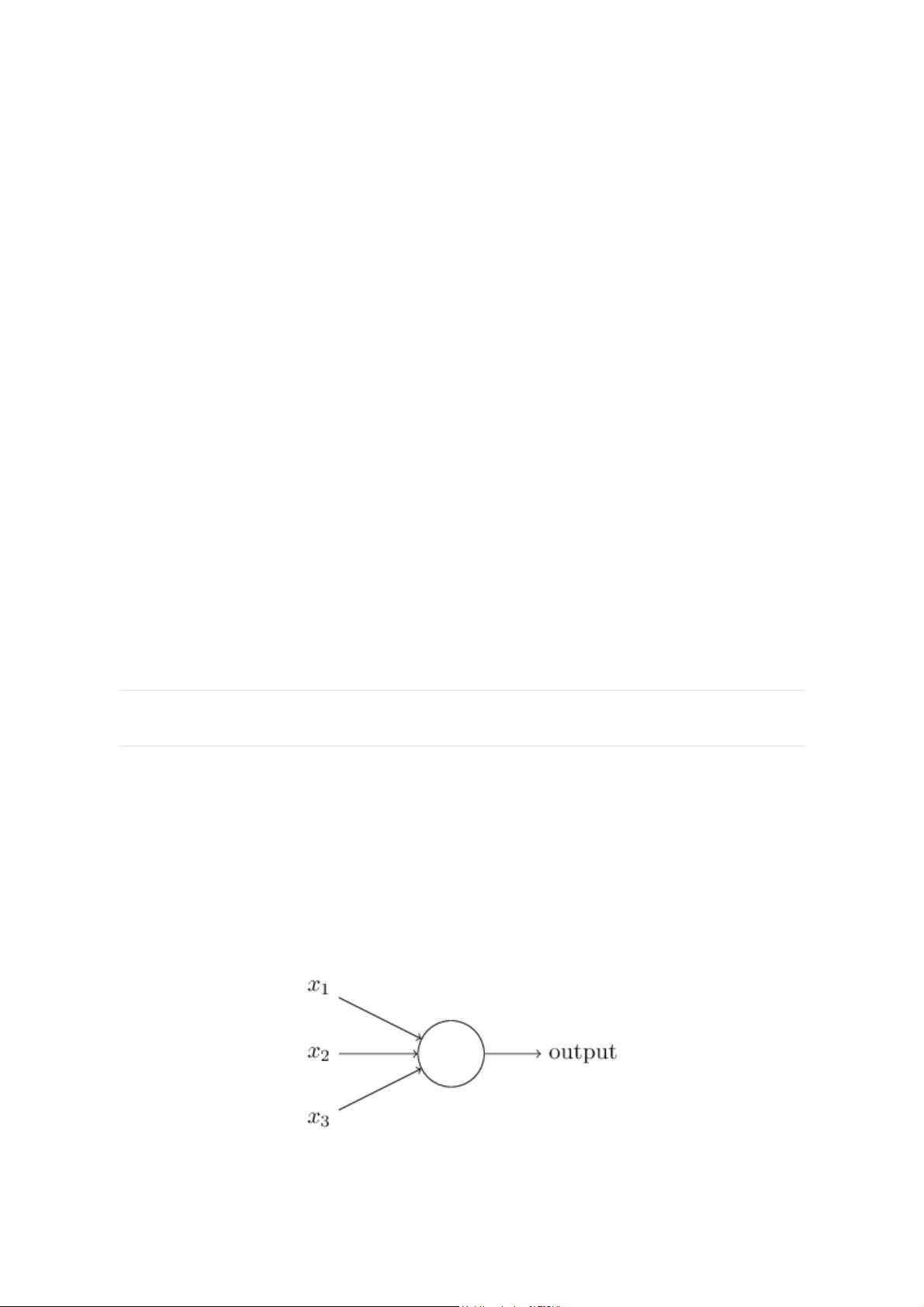

感知机

多层感知机中的特征神经元模型称为感知机,由Frank Rosenblatt于1957年发明。

简单的感知机如下图所示:

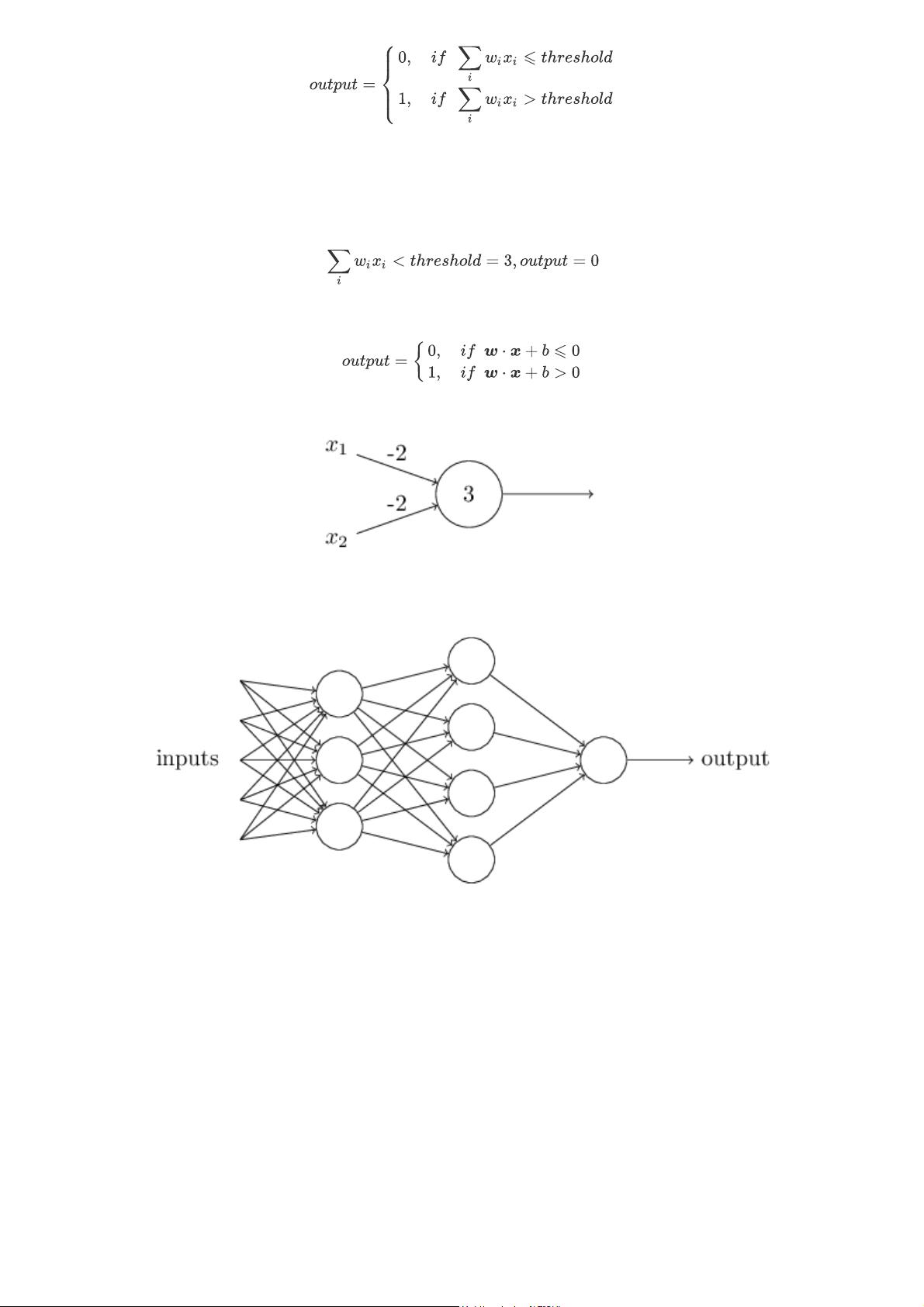

其中$x_1$,$x_2$,$x_3$为感知机的输入,其输出为:

假如把感知机想象成一个加权投票机制,比如 3 位评委给一个歌手打分,打分分别为$ 4 $分、$1$ 分、

$-3 $分,这$ 3$ 位评分的权重分别是 $1、3、2$,则该歌手最终得分为 $4 \times 1 + 1 \times 3 +

(-3) \times 2 = 1$ 。按照比赛规则,选取的 $threshold$ 为 $3$,说明只有歌手的综合评分大于$ 3$

时,才可顺利晋级。对照感知机,该选手被淘汰,因为:

用 $-b$ 代替 $threshold$,输出变为:

设置合适的 $\boldsymbol{x}$ 和 $b$ ,一个简单的感知机单元的与非门表示如下:

当输入为 $0$,$1$ 时,感知机输出为 $ 0 \times (-2) + 1 \times (-2) + 3 = 1$。

复杂一些的感知机由简单的感知机单元组合而成:

多层感知机

多层感知机由感知机推广而来,最主要的特点是有多个神经元层,因此也叫深度神经网络。相比于单独

的感知机,多层感知机的第 $ i $ 层的每个神经元和第 $ i-1 $ 层的每个神经元都有连接。

剩余47页未读,继续阅读

资源评论

fighting的码农(zg)-GPT

- 粉丝: 345

- 资源: 34

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功