没有合适的资源?快使用搜索试试~ 我知道了~

资源详情

资源评论

资源推荐

1. Jieba

"结巴"中文分词:做最好的 Python 中文分词组件 "Jieba"。

Windows 和 Linux 下均可安装使用,安装命令:pip install jieba。

1.1 demo1--jieba 的三种切词模式:全模式、精确模式、搜索引擎模式

我来到北京清华大学

!"#全模式

我来到北京清华大学

$ !"#精确模式

他来到了网易杭研大厦默认是精确模式

%小明硕士毕业于中国科学院计算所,后在

日本京都大学深造搜索引擎模式

我在学 ,感觉它还是挺有意思的

我在学 ,感觉它还是挺有意思的

#

我在学 ,感觉它还是挺有意思的

#

%小博硕士就读于江苏师范大学,希望能顺

利毕业找到一份好工作

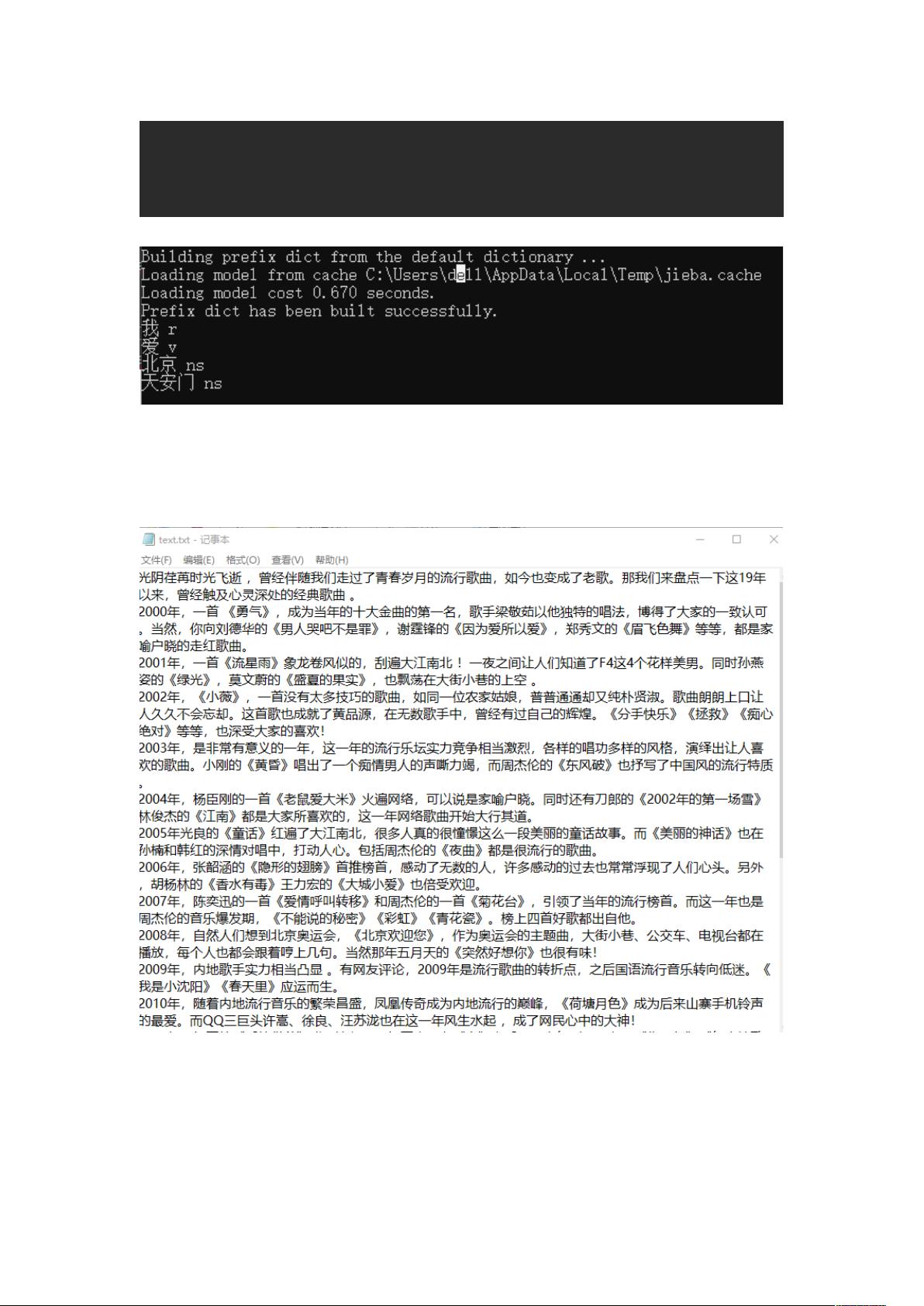

1.2 demo2--jieba 用于词性标注

&我爱北京天安门

&'&!

&'

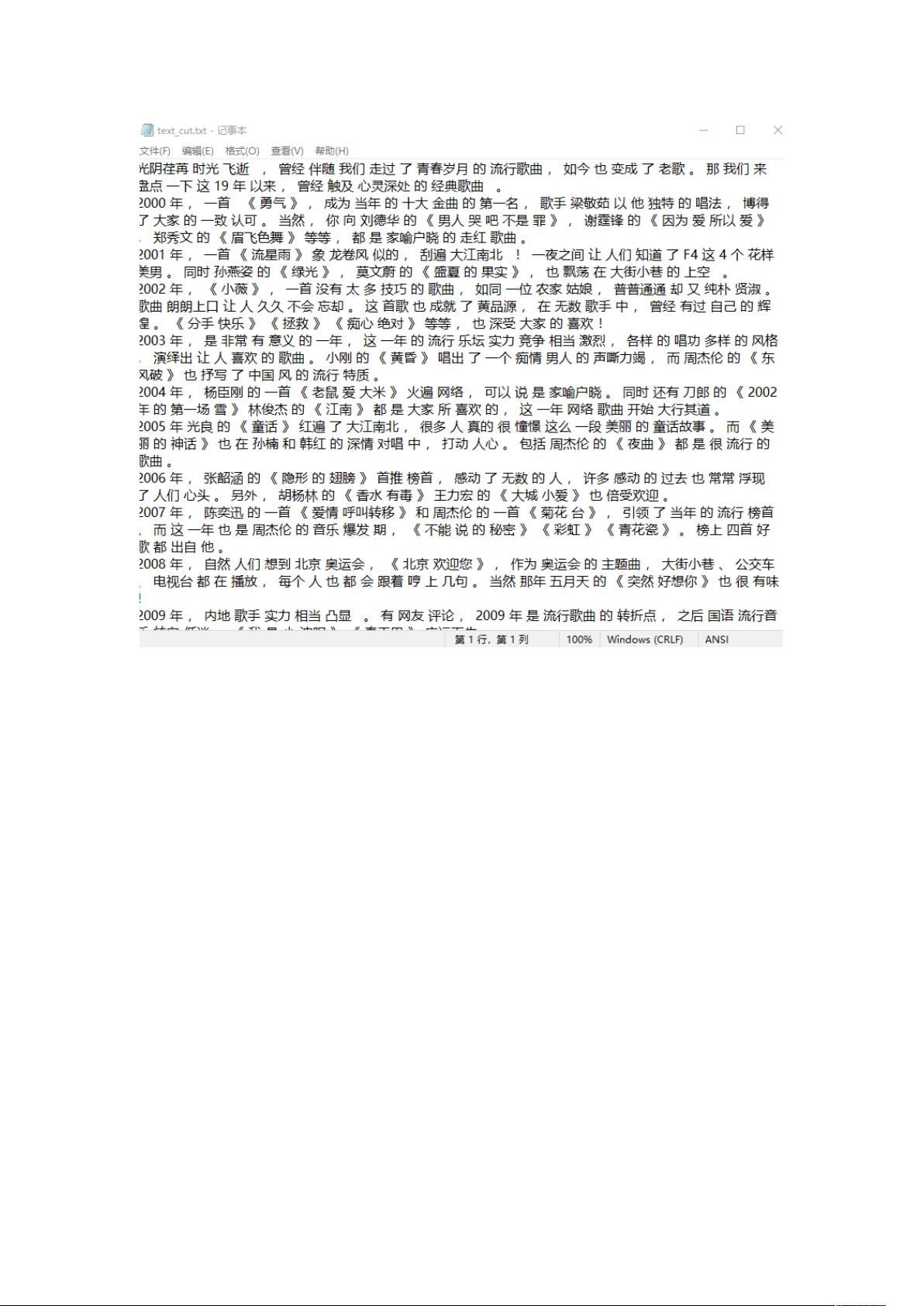

1.3 demo3--jieba 用于文件分词

python -m jieba -d “ “ text.txt > text_cut.txt

2. SnowNLP

SnowNLP 是一个 python 写的类库,可以方便的处理中文文本内容,是受

到了[TextBlob](https://github.com/sloria/TextBlob)的启发而写的,由于现在大部

分的自然语言处理库基本都是针对英文的,于是写了一个方便处理中文的类库,

并且和 TextBlob 不同的是,这里没有用 NLTK,所有的算法都是自己实现的,

并且自带了一些训练好的字典。

剩余21页未读,继续阅读

中科小白

- 粉丝: 14

- 资源: 5

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0