总结:一文搞懂 chatGPT 原理

目前关于 chatGPT 的资料过于零散,没有详尽所有知识点、系统概述的文

章,因此,笔者作了这篇总结性文章。

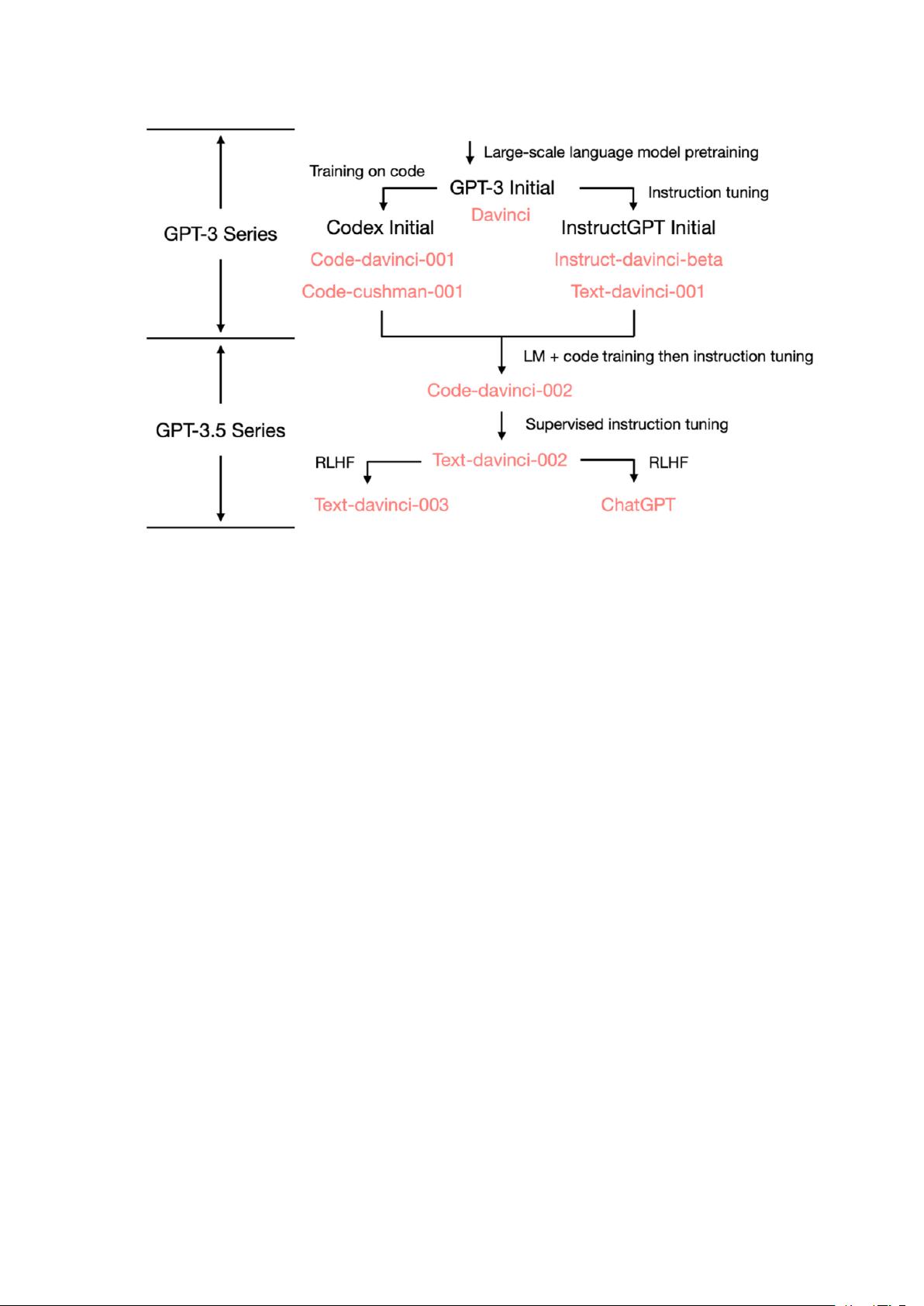

训练过程总览

理清演化路径

预训练(pretrain)

GPT-3 概述

GPT 3 模型的理念

GPT-3 如何学习

数据集

指令微调 (Instruction Fine-Tuning,IFT)

有监督微调 (Supervised Fine-tuning, SFT)

人类反馈强化学习 (Reinforcement Learning From Human Feedback,RLHF)

其他方法

思维链 (Chain-of-thought,CoT)

与 chatGPT 类似的工作

训练过程总览

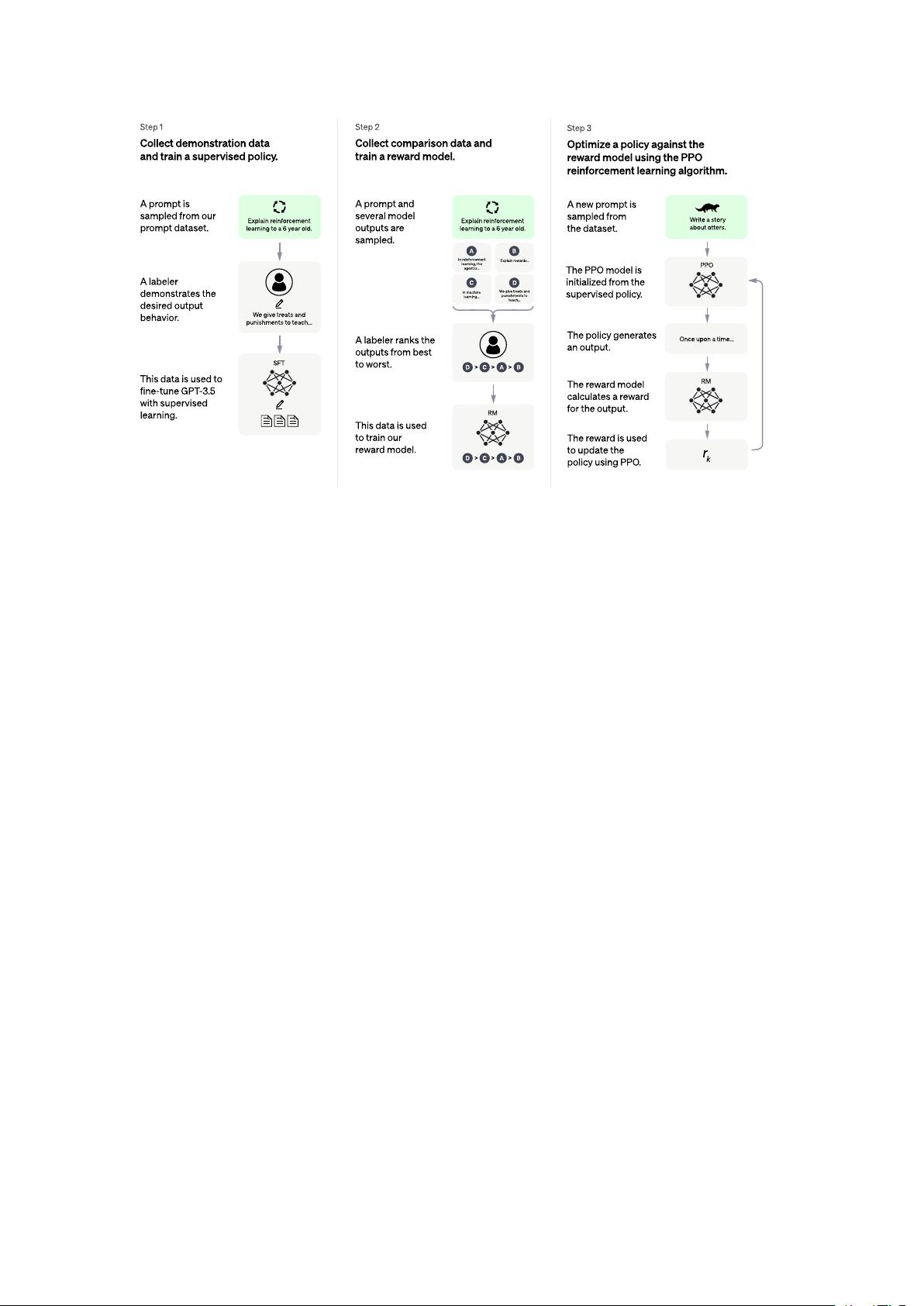

OpenAI 使用了 175B 参数的大型语言模型(LM) 和 6B 参数的奖励模型

(RM)。除预训练之外,训练过程分为三步:

1.收集 NLP 各种任务的数据集,加上任务描述和提示组装成新的数据集,并使用

这些数据微调预训练的大型语言模型。包括指令微调和有监督微调。

2.从上述数据集中采样,使用大型语言模型生成多个响应,手动对这些响应进行

排名,并训练奖励模型 (RM) 以适应人类偏好。

3.基于第一阶段的有监督微调模型和第二阶段的奖励模型,使用强化学习算法进

一步训练大型语言模型。