没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

机器学习高频问答题

第一章 线性回归

1. 什么是线性回归?你能解释它的主要原理吗?

线性回归是一种统计方法,用于建立一个或多个自变量(预测变量)和一个因变量(响应变量)之间

的关系模型。它假设变量之间存在线性关系,通过找到最佳拟合直线(在简单线性回归中)或超平面(在

多元线性回归中),来预测响应变量的值。

其主要原理基于最小二乘法,目的是最小化实际观测值和模型预测值之间差异的平方和。通过这种方

式,线性回归尝试画出一条直线(或超平面),尽可能接近所有观测点,从而能够用来预测新的数据点的

响应值。

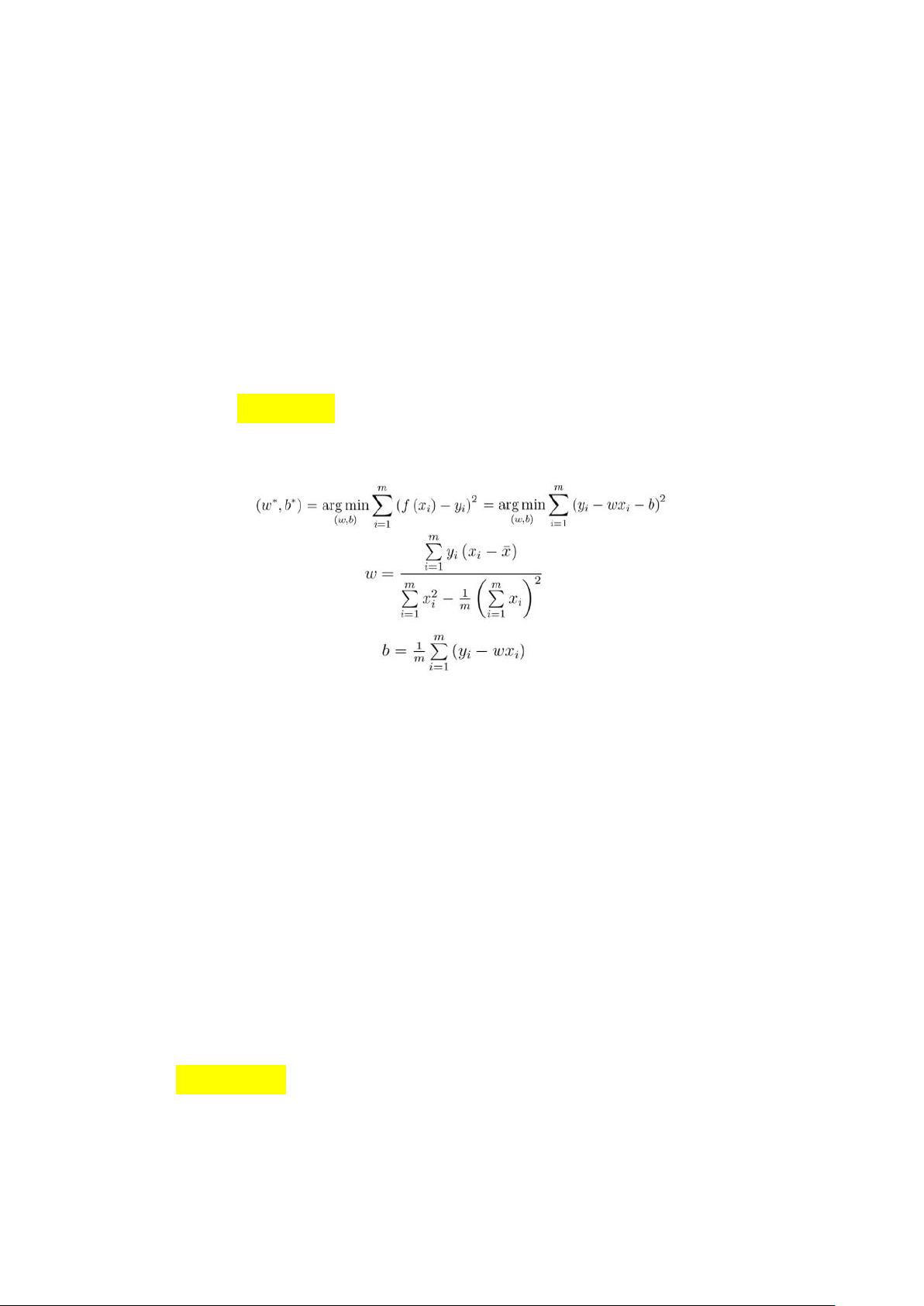

2. 解释线性回归中最小二乘法的原理吗?

最小二乘法是在线性回归分析中常用的一种方法,用于估计模型的系数,使得预测误差的平方和最小。

在线性回归中,我们的目标是找到一条直线(或在多元线性回归中是一个平面或超平面),这条直线

能够尽可能准确地预测因变量的值。为了量化直线(或超平面)拟合数据的好坏,我们计算每个观测点的

实际值与模型预测值之间的差距(即残差),并求这些残差的平方和。

最小二乘法通过优化过程寻找使得残差平方和最小的系数值。具体来说,它通过计算导数并设置导数

为零,来找到系数的最佳估计值。这个过程确保了我们找到的直线(或超平面)在统计学意义上最好地解

释了自变量和因变量之间的关系。

简而言之,最小二乘法通过最小化预测误差的平方和,来确定线性回归模型中的最佳拟合线。这个方

法不仅可以用于简单线性回归,还可以应用于多元线性回归,从而处理更复杂的关系和更多的变量。

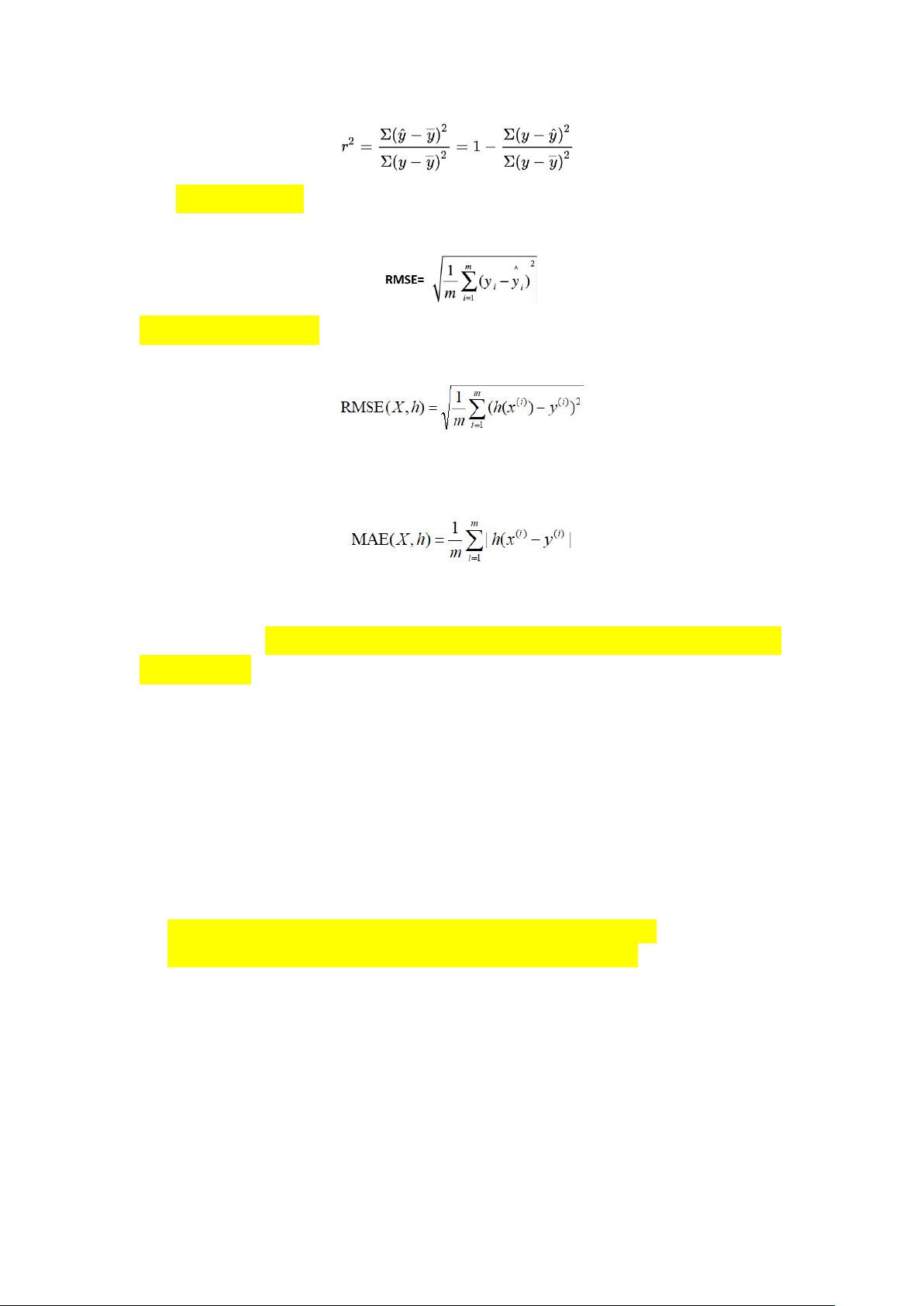

3. 如何评估线性回归模型的性能?

评估线性回归模型的性能主要依靠几个关键的统计指标来衡量模型的拟合度和预测能力:

(1)决定系数(R²):R²值衡量模型解释的变异性占总变异性的比例。其值范围从0到1,值越接近1,表

示模型解释的变异性越高,拟合度越好。R²提供了一个衡量模型整体拟合优度的快速指标。

(2)均方误差(MSE):MSE计算了预测值与实际值之间差异的平方的平均值。它是衡量模型预测精度

的一个重要指标。MSE值越小,表示模型的预测误差越小,性能越好。

(3)均方根误差(RMSE):RMSE是MSE的平方根,同样用于衡量预测误差的大小。与MSE一样,RMSE

值越小,模型的预测精度越高。

(4)平均绝对误差(MAE):MAE是预测值与实际值差异的绝对值的平均值。它直观地衡量了预测误差

的平均大小,MAE值越小,表明模型的预测能力越好。

4. 线性回归中正则化的目的是什么吗?L1正则化和L2正则化有什么不同?

在线性回归中,正则化是用来防止模型过拟合的一种技术,通过引入额外的信息(惩罚项)来约束或

减少系数的大小。正则化的主要目的是改善模型的泛化能力,即在未见数据上的表现。通过对系数大小施

加惩罚,正则化帮助确保模型不会过于依赖训练数据中的特定观测,从而减少模型在新数据上预测时的误

差。

L1正则化(也称为Lasso回归)通过向损失函数添加系数的绝对值之和的惩罚项,促使一部分系数精

确地缩减到0。这种性质使L1正则化成为一种有效的特征选择方法,因为它可以减少模型中变量的数量,

留下对输出变量有显著影响的那些变量。

L2正则化(也称为岭回归)通过向损失函数添加系数的平方和的惩罚项,倾向于使系数值均匀地缩小,

但不会将它们完全缩减到0。L2正则化有助于处理特征间的多重共线性问题,通过保留所有特征但减小系

数值的影响,从而提高模型的稳定性和泛化能力。

L1范数:||x||₁ = |x₁ | + |x₂ | + ... + |xₙ |,它是向量中各个元素绝对值之和。

L2范数:||x||₂ = √(x₁² + x₂² + ... + xₙ ²),它是向量元素的平方和的平方根。

简而言之,L1正则化倾向于产生稀疏系数矩阵,有助于特征选择,而L2正则化则通过惩罚大的系数值

来防止过拟合,保证模型的复杂度得到适当的控制。在实际应用中,根据数据的特点和需求选择适当的正

则化方法是非常重要的。

第二章 逻辑回归

1. 什么是逻辑回归

逻辑回归是一种统计学方法,用于预测一个事件发生的概率。它通过使用一个或多个自变量来预测一

个二元结果(是/否,成功/失败,1/0等)。逻辑回归在处理分类问题时特别有用,特别是在目标变量是二

分类的情况下。

2. 逻辑回归与线性回归有何不同?

逻辑回归与线性回归的主要区别在于它们处理的预测结果类型。线性回归用于预测连续的数值型结果,

例如房价、温度或销售额。逻辑回归则用于预测分类结果,特别是用于二分类问题,如是/否决策、成功/

失败结果等。

此外,逻辑回归和线性回归在模型构建时使用的函数也不同。线性回归使用的是线性函数,其预测结

果可以是任何实数。而逻辑回归使用的是逻辑函数(或称Sigmoid函数),这使得它的输出被压缩在0和1

之间,通常表示为发生某事件的概率。

3. 什么是逻辑函数,它在逻辑回归中为什么重要?

逻辑函数,也被称为Sigmoid函数,是逻辑回归中最核心的组成部分。它是一个S形的曲线,能够将任

意实数值映射到(0, 1)区间内,这使得它非常适合于处理分类问题,特别是二分类问题。逻辑函数的数学表

达式为:

,其中(e)是自然对数的底数,(x)是输入变量。

逻辑函数之所以在逻辑回归中至关重要,是因为它可以将线性回归模型的连续输出转换为概率值。这

意味着逻辑回归模型不仅能预测哪个类别更可能是正确的,还能给出这个预测的确定性或概率。例如,逻

辑回归模型可以预测一个邮件是垃圾邮件的概率是80%,而不是简单地分类为“垃圾邮件”或“非垃圾邮

件”。

4. 逻辑回归能用于多分类问题吗?如果可以,应如何应用?

逻辑回归虽然最初是为二分类问题设计的,但它也可以被扩展到多分类问题。处理多分类问题的常用

方法有两种:一对多(One-vs-Rest, OvR)和多项逻辑回归(Multinomial Logistic Regression)。

一对多(OvR)方法涉及将多分类问题分解为多个二分类问题。对于每个类别,模型将这个类别与所

有其他类别对比,构建一个二分类模型。因此,如果有N个类别,就会有N个二分类模型。在预测时,所有

模型都会被用来评估一个观测值,然后选择概率最高的类别作为最终预测。

多项逻辑回归(又称为Softmax回归)是另一种方法,它直接在一个模型中处理多个类别。与逻辑函

数用于二分类一样,多项逻辑回归使用Softmax函数来将线性函数的输出转换为概率分布。这种方法不需

要像OvR那样为每个类别构建多个模型,因此在某些情况下可能更有效率。

5. 逻辑回归模型是如何训练以找到最佳拟合的?

逻辑回归模型通过优化过程来寻找最佳拟合,这个过程涉及最大化模型对训练数据的预测准确性。具

体来说,这个优化过程通常是通过最大化似然函数来实现的,似然函数衡量了给定模型参数下,观测到的

训练数据出现的概率。

剩余15页未读,继续阅读

资源评论

一颗小萌新

- 粉丝: 1925

- 资源: 6

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功