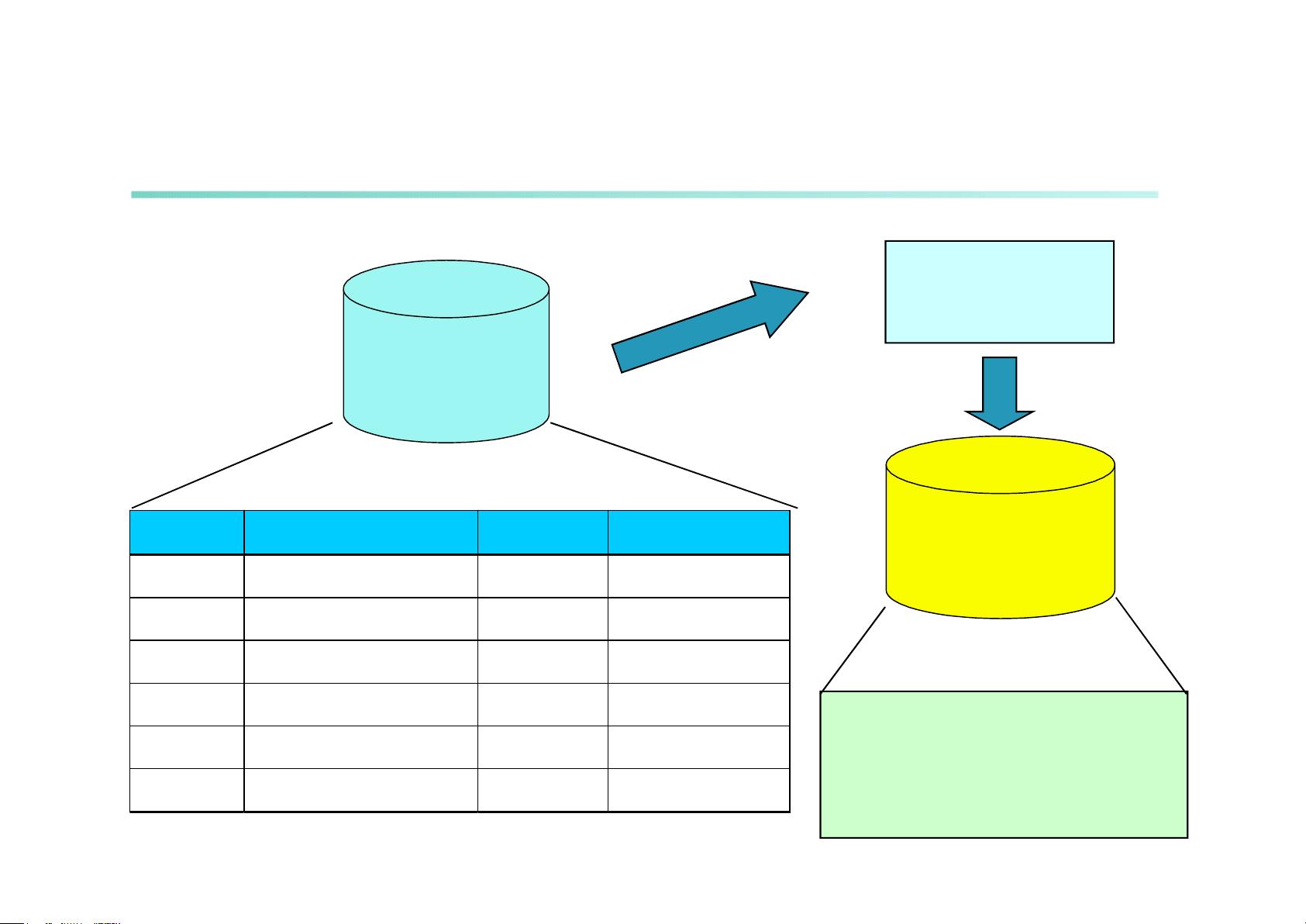

分类算法是机器学习中的一类算法,它的主要作用是将实例数据分配到合适的类别中,这个过程也被称作预测。分类的目的是根据输入数据的特征,预测出这些数据的类别属性,这些类别属性是离散的或名义的。 分类算法在很多领域都有广泛的应用,例如信贷审批、目标市场推广、医疗诊断以及欺诈检测等。分类的任务通常可以分为两个步骤:模型构造(Model construction)和模型使用(Model usage)。模型构造是指根据训练集和分类属性中的值来构建模型,这个过程需要假设每个元组(或样本)都属于一个预先定义好的类别,这个类别是由类标签属性来确定的。用于构造模型的数据集通常被称为训练集。模型使用则是利用这个模型来对未来的或未知的数据进行分类。 评估模型准确性的过程是,在测试集上用已知的标签与模型分类结果进行对比,准确性是被正确分类的测试集样本的百分比。为了防止过拟合现象的发生,测试集和训练集是独立的。如果准确性达到了一个可接受的水平,那么这个模型就可以用于对那些类标签未知的数据元组进行分类。 决策树算法是一种常见的分类算法,它通过一系列的规则对数据进行分类,这些规则以树的形态表现出来,因此命名为“决策树”。决策树的每一层都代表一个属性上的测试,每一个分支代表测试的结果,而每个叶节点代表一个类别。构建决策树时,算法会从训练集中选择最优的特征并根据这些特征进行分割,使得子集尽可能地属于同一个类别。 在决策树算法中,树的节点通常是特征(或属性),而分支代表了这些特征上的分割或测试,叶节点代表最终的决策或预测结果。一个经典的决策树算法是ID3算法,它通过计算信息增益来选择特征,目标是构建一棵具有最小化熵值(或最大信息增益)的决策树。ID3的一个限制是对特征的限制,它只能应用于那些属性值是名义型的特征。为了克服这一点,后续又发展出了C4.5和C5.0算法,它们可以处理数值型的特征。这些算法通过一种叫做信息增益比的度量来选择最佳的分割特征。 在Python中,可以使用诸如scikit-learn库来实现决策树算法。Scikit-learn中的决策树分类器是一种非常灵活的分类模型,它能够处理数值型和类别型的数据,并提供了很多的选项来进行模型的配置,比如控制树的深度、分割的最小样本数等。 在使用决策树进行分类时,还会遇到一些问题和挑战,例如决策树容易出现过拟合现象,也就是树的复杂度太高,以至于模型对训练数据的泛化能力不足,这时可以使用剪枝技术来简化模型。另外,决策树在对连续型特征的处理上并不像处理离散型特征那么直接,需要一些预处理的步骤。 总结来说,分类算法和决策树在解决分类问题时具有重要的作用和广泛的应用。决策树算法因其模型的直观性和解释性强而备受欢迎,然而在实际应用中,仍然需要注意模型的选择、过拟合问题以及连续特征的处理等问题,从而更好地利用决策树模型进行数据分析和预测。

剩余31页未读,继续阅读

- 粉丝: 0

- 资源: 2

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功