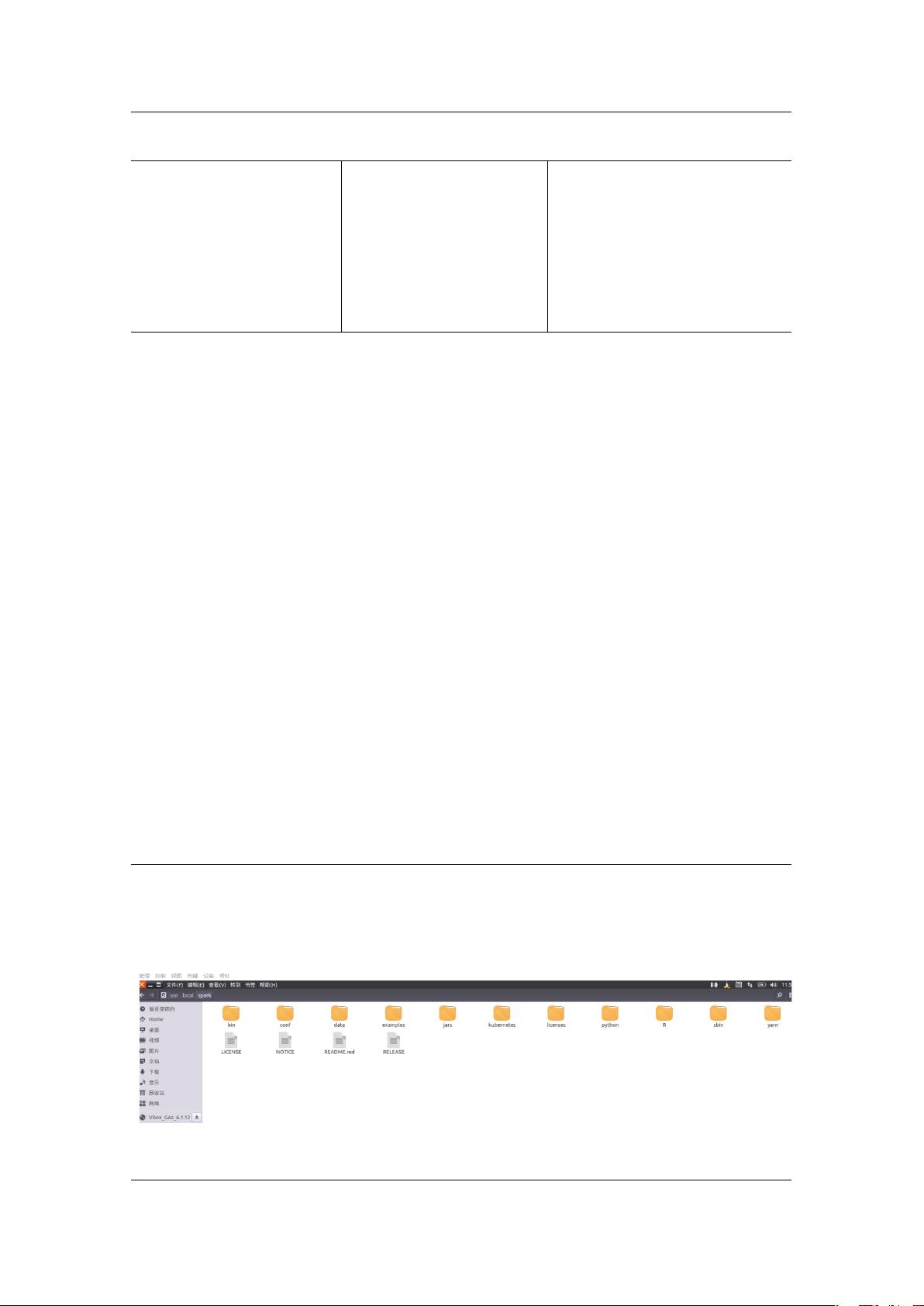

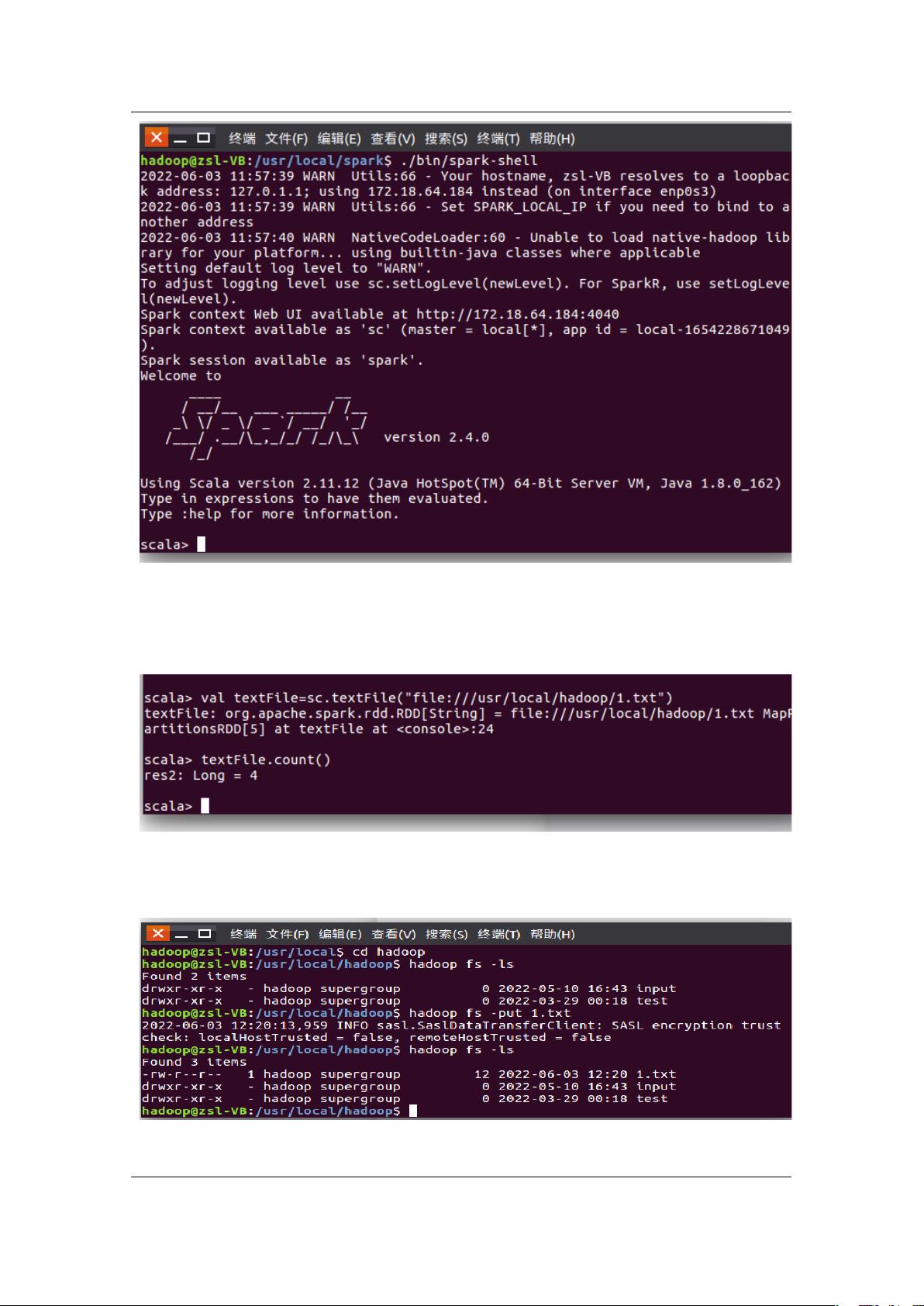

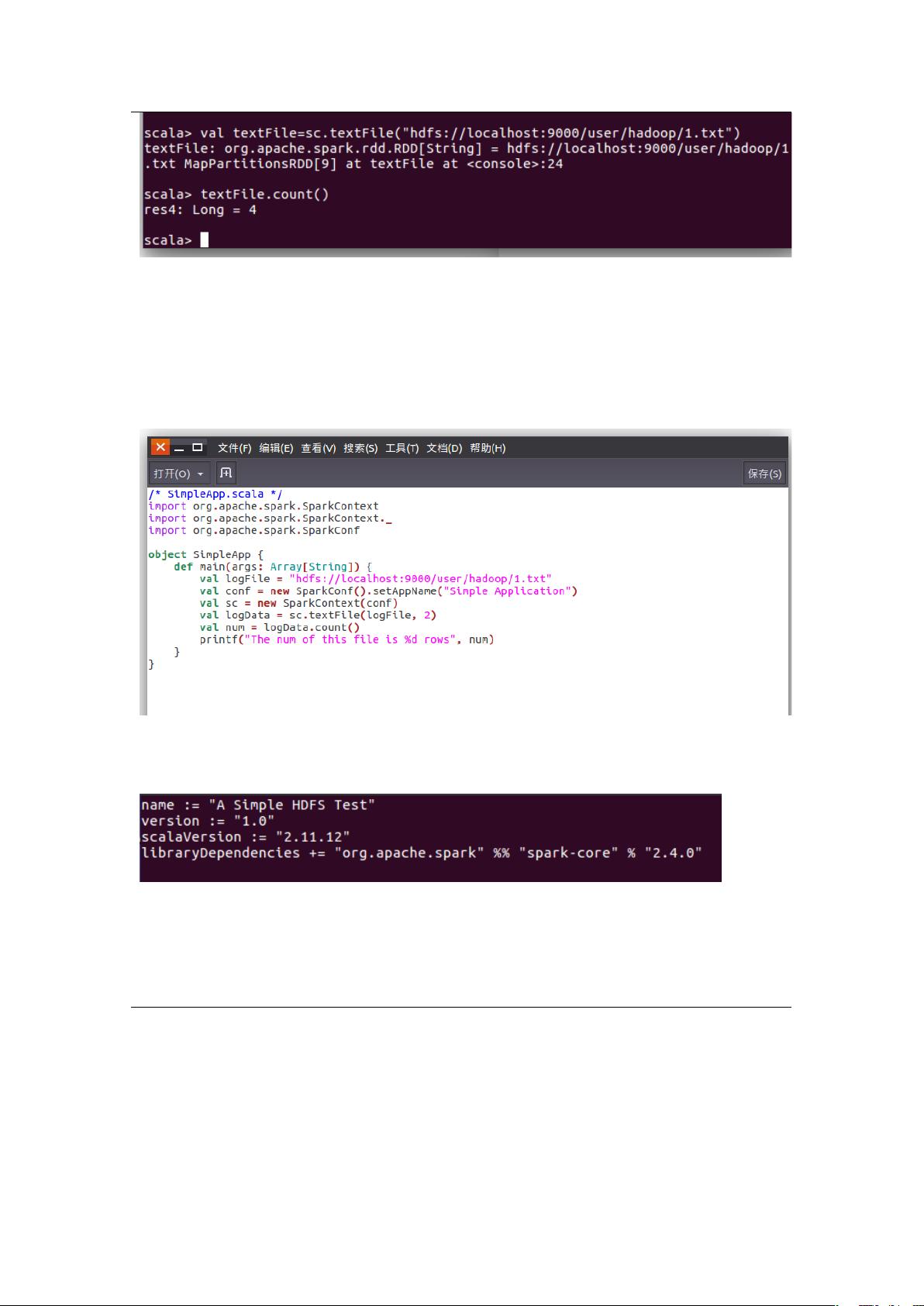

1、实验环境: 设备名称 LAPTOP-9KJS8HO6 处理器 Intel(R) Core(TM) i5-10300H CPU @ 2.50GHz 2.50 GHz 机带 RAM 16.0 GB (15.8 GB 可用) 主机操作系统 Windows 10 家庭中文版 虚拟机操作系统 ubuntukylin-16.04 Hadoop 版本 3.1.3 JDK 版本 1.8 Java IDE:Eclipse 系统类型 64 位操作系统, 基于 x64 的处理器 笔和触控 没有可用于此显示器的笔或触控输入 2、实验内容与完成情况: 1. 安装hadoop和spark。 将下载好的安装包解压至固定路径并安装 使用命令./bin/spark-shell启动spark 图2启动spark 2. Spark读取文件系统的数据 (1) 在spark-shell中读取Linux系统本地文件“/home/hadoop/test.txt”,然后统计出文件的行数; 图3 spark统计行数 (2) 在spark-shell中读取HDFS系统文件“/user/hadoop/test.txt”( 【Spark 初级编程实践】 Spark 是一个分布式计算框架,常用于大数据处理,它提供了高效的数据处理能力,包括批处理、交互式查询、实时流处理等。本实验旨在通过实践操作,让学生熟悉 Spark 的基本使用,包括安装配置、数据读取、数据处理以及独立应用程序的开发。 1. **安装 Hadoop 和 Spark** 在实验环境中,首先需要安装 Hadoop 和 Spark。Hadoop 是一个分布式文件系统,为 Spark 提供了存储基础。Spark 则基于 Hadoop 的数据,提供更快速的数据处理能力。安装过程通常包括下载安装包,解压到指定目录,并配置相关环境变量。实验中使用的是命令 `./bin/spark-shell` 来启动 Spark 的交互式 Shell,方便进行测试和调试。 2. **Spark 读取文件系统数据** Spark 可以读取多种数据源,包括本地文件系统和 HDFS(Hadoop 分布式文件系统)。在 Spark Shell 中,可以使用内置函数读取文件,如 `sc.textFile()`,并进行简单的数据分析。实验中统计了 `/home/hadoop/test.txt` 和 `/user/hadoop/test.txt` 文件的行数,这展示了 Spark 对文本数据的基本操作。 3. **编写独立 Scala 应用程序** Spark 提供了 Scala、Java、Python 和 R 的 API,便于开发者构建分布式应用程序。实验中,使用 Scala 编写了两个独立应用: - `SimpleApp` 读取 HDFS 文件 `/user/hadoop/test.txt` 并统计行数,这通过 `sbt package` 打包成 JAR,再使用 `spark-submit` 提交到 Spark 集群执行。 - `RemDup` 应用实现了合并两个文件并去除重复项的功能,同样通过 `sbt` 打包并提交到 Spark 集群运行。 4. **数据处理示例** 实验中还涉及到了数据处理的实际场景,例如求平均值。假设有一个包含学生姓名和成绩的数据集,Spark 应用可以读取这些文件,通过 MapReduce 或 DataFrame/Dataset API 进行计算,最后输出平均成绩。 这些实验步骤涵盖了 Spark 开发的基本流程,包括环境搭建、基本操作、数据处理和应用开发。通过这样的实践,学生能够深入理解 Spark 的工作原理和使用方式,为后续的大数据处理项目打下坚实基础。同时,实验也强调了 Scala 作为 Spark 的主要编程语言,以及 sbt 和 spark-submit 在构建和部署 Spark 应用中的作用。

剩余10页未读,继续阅读

- 粉丝: 120

- 资源: 9

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功

评论0