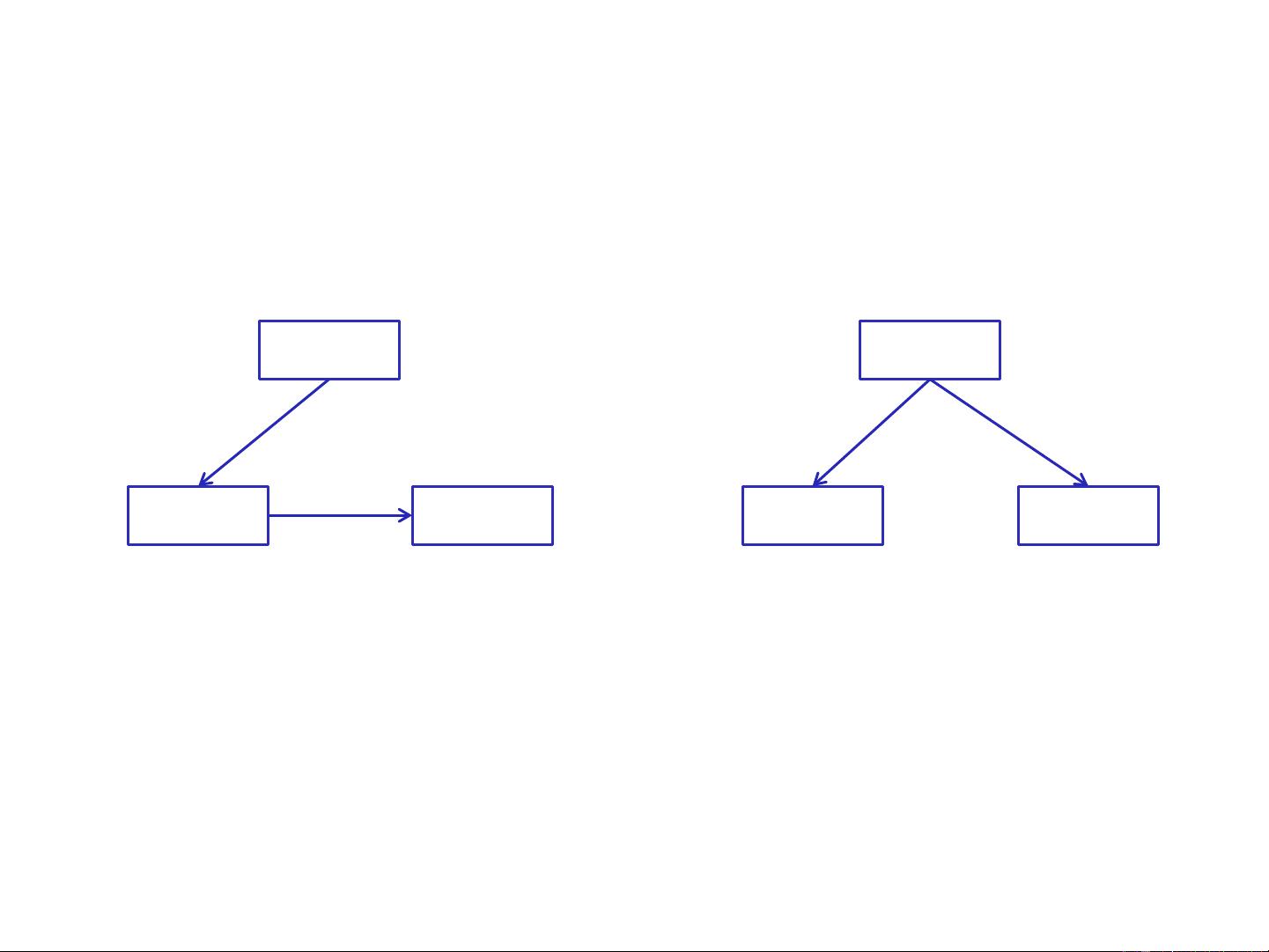

在给定的文件信息中,我们可以提炼出有关深度神经网络(DNN)以及神经网络基础和深入讲解的大量知识点。由于文档中提到了“CSE 5526: Introduction to Neural Networks Deep Networks”,我们可以推测这是一份关于神经网络入门以及深度网络讲解的资料。 文档提到了神经网络的动机,即为什么需要深层网络(Deep nets)而非浅层网络(Shallow nets)。浅层网络通常包含一个隐藏层(例如单隐藏层的多层感知器MLP、径向基函数RBF和SVM),而后是输出层。相比之下,深层网络使用多于一个的隐藏层,如卷积神经网络。例如,在进行两个三位二进制数加法的任务时,自然而然想到使用具有两个隐藏层的小型网络会是更自然的解决方案。尽管浅层网络也能完成任务,但通常需要一个更大的网络。 文档接着讲到了深层网络训练中的一个问题——梯度消失问题。在实践中的后向传播算法中,近输入层的较浅层会出现梯度消失现象,导致训练缓慢且容易过拟合数据。为了解决这一问题,训练深层网络分为两个阶段:首先使用无监督的生成预训练来初始化深层网络,然后通过有监督的判别微调来完成网络训练。采用这种两阶段训练策略的原因在于,无监督学习不容易过拟合,因此我们期望深度学习能有更好的泛化能力。此外,第一阶段让我们能够通过生成模型来验证网络学到的内容。 文档提到了深层信念网络(DBN)和受限玻尔兹曼机(RBM)之间的学习等价性。深层信念网络中,每个单元都是双极性(二进制)和随机的,生成信念网络的数据是容易的。每个单元的状态由其所在层的双极性状态和一个逻辑激活函数决定。学习规则方面,信念网络中的学习是为了最大化可见层数据的似然性,这与可见层相同。类似于用于玻尔兹曼学习的输入模式生成,规则的差异包括了一个后验概率的评估。 针对特定类型的信念网络,提出了一个特殊的信念网络。例如,考虑一个具有无限节点的逻辑信念网络,对于这样的网络,计算变得非常困难。 深度神经网络的学习涉及多个层面,其中包含了神经网络的基本概念和深层结构的设计原理。内容中强调了无监督学习的重要性,其可以在两阶段训练中提供对网络学习过程的初步验证,并且有利于泛化能力的提升。此外,通过对比浅层和深层网络,引入了深层网络结构对于复杂问题解决的必要性,并指出了实际训练过程中遇到的技术挑战和解决方法。 总结而言,这份讲义深入讲解了神经网络的核心概念和深度网络的学习过程。从浅层网络与深层网络的区别,到无监督学习与有监督学习在训练过程中的应用,再到深层网络训练中的梯度消失问题及其解决方法,都体现了神经网络领域的前沿知识。同时,对深层信念网络和受限玻尔兹曼机的学习等价性的探讨,以及特殊信念网络计算困难的分析,为读者提供了一个全面而深入的神经网络学习视窗。

剩余22页未读,继续阅读

- 粉丝: 1

- 资源: 3

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功