SVM入门(通俗易懂的SVM教程)

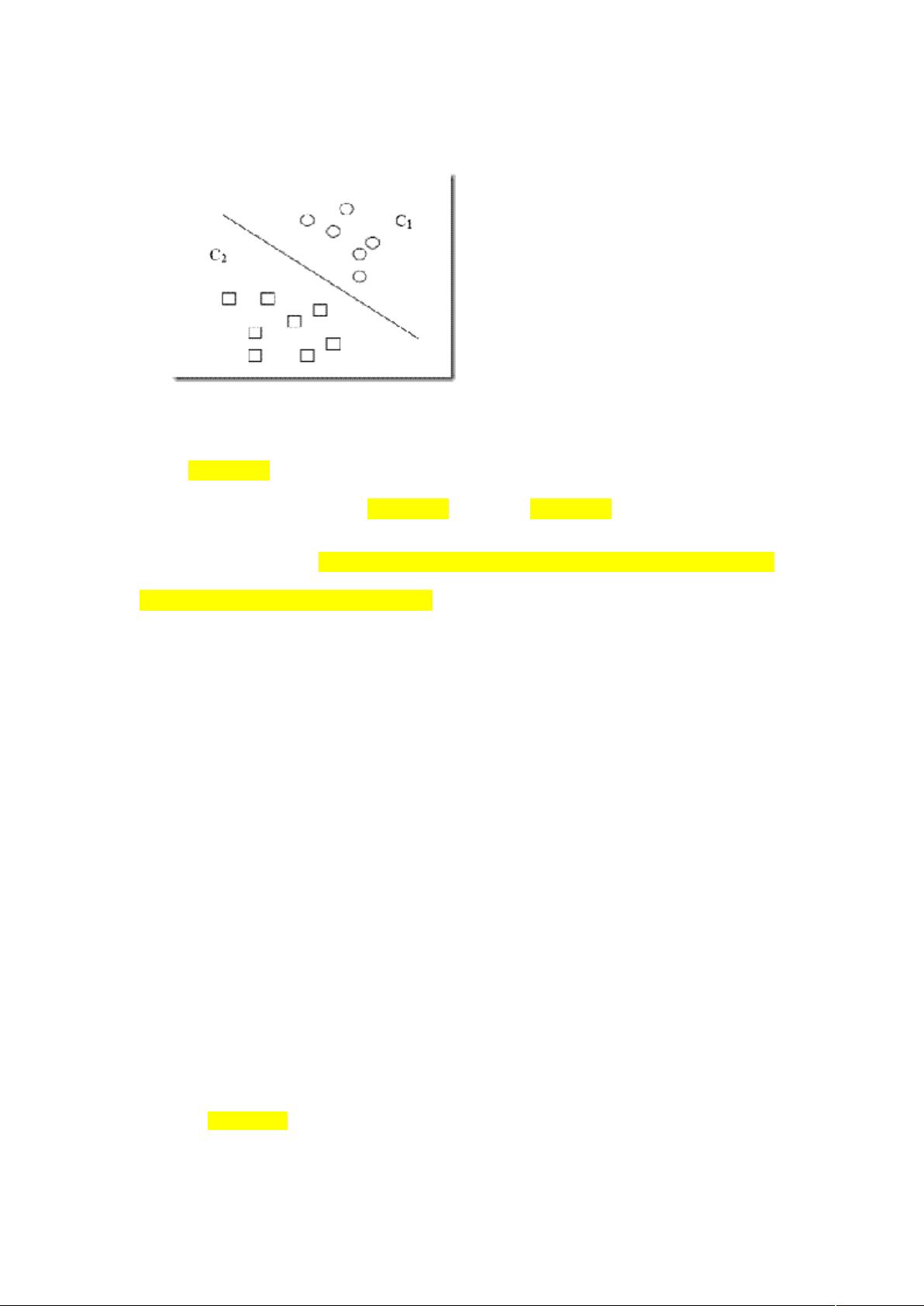

# SVM入门(通俗易懂的SVM教程) 在这个数字化时代,机器学习成为了数据分析和计算机科学中的热门领域。机器学习模型的种类繁多,而支持向量机(Support Vector Machine,简称SVM)是其中一种非常强大且应用广泛的算法。本文旨在深入浅出地介绍SVM的基本原理,使读者即便没有深厚的模式识别基础,也能够对这一机器学习模型有一个初步的理解和认识。 ## SVM的起源与发展 SVM是由Cortes和Vapnik于1995年提出的监督学习模型。它的核心是解决分类问题,尤其是在样本数量有限且样本特征维度很高的情况下。SVM之所以受到青睐,是因为它基于统计学习理论,尤其是VC维理论和结构风险最小化原则,这为处理复杂的数据模式提供了一个坚实的理论基础。 ## SVM的核心概念解析 ### VC维的定义及其重要性 VC维是度量函数类复杂度的一个概念。其核心思想是,对于给定的样本集合,函数类能打散所有可能的标签组合的最高维数称为其VC维。简言之,VC维越高,函数类复杂度越大,过拟合的风险也就越大。SVM正是利用这一点,通过选择合适的参数使得模型保持在简单与复杂的平衡之间,进而有效地避免过拟合。 ### 结构风险最小化 结构风险最小化是SVM优化的目标,它综合考虑了经验风险与置信风险。经验风险指的是模型在训练数据上的误差,而置信风险则考虑了模型对未知数据的不确定性。SVM试图寻找一个模型,使得两者的和最小。这样一来,SVM不仅在训练数据上有良好的表现,而且能够较好地泛化到新的数据上。 ### 核函数的作用与意义 由于SVM擅长处理高维数据,核函数在SVM中扮演了至关重要的角色。核函数能够将原始样本数据映射到高维空间,这样原本线性不可分的数据在新的空间中就可能变得线性可分。核函数的一个重要特性是它能够将数据之间的复杂关系转化为简单的内积运算,这使得SVM在处理非线性问题时变得更加高效。 ## SVM在实际中的应用 SVM的强项在于它能够很好地解决小样本、非线性和高维数据的分类问题。例如,在文本分类、生物信息学、手写识别等领域,SVM都显示出了卓越的性能。尤其对于那些样本数量不多但特征维度很高的数据集,SVM通过其结构风险最小化原则,能够找到合适的决策边界,从而准确地对新的样本进行分类。 ## SVM的原理与方法 ### SVM的基本原理 SVM通过寻找一个最优的决策边界,将不同类别的数据分开。这个最优决策边界是通过最大间隔方法来确定的。它找到一个超平面,这个超平面能够使得离它最近的两类样本之间的间隔最大。这样不仅可以保证分类的准确性,同时还能保证模型的泛化能力。 ### SVM的优化问题 为了找到这个最优的决策边界,SVM转化为一个二次规划问题。这个优化问题的目标是最大化两类样本的间隔,同时对那些违反间隔约束的样本点引入惩罚项,使得模型在优化间隔的同时,也能够提高容错性。 ## 结语 通过以上介绍,我们可以发现SVM是一种既注重理论又贴近实际应用的机器学习模型。其核心优势在于能够有效处理高维数据、非线性问题以及小样本情况。通过深入理解VC维、核函数和结构风险最小化原则,我们能够更好地掌握SVM的工作机制和使用方法。对于想要进一步探索SVM或是进入机器学习领域的朋友们,希望这篇通俗易懂的SVM入门教程能够成为你们宝贵的起点。

剩余32页未读,继续阅读

cy198612302011-10-24写得真的很通俗,入门很容易。

cy198612302011-10-24写得真的很通俗,入门很容易。 alansif2012-12-18简洁易懂,非常好哦

alansif2012-12-18简洁易懂,非常好哦

- 粉丝: 0

- 资源: 2

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- Lawrence C. Evans Partial Differential Equations.djvu

- CFA知识点梳理系列:CFA Level II, Reading 4 Big Data Projects

- 专业问题 · 语雀.mhtml

- 基于Vue+TP6的B2B2C多场景电商商城设计源码

- 基于小程序的研知识题库小程序源代码(java+小程序+mysql).zip

- 基于小程序的微信小程序的点餐系统源代码(java+小程序+mysql).zip

- 基于小程序的宿舍管理小程序源代码(java+小程序+mysql).zip

- 基于小程序的小区服务系统源代码(python+小程序+mysql).zip

- QT项目之中国象棋人工智能

- 基于小程序的疫情核酸预约小程序源代码(java+小程序+mysql).zip

信息提交成功

信息提交成功