没有合适的资源?快使用搜索试试~ 我知道了~

决策树及应用.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 76 浏览量

2021-09-13

17:09:05

上传

评论

收藏 1016KB DOCX 举报

温馨提示

试读

15页

。。。

资源推荐

资源详情

资源评论

各个领域的人工智能实现,常常要涉及这样的问题:从实际问题中提取数据,并从数据中提炼一组数据规

则,以支持知识推理实现智能的功能。知识规则一般以“原因—结果"形式表示。一般地,获取知识规则可以

建模实现.由于推理结果是有限个,即 的取值是有限的,所以这样的建模属于分类问题.利用神经网络可

以实现分类问题建模,但当影响因素变量 的个数较大时,建模后的知识规则不易表示,特别地,当默写变量

的取值缺失时,即使神经网络具有容错性,也会在一定程度上影响分类结果的不确定性 .实际应用中,决定

分类结果可能只是几个主要影响因素取值,不依赖全部因素变量,因此,知识规则的提取,可以转换为这样的

问题:某一分类下哪些变量是主要的影响因素,这些主要影响因素与分类结果的因素规则表示如何获取?决

策树就是解决这些问题的方法之一.

决策树学习算法是一组样本数据集(一个样本数据也可以称为实例)为基础的一种归纳学习算法,它着

眼于从一组无次序、无规则的样本数据(概念)中推理出决策树表示形式的分类规则。假设这里的样本数据

应该能够用“属性-结论”。

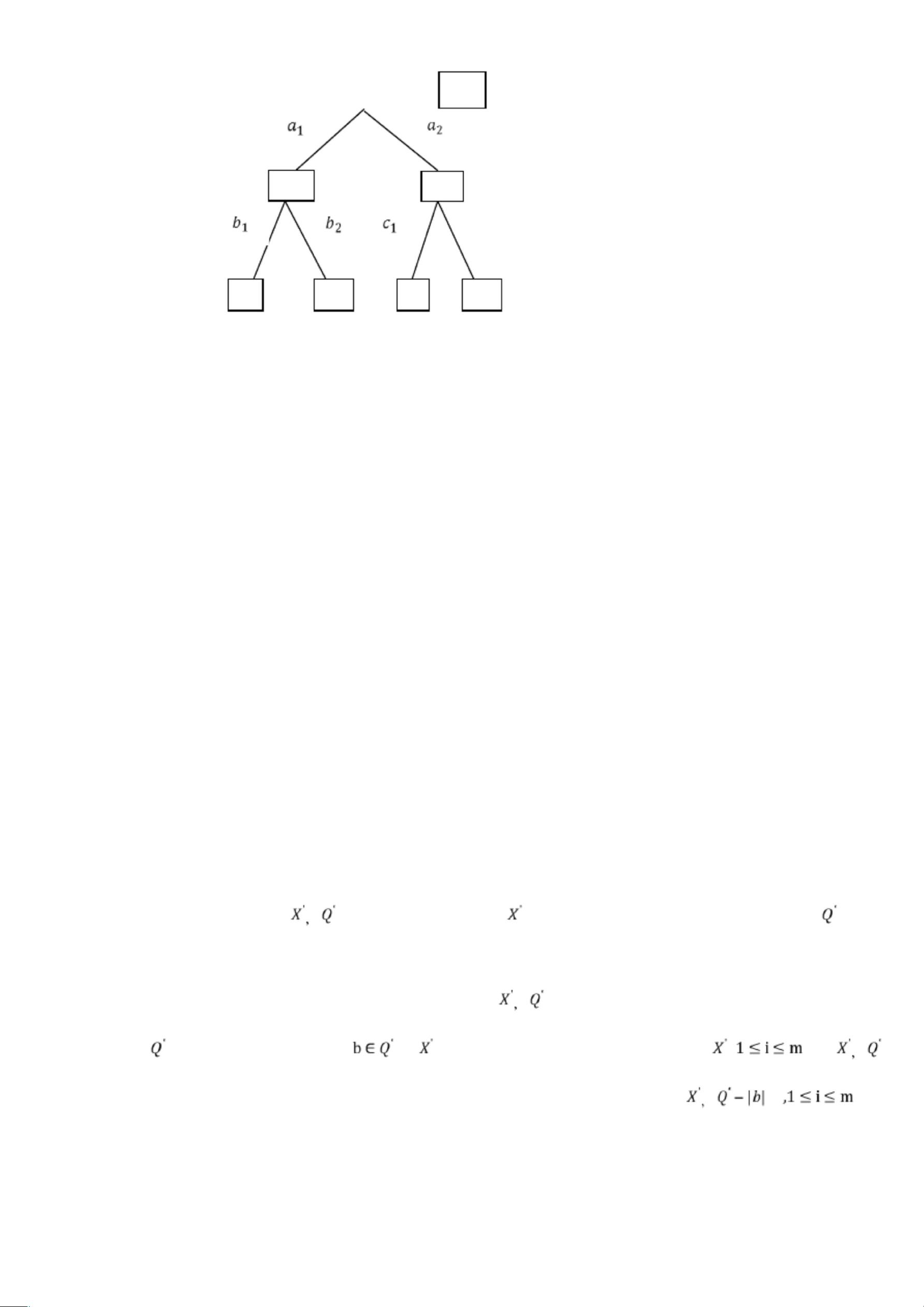

决策时是一个可以自动对数据进行分类的树形结构,是树形结构的知识表示,可以直接转换为分类规则.

它能被看做基于属性的预测模型,树的根节点是整个数据集空间,每个分结点对应一个分裂问题,它是对某个

单一变量的测试,该测试将数据集合空间分割成两个或更多数据块,每个叶结点是带有分类结果的数据分割。

决策树算法主要针对“以离散型变量作为属性类型进行分类”的学习方法。对于连续性变量,必须被离散化

才能被学习和分类。

基于决策树的决策算法的最大的有点就在于它在学习过程中不需要了解很多的背景知识,只从样本数据

及提供的信息就能够产生一颗决策树,通过树结点的分叉判别可以使某一分类问题仅与主要的树结点对应的

变量属性取值相关,即不需要全部变量取值来判别对应的范类。

一颗决策树的内部结点是属性或属性的集合,儿叶结点就是学习划分的类别或结论,内部结点的属性称

为测试属性或分裂属性。

当通过一组样本数据集的学习产生了一颗决策树之后,就可以对一组新的未知数据进行分类。使用决策

树对数据进行分类的时候 ,采用自顶向下的递归方法 ,对决策树内部结点进行属性值的判断比较并根据不同

的属性值决定走向哪一条分支,在叶节点处就得到了新数据的类别或结论。

从上面的描述可以看出从根结点到叶结点的一条路径对应着一条合取规则 ,而整棵决策树对应着一组合

取规则.

A

B

C

1

2

3

4

(1)当决策树的每一个内部结点都只包含一个属性时,称为单变量决策树;当决策树存在包含多个变量

的内部结点时,称为多变量决策树。

(2)根据测试属性的不同属性值的个数,可能使得每一个内部结点有两个或者是多个分支,如果每一

个内部结点只有两个分支则称之为二叉树决策。

(3)分类结果可能是两类也可能是多类,二叉树决策的分类结果只能有两类,股也称之为布尔决策树。

5.2.2 CLS 算法

CLS 学习算法是 1966 年有 Hunt 等人提出的.它是最早的决策树学习算法。后来的许多决策树算法都可以

看作是 CLS 学习算法的改进与更新。

CLS 的算法的思想就是从一个空的决策出发,根据样本数据不断增加新的分支结点,直到产生的决策树

能够正确地将样本数据分类为止.

(1)令决策树 T 的初始状态只含有一个树根(X,Q),其中 X 是全体样本数据的集合,Q 是全体测试属性

的集合。

)都有如下状态:或者 中的样本数据都是属于同一个类,或者 为空,

,从(

)

)

。

在算法步骤(4)中,并没有明确地说明按照怎样的规则来选取测试属性,所以 CLS 有很大的改进空间,

而后来很多的决策树学习算法都是采取了各种各样的规则和标准来选取测试属性,所以说后来的各种决策树

Shannon 在 1948 年提出并发展了信息论的观点,主张用数学方法度量和研究信息,提出了以下的一些概

念.决策树学习算法是以信息熵为基础的,这些概念将有助于理解后续的算法。

(1)自信息量:在收到 之前,接收者对信 源 发 出 的 不 确 定 性 定 义 为 信 息 符 号 的自信息量

,其中

是取值为 的概率。自信息量反映了接收 的不确定性,自信息量越大,不确定

性越大。

(2)信息熵:自信息量只能反映符号的不确定性,而信息上可以用来度量整个信源 X 整体的不确定性。

(5.1)

是取值为 的概率;信息熵是各个自信息量的

式中:n 是信源 X 所有可能的符号数; 是可能取到的值;

期望.

,

为当 Y 为 时 X 为 的概率,则有

上一节已经提到的 CLS 算法并没有明确地说明按照怎样的规则和标准来确定不同层次的树结点(即测试

属性),Quinlan 于 1979 年提出的以信息熵的下降速度作为选取测试属性的标准。ID3 算法是各种决策树学

习算法中最有影响力、使用最广泛的一种决策树学习算法。

剩余14页未读,继续阅读

资源评论

苦茶子12138

- 粉丝: 1w+

- 资源: 6万+

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功