没有合适的资源?快使用搜索试试~ 我知道了~

温馨提示

试读

28页

我们判断,如果 ChatGPT 不犯大错,两年之内,整个科技行业甚至人类社会都会被颠覆一 遍。倒计时已经开始了。 在 ChatGPT 纪元中,提问题的能力和判断力也许是人类最重要的两个能力。我们这里提出五 个关键问题,并且试图抛开网络上的二手观点,做出基于原理的判断。 更详细的科普文可以参考这篇:了解 AIGC 中的 ChatGPT 和 LLM 其中包含如何在公司快速便捷地使用 ChatGPT 针对中台业务场景的应用:ChatGPT 在中台业务应用的可能性与探索 这篇文章会尽量用准确的说明与类比(如何区分准确的类比和偷换概念的类比)去解读技术。 但是对于这样一个非常新、非常颠覆、大家对原理和应用都还没形成共识的技术,不了解技术 细节就去打比方,难免信口开河。所以我们会先尽量无损地把需要的技术细节都盘清楚,然后 再去进行抽象和提取本质。 哪五个问题? 1. 是什么:ChatGPT 是范式突破吗?和过往 AI 有什么不同? 2. 会怎样:ChatGPT 两年内会达到什么水准? 3. 行业格局:ChatGPT 以及 GPT 有壁垒吗? 4. 如何参与:我们未来应该如何使用 Ch

资源推荐

资源详情

资源评论

关于 ChatGPT 的五个最重要问题

我们判断,如果 ChatGPT 不犯大错,两年之内,整个科技行业甚至人类社会都会被颠覆一

遍。倒计时已经开始了。

在 ChatGPT 纪元中,提问题的能力和判断力也许是人类最重要的两个能力。我们这里提出五

个关键问题,并且试图抛开网络上的二手观点,做出基于原理的判断。

更详细的科普文可以参考这篇:了解 AIGC 中的 ChatGPT 和 LLM

其中包含如何在公司快速便捷地使用 ChatGPT

针对中台业务场景的应用:ChatGPT 在中台业务应用的可能性与探索

这篇文章会尽量用准确的说明与类比(如何区分准确的类比和偷换概念的类比)去解读技术。

但是对于这样一个非常新、非常颠覆、大家对原理和应用都还没形成共识的技术,不了解技术

细节就去打比方,难免信口开河。所以我们会先尽量无损地把需要的技术细节都盘清楚,然后

再去进行抽象和提取本质。

哪五个问题?

1. 是什么:ChatGPT 是范式突破吗?和过往 AI 有什么不同?

2. 会怎样:ChatGPT 两年内会达到什么水准?

3. 行业格局:ChatGPT 以及 GPT 有壁垒吗?

4. 如何参与:我们未来应该如何使用 ChatGPT?

5. 人文:人类和 ChatGPT 的本质区别是什么?对人类社会的冲击?

还有一个不需要讨论的重要问题:ChatGPT 不会开源的,因为 AGI 是一个危险品。国内那些依

赖开源+抄的公司可以死心了。指望原子弹开源吗?

我们搞清楚这五个问题,就能判断市面上大多数解读 ChatGPT 的观点,无论从技术、商业、

投资,等等角度,是否靠谱了。其实就两个关键

1. 对 ChatGPT 新能力的认知:这新能力是什么,有什么意义?

2. 对“能力获取难度”的认知:ChatGPT 如何获得的?难度有多大?

文章结尾我们会做一下总结。让你下次见到某大模型,可以判断这是 ChatGPT 的 80%还是

0%。

为什么这样问?

最近到处都在讨论 ChatGPT,就像 A 股 6000 点的时候所有人都在讨论 A 股一样。但是大家的

问题主要聚焦在于自己会不会被 ChatGPT 取代,中国如何赶超 ChatGPT,ChatGPT 相关概念股

票是什么,等等。这些问题很重要,但是对于 ChatGPT 这样一个人类高科技结晶的新物种,

不先搞清楚它“是什么”和“如何牛逼的”,那就没有办法形成自己的判断。没有自己的判断,看

ChatGPT 就像看元宇宙、Web3、自动驾驶一样,觉得好像牛逼,也有一套看似点只能被别人

牵着走。

所以我们先要搞清楚这两个问题。

搞清楚 ChatGPT“是什么”和“如何牛逼的”是一件困难的事情,因为最顶尖的人工智能大佬们也

没有达成共识。比如 Meta 的 AI 负责人,深度学习三大佬之一的 LeCun 就不看好,认为这就

是个基于 auto-regressive(自回归)的 LLM(large language model,大语言模型),从方法上

来讲没有啥范式突破。只是因为 OpenAI 是个创业公司,大家宽容度比较高,ChatGPT 在乱说

话,大家也能容忍。

另一面,ChatGPT 的火热就不说了,比如特斯拉的首席 AI 科学家就选择回到 OpenAI,共建

AGI(artificial general intelligence,通用人工智能,也是 OpenAI 的追求目标);Meta 的 VR 创

始人卡马克选择离开 Meta,自己开一家 AGI 公司。另外一篇文章截取了大佬们的赞誉

技术讲解环节:“自回归”“大语言模型”是两个关键词

自回归的意思是,我先用模型预测下一个词是什么,然后把预测出来的词带入模型,去预

测再下一个词是什么,不断迭代。这是过往语言模型的通用范式。也能让各类语言类任务

统一成“生成式”任务

大语言模型是因为 GPT 的海量数据与参数。大语言模型本身也值得技术科普一下,我们在

第一个问题中展开

大佬们都认可 AGI 的重要意义,但是对于 ChatGPT 是不是有“范式突破”,是不是 AGI,有重大

分歧。大佬们无法形成共识,我们有两种选择,一种是做“early-adoptor”,早期采用者(特点

是懂技术,有 vision,想通过技术带来巨大改变),去在体验和探索中形成自己的观点;一种是

做“early-mass”,早期大众(特点是厌恶风险,希望追求确定的改善),等着标准成熟,应用也

有定论,再去采用。作为中台,我们需要抓住 IEG early-adoptor 的身份。所以我们需要在纷杂

的信息中形成自己的理解和主张。

这次讨论就想达到这个目的。数科和算法同学会保证信息的准确,知之为知之不知为不知,但

是观点、主张、区别、共识,需要老板们自己推演出。

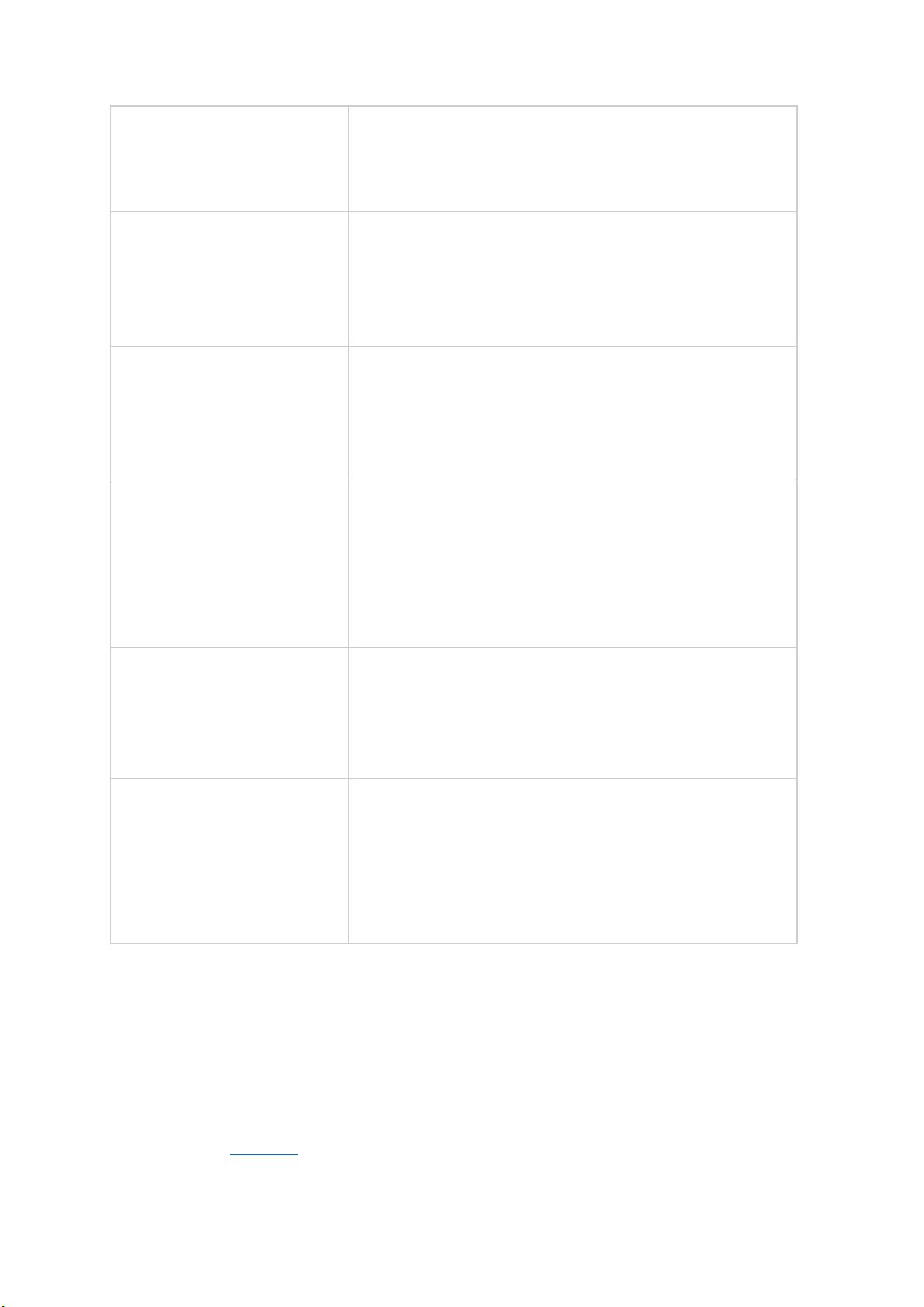

开头:ChatGPT 的最基本版历史

虽然想直接开始问题,但是一定程度的技术科普还是必要的。这样能在思考问题的时候更加高

效。我们着重参考两篇综述,尽量抓重点:

1. 大语言模型技术精要(链接)

2. ChatGPT 的各项超能力从哪里来(链接)

第一份综述主要讲了大语言模型发展中的关键技术突破,第二份综述主要讲了 ChatGPT 发展

过程中的几个重要模型“做到了什么”和“有什么与众不同的做法”。我们把两篇文章的重点挑出

来,标注一下里程碑事件,和其意义。

事件

意义

Transformer 问世

让深度学习模型可以“自由吸

收”数据中的知识

大语言模型突破了参数和算力限制,从此语言模型也进入

参数越多,数据越大,模型效果越好的时代。

LLM 内战,逐渐吊打老 NLP

Google 的 Bert 路线和

OpenAI 的 GPT 路线各有所长

GPT 通过“自然语言生成任务”,兼容了几乎所有 NLP 问

题;但是 Bert 比 GPT2 表现好。此时大语言模型已经开始

吊打传统 NLP 模型了

GPT3 问世

展示 in-context learning 能

力,简单调教下就能吊打精

调过的很多模型

一方面让 GPT 模式初现一统江湖的潜质,一方面 GPT3 的

in-context learning 能力,展示了和过往 ML 的 fine-

tuning 模式的本质区别,我们在下面单独详细展开

- InstructGPT

ChatGPT 的交互模式,让

GPT 的能力,更加贴近人类

真实交互方式

在 in-context learning 基础之上,进一步降低了

prompting 的门槛;一定程度解决了 GPT-3 生成结果与用

户期望不一致的非预期输出,大幅降低了有害的、错误或

偏差的输出结果,让 GPT 更符合人类胃口

- GPT 读代码

代码训练能力的提升是 GPT3

到 GPT3.5 的重要迭代之一,

模型可从而可以生成代码和

理解代码

Codex 模型读了大量代码,之后的 GPT3.5 模型涌现出了

inference 的能力。不光能读懂和生成代码,对语言本身

的理解和推理能力也解锁了

- RLHF

ChatGPT 背后的核心技术之

一,让模型学习人类的偏好

全称是 reinforcement learning from human feedback,通

过构建人类反馈数据集,训练一个 reward 模型,模仿人

类偏好对结果打分,是 GPT-3 后时代 LLM 越来越像人类

对话的核心技术

ChatGPT

InstructGPT 的亲戚,但一些

优化方式也带来了 ChatGPT

的更泛化和准确能力,再次

引爆了 AIGC

ChatGPT 总体来说和 InstructGPT 一样是使用 RLHF 进行训

练,但模型是基于 GPT3.5,而且数据设置上也不同。

ChatGPT 是一个输入,模型给出多个输出,然后人给结果

排序,让模型可以学习人类的排序策略,即使是一本正经

的胡说八道看起来也很合理的样子。

这里面再强调一个关键点。GPT3 之后,很多能力是“涌现”的。即不是线性发展,可预测的,

而是突然就有了。至于这对于 OpenAI 的人是早晚会发生,还是完全未预料,我们就不知道

了。这几个“涌现”出的能力,尤其是 inference 的能力,是 ChatGPT 和过往 AI 的范式不同,

也会是我们这次讨论关注的重点。“涌现”也是大语言模型很神奇的一点,这些能力我们发现模

型随着数据量和模型大小的提升,就突然具备了,但是我们对这些能力怎么出现的,只有猜

想,没有共识。这篇文章有一个比较全面的总结和比较。

下图是 GPT-3 到 ChatGPT 的演变历史

这里也牵涉到了一个重要的题外话,大概是发生在 in-context learning 和 instruct 这一模式

下。尤其是对“fine-tuning”这个词的理解。如果用过往模型的经验去想象 ChatGPT 的运作方

式,就会产生错判。这一误解反而更容易发生对 AI 已经有所了解的从业者身上。

重要的题外话 -- 很多 AI 从业者为什么对 ChatGPT 有错误理

解?

过往的 NLP 模型是按照具体任务和具体数据来训练的。所以数据质量越好,模型效果越好。

而且最好只有正确数据,没有错误数据。大语言模型有一个重要不同,是“数据越多”越好,而

数据质量变成了重要,但稍显次要因素。

在一开始,大模型想要在特定任务上取得较好效果,也需要那个领域的具体数据去“fine-tune”

一下。通过大量的例子,先教给模型,那个领域中什么是好,什么是坏,调节一下模型的权

重,从而输出恰当的结果。这和过往模型的范式是差不多的。

而 GPT-3 涌现出的 in-context learning 能力(Google 的 PaLM 大模型也有)和上述范式有本质

不同,“过往的 fine-tuning”需要更改模型参数。也就是说,换了个新模型,从而在新数据上表

现更好。但是 in-context learning,模型并没有变化,却能在新数据上表现更好。研究甚至发

剩余27页未读,继续阅读

资源评论

Wis57

- 粉丝: 304

- 资源: 450

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 基于yolov5识别算法实现的DNF自动脚本源码.zip

- 基于Python实现的自动化办公项目.zip

- 基于python实现的基于PyQt5和爬虫的小说阅读系统.zip

- 机械设计整经机上纱自动化sw20非常好的设计图纸100%好用.zip

- Screenshot_20240427_031602.jpg

- 网页PDF_2024年04月26日 23-46-14_QQ浏览器网页保存_QQ浏览器转格式(6).docx

- 直接插入排序,冒泡排序,直接选择排序.zip

- 在排序2的基础上,再次对快排进行优化,其次增加快排非递归,归并排序,归并排序非递归版.zip

- 实现了7种排序算法.三种复杂度排序.三种nlogn复杂度排序(堆排序,归并排序,快速排序)一种线性复杂度的排序.zip

- 冒泡排序 直接选择排序 直接插入排序 随机快速排序 归并排序 堆排序.zip

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功