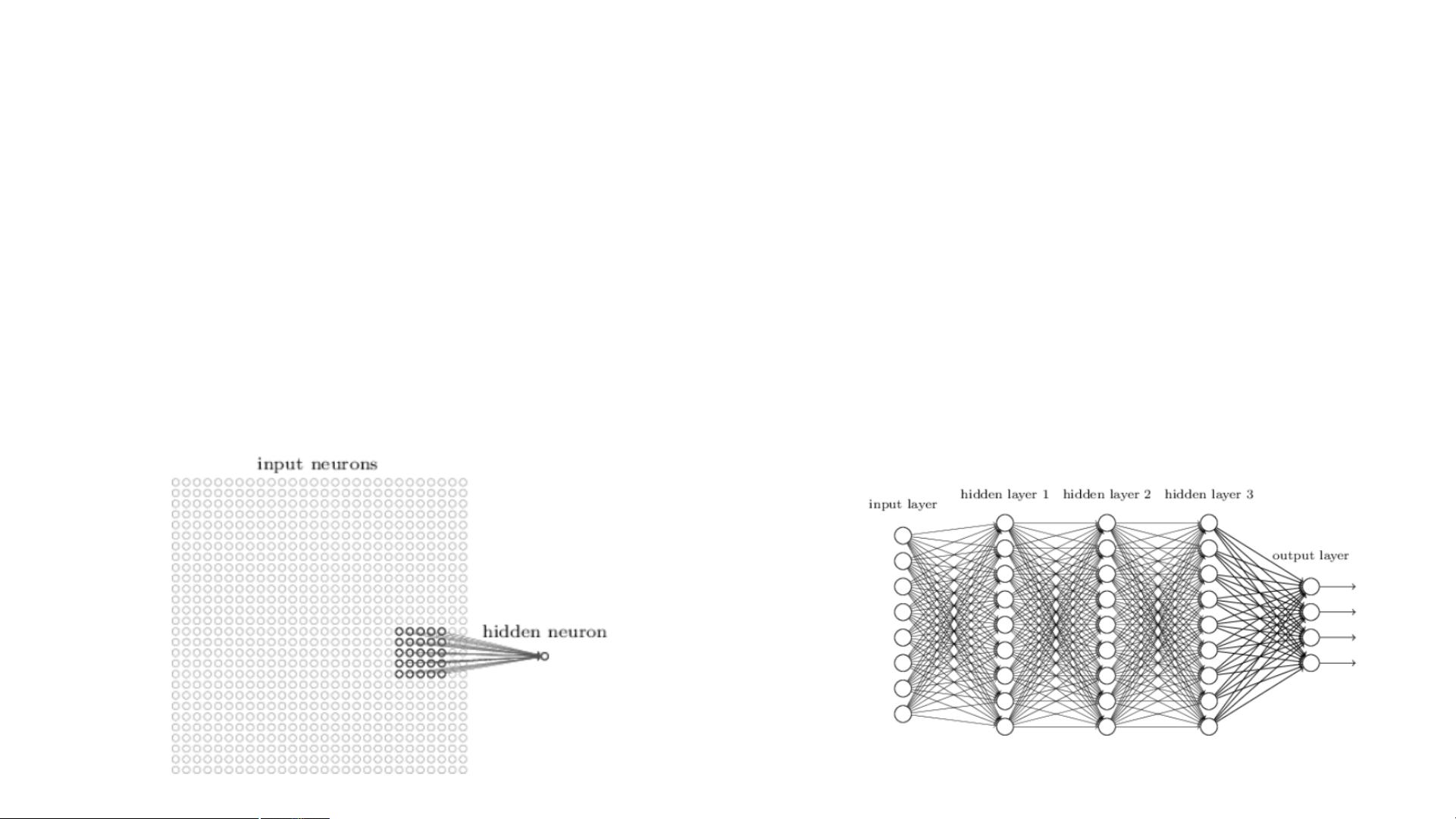

DL-CNN 总结ppt 本文总结了DL-CNN的三个基本概念:局部感知域、共享权重和池化,并对每个概念进行了详细的解释。 局部感知域(Local Receptive Fields) 局部感知域是指神经网络中,某个神经元仅仅与输入信号的局部区域连接,而不是与所有输入信号连接。这种机制可以减少网络的参数数量和计算复杂度,提高网络的训练速度和泛化能力。 在图像识别任务中,局部感知域可以用于检测图像中的局部特征,如边缘、线条、形状等。通过对局部特征的检测,神经网络可以 learns 到图像的特征 representation。 共享权重(Shared Weights) 共享权重是指在卷积神经网络中,卷积层的每个filter都共享同一个权重。这种机制可以减少网络的参数数量,提高网络的训练速度和泛化能力。 在卷积操作中,每个filter都有多个channel,每个channel都与输入的每个channel进行卷积操作,然后将所有channel的结果相加,得到最终的特征图。这种机制可以捕捉到图像中的多种特征,如边缘、纹理、形状等。 池化(Pooling) 池化是指将卷积层的输出结果缩减到更小的尺寸,以减少模型的参数数量和计算复杂度。常见的池化方法有最大值池化和均值池化两种。 池化操作可以实现局部平移不变性,即当输入信号发生平移时,输出结果保持不变。这使得神经网络可以更好地学习图像的特征representation。 激励函数(Activation Function) 激励函数是指在神经网络中,用于引入非线性因素的函数。常见的激励函数有Sigmoid、ReLU、Tanh等。 激励函数可以使神经网络学习到更加复杂的特征representation,提高网络的表达能力和泛化能力。 全连接层(FC Layer) 全连接层是指在神经网络中,用于学习特征图的组合的层。全连接层可以将卷积层或池化层的输出结果映射成一个一维的特征向量,然后对所有特征进行加权求和,得到输入的表达。 反卷积(Deconvolution) 反卷积是指将卷积操作的结果反转回原始的图像尺寸。反卷积可以用于图像分割、图像超分辨率等任务。 反卷积的输出结果可以与原始图像尺寸相同,但不能还原卷积之前的矩阵,只能还原卷积之前的特征图大小。 卷积网络的平移不变性 卷积网络可以为图像分类提供平移不变性,但像OCR这种多对一图像序列序列分类不存在平移不变性。卷积网络的平移不变性来自于局部感知域和池化操作的结合。

剩余8页未读,继续阅读

- 粉丝: 0

- 资源: 1

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜 信息提交成功

信息提交成功