AdaX:⼀个⽐Adam更优秀,带”⻓期记忆“的优化器

原创

苏剑林

1周前⼣⼩瑶的卖萌屋

关注⼩⼣并星标,解锁⾃然语⾔处理

搜索、推荐与算法岗求职秘籍

⽂ | 苏剑林(追⼀科技,⼈称苏神)

美 | ⼈美⼼细⼩谨思密达

前⾔

这篇⽂章简单介绍⼀个叫做AdaX的优化器,来⾃《AdaX: Adaptive Gradient Descent with Exponential Long Term Memory》。介

绍这个优化器的原因是它再次印证了之前在《硬核推导Google AdaFactor:⼀个省显存的宝藏优化器 》⼀⽂中提到的⼀个结论,

两篇⽂章可以对⽐着阅读。

Adam & AdaX

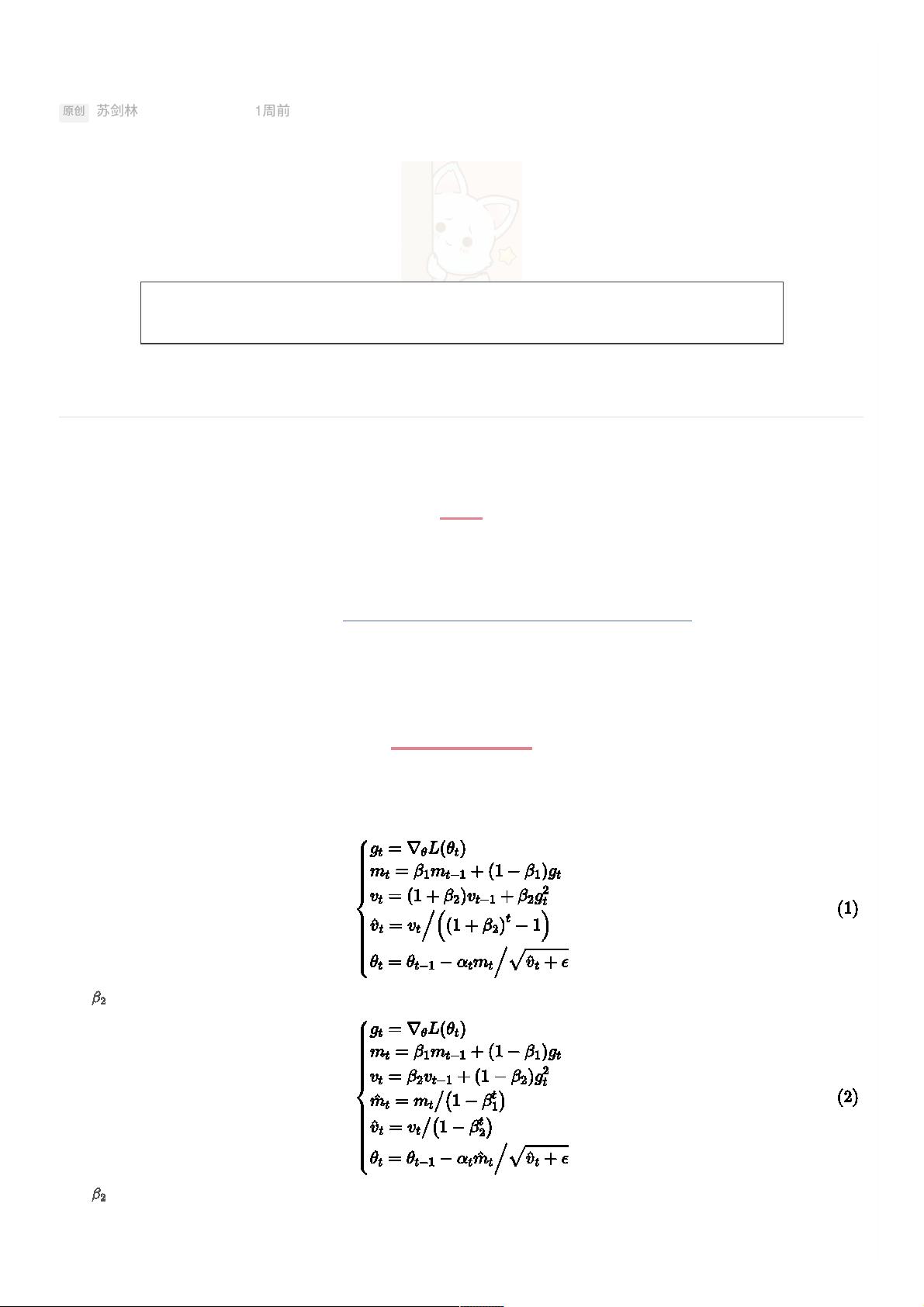

AdaX的更新格式是

其中 的默认值是0.0001。对了,顺便附上⾃⼰的Keras实现:https://github.com/bojone/adax 作为⽐较,Adam的更新格式是

其中 的默认值是0.999。