不要再纠结卷积的公式啦!0公式深度解析全连接前馈⽹络与卷积神经⽹络

原创

⼣⼩瑶

2017-08-08⼣⼩瑶的卖萌屋

Hello~你们的⼩⼣终于吐泡泡了〜前⼏天⼩⼣⼜加班赶project啦,拖了好⼏天,都快患上拖稿焦虑症了_(:з」∠)_

关于卷积神经⽹,⼩⼣就不从卷积讲啦。以前不⽌⼀个粉丝问我卷积神经⽹络中卷积的意义,甚⾄在知乎上被邀请

回答⼀个“卷积神经⽹络为什么不叫互相关神经⽹络”的类似的奇怪问题,终于忍不住,还是赶紧把CNN写了吧(说

的⾃⼰要去拯救世界了⼀样\(//∇//)\

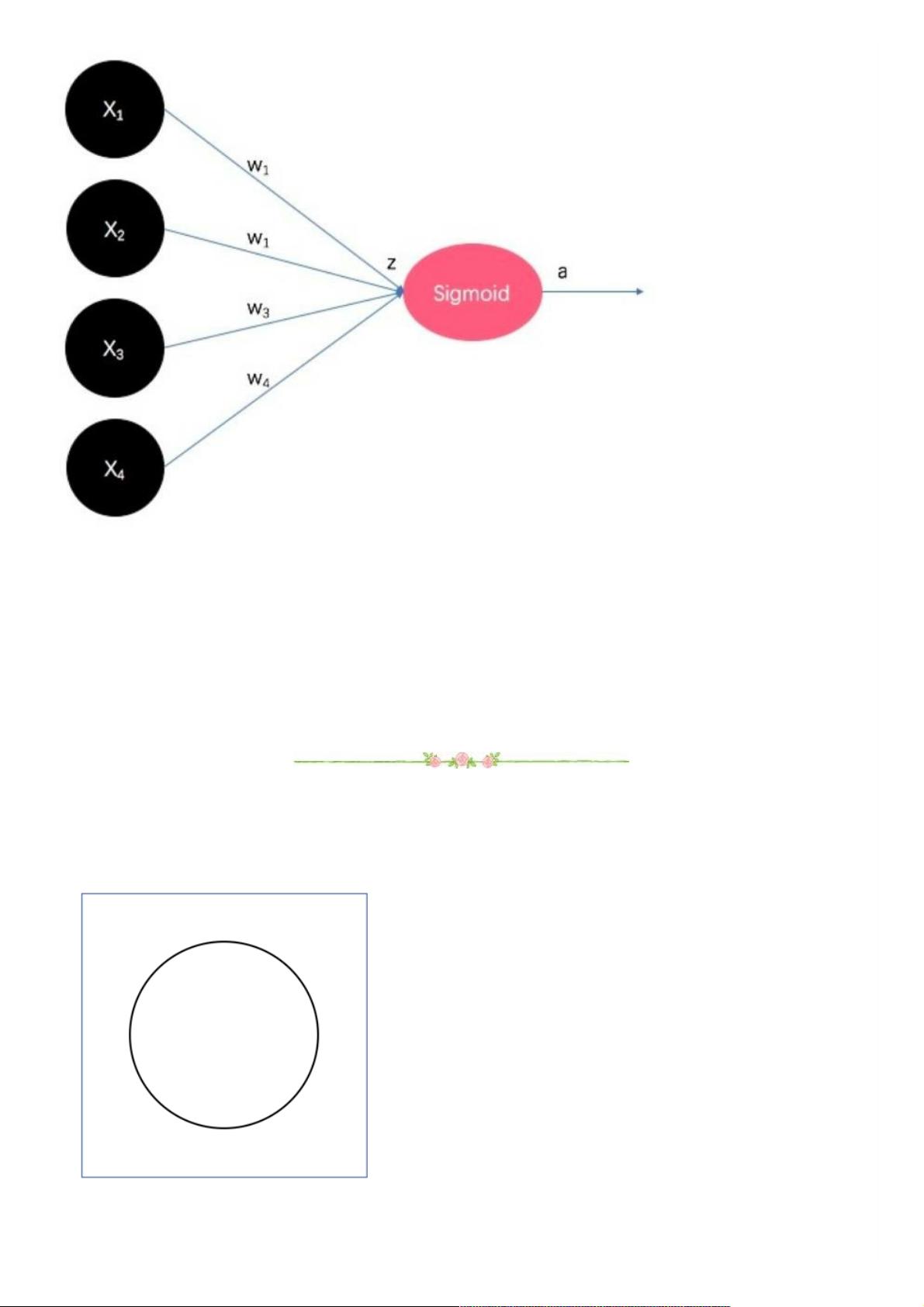

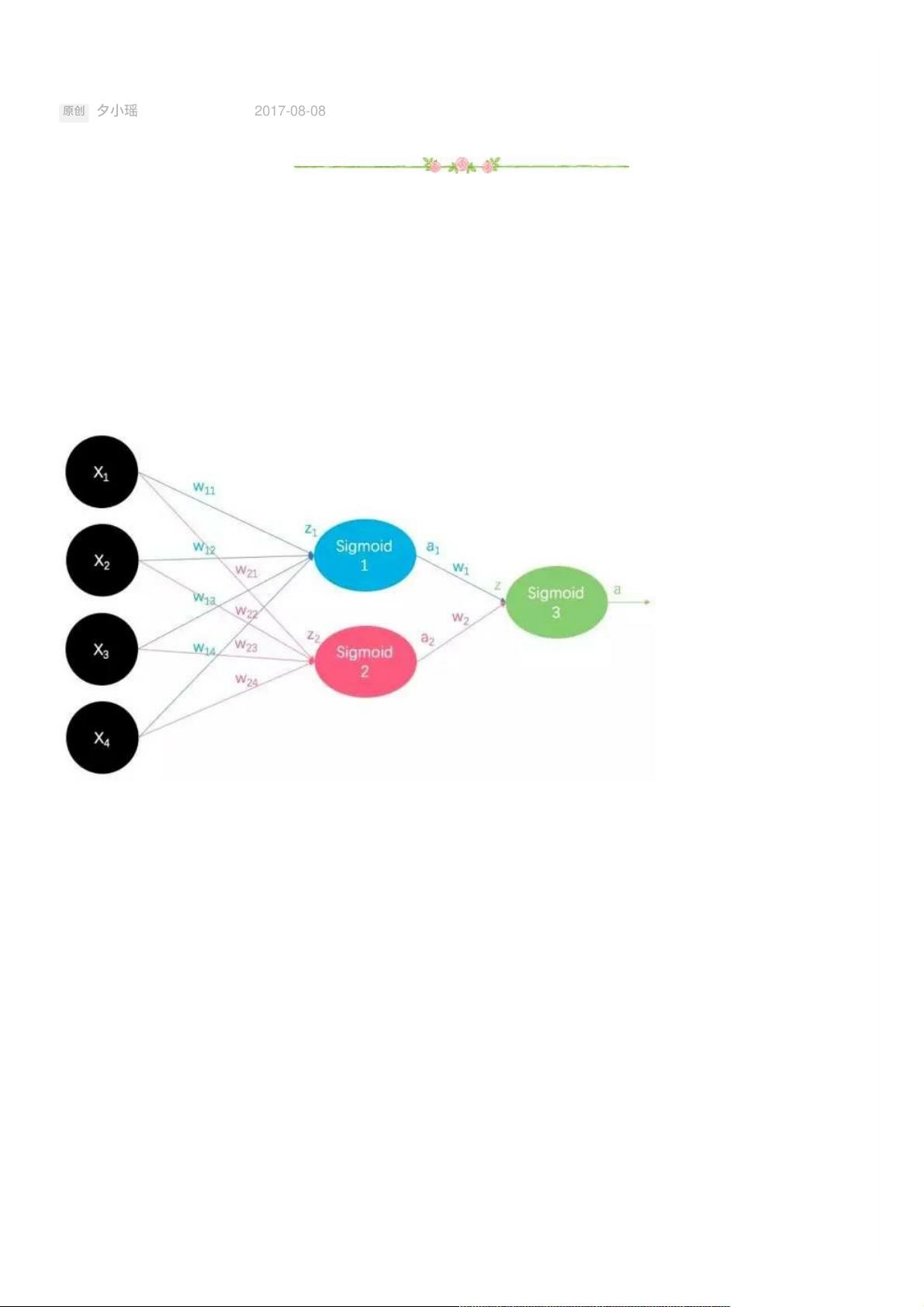

我们还是从前⾯更简单的机器学习model开始。回顾⼀下前⾯已经讲过N*N*N次的全连接前馈神经⽹络,前⾯⽂章中

⼩⼣讲过,对于⼀个有⼀个隐含层的全连接前馈⽹络:

这⾥就可以看作是两层简单的分类器的前后级联,前⼀层分类器的输出就是后⼀层分类器的输⼊,那么显然前⼀层

分类器的每个输出(即每个隐单元)代表什么含义我们是不清楚的,也就是前⼀层分类器学到的是分类未知意义的

类别!⽽后⼀层分类器则直接利⽤前⼀个分类器得到的未知类别来学习输出最终我们定义的类别!举个栗⼦。

⽐如输⼊是⼀副图像: