T

r

a

ns

f

orm

e

r

太⼤

了

,

我

要

把

它

微

调

成

R

NN

收

录

于

话

题

#

卖

萌

屋

@

⾃

然

语⾔

处

理

69

个

⽂

|

炼

丹

学

徒

编

|

⼩

轶

从

前

⻋

⻢

很

慢

,

显

卡

跑

的

也

慢

,⼀

⽣

只

够

爱

⼀个

RNN

。

后

来时

代

进

步

了

,

数据

量

和

计

算

⼒

阔

绰

了

,

堆

叠

起

来

的

Transformer

能

够

在

更

深

更

宽

的

模

型

结

构

⾥

吃

下

去

更

多

的

数据

。

从

19

年

的

预

训

练

浪

潮

开

始

,

暴

⼒

美

学

兴

起

,

更

深

的

Transformer

更

久

的

预

训

练

更

⼤

的

模

型

参

数

量

,

暴

⼒出

奇

迹

⼀个个

NLP

榜

单

被

刷

新

,

但

谁

⼜

记

得

起

来

当

初

Transformer

论

⽂

⾥

“

解

决

RNN

⽆

法

并

⾏

化

训

练

问题

”

的

追

求

效

率

的

motivation

呢

?

身

在

普

通

⾼

校

,

⼿

握

2080Ti

和

Titan V

,

向

着

⼤

⼚

的

预

训

练

模

型

望

洋

兴

叹

,

我

们

开

始

怀念

起

当

初

⼈⼈

都

训

练

得

起

的

LSTM

和

GRU

。

那

是

精

巧

轻

量

的

模

型

,

那

是

⼈⼈

都

刷

的

起

SOTA

的

时

代

。

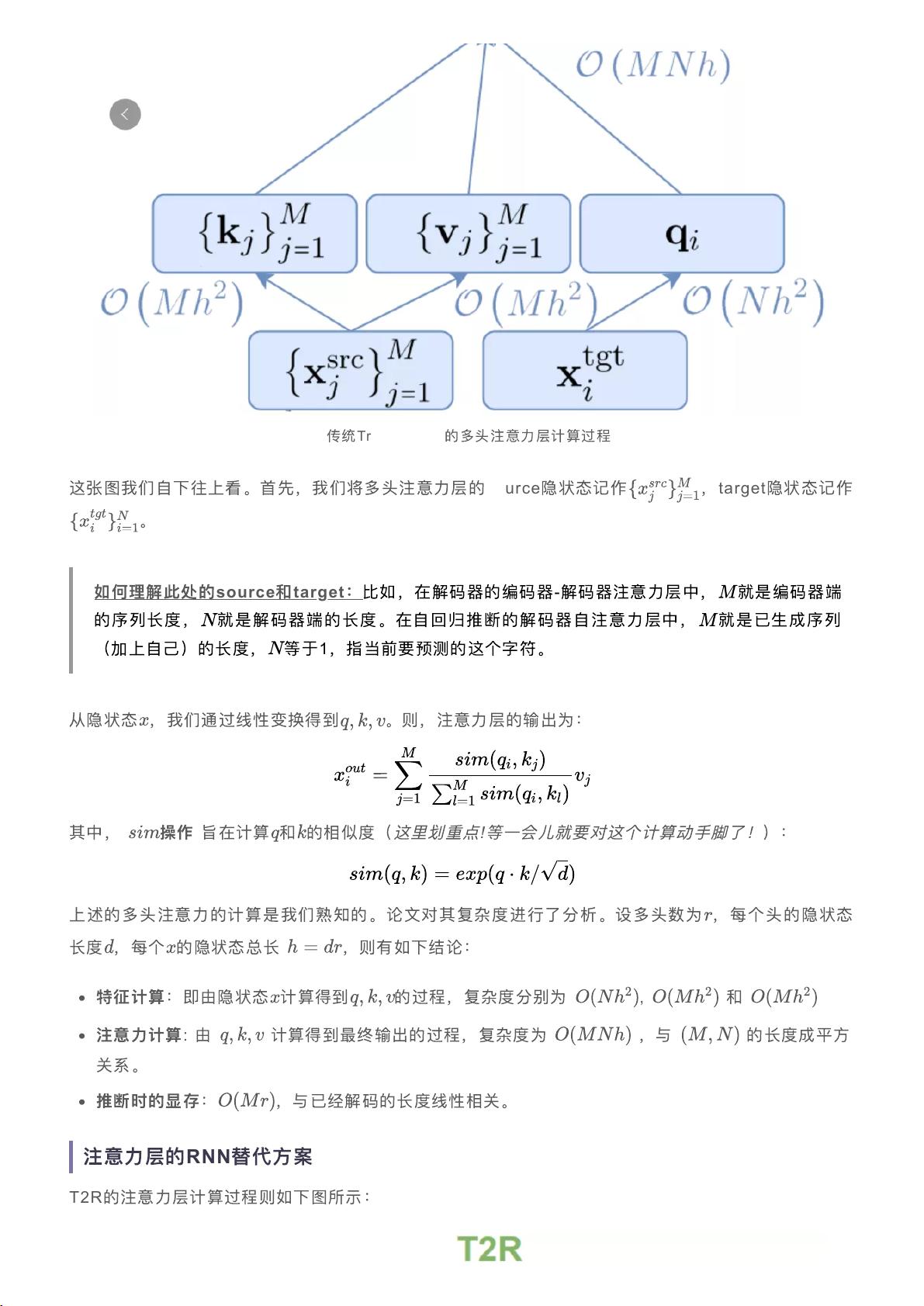

今

天

这

篇

来

⾃

微

软

的

论

⽂

告

诉

我

们

,

⼤

⼚

⾥

有

⼀

些

研

究

员

也

还

是

爱

我

们

的

,

Finetuning Pretrained

Transformers into RNNs

,

在

保

持

性

能

的

情

况

下,

将

预

训

练

好

的

Transformer

模

型

微

调

到其

RNN

变

体

,

极

⼤

地

降

低

显

存

使

⽤

和

计

算

开

销

。

论

⽂

题

⽬

:

Finetuning Pretrained Transformers into RNNs

论

⽂

链

接

:

https://arxiv.org/abs/2103.13076

Arxiv

访

问

慢

的

⼩

伙伴也

可

以

在

【

夕

⼩

瑶

的

卖

萌

屋

】

订

阅

号后台

回

复

关

键

词

【

0407

】

下

载

论

⽂

PDF~

炼

丹

学

徒

2021-04-07

22:20

原

创

夕

⼩

瑶

的

卖

萌

屋