2023/6/28 22:37

预训练模型对实体的表示能力差?一个简单有效的解法来了!(开源)

https://mp.weixin.qq.com/s/HXMU_IZAReEgfNi42Y8mIA

1/7

预训练模型对实体的表示能力差?一个简单有效的解法来了!(开

源)

收录于合集

#卖萌屋@自然语言处理

97个

文 | 小 轶

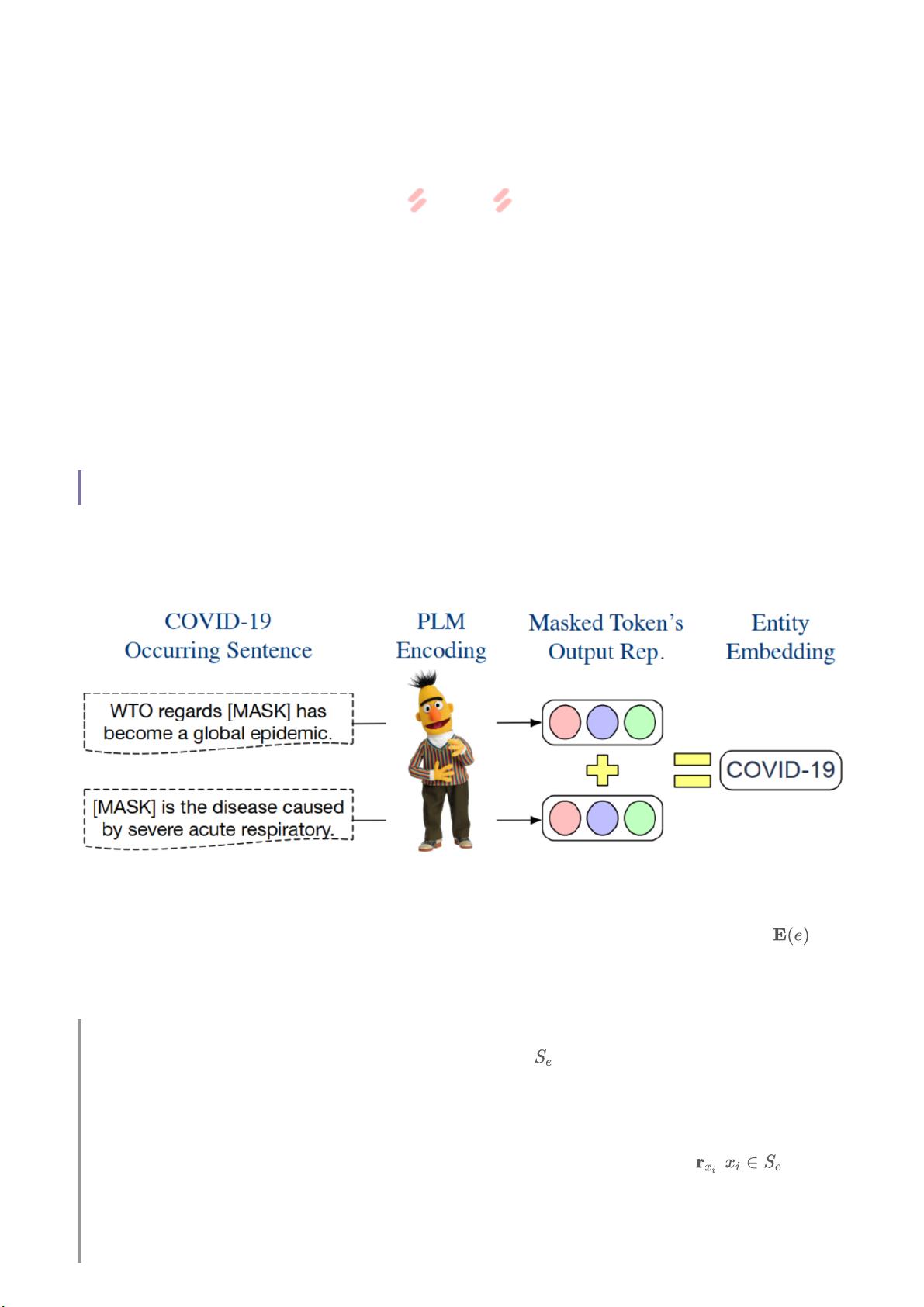

今天给大家介绍一篇 ACL'22 的论文,来自清华大学刘知远老师组。本文解决的问题是如 何 在

预 训 练 语 言 模 型 中 引 入 任 务 所 需 的 实 体 知 识 。此前常见的解决方法大致可以分为两种。

一种是在领域相关的语料上再做 further pretraining,比如 BioBERT。这种方法的缺点主要在

于需要大量的额外训练,V100 上的训练时长可达数千小时。

另一种是直接引入知识图谱,比如 ERNIE。本文则认为:使得预训练模型具备实体知识,可以

不完全依赖于引入外部知识图谱。已经有许多相关工作证明预 训 练 模 型 自 身 就 具 备 存 储 知 识

的 能 力 ,我们需要的只是一种调 用 出 模 型 知 识 存 储 的 方 法 。于是本文就提出了一种轻量的方

法 PELT,能够非常简单有效的达到引入实体知识的效果。

论 文 标 题 :

A Simple but Effective Pluggable Entity Lookup Table for Pre-trained Language Models

论 文 链 接 :

https://arxiv.org/pdf/2202.13392.pdf

小轶 2022-04-05 12:05

原创

夕小瑶科技说