没有合适的资源?快使用搜索试试~ 我知道了~

必看!大语言模型调研汇总!!.pdf

资源推荐

资源详情

资源评论

作者:guolipa @知乎

自从ChatGPT出现之后,各种大语言模型是彻底被解封了,每天见到的模型都能不重样,几乎分不清这

些模型是哪个机构发布的、有什么功能特点、以及这些模型的关系。比如 GPT-3.0 和 GPT 3.5 就有一系

列的模型版本和索引,还有羊驼、小羊驼、骆驼 ......

动图封面

于是浅浅的调研了一下比较有名的大语言模型,主要是想混个脸熟,整理完之后就感觉清晰多了,又可

以轻松逛知乎学习了。

动图封面

一一. Basic Language Model

基础语言模型是指只在大规模文本语料中进行了预训练的模型,未经过指令和下游任务微调、以及人类

反馈等任何对齐优化。

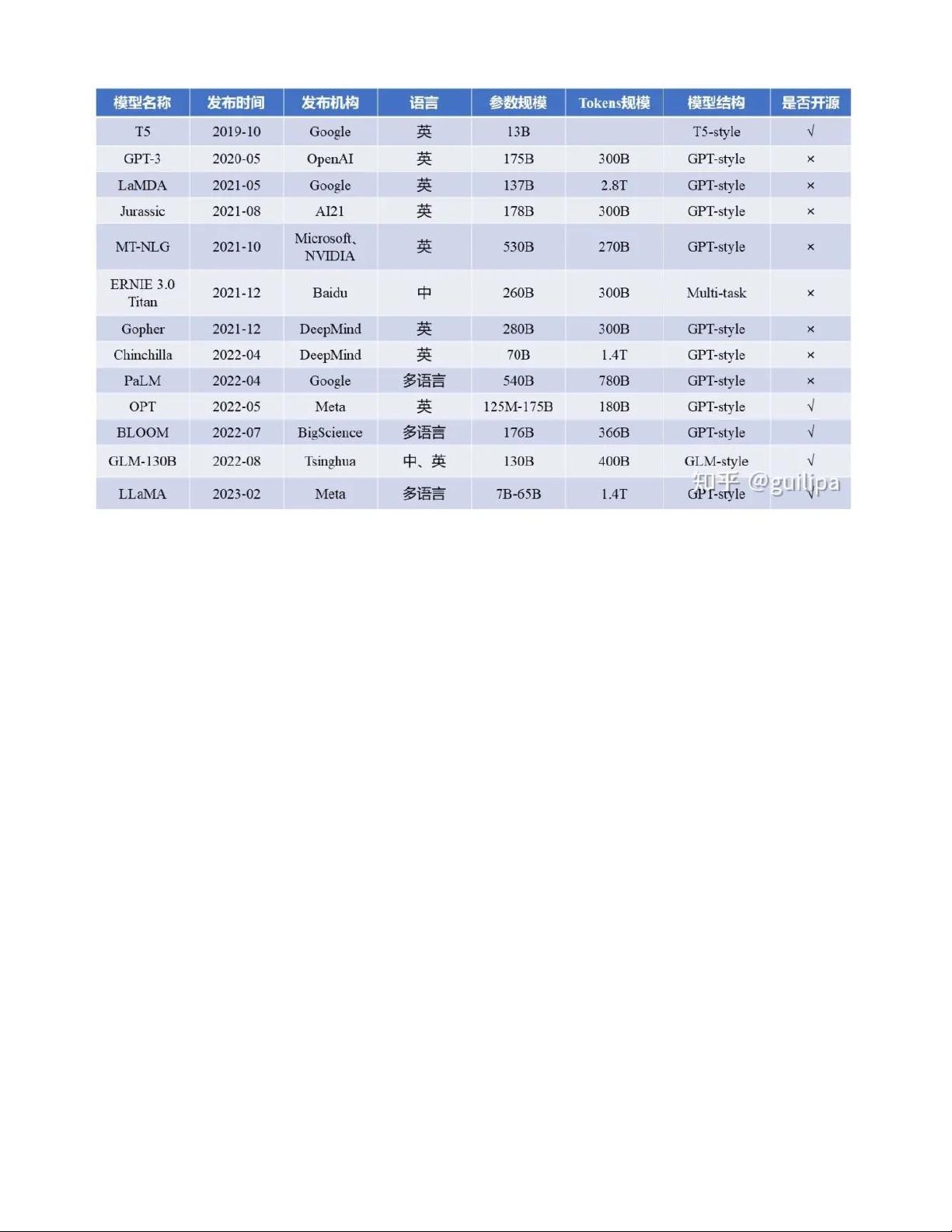

基础 LLM 基本信息表,GPT-style 表示 decoder-only 的自回归语言模型,T5-style 表示 encoder-

decoder 的语言模型,GLM-style 表示 GLM 特殊的模型结构,Multi-task 是指 ERNIE 3.0 的模型结构

当前绝大部分的大语言模型都是当前绝大部分的大语言模型都是 Decoder-only 的模型结构的模型结构,原因请转移这个问题:为什么现在

的LLM都是Decoder only的架构;

大部分大语言模型都不开源大部分大语言模型都不开源,而 OPT、BLOOM、LLaMA 三个模型是主要面向开源促进研究和应

用的,中文开源可用的是 GLM,后续很多工作都是在这些开源的基础模型上进行微调优化的。

T5[1]

T5 是谷歌提出了一个统一预训练模型和框架,模型采用了谷歌最原始的 Encoder-Decoder Transformer

结构。T5将每个文本处理问题都看成将每个文本处理问题都看成“Text-to-Text”问题问题,即将文本作为输入,生成新的文本作为输

出。通过这种方式可以将不同的 NLP 任务统一在一个模型框架之下,充分进行迁移学习。为了告知模型

需要执行的任务类型,在输入的文本前添加任务特定的文本前缀 (task-specific prefifix ) 进行提示,这也

就是最早的 Prompt。也就说可以用同样的模型,同样的损失函数,同样的训练过程,同样的解码过程来

完成所有 NLP 任务。

T5 本身主要是针对英文训练,谷歌还发布了支持 101 种语言的 T5 的多语言版本 mT5[2]。

GPT-3[3]

大语言模型中最具代表和引领性的就是发布 ChatGPT 的 OpenAI 的 GPT 系列模型 (GPT-1、GPT-2、

GPT-3、GPT-3.5、GPT-4),并且当前大部分大语言模型的结构都是 GPT-style ,文章生成式预训练

模型中介绍了GPT-1/2/3, 且从 GPT-3 开始才是真正意义的大模型。

GPT-3 是 OpenAI 发布的 GPT 系列模型的一个,延续了 GPT-1/2 基于Transformer Decoder 的自回归

语言模型结构,但 GPT-3 将模型参数规模扩大至将模型参数规模扩大至 175B, 是 GPT-2 的 100 倍,从大规模数据中吸纳更

多的知识。GPT-3不在追求 zero-shot 的设定,而是提出提出 In-Context Learning ,在下游任务中模型不,在下游任务中模型不

需要任何额外的微调,利用需要任何额外的微调,利用 Prompts 给定少量标注的样本让模型学习再进行推理生成给定少量标注的样本让模型学习再进行推理生成。就能够在只

有少量目标任务标注样本的情况下进行很好的泛化,再次证明大力出击奇迹,做大模型的必要性。通过

大量的实验证明,在 zero-shot、one-shot 和 few-shot 设置下,GPT-3 在许多 NLP 任务和基准测试中表

现出强大的性能,只有少量目标任务标注样本的情况下进行很好的泛化,再次证明大力出击奇迹,做大

模型的必要性。

剩余17页未读,继续阅读

资源评论

毕业课程设计

- 粉丝: 2247

- 资源: 1634

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功