没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

2017/10/7 如何用简单易懂的例子解释条件随机场(CRF)模型?它和HMM有什么区别? - 知乎

file:///C:/%E7%99%BE%E5%BA%A6%E4%BA%91%E5%90%8C%E6%AD%A5%E7%9B%98/%E5%9C%B0%E9%9D%A2%E7%89%B9%E8…

1/14

16 个回答

下载知乎客户端

与世界分享知识、经验和见解

相关问题

私家课 · Live 推荐

刘看山 · 知乎指南 · 知乎协议 · 应用 · 工作

侵权举报 · 网上有害信息举报专区

违法和不良信息举报:010-82716601

儿童色情信息举报专区

联系我们 © 2017 知乎

如何用简单易懂的例子解释条件随机场(CRF)模型?它和HMM有

什么区别?

看到一个同样问题问HMM,感觉答案都很好

关注者

1095

被浏览

62194

1 条评论 邀请回答

关注问题 写回答

机器学习

分享

默认排序

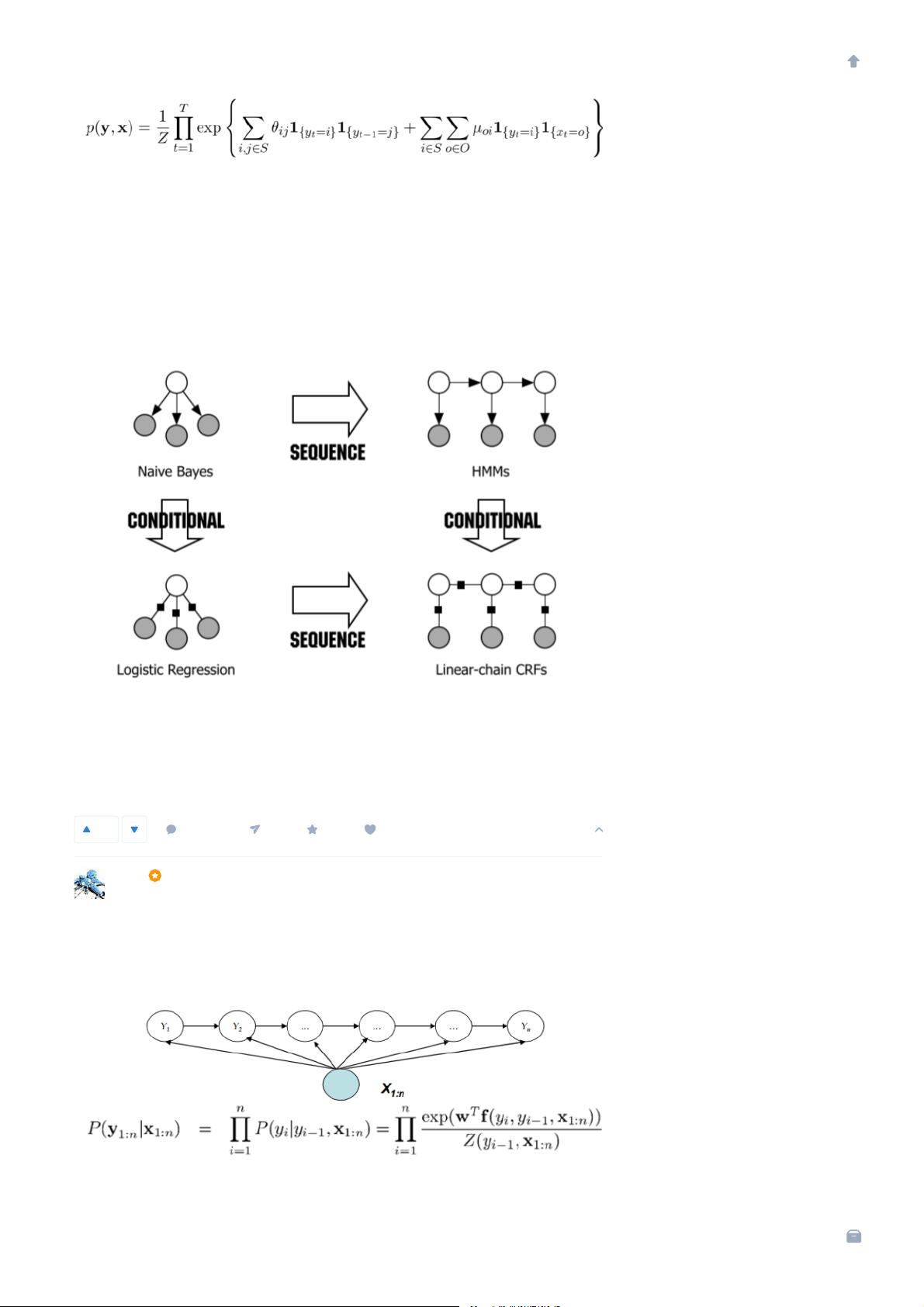

from Sutton, Charles, and Andrew McCallum. "An introduction to conditional random fields."

Machine Learning 4.4 (2011): 267-373.

发布于 2016-01-05

123

10 条评论 收藏 感谢

无有入无间

123 人赞同了该回答

祝皓玥

分享

搬砖狗强答一发...才疏学浅,不对求批评指正。

阅读前说明:

- 本人阅读的材料来主要来自于李航的《统计学习方法》第十一章和之前有人贴出的"An

introduction to conditional random fields" (90页太多没读完= _ =)

- 这段文字主要从两个方面描述了CRF公式的由来和其他模型的关系。

- 阅读前默认读者已了解HMM。知道大致流程是训练,最大似然,然后预测,知道特征函数的定义

等细节。

- 自己感觉,如果只要使用模型的话,只要知道公式,parameter estimate和inference就可以了,要

弄清楚整个probability graph model是个不小的工作量。

- 公式貌似太多,要是有人愿意阅读,本学渣跪谢您的耐心。

正文:

一般可以从两个方面来理解CRF模型:

一个从一般的graphical model来的(可以看成logistic回归的扩展)。

另一个方面是linear chain CRF与HMM有类似的结构,而分别是discriminative model和generative

model。

直接扔出CRF的公式会给人一种wtf的感觉,我阅读的材料都是从无向图模型开始说起,从这个模型

开始呢,可以理解公式怎么来的,那我们就从这个模型说起吧。

- 概率无向图模型(probabilistic undirected graphical model)

首先我们有无向图G=(V,E),V是节点,E是边, 图G中每个节点v上都有一个随机变量y,这样所有

莫名入了cv的坑

75 人赞同了该回答

赋布斯

如何用简单易懂的例子解释隐马尔可夫模

型? 35 个回答

机器学习专家与统计学家观点上有哪些不

同? 68 个回答

机器学习有很多关于核函数的说法,核函

数的定义和作用是什么? 49 个回答

「社交网络分析」是门怎样的学科? 11

个回答

HMM 实际应用过程中,如何确定隐含状

态数量? 8 个回答

10 大社会学经典破解职场

难题

共 11 节课

试听

大话移动互联网软件测试

Monkey 等

5 场 live, 335 次参与

互联网面试攻略中篇:算法

覃超

786 人参与

2017/10/7 如何用简单易懂的例子解释条件随机场(CRF)模型?它和HMM有什么区别? - 知乎

file:///C:/%E7%99%BE%E5%BA%A6%E4%BA%91%E5%90%8C%E6%AD%A5%E7%9B%98/%E5%9C%B0%E9%9D%A2%E7%89%B9%E8…

2/14

的节点上的随机变量就构成一组随机变量Y,图G上有联合概率分布P(Y)。边e表示相邻节点的变量

存在某种神秘的联系。

图G上的随机变量Y满足马尔科夫性,即两个不相邻的节点上的随机变量yi,yj条件独立。

这个模型的定义就这么简单,它又叫马尔科夫随机场(MRF),这个名字貌似响亮一些。

再稍微介绍一下最大团(maximal clique) 如下图

图中{Y1,Y2,Y3}和{Y3,Y2,Y4}是最大团,包含的任何节点都两两相连被称作团。最大团就是不能再

添加节点。

然后呢,有个定理叫Hammersley-Clifford定理,给出了无向图模型P(Y)的公式。

- Hammersley-Clifford

定

理

:

概率

无

向图

模

型

的

联

合

概率

分

布

P(Y)

可

以

表

示

为

如

下

形式

:

P(Y)=\frac{1}{Z}\ \prod_{C}\Psi_{C}(Y_{C}) Z=\sum_{Y}\prod_{C}\Psi_{C}(Y_{C})

其中

C

是无

向图

最

大团

,

Yc

是

C

的

节

点

对应

的

随

机

变

量

,

\Psi_{C}(Y_{C})

是

一

个严

格正

势

函

数

,

乘

积

(

因

式

分

解

)

是

在

无

向图

所

有最

大团

上

进

行

的

。

另外,势函数这东西呢是Gibbs分布的,这个定理意义就是用Gibbs概率分布来计算马尔科夫随机

场。一般来说势函数取对数线性,这样方便计算。

好了,这东西就介绍完了,接下来就是CRF。

- 条件随机场(conditional random field)

定义:(和上面的模型比较就是多了一个X。)

设

X

与

Y

是

随

机

变

量

,

P(Y|X)

是

给

定

条

件

X

的

条

件下

Y

的

条

件

概率

分

布

,

若

随

机

变

量

Y

构

成

一

个

由

无

向

图

G=(V,E)

表

示的

马

尔

科

夫

随

机

场

。

则

称

条

件

概率

分

布

P(X|Y)

为

条

件

随

机

场

。

虽然定义里面没有要求,我们还是默认X和Y结构一致,这是general CRF,然后看看linear chain

CRF,线性链就是X和Y都是一串序列,线性链里面呢,最大团就是相邻的两项,y_i和y_i+1。

由Hammersley-Clifford定理写出linear chain CRF的公式。

P(Y|X)=\frac{1}{Z}\prod_{i=0}^{n-1}\Psi_{i}(Y_{i},Y_{i+1}|X)

势函数取 对数线性,就得到了第一次见让本学渣云里雾里的公式。(懒得输了贴个图)

再详细点:

就是linear chain CRF常见的两种特征函数指数和的形式。

注意点!!!高潮来了!!如果我们把上式中的特征函数

t_{k}

去掉,得到就是自变量X关于Y的

logistic回归(加上一个normalizer函数Z(x)),每个Y和X之间对数线性关系。本学渣看到这里的时

候真是amazing了一下。

好了,那么是不是可以说linear chain CRF是logistic回归,再加上了有关相邻项某种神秘联系的参数

呢?看起来是这样的,我也不敢确定= =、、

之后呢,再从HMM的角度看。

- HMM和linear chain CRF

HMM的概率分布可以写成这样的形式:

2017/10/7 如何用简单易懂的例子解释条件随机场(CRF)模型?它和HMM有什么区别? - 知乎

file:///C:/%E7%99%BE%E5%BA%A6%E4%BA%91%E5%90%8C%E6%AD%A5%E7%9B%98/%E5%9C%B0%E9%9D%A2%E7%89%B9%E8…

3/14

右边取对数变成和的形式,再加上归一化的Z(x) 得到

嗯,这样一看就和前面的CRF长的很像了,就是一个是条件概率,一个是联合概率,

这也是discriminative model和generative model的区别。

注意Z(x)是遍历所有y的全局归一化,写在乘积符号里面的是local归一化,得到的是MEMM。

其实generative和discriminative的差别是很大的,因为假设不一样,结果和参数训练的方法都不

同,线性的CRF不需要EM算法,稍微简单一些,最大似然训练集之后,梯度下降加上vertebi算法就

可以了。

最后贴上参考资料上一张图

嗯,所以说我们就是从这两条路走到了线性的CRF,general的CRF也是从MRF来的,公式是最大

团的乘积形式,计算上麻烦一些,会用到loopy belief propagation。

发布于 2016-06-19

75 10 条评论 收藏 感谢 收起分享

一部分区别在于概率归一化的时候。CRF的归一化在模型上更加合理(但是在计算的时候可能导致

计算量增加),而HMM的归一化会导致label bias问题

MEMM(可以看做是HMM与log-linear model结合的一种方式)

CRF

机器学习 话题的优秀回答者

18 人赞同了该回答

li Eta

剩余13页未读,继续阅读

资源评论

风迹阿sir2018-01-16不好用,就是问答,

风迹阿sir2018-01-16不好用,就是问答, JJJJYYYYYY1232021-07-03知乎上复制粘贴都复制不全,浪费我的积分

JJJJYYYYYY1232021-07-03知乎上复制粘贴都复制不全,浪费我的积分

spanel

- 粉丝: 5

- 资源: 14

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功