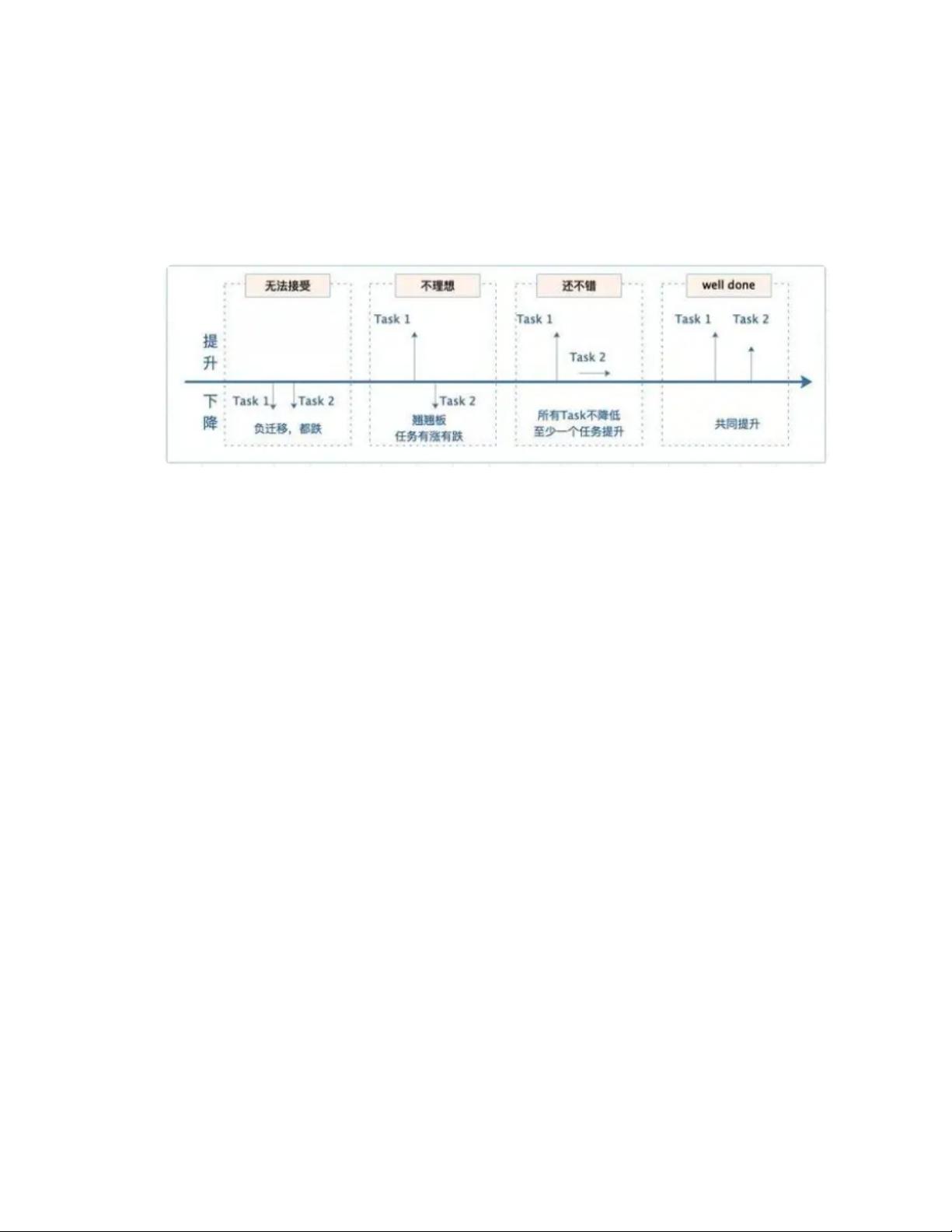

kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考,kaggle教程,方案分析,竞赛资料,竞赛方案参考, 【任务损失与梯度优化策略】在机器学习和深度学习领域,优化模型性能的一个关键环节是设计有效的损失函数和选择合适的梯度优化策略。在多任务学习中,这些问题尤为重要,因为不同的任务可能有不同的目标和难度,这可能导致负迁移(negative transfer)、跷跷板效应(see-saw effect)等问题。以下是一些解决这些问题的方法: 1. **不确定性加权(Uncertainty Weighting)** Kendall等人在2018年的论文中提出了利用不确定性来加权损失函数的思想,以解决不同任务之间的权重平衡问题。他们引入了可学习的噪声参数σ,表示任务的不确定性。通过定义概率模型和最大化高斯似然估计,可以调整每个任务的损失权重。对于回归和分类任务,可以通过调整损失函数中的惩罚项来适应不同任务的特性,避免损失值的负值。不确定性较大的任务会被赋予较小的损失权重,以减少其对整体优化的影响。 2. **多任务学习损失加权(Multi-Task Loss Weighting)** 这种方法通常根据任务的重要性或者任务的难度动态调整损失权重。可以使用固定的权重,也可以学习这些权重。权重的更新可以基于任务的损失值、学习速率或者其他指标。 3. **共享参数与任务特定参数(Shared Parameters and Task-Specific Parameters)** 通过将部分网络层设为所有任务共享,部分层设为任务特定,可以控制任务间的交互。共享参数有助于提取通用特征,而任务特定参数则允许各任务独立优化。 4. **梯度归一化(Gradient Normalization)** 当不同任务的梯度大小不同时,可以对每个任务的梯度进行归一化,确保它们在同一尺度上,从而避免某个任务的学习速度过快或过慢。 5. **损失剪切(Loss Clipping)** 如果某些任务的损失值过大,可以采取剪切策略,限制损失值在一个合理的范围内,防止损失值过大的任务主导整个优化过程。 6. **梯度对偶(Gradient Orthogonality)** 当不同任务的梯度方向冲突时,可以尝试使它们正交,从而减少负面影响。这可以通过正交约束或正交初始化来实现。 7. **梯度聚合(Gradient Aggregation)** 可以采用平均、加权平均或其他聚合策略来结合来自不同任务的梯度,以促进协同学习。 8. **分阶段训练(Sequential Training)** 在训练过程中,可以先训练一个任务,然后固定该任务的参数,再训练下一个任务。这种方法可以逐步优化每个任务,同时减少负迁移。 这些策略都是为了在多任务学习中找到一个平衡点,让模型能够有效地学习各个任务,提高整体性能。在实际应用中,可能需要结合具体问题和数据集的特点,灵活选择和组合这些方法,以获得最佳效果。在Kaggle等竞赛中,这些技巧常常被用于构建高效的解决方案,帮助参赛者提升模型的表现。

剩余31页未读,继续阅读

- 粉丝: 1w+

- 资源: 7740

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功