没有合适的资源?快使用搜索试试~ 我知道了~

概率图模型_知乎Scofield.pdf

需积分: 18 9 下载量 81 浏览量

2019-08-01

20:08:00

上传

评论

收藏 764KB PDF 举报

温馨提示

试读

26页

这是知乎上《如何用简单易懂的例子解释条件随机场(CRF)模型?它和HMM有什么区别?》问题下最高赞用户Scofield的回答,我整理为pdf版本,以供大家下载学习,里面涉及HMM,MEMM,CRF的总结,

资源推荐

资源详情

资源评论

1

一、Preface

二、Prerequisite

2.1 概率图

2.1.1 概览

2.1.2 有向图 vs. 无向图

2.1.3 马尔科夫假设&马尔科夫性

2.2 判别式模型 vs. 生成式模型

2.3 序列建模

三、HMM

3.1 理解 HMM

3.2 模型运行过程

3.2.1 学习过程

3.2.2 序列标注(解码)过程

3.2.3 序列概率过程

四、MEMM

4.1 理解 MEMM

4.2 模型运行过程

4.2.1 学习过程

4.2.2 序列标注(解码)过程

4.2.3 序列概率过程

4.3 标注偏置?

五、CRF

5.1 理解 CRF

5.2 模型运行过程

5.2.1 学习过程

5.2.2 解码过程

5.2.3 序列概率过程

5.3 CRF++分析

5.4 LSTM+CRF

2

六、总结

Referrence

一、Preface

之前刚接触 NLP 时做相关的任务,也必然地涉及到了序列处理任务,然后自然要接触

到概率图模型。当时在全网搜中文资料,陆续失望地发现竟然真的没有讲得清楚的博文,

发现基本是把李航老师书里或 CRF tutorial 等资料的文字论述和公式抄来抄去的。当然,

没有说别人讲的是错的,只是觉得,要是没有把东西说的让读者看得懂,那也是没意义

啊。或者有些吧,就是讲了一大堆的东西,貌似也明白了啥,但还是不能让我很好的理解

CRF 这些模型究竟是个啥,完了还是有一头雾水散不开的感觉。试想,一堆公式扔过来,

没有个感性理解的过渡,怎么可能理解的了。我甚至觉得,如果博客让人看不懂,那说明

要么自己没理解透要么就是思维不清晰讲不清楚。所以默想,深水区攻坚还是要靠自己,

然后去做调研做 research,所以就写了个这个学习记录。

所以概率图的研究学习思考列入了我的任务清单。不过平时的时间又非常的紧,只能

陆陆续续的思考着,所以时间拖得也真是长啊。

这是个学习笔记。相比其他的学习模型,概率图貌似确实是比较难以理解的。这里我

基本全部用自己的理解加上自己的语言习惯表达出来,off the official form,表达尽量

接地气。我会尽量将我所有理解过程中的每个关键小细节都详细描述出来,以使对零基础

的初学者友好。包括理论的来龙去脉,抽象具象化,模型的构成,模型的训练过程,会注

重类比的学习。

根据现有资料,我是按照概率图模型将 HMM,MEMM,CRF 放在这里一起对比学习。之所

以把他们拿在一起,是因为他们都用于标注问题。并且之所以放在概率图框架下,是完全

因为自己 top-down 思维模式使然。另外,概率图下还有很多的模型,这儿只学习标注模

型。

正儿八经的,我对这些个概率图模型有了彻悟,是从我明白了生成式模型与判别式模

型的那一刻。一直在思考从概率图模型角度讲他们的区别到底在哪。

另外,篇幅略显长,但咱们不要急躁,好好看完这篇具有良好的上下文的笔记,那肯

定是能理解的,或者就多看几遍。

个人学习习惯就是,要尽可能地将一群没有结构的知识点融会贯通,再用一条树状结

构的绳将之串起来,结构化,就是说要成体系,这样把绳子头一拎所有的东西都能拿起

来。学习嘛,应该要是一个熵减的过程,卓有成效的学习应该是混乱度越来越小!这个思

维方式对我影响还是蛮大的。

在正式内容之前,还是先要明确下面这一点,最好脑子里形成一个定势:

统计机器学习所有的模型(个别 instant model 和优化算法以及其他的特种工程知识

点除外)的工作流程都是如此:

a.训练模型参数,得到模型(由参数唯一确定),

b.预测给定的测试数据。

拿这个流程去挨个学习模型,思路上会非常顺畅。这一点可参见我另一篇文字介绍。

3

除此之外,对初学者的关于机器学习的入门学习方式也顺带表达一下(empirical

speaking):

a.完整特征工程竞赛

b.野博客理论入门理解

c.再回到代码深入理解模型内部

d.再跨理论,查阅经典理论巨作。这时感性理性都有一定高度,会遇到很多很大的理

解上的疑惑,这时 3 大经典可能就可以发挥到最大作用了。

很多 beginer,就比如说学 CRF 模型,然后一上来就摆一套复杂的公式,什么我就问,

这能理解的了吗?这是正确的开启姿势吗?当然了,也要怪那些博主,直接整一大堆核心公

式,实际上读者的理解门槛可能就是一个过渡性的细枝末节而已。没有上下文的教育肯定是

失败的(这一点我又想吐槽国内绝大部分本科的院校教育模式)。所以说带有完整上下文信

息以及过程来龙去脉交代清楚才算到位吧。

而不是一上来就死啃被人推荐的“经典资料”,这一点相信部分同学会理解。好比以前

本科零基础学 c++ JAVA,上来就看 primr TIJ,结果浪费了时间精力一直在门外兜圈。总结

方法吸取教训,应该快速上手代码,才是最高效的。经典最好是用来查阅的工具书,我目前

是李航周志华和经典的那 3 本迭代轮询看了好多轮,经常会反复查询某些 model 或理论的

来龙去脉;有时候要查很多相关的东西,看这些书还是难以贯通,然后发现有些人的博客写

的会更容易去理解。所以另外,学习资料渠道也要充分才行。

最后提示一下,请务必按照标题层级结构和目录一级一级阅读,防止跟丢。

二、Prerequisite

2.1 概率图

之前刚接触 CRF 时,一上来试图越过一堆繁琐的概率图相关概念,不过 sad to say,

这是后面的前驱知识,后面还得反过来补这个点。所以若想整体把握,系统地拿下这一

块,应该还是要越过这块门槛的。

当然了,一开始只需略略快速看一篇,后面可再返过来补查。

2.1.1 概览

在统计概率图(probability graph models)中,参考宗成庆老师的书,是这样的体

系结构(个人非常喜欢这种类型的图):

4

在概率图模型中,数据(样本)由公式

建模表示:

V 表示节点,即随机变量(放在此处的,可以是一个 token 或者一个 label),具体

地,用

为随机变量建模,注意 Y 现在是代表了一批随机变量(想象对应一条

sequence,包含了很多的 token),P(Y)为这些随机变量的分布;

E 表示边,即概率依赖关系。具体咋理解,还是要在后面结合 HMM 或 CRF 的 graph 具

体解释。

2.1.2 有向图 vs. 无向图

上图可以看到,贝叶斯网络(信念网络)都是有向的,马尔科夫网络无向。所以,贝

叶斯网络适合为有单向依赖的数据建模,马尔科夫网络适合实体之间互相依赖的建模。具

体地,他们的核心差异表现在如何求 P=(Y),即怎么表示

这个的联合概率。

1. 有向图

对于有向图模型,这么求联合概率:

举个例子,对于下面的这个有向图的随机变量(注意,这个图我画的还是比较广义的):

应该这样表示他们的联合概率:

应该很好理解吧。

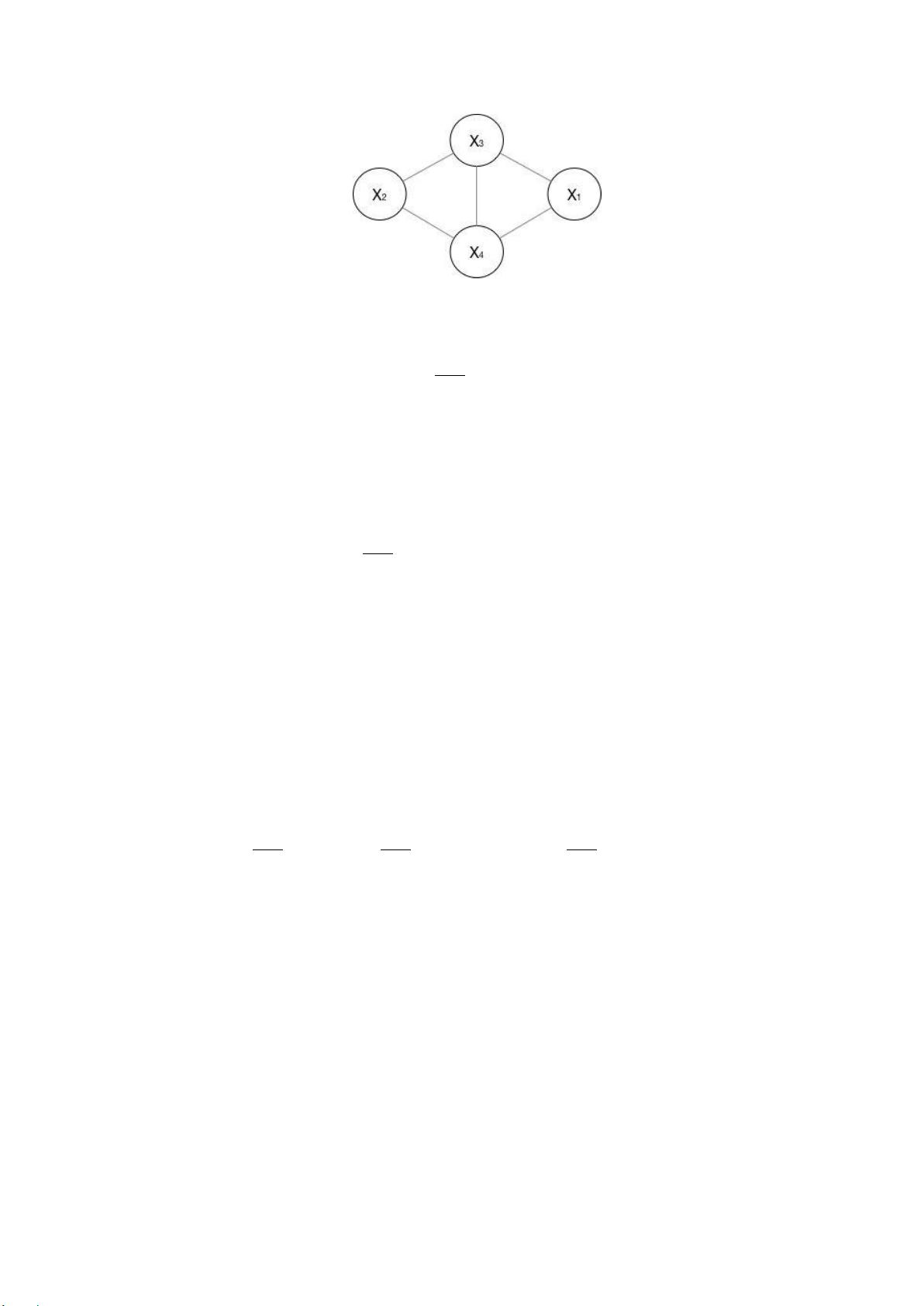

2. 无向图

对于无向图,我看资料一般就指马尔科夫网络(注意,这个图我画的也是比较广义的)。

5

如果一个 graph 太大,可以用因子分解将 P=(Y)写为若干个联合概率的乘积。咋分解

呢,将一个图分为若干个“小团”,注意每个团必须是“最大团”(就是里面任何两个点

连在了一块,具体……算了不解释,有点“最大连通子图”的感觉),则有:

其中

,公式应该不难理解吧,归一化是为了让结果算作概率。

所以像上面的无向图:

其中,

是一个最大团 C 上随机变量们的联合概率,一般取指数函数的:

好了,管这个东西叫做势函数。注意

是否有看到 CRF 的影子。

那么概率无向图的联合概率分布可以在因子分解下表示为:

注意,这里的理解还蛮重要的,注意递推过程,敲黑板,这是 CRF 的开端!这个由

Hammersly-Clifford law 保证,具体不展开。

2.1.3 马尔科夫假设&马尔科夫性

这个也属于前馈知识。

1. 马尔科夫假设

这应该是齐次马尔科夫假设,这样假设:马尔科夫链

里的

总是只受

剩余25页未读,继续阅读

资源评论

ydf_micro

- 粉丝: 1

- 资源: 10

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功