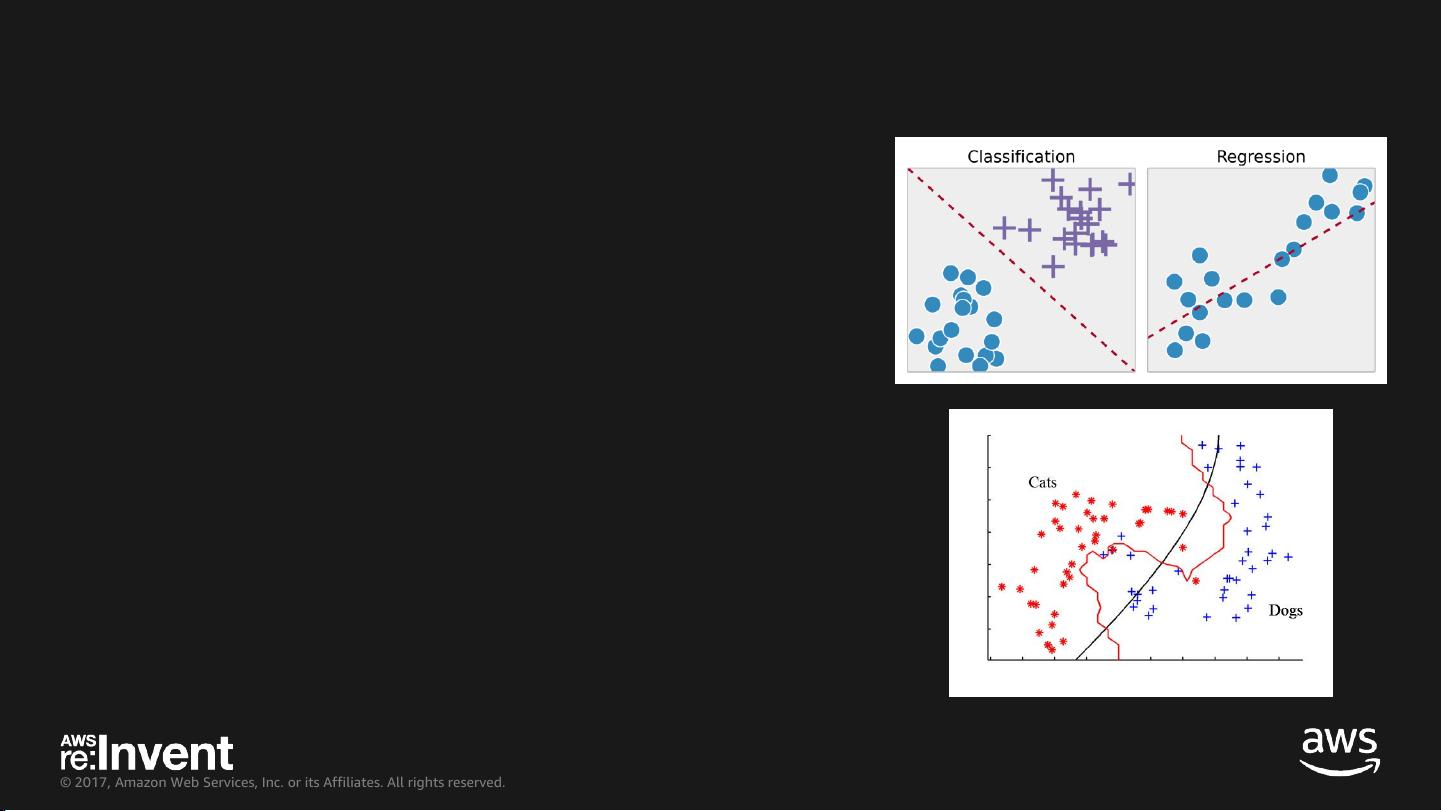

MXNet Gluon 是一个用于深度学习的开源库,它提供了一种非常方便的方式来构建和训练神经网络。这个库是Apache MXNet的一个高层接口,以提供灵活性和简洁的编程模型,同时保持底层的性能和控制。本知识点将详细介绍Gluon库,以及它在深度学习中的应用。 **MXNet Gluon 介绍** MXNet Gluon最初由亚马逊Web服务(AWS)开发,并于2017年开源。它旨在为开发者提供一种易于使用的深度学习工具,以减少编程复杂性并提高开发效率。Gluon支持动态计算图和静态计算图两种编程模型,它简化了模型定义和训练过程,使得构建复杂模型和实验新想法变得更加容易。 **深度学习基础** 在介绍Gluon之前,我们需要了解一些深度学习的基础知识。深度学习是机器学习的一个子集,它使用类似于人脑神经网络的结构来学习和解决问题。深度学习模型主要由神经网络构成,这些网络由输入层、隐藏层和输出层组成。每个层包含多个神经元或节点,这些节点通过权重相互连接。通过调整这些权重,网络能够学习到从输入数据到输出预测之间的复杂映射关系。 **机器学习的目标** 机器学习的一个主要目标是从未标记的数据开始,尽可能准确地标记数据,并提供一个函数,基于输入数据尽可能准确地概率性地近似预测。这通常通过损失函数来衡量模型的性能,损失函数评估了模型预测值与实际值之间的差异。 **统计模型的局限性** 传统的统计模型在处理高维数据、识别结构性相关性、挑选复杂模式以及特征工程方面存在局限。高维数据意味着数据有很多特征或维度,这对于统计模型来说是一个挑战。机器学习模型通常需要较少的手动特征工程,因为它们可以自动学习数据的特征表示。 **感知器与非线性** 感知器是一种简单的二分类器,它是神经网络的基本构成单元。感知器接收输入信号,通过加权求和后,将结果传递给一个激活函数。激活函数用来决定神经元是否被激活。在深度学习中,非线性激活函数是必须的,因为它们允许模型学习和模拟复杂的数据结构。 **深度学习中的隐藏层与非线性** 深度学习模型之所以强大,是因为它们能够通过添加非线性转换到隐藏层的输出来学习复杂的模式。这种非线性是通过激活函数实现的,它将隐藏层的输出转换成一个连续范围的输出。例如,ReLU(Rectified Linear Unit)是一种常用的激活函数,它将所有负值设置为零,而正值保持不变。 **深度学习中的“学习”过程** 深度学习中的学习过程实质上是调整神经网络中的权重,以最小化损失函数的过程。这通常通过反向传播算法实现,该算法通过网络向后传播误差,并使用梯度下降或其他优化算法来更新权重。 **深度学习的挑战** 尽管深度学习在各种领域都取得了巨大成功,但它也面临着一些挑战。例如,训练深度学习模型需要大量的数据和计算资源。此外,深度学习模型的解释性往往较差,这意味着它们的决策过程难以理解。 **Gluon API 介绍** Gluon API为构建神经网络提供了一种高级接口,包括各种预定义的层和组件,使得快速原型设计和实验变得更加容易。Gluon还支持直观的模型参数管理,包括默认初始化、模型检查点保存和加载等。使用Gluon,开发者可以更专注于算法的研究,而不是底层的实现细节。 通过这篇文章,我们介绍了MXNet Gluon的概念、重要性和深度学习的基础知识。它强调了Gluon如何简化深度学习模型的设计与训练过程,同时提供了相应的例子来阐述如何在实践中应用这些概念。随着深度学习的不断发展,Gluon作为其核心库之一,将继续在研究和工业界扮演重要角色。

剩余81页未读,继续阅读

- 粉丝: 340

- 资源: 9

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 人工智能&深度学习:PyTorch 实战 - DataLoader 自定义花卉数据集制作资源(源码+数据集+说明)

- 研发效能提升全解析:业界顶尖专家答疑效能度量与实践

- 素材图片文档合集-新空间

- 安徽省创新型中小企业名单(2024年度第二批)

- DeepSeek完全实用手册V1.0+-+至顶AI实验室.pdf

- ihrm接口测试postman脚本

- 汇编语言教程&案例&相关项目资源

- Comsol仿真解析纳米孔超表面的手性响应及其应用探究,纳米孔超表面的手性响应与COMSOL仿真的探讨分析,comsol仿真纳米孔超表面的手性响应 ,关键词:comsol仿真; 纳米孔超表面; 手性响

- 哪吒之魔童闹海-ts文件

- 【火绒-2025研报】“火绒终端安全管理系统1.0版”.pdf

- 【Workday-2025研报】探索银行中AI驱动技术转型的投资回报率。.pdf

- 【科智咨询-2025研报】deepseek对算力产业的影响.pdf

- 【未知机构-2025研报】3D 打印行业发展研究报告.pdf

- 【莱坊-2025研究报告】Melbourne CBD Office Market February 25.pdf

- 【YOYI悠易-2025研报】突破传统奢侈品营销模式:数变奢侈品营销新增长.pdf

- 【360-2025研报】2025年1月勒索软件流行态势分析.pdf

信息提交成功

信息提交成功