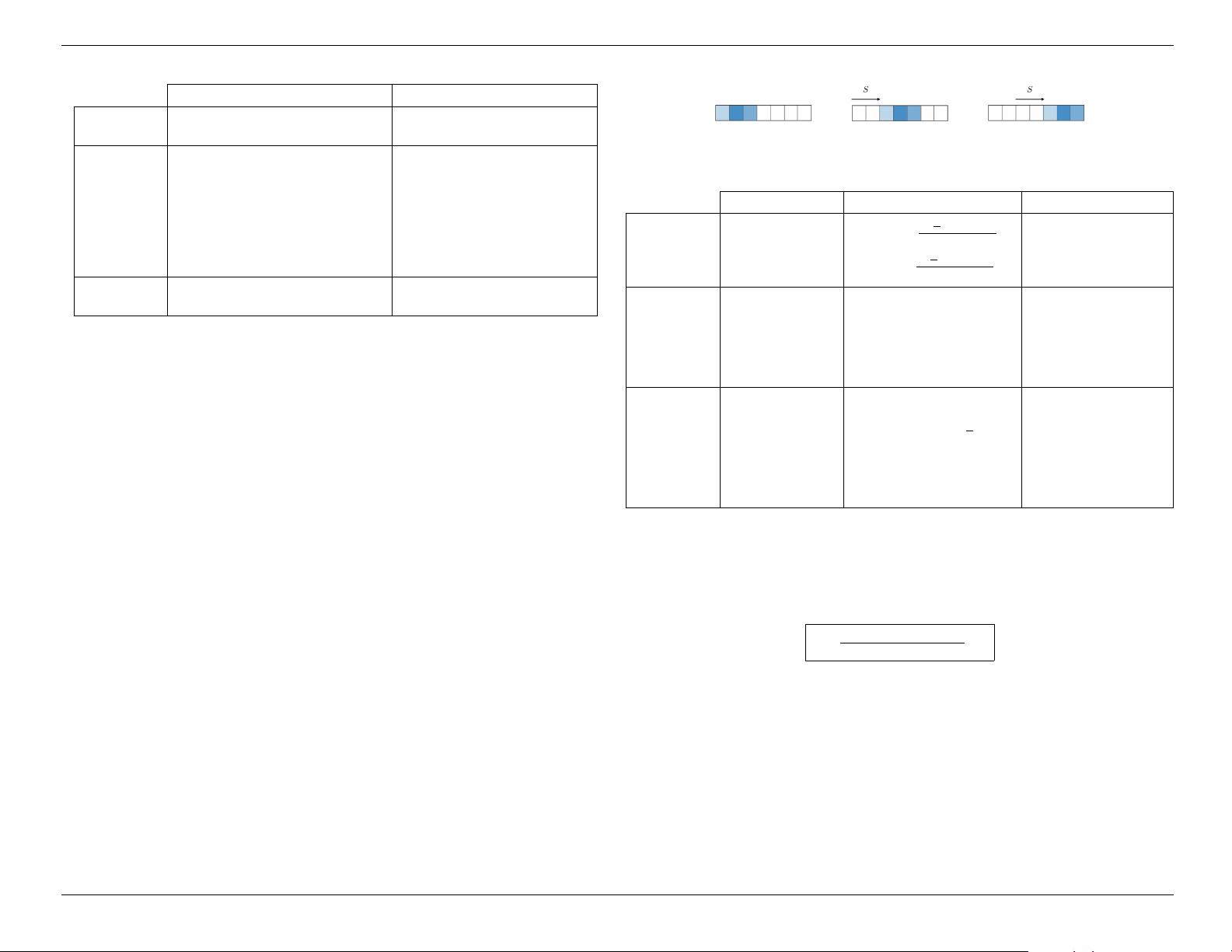

### 深度学习超级VIP速查表:关键知识点概览 #### 卷积神经网络(Convolutional Neural Networks) **概述** 卷积神经网络(CNN)是一种专门设计用于处理具有网格结构输入数据(如图像)的神经网络。CNN在计算机视觉任务中表现出了强大的能力,比如图像分类、目标检测等。 **卷积层(Convolutional Layer, CONV)** - **定义**:卷积层使用一组滤波器对输入进行扫描,这些滤波器执行卷积操作。 - **超参数**: - **滤波器大小(Filter Size, F)**:指定了滤波器的尺寸。 - **步长(Stride, S)**:指定了滤波器在输入上移动的步长。 - **输出**:卷积操作的结果通常被称为特征图或激活图。 **池化层(Pooling Layer, POOL)** - **定义**:池化层通常位于卷积层之后,它通过下采样来降低空间维度,减少计算量同时保持重要信息。 - **类型**: - **最大池化(Max Pooling)**:选取每个区域的最大值作为输出。 - **平均池化(Average Pooling)**:选取每个区域的平均值作为输出。 - **目的**:池化层可以增加模型对输入微小变化的鲁棒性,并减少过拟合的风险。 **滤波器超参数(Filter Hyperparameters)** - **滤波器数量**:一个卷积层中滤波器的数量决定了该层能够提取多少种不同的特征。 - **滤波器尺寸**:较小的滤波器可以捕捉局部细节,较大的滤波器可以捕捉更大的模式。 - **步长(Stride)**:较大的步长可以减少输出尺寸,但可能会丢失细节;较小的步长会保留更多细节,但输出尺寸较大。 **调整超参数(Tuning Hyperparameters)** - **学习率**:调整学习率可以帮助模型更快地收敛。 - **批量大小(Batch Size)**:较大的批量可以提供更稳定的梯度估计,但需要更多的内存资源。 - **正则化参数**:适当的正则化可以防止过拟合。 **常用的激活函数(Commonly Used Activation Functions)** - **ReLU (Rectified Linear Unit)**:如果输入是负数,则输出为0;如果是正数,则输出与输入相同。 - **Sigmoid**:将任何数值映射到0和1之间,适用于二分类问题。 - **tanh (Hyperbolic Tangent)**:类似于Sigmoid函数,但输出范围是-1到1。 **目标检测(Object Detection)** - **定义**:目标检测的任务是识别图像中的多个物体并给出它们的位置。 - **方法**: - **滑动窗口法**:使用不同大小的窗口在图像上滑动并应用分类器。 - **基于候选区域的方法**:如R-CNN系列算法,先找到潜在的目标位置,再进行分类。 - **端到端的方法**:如YOLO(You Only Look Once),可以直接从输入图像预测出物体类别及其边界框。 **人脸识别与验证(Face Verification and Recognition)** - **人脸识别**:从一张图片中识别出特定人物的身份。 - **人脸验证**:验证两张图片中的人物是否为同一个人。 - **常用技术**:使用深度学习模型提取面部特征,然后通过距离度量来进行比较。 **神经风格迁移(Neural Style Transfer)** - **定义**:神经风格迁移是指将一张图片的风格转移到另一张图片上。 - **实现**:通常使用两个损失函数:内容损失和风格损失。内容损失确保内容图像的主要对象被保留,而风格损失则确保风格图像的风格被应用于内容图像。 **使用计算技巧的架构(Architectures Using Computational Tricks)** - **跳跃连接(Skip Connections)**:如ResNet中使用的跳跃连接可以帮助解决梯度消失问题。 - **注意力机制(Attention Mechanism)**:使模型能够聚焦于输入序列中更重要的部分,从而提高性能。 #### 循环神经网络(Recurrent Neural Networks) **概述** 循环神经网络(RNN)是一种特别适合处理序列数据的神经网络,例如文本和语音信号。 **处理长期依赖性(Handling Long-Term Dependencies)** - **问题**:传统的RNN在处理长序列时容易遭受梯度消失/爆炸问题。 - **解决方案**:长短期记忆网络(LSTM)和门控循环单元(GRU)通过特殊的设计解决了这一问题。 **学习词表示(Learning Word Representations)** - **动机**:词嵌入是一种将词转换为向量的技术,这些向量能够捕获词汇之间的语义和语法关系。 - **词嵌入(Word Embeddings)**:常见的词嵌入技术包括Word2Vec和GloVe。 - **比较词项**:通过计算词向量之间的相似度(如余弦相似度)来衡量词语间的相似程度。 **语言模型(Language Model)** - **定义**:语言模型是一种用于预测给定序列中下一个词的概率分布的模型。 - **应用**:可以用于自动补全、机器翻译等自然语言处理任务。 **机器翻译(Machine Translation)** - **定义**:机器翻译是指将一种语言的文本自动转换为另一种语言的过程。 - **方法**:使用编码器-解码器架构结合注意力机制来提高翻译质量。 **注意力机制(Attention)** - **定义**:注意力机制允许模型在处理序列数据时关注输入序列的不同部分。 - **应用**:在机器翻译、问答系统等领域中得到了广泛应用。 #### 深度学习技巧与窍门(Deep Learning Tips and Tricks) **数据预处理(Data Processing)** - **标准化/归一化**:对输入数据进行标准化或归一化,以便模型更好地学习。 - **数据增强**:通过对训练数据进行变换(如旋转、缩放等)来扩大数据集规模。 **训练神经网络(Training a Neural Network)** - **定义**:包括选择合适的优化器、设置初始权重等步骤。 - **寻找最优权重**:使用反向传播算法来更新权重,使得损失函数最小化。 **参数调整(Parameter Tuning)** - **权重初始化**:良好的权重初始化可以加速模型收敛。 - **优化收敛**:通过调整学习率等超参数来提高模型训练效率。 **正则化(Regularization)** - **定义**:正则化是一种技术,用于减少模型复杂度,防止过拟合。 - **常见方法**:包括L1和L2正则化、Dropout等。 **良好实践(Good Practices)** - **早停法(Early Stopping)**:当验证集上的性能不再提高时停止训练。 - **使用验证集**:将一部分训练数据保留为验证集,用于调整超参数和评估模型性能。 - **模型集成**:使用多个模型的预测结果进行集成,可以提高整体性能。 通过以上知识点的梳理,我们可以看到深度学习领域的关键技术及其应用。这些技术和方法不仅在理论上有深刻的见解,在实际应用中也发挥了重要作用。对于想要深入学习深度学习技术的人来说,理解这些基本概念和技术是至关重要的。

剩余12页未读,继续阅读

- 粉丝: 4w+

- 资源: 1083

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 光储并网VSG系统Matlab simulink仿真模型,附参考文献 系统前级直流部分包括光伏阵列、变器、储能系统和双向dcdc变器,后级交流子系统包括逆变器LC滤波器,交流负载 光储并网VSG系

- file_241223_024438_84523.pdf

- 质子交膜燃料电池PEMFC Matlab simulink滑模控制模型,过氧比控制,温度控制,阴,阳极气压控制

- IMG20241223015444.jpg

- 模块化多电平变器(MMC),本模型为三相MMC整流器 控制策略:双闭环控制、桥臂电压均衡控制、模块电压均衡控制、环流抑制控制策略、载波移相调制,可供参考学习使用,默认发2020b版本及以上

- Delphi 12 控件之FlashAV FFMPEG VCL Player For Delphi v7.0 for D10-D11 Full Source.7z

- Delphi 12 控件之DevExpressVCLProducts-24.2.3.exe.zip

- Mysql配置文件优化内容 my.cnf

- 中国地级市CO2排放数据(2000-2023年).zip

- smart200光栅报警程序

信息提交成功

信息提交成功