没有合适的资源?快使用搜索试试~ 我知道了~

基于图卷积半监督学习的论文作者同名消歧方法研究.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 184 浏览量

2023-02-23

20:06:24

上传

评论

收藏 443KB DOCX 举报

温馨提示

试读

15页

基于图卷积半监督学习的论文作者同名消歧方法研究.docx

资源推荐

资源详情

资源评论

1. 引言

作者姓名歧义一直是国内外出版界和学术界的难点问题。近年来科学论文数量呈指数

级增长,重名现象越来越严重,特别是名称缩写、拼音一音多字等问题影响着文献检索系

统以及学术评价的准确性。为消除歧义,许多研究机构提出了人名标识系统以期通过唯一

标识来区分作者,如开放研究者与贡献者身份识别码(Open Researcher and Contributor

IDentifier, ORCID)

[1]

、Thomson Reuters 的 ResearchID

[2]

等。然而,人名标识系统的应用范

围有限,大量科学出版物中并未明确标注作者身份识别码。因此,通过自动化方法解决论

文中作者歧义问题仍然是同名消歧的主要手段,也是国内外学者的研究热点之一。常用的

作者消歧方法往往将问题转化为机器学习的聚类问题或分类问题,如利用 SVM

[3]

、层次聚

类

[4]

、谱聚类

[5]

等机器学习算法进行处理。随着深度学习技术的发展,越来越多研究人员采

用网络嵌入方法(Network Embedding)进行作者同名消歧

[6,7]

,从论文数据中抽取特征以便于

聚类或分类任务。此外,具有表征学习能力的卷积神经网络(Convolutional Neural Networks,

CNN)快速发展,在计算机视觉

[8,9]

、自然语言处理

[10]

等领域都取得了巨大成功,而图卷积

神经网络(Graph Convolutional Network, GCN)由于能够有效处理具有丰富关系结构的任务,

常用于处理图节点表示学习、图节点分类、边预测、图分类等问题

[11-14]

。鉴于此,本文提

出了一种基于图卷积半监督学习的论文作者同名消歧方法,融合作者、机构、题目、关键

词等论文属性信息,借助 BERT 语义表示方法和图卷积神经网络,探索作者消歧方法,以

提高作者与成果的匹配效果。

2. 相关研究

Zhang 等人

[6]

将当前同名消歧的研究方法分为两类:基于特征的消歧方法和基于连接/

图的消歧方法。

基于特征的消歧方法应用较早,根据文档的特征向量学习文档之间的距离函数,将相

近的特征向量归入相同类别,实现同名消歧。Huang 等人

[15]

提出了一个有效的综合框架来

解决名称消歧问题,分别利用 Blocking 技术检索具有相似名称作者的候选类,使用在线主

动选择支持向量机算法(LASVM)计算论文之间的距离度量进行 DBSCAN 聚类。Yoshida 等

人

[16]

提出一种基于 bootstrapping 的两阶段聚类算法来改善低查全率,其中第 1 阶段的聚类

结果用于提取第 2 阶段聚类中使用的特征。Han 等人

[3]

提出了基于 SVM 和贝叶斯网络的有

监督消歧方法,利用论文合作者、题目出版物名称等特征对同名作者进行消歧。Zhu 等人

[17]

使用多层聚类的方式进行同名消歧,如分别利用 Email 信息、论文合作者、论文题目等

进行动态的作者聚类。

基于连接/图的消歧方法利用图的拓扑结构或者聚合来自邻居节点的信息,例如 Fan

等人

[18]

提出了一种仅使用合作者关系的同名消歧框架 GHOST,通过合作关系构造图,根

据图中待排歧作者间有效路径的数目和长度计算相似度,再对相似度矩阵聚类实现同名消

歧。Tang 等人

[19]

利用隐马尔可夫随机域对统一概率框架下的节点特征和边特征进行建模。

Zhang 等人

[7]

提出一种基于网络嵌入的解决方案,构建作者-作者、作者-论文、论文-论文 3

个图,利用各种匿名网络的链接结构,将每个文档表示为低维向量空间,以解决名称消歧

任务。Hermansson 等人

[20]

提出了一种基于局部邻域结构的匿名图实体消歧方法,基于局部

邻域结构利用 Graph Kernels 计算图中节点之间的相似度,并用 SVM 执行分类任务。

Zhang 等人

[6]

采用结合全局监督和局部上下文的表示学习方法,采用该技术的名称消歧模块

应用在 AMiner 系统中能够高效处理十亿级规模的消歧问题。

本文结合两种消歧方法的优势,一方面利用论文文本属性信息如题目、关键词等计算

语义特征向量,再通过合作关系和同机构关系构建论文网络,将卷积用于图结构进行半监

督学习,达到作者消歧的目的。

3. 基于图卷积半监督学习的作者同名消歧方法

图卷积神经网络是一种最为典型的图神经网络。图卷积半监督学习利用卷积操作将节

点的特征向量和节点间的图结构结合在一起,节点的特征向量每经过 1 次图卷积操作,就

通过图结构利用临近节点更新自己的特征向量,从而使相似的节点具有相似的特征向量

[21]

。此过程适用于作者同名消歧任务,待消歧论文通过相互关联构建网络并通过图卷积网

络不断更新特征向量实现论文聚类任务。

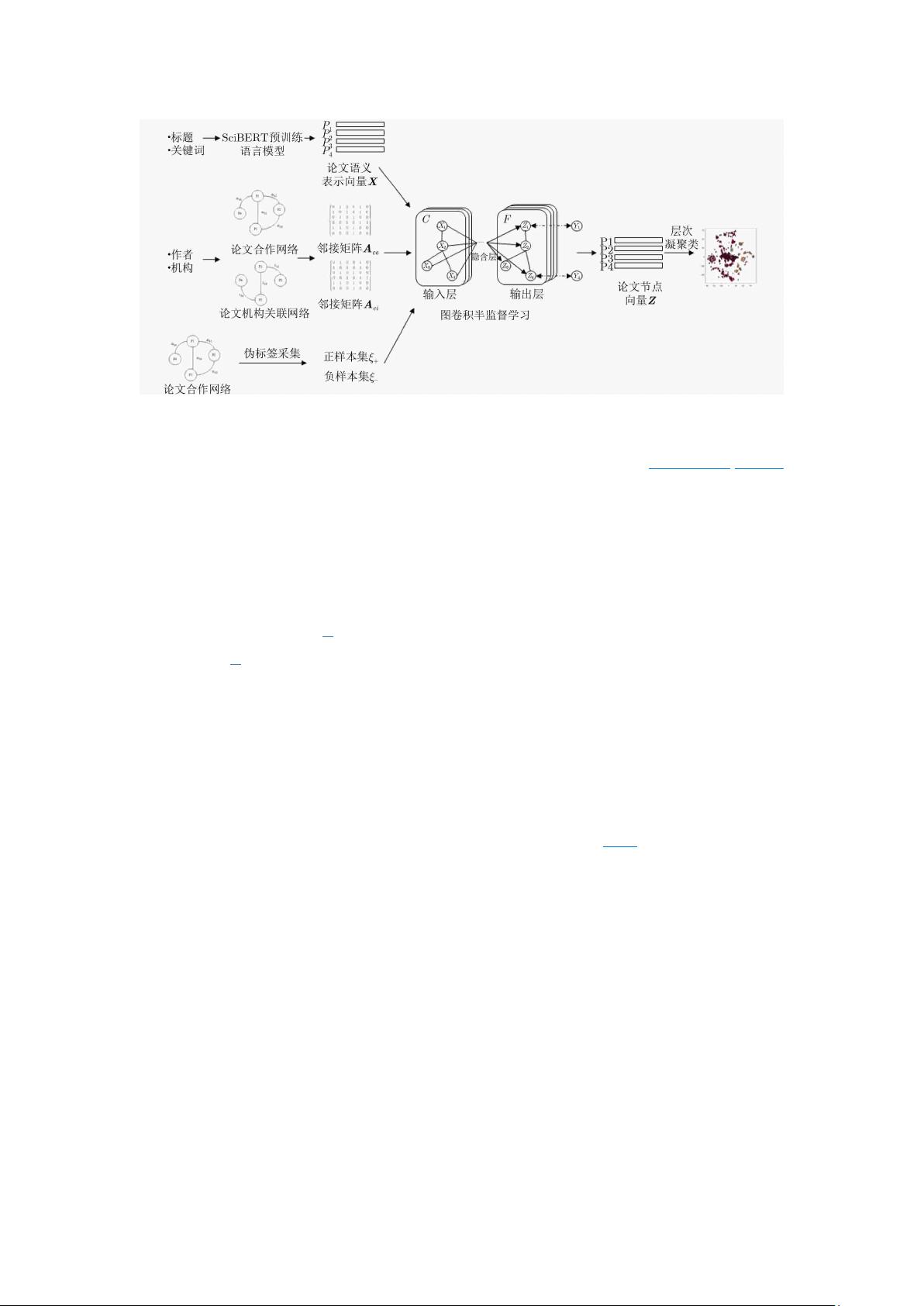

基于这一思路,本文提出一种基于图卷积半监督学习的作者同名消歧方法框架如图 1

所示。首先,将论文的题目、关键字作为文本输入预先训练好的 SciBERT 模型得到每篇论

文的语义表示向量;其次,利用论文的作者和机构信息构建论文合作网络与机构关联网

络,分别获得邻接矩阵;然后,从论文合作网络中采集伪标签,获得正样本集和负样本

集;将待消歧论文的 BERT 语义向量、论文合作网络和论文机构关联网络以及正、负样本

集作为输入,利用图卷积神经网络进行半监督学习,获得论文最终节点向量;最后使用层

次凝聚类算法将论文节点向量聚类划分,实现对论文作者同名消歧。

图 1 研究框架

下载: 全尺寸图片 幻灯片

3.1 基于 BERT 预训练模型的论文语义表示

由于研究人员在一段时间内的研究方向相对稳定,论文的题目、关键词、摘要、出版

物名称等文本特征也可用于表征作者的研究内容并用于区分从事不同研究的同名作者。目

前,广泛使用的文本向量构建方法包括 n-gram, NNLM, word2vec 等。2018 年 Google 发布

了 BERT 预训练语言模型

[22]

,在自然语言处理的 11 个任务上大幅刷新了精度。随后,

Beltagy 等人

[23]

推出了专门为科学论文训练的 SciBERT 预训练语言模型,更适用于科学论

文的自然语言处理任务。为充分利用论文文本特征,本文将论文的题目、关键词作为文本

输入,利用 SciBERT 模型得到每篇论文的语义表示向量。

设每篇论文的题目和关键词拼接获得的句子输入为 dd,则 BERT 输入为

[CLS,d,SEP][CLS,d,SEP],CLS 和 SEP 标识符分别作为句子的起始符和分隔符,经过分词

获得句子的 token 序列{tok1,tok2,⋯,tokN}{tok1,tok2,⋯,tokN},依次输入到 BERT 模型中。

BERT 以双向 Transformer 的 Encoder 作为模型的基本组成单元(如图 2 中 BERT 层),能够

联合所有层中左右两个方向的上下文信息进行训练,利用多头注意力机制进行更多层面的

特征提取,最后得到含有丰富语义特征的序列向量,即输出为该论文的语义表示向量,设

为\boldsymbold\boldsymbolS\boldsymbold\boldsymbolS,向量维数为 BERT 的默认隐含元

个数 768,记为 HH。则待消歧同名作者论文集合的语义表示向量矩阵

\boldsymbolX\boldsymbolH×\boldsymbolK=(\boldsymbold\boldsymbolS1,\boldsymbold\bolds

ymbolS2,⋯,\boldsymbold\boldsymbolS\boldsymbolK)\boldsymbolX\boldsymbolH×\boldsymbolK

=(\boldsymbold\boldsymbolS1,\boldsymbold\boldsymbolS2,

⋯,\boldsymbold\boldsymbolS\boldsymbolK),其中

\boldsymbold\boldsymbolS\boldsymboli\boldsymbold\boldsymbolS\boldsymboli 为第 ii 篇论文

的语义表示向量,KK 为论文的数量。

剩余14页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3691

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功