没有合适的资源?快使用搜索试试~ 我知道了~

基于多注意力机制的维吾尔语人称代词指代消解.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 134 浏览量

2023-02-23

16:53:50

上传

评论

收藏 333KB DOCX 举报

温馨提示

试读

19页

基于多注意力机制的维吾尔语人称代词指代消解.docx

资源推荐

资源详情

资源评论

指代(Anaphora)作为一种常见的语言现象, 广泛存在于自然语言的表达之中. 它对语言

的简化表达、主题的突出性描述和语言表达连贯性起着重要的作用. 对指代成分准确无歧

义的消解有助于机器分析和语篇理解

[1]

. 在语言学中, 指代词称为照应语(Anaphor), 用于指

向另一个语言单位, 被指代词称为先行语(Antecedent), 用于被指向的语言单位, 指代消解

(Anaphora Resolution)就是确定照应语所指代的先行语的过程

[2]

. 维吾尔语人称代词指代消

解是研究人称代词与句中名词和名词性短语的指代关系, 图 1 给出维吾尔语人称代词指代

消解例句.

图 1 维吾尔语人称代词指代消解例句

Fig. 1 The example of Uyghur personal pronoun anaphora resolution

下载: 全尺寸图片 幻灯片

如果一个人称代词存在指代关系, 那么它与相关文本中的一个或多个提及的名词或名

词性短语关联. 本句中" (吾斯英)" 和" (他)" 存在指代关系, " (布

葛热汗)" 和" (他)" 不存在指代关系.

近年来, 随着深度学习技术在语音识别、计算机视觉、图像识别等领域的重大突破,

学者们尝试将深度学习模型应用于自然语言处理任务中. 例如 Kim 使用卷积神经网络

(Convolutional neural network, CNN)进行句子建模, 解决情感分类任务

[3]

, Irsoy 等使用循环神

经网络(Recurrent neural network, RNN)进行意见分析

[4]

, Tai 等使用长短时记忆网络(Long

short term memory network, LSTM)解决情感分类问题

[5]

, 这些基于深度学习的方法在自然语

言处理任务中取得了比以往研究更好的分类效果.

指代消解作为自然语言处理一个重要子任务, 深度学习模型在指代消解中得到广泛的

研究. 这些研究关注照应语和候选先行语的语义信息, 应用大量的神经网络模型进行候选先

行语预测

[6-8]

. 目前的研究主要针对中文和英文等具有充足语料库的语种, 对维吾尔语等小

语种的研究不够深入, 针对小语种的研究无论是语料标注还是实体识别都需要掌握多级语

法知识、语义知识, 甚至相应语言领域知识, 在当前自然语言处理的研究阶段, 要获取和学

习研究中所需知识仍比较困难. 人称代词指代消解作为指代消解任务更细粒度的一个分支,

不仅依赖照应语和候选先行语特征信息, 还要关注距离特征和上下文语境信息. 例如句子:

(因为吾斯英是当代的大学者之一, 所以布葛热汗尊敬他)

我们普遍认为与照应语距离越近的候选先行语存在指代关系概率越大, 根据候选先行

语" (吾斯英)"、" (学者)"和" (布葛热汗)", 很难推断"

(吾斯英)" 是否为照应语" (他)"正确的先行语, 在这种情况下, 研究者会错误地判断"

(布葛热汗)"为" (他)"的先行语, 因为文本中" (布葛热汗)"与"

(他)"距离更近. 但是, 候选先行语" (吾斯英)" 才是照应语" (他)" 正确

的先行语. 所以, 人称代词指代消解应该充分考虑候选先行语距离特征和更深层次的语境信

息.

针对以上问题, 本文提出基于多注意力机制的深度学习模型应用于维吾尔语人称代词

指代消解任务. 注意力机制最早应用于视觉图像领域, 目的是在神经网络训练过程中将注意

力集中到图像的特定部分. Mnih 等首次提出在 RNN 模型上使用注意力机制进行图像分类

[9]

,

验证了注意力机制在图像处理领域的有效性. 随后 Bahdanau 等将注意力机制应用于机器翻

译任务

[10]

, 模型取得了显著的效果并使注意力机制成功应用于自然语言处理领域. 随着研究

不断深入, Yin 等提出基于注意力机制的卷积神经网络进行句子建模

[11]

, Wang 等使用基于注

意力机制的 LSTM 解决细粒度的情感分析问题

[12]

, 这些方法的提出验证了注意力机制结合

深度学习模型的有效性.

本文结合三种注意力机制来构造 CMAIR 模型: 1)词向量注意力机制: 突出照应语和候

选先行语的重要程度, 2)距离注意力机制: 有效表达不同词语对消解结果的贡献度, 3)词性注

意力机制: 是句中词和词性的关联. 同时, 本文结合 IndRNN 构造语境特征, 并将这 4 种特

征作为模型的输入, 可以从多个层面学习词语级和句子级特征信息, 提高指代消解性能.

本文提出的 CMAIR 模型使用 3 种注意力机制和语境特征构建模型, 使模型关注多种

特征信息. 最后, 将 CMAIR 模型在维吾尔语数据集进行实验, 实验结果表明, 本方法取得

了比以往研究更好的分类效果. 本文的主要贡献有 5 方面:

1) 提出一种结合语境的多注意力独立循环网络(CMAIR)应用在维吾尔语人称代词指

代消解任务中, 实验取得了当前研究最好效果;

2) 本文首次考虑结合语境的深度学习模型, 学习词序关联和依赖关系, 结合语境信息

增强了特征表达力;

3) 本文提出的词向量、词性、距离注意力机制能从三方面获取更深层次的特征信息,

弥补了单注意力机制仅关注内容层面信息的不足;

4) CMAIR 模型结构简单, 具有很强的鲁棒性和泛化能力, 无需额外的句法分析和语义

依存分析相关知识;

5) 提出一种距离识别算法, 能准确计算待消解对距离, 识别不同词在句中重要程度,

使 CMAIR 可以充分利用距离信息.

1. 相关工作

1.1 指代消解

指代消解作为自然语言处理重要子任务, 是细粒度的文本分类任务, 更加关注照应语

和候选先行语深层次语义特征, 一直以来都得到众多学者的研究和关注. Soon 等首次给出

利用机器学习的方法进行指代消解基本步骤, 其思想是把指代消解任务看作二分类问题, 从

已标注好的语料库中提取语料的各类词法、语法、语义特征作为消解框架的输入并利用分

类器完成指代消解任务

[13]

; Ng 等对 Soon 等研究进行了改进, 抽取 53 个特征, 指代消解的效

果有显著地改善

[14]

; Yang 等提出将特征方法和聚类相结合, 模型消解性能有较大的提高

[15]

;

这些方法通过传统的机器学习构造文本语法、句法等特征, 能充分利用文本内容层面特征,

有效进行指代关系识别. 此外, 指代消解在多种语言已得到广泛的研究.

近年来, 随着深度学习在自然语言处理领域的广泛应用, 许多研究者也利用深度学习

方法解决指代消解任务. Chen 等针对此问题提出一种深度神经网络模型, 在他们的工作中,

照应语和候选先行语用前馈神经网络编码

[16]

. Clark 等尝试对指代消解的一种神经网络

Mention Rank 模型的启发式损失函数中的超参数利用强化学习方式进行优化, 提出一种奖

励衡量机制, 跟其他方式相比结果突出

[17]

. Iida 等提出一种句内主题指代关系并利用多列卷

积神经网络(Multi-column CNN)来预测指代关系, 在多个基准测试中取得了很好的结果

[8]

.

Yin 等建立一个深度记忆网络获取零代词和先行语语义关联信息

[18]

. 这些方法使用深度学习

技术来解决指代消解问题, 可以在不需要依存树、句法关系的情况下通过深度神经网络更

好地学习文本的深层次特征信息, 取得了比传统机器学习方法更好的分类效果.

针对维吾尔语指代消解问题, 目前已有学者进行研究. 李敏等提出一种基于栈式自编

码深度学习的算法进行维吾尔语名词短语指代消解

[19]

. 田生伟等挖掘维吾尔语隐含的上下

文语义层面特征, 提出利用 BiLSTM 的深度学习机制进行基于深层语义信息的维吾尔语人

称代词指代消解, 维吾尔语人称代词指代消解的 F 值达到 76.86%, 证明了该方法的有效性

[20]

. 李冬白等通过堆叠多层 RBM 网络和一层 BP 网络构建 DBN 深度网络学习模型, 经过维

吾尔语语料库测试, F 值达到 83.81%, 该方法能有效提升维吾尔语人称代词指代消解性能,

推动了维吾尔语指代消解的研究

[21]

.

本文提出的 CMAIR 模型与现有技术的主要区别在于多注意力机制和 IndRNN 的应用,

我们将指代消解作为多注意力机制和 IndRNN 环境下关注词语重要程度和学习文本深层次

语境特征的过程. 在 IndRNN 模型的帮助下, CMAIR 模型学习以顺序的方式对候选先行语

进行分类, 从而做出全局最优的决策.

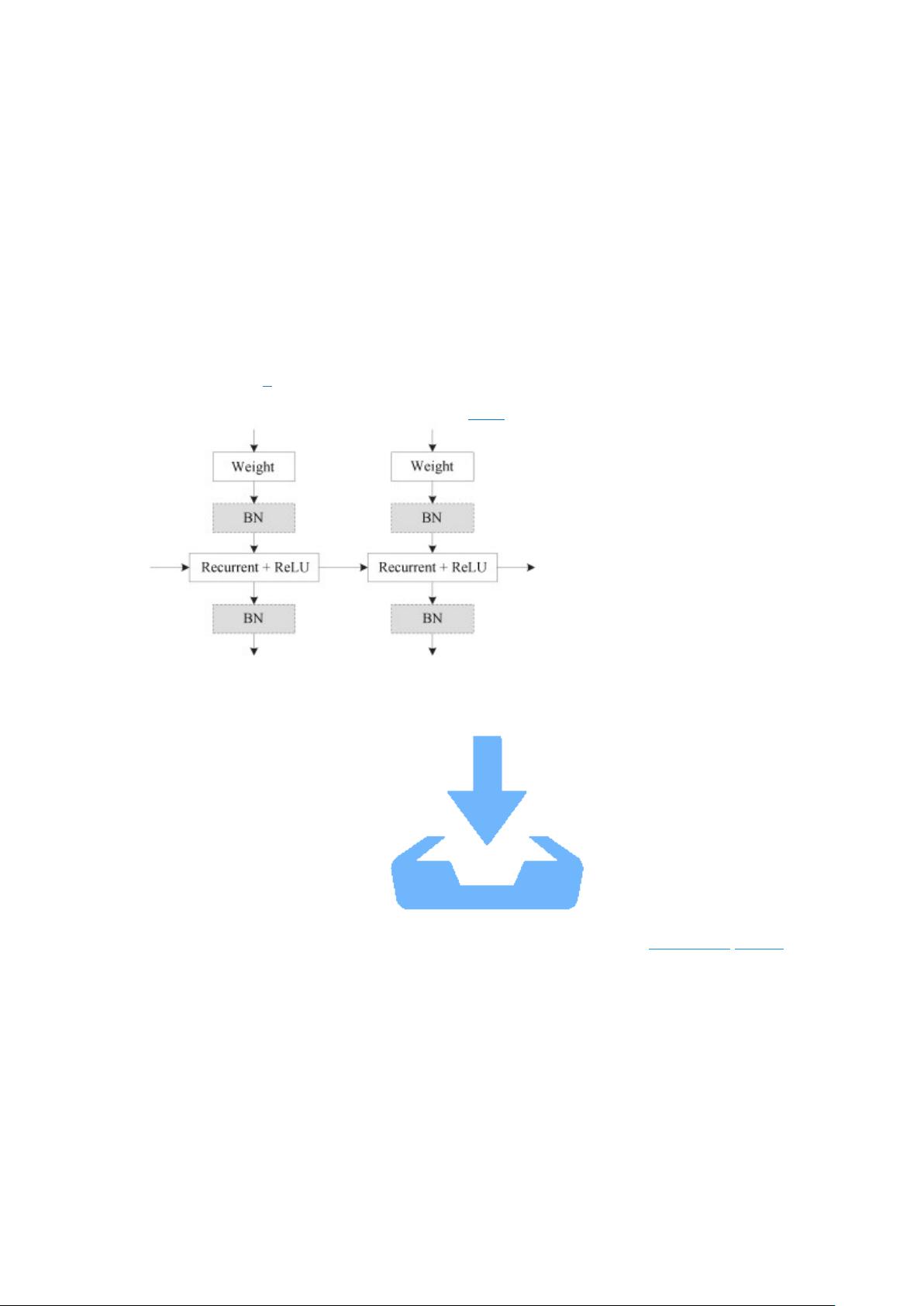

1.2 独立循环神经网络

独立循环神经网络(IndRNN)是由 Li 等提出的一种新型网络结构, 不仅可以解决传统

RNN 所存在的梯度消失和梯度爆炸问题, 还学习长期依赖关系; 此外, 借助 ReLU 等非饱

和激活函数, 训练之后 IndRNN 更具鲁棒性, 并且通过堆叠多层 IndRNN 还可以构建比现有

RNN 更深的网络

[22]

. 实验结果表明, 与传统的 CNN 和 LSTM 相比, 使用 IndRNN 可以在各

种任务中取得更好的结果. IndRNN 基本结构如图 2 所示.

图 2 IndRNN 结构图

Fig. 2 The structure diagram of IndRNN

下载: 全尺寸图片 幻灯片

其中 weight 和 Recurrent + ReLU 表示每一时间步对输入的处理步骤, ReLU 是激活函

数, 为了加速训练, 每层之后插入了批标准化(Batch normalization, BN), 通过堆叠这种基础

架构, 可以建立一个深度 IndRNN 网络. 其用公式可以表示为:

[Math Processing Error]ht=σ(Wxt+μ

⊙

ht−1+b)

(1)

其中循环权重[Math Processing Error]μμ 是一个向量, [Math Processing Error]

⊙

表示

Hadamard 积(对应元素相乘). 同一图层中的每个神经元都与其他神经元不相连, 通过叠加

剩余18页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3578

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功