一种基于改进AOD-Net的航拍图像去雾算法.docx

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

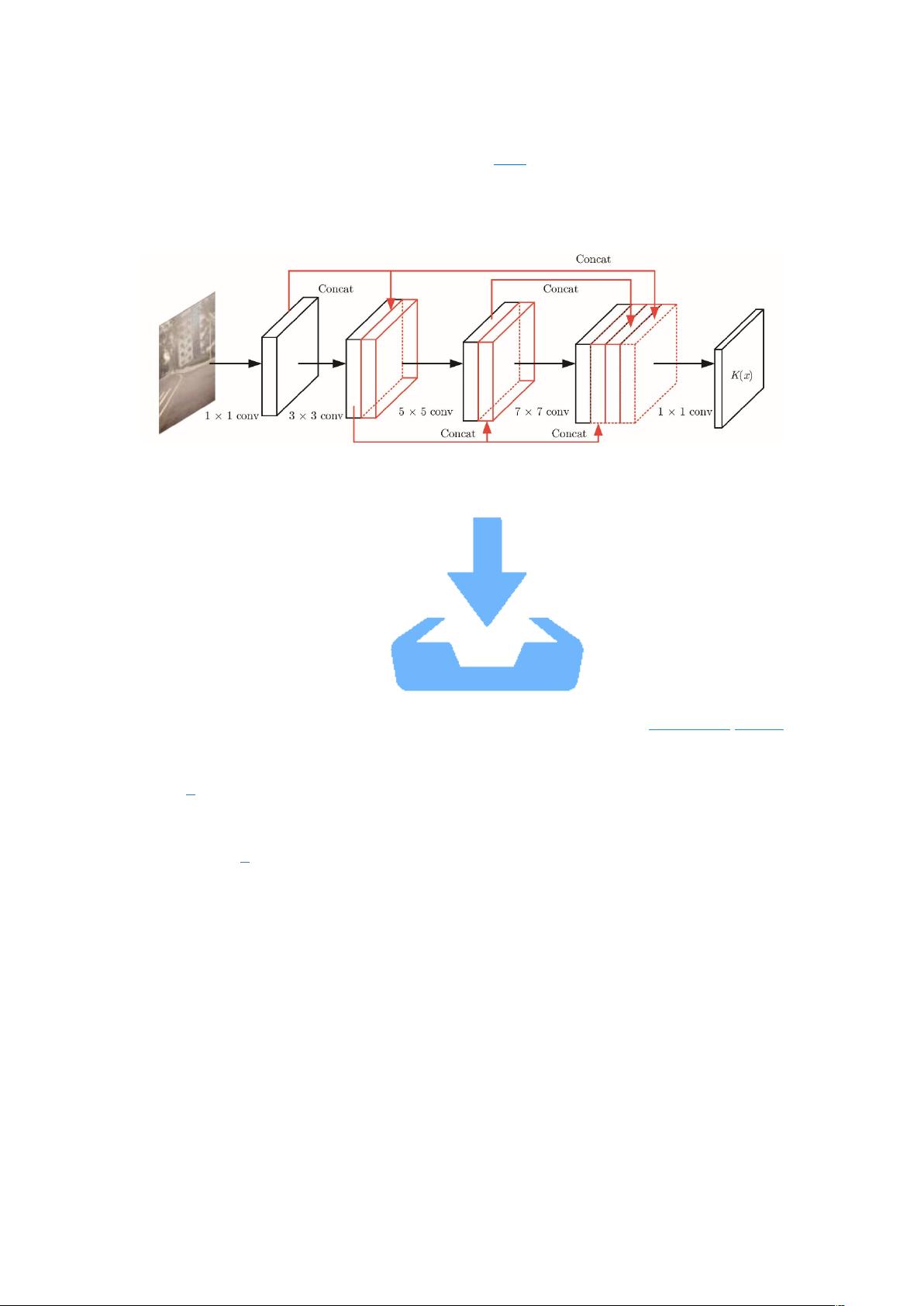

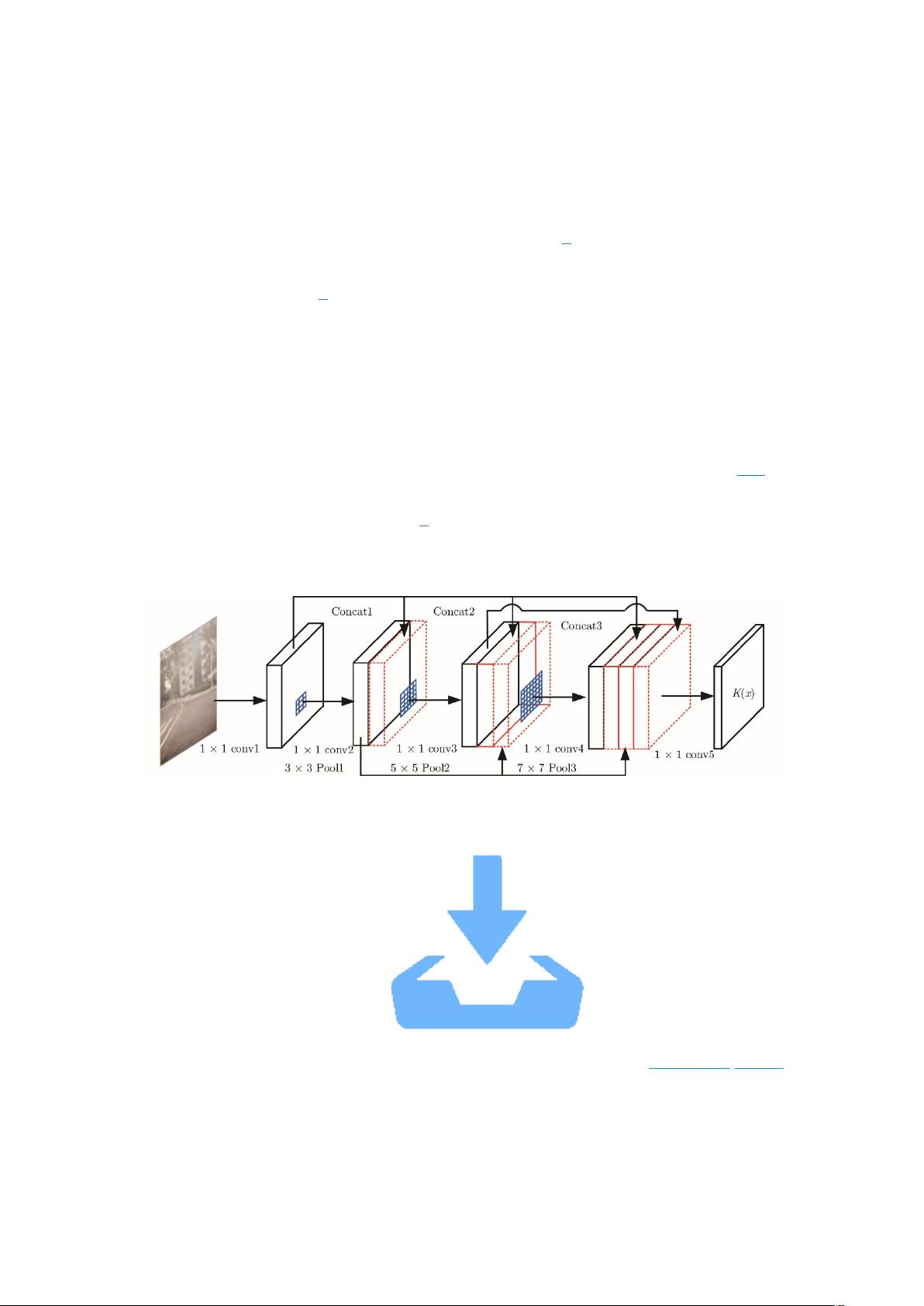

基于改进AOD-Net的航拍图像去雾算法 随着无人机航拍技术的日益成熟,无人机航拍技术逐渐被频繁地应用于复杂环境地图测绘、辅助驾驶、道路监控等领域。然而,由于航拍无人机与拍摄对象的距离通常较远,航拍图像更容易受雾霾环境的影响。在雾霾环境中,地面拍摄的普通图像中近景受到雾霾的影响较小,而航拍图像整体都会包含浓度较高的雾霾,这极大地影响了航拍图像的成像质量。 图像去雾算法可以分为基于传统数字图像处理与物理模型结合的方法和基于深度学习设计的去雾网络模型的方法。基于传统数字图像处理与物理模型结合的方法一般以大气散射物理模型为基础,在此基础上针对大气光值与透射矩阵设计求解算法以期获取准确的数值。 而基于深度学习设计的图像去雾模型能够被进一步细分为基于大气散射模型的间接参数求解型网络模型和直接图像生成型网络模型。其中,基于大气散射模型的间接参数求解型网络模型一般是通过对大气光值或者传输矩阵进行网络设计,通过构建高效的特征提取网络结构来准确获取二者的数值,然后进而通过大气散射物理模型生成无雾图像。 AOD-Net是我们选择的去雾算法,该方法简化了去雾模型,通过对大气散射模型进行变形使大气光值以及大气透射率合并为一个参数变量,并设计了一种简单高效的特征融合型卷积神经网络来有效获取该变量的值。虽然AOD-Net的网络结构非常轻巧,算法耗时极短,但是处理真实雾图的时候非常容易使图像的色调丢失并且损失较多色值。 因此,我们需要对AOD-Net进行改进,以提高去雾图像的质量和去雾速度。通过对AOD-Net的改进,我们可以实现高质量的去雾图像,满足复杂环境地图测绘、辅助驾驶、道路监控等领域的需求。 知识点总结: 1. 航拍图像去雾算法的重要性:航拍图像容易受雾霾环境的影响,影响了航拍图像的成像质量,因此需要对航拍图像进行去雾处理。 2. 基于传统数字图像处理与物理模型结合的方法:该方法一般以大气散射物理模型为基础,通过设计求解算法获取准确的数值。 3. 基于深度学习设计的图像去雾模型:该方法能够被进一步细分为基于大气散射模型的间接参数求解型网络模型和直接图像生成型网络模型。 4. AOD-Net的优缺点:AOD-Net的网络结构非常轻巧,算法耗时极短,但是处理真实雾图的时候非常容易使图像的色调丢失并且损失较多色值。 5. 改进AOD-Net的必要性:为了提高去雾图像的质量和去雾速度,我们需要对AOD-Net进行改进,以满足复杂环境地图测绘、辅助驾驶、道路监控等领域的需求。

剩余30页未读,继续阅读

- 粉丝: 4558

- 资源: 1万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- SoundManager.java

- 永磁同步电机参数调整与预测控制模块:时变工况下的参数不确定性与匹配策略,永磁同步电机参数调整与预测控制模块:时变工况下的参数不确定性与匹配策略,永磁同步电机参数不确定 参数变化 参数失配 参数摄动模块

- C++基础入门.pdf

- 软考-中级-网络工程师-知识点总结.docx

- ,《基于速度同步线性调频小波变换(VSLCT)的时频分析技术研究与应用》,速度同步线性调频小波变(VSLCT)VSLCT是当前线性变的扩展版本 它能有效地缓解拖尾效应,并能动态地响应条件变化提供所需

- ROS工程认知-ROS文件系统结构与编译系统详解

- 两极式三相光伏逆变并网仿真:基于MPPT算法与双环PI调节的LCL型三相逆变系统仿真模型,三相光伏并网系统仿真模型:研究Boost变换器MPPT算法与三相两电平LCL型逆变器的SVPWM调制及控制策略

- ROS环境中C++节点的构建与多节点协调运行机制探讨

- ROS通讯机制-话题通信详解及实例:构建发布/订阅模式实现异步通信

- 优化后的PFC2D颗粒离散元数值模拟试验合集:直剪、单轴与双轴压缩并行高效运行代码集,优化后PFC2D颗粒离散元数值模拟试验合集:高效单直剪与单双轴压缩并行运行代码集,该模型是一个PFC2D颗粒离散元

- 第五次课程服务组实验1:基于仿真的机器人及其应用环境

- 【business-jxd】

- 第6次课 ROS服务.docx

- Abaqus铁路轨道建模及车轨耦合动力响应分析:车轨地基相互作用与弹簧批量施加研究,Abaqus铁路轨道建模及车轨耦合动力响应分析:车轨地基相互作用与弹簧批量施加研究,Abaqus铁路轨道建模,车轨耦

- PCAN-Basic-Windows.zip

- 从0到1的网络安全专家之路 二进制安全和Web安全.zip

信息提交成功

信息提交成功