没有合适的资源?快使用搜索试试~ 我知道了~

基于自适应级联的注意力网络的超分辨率重建.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 69 浏览量

2023-02-23

16:51:59

上传

评论

收藏 2.61MB DOCX 举报

温馨提示

试读

21页

基于自适应级联的注意力网络的超分辨率重建.docx

资源推荐

资源详情

资源评论

单图像超分辨率(Single image super-resolution, SISR)

[1]

技术是一个经典的计算机视觉任

务, 旨在从一个低分辨率(Low-resolution, LR)图像生成对应的高分辨率(High-resolution, HR)

图像, 在医学成像、监控和遥感等领域有十分广泛的应用. SISR 是一个病态的逆问题, 要重

建逼真的 HR 图像非常困难, 因为一个 LR 图像可与多个 HR 图像对应, 需要假定的先验知

识, 正则化原 HR 图像解

[2]

.

近年来, 深度学习

[3]

技术显著改进了 SISR 性能, 并主导了当前 SISR 技术的研究. Dong

等

[4]

提出了第 1 个基于卷积神经网络的 SISR 算法称为超分辨率卷积神经网络(Super-

resolution convolutional neural network, SRCNN). SRCNN 只有 3 个卷积层, 感受野较小. 之

后的 SISR 方法的一个趋势是: 逐步加深网络, 从而获得更强的 LR-HR 映射能力, 同时拥有

更大的感受野, 能够融入更多的背景信息, 改进了 SISR 性能

[5]

. 然而加深网络也会带来一些

问题: 更大的网络(更深或更宽), 会有更多的参数, 需要更大的内存和更强的计算力, 这阻

碍了在资源受限的设备, 如移动设备上的实际应用. 当前已有一些引人注意的基于轻量级网

络的 SISR 方法被提出. Kim 等

[6]

提出的深度递归卷积网络(Deeply-recursive convolutional

network, DRCN)方法, 使用深度递归的方法, 在卷积层之间共享参数, 在加深网络的同时,

尽可能不增加网络参数量. Tai 等

[7]

提出的深度递归残差网络 (Deep recursive residual

network, DRRN), 也使用了深度递归的方法. 与 DRCN 的区别在于 DRRN 在残差块之间共

享参数, 不仅显著地减少了参数量, 而且性能也显著更好. Tai 等

[8]

也提出了深度持续记忆网

络(Deep persistent memory network, MemNet)方法, 使用记忆模块, 并多次递归, 既能控制参

数量, 也能更好地利用多层特征信息. Ahn 等

[9]

提出的级联残差网络(Cascading residual

network, CARN)方法, 使用级联残差的形式, 重用不同层次的信息. Li 等

[5]

提出的轻量级超

分辨率反馈网络 (Lightweight super-resolution feedback network, SRFBN-S)方法, 使用循环神

经网络结构, 共享隐藏层的参数, 并多次利用各个隐藏层的输出, 从而改进了网络性能.

本文提出了一个新的轻量级 SISR 模型, 称为自适应级联的注意力网络(Adaptive

cascading attention network, ACAN). 与当前类似的尖端 SISR 方法相比, ACAN 有更好的性

能和参数量平衡. 的主要贡献包括: 1)提出了自适应级联的残差(Adaptive cascading residual,

ACR) 连接. 残差块之间的连接权重, 是在训练中学习的, 能够自适应结合不同层次的特征

信息, 以利于特征重用. 2)提出了局部像素级注意力(Local pixel-wise attention, LPA)模块. 其

对输入特征的每一个特征通道的空间位置赋予不同的权重, 以关注更重要的特征信息, 更好

地重建高频信息. 3)提出了多尺度全局自适应重建(Multi-scale global adaptive reconstruction,

MGAR)模块, 不同尺寸的卷积核处理不同层次的特征信息, 并自适应地组合处理结果, 以

产生更好的重建图像.

1. 相关工作

1.1 注意力机制

注意力机制在计算机视觉领域中已经引起了越来越多的关注

[10-12]

. 在图像分类问题中,

Wang 等

[11]

设计了软掩模支路, 同时探索特征在空间维度和通道维度上的关系. Hu 等

[12]

提出

了轻量级的挤压和激励(Squeeze-and-excitation, SE)模块, 在网络训练过程中探索特征通道之

间的内在联系. 在图像理解问题中, Li 等

[13]

提出了引导的注意推理网络, 网络预测结果能够

聚焦于感兴趣的区域. Liu 等

[14]

首次将注意力机制引入到 SISR 中, 提出了全局的注意力产生

网络, 能够定位输出特征的高频信息, 以改进 SISR 性能. Zhang 等

[15]

提出的残差通道注意力

网络 方法, 使用通道注意力机制, 能够选择携带信息丰富的特征通道. 本文主要受 Wang

等

[11]

和 Liu 等

[14]

的启发, 提出了局部像素级注意力模块. 在像素级别上定位高频信息丰富的

区域, 以更好地利用特征.

1.2 上采样层

上采样层是 SISR 重建中很重要的一个组成部分. 早期基于深度学习的 SISR 方法

[4, 8, 16]

, 一般先将 LR 图像, 用双三次插值到目标 HR 图像的尺寸, 再输入到网络模型. 这有

助于减轻学习难度, 但大大增加了网络的计算量与参数量

[17]

. 目前常用的重建方法是直接输

入原始的 LR 图像

[18-19]

, 再将网络模型的输出上采样得到重建的 HR 图像. 文献[18]和文献

[20]使用转置的卷积作为上采样层, 文献[15]和文献[19]使用亚像素卷积进行上采样. 这些单

尺度上采样能缓解预上采样的弊端, 但是, 其同样存在难以充分利用网络模型产生的丰富的

特征信息的问题. 本文提出了一种多尺度全局自适应的上采样方式: 针对不同的层次特征使

用不同尺寸的卷积核, 多尺度地利用网络模型产生的特征信息, 并能够根据自适应参数, 自

适应选择不同层次特征的结合方式, 以改进超分辨率的重建效果.

2. 方法

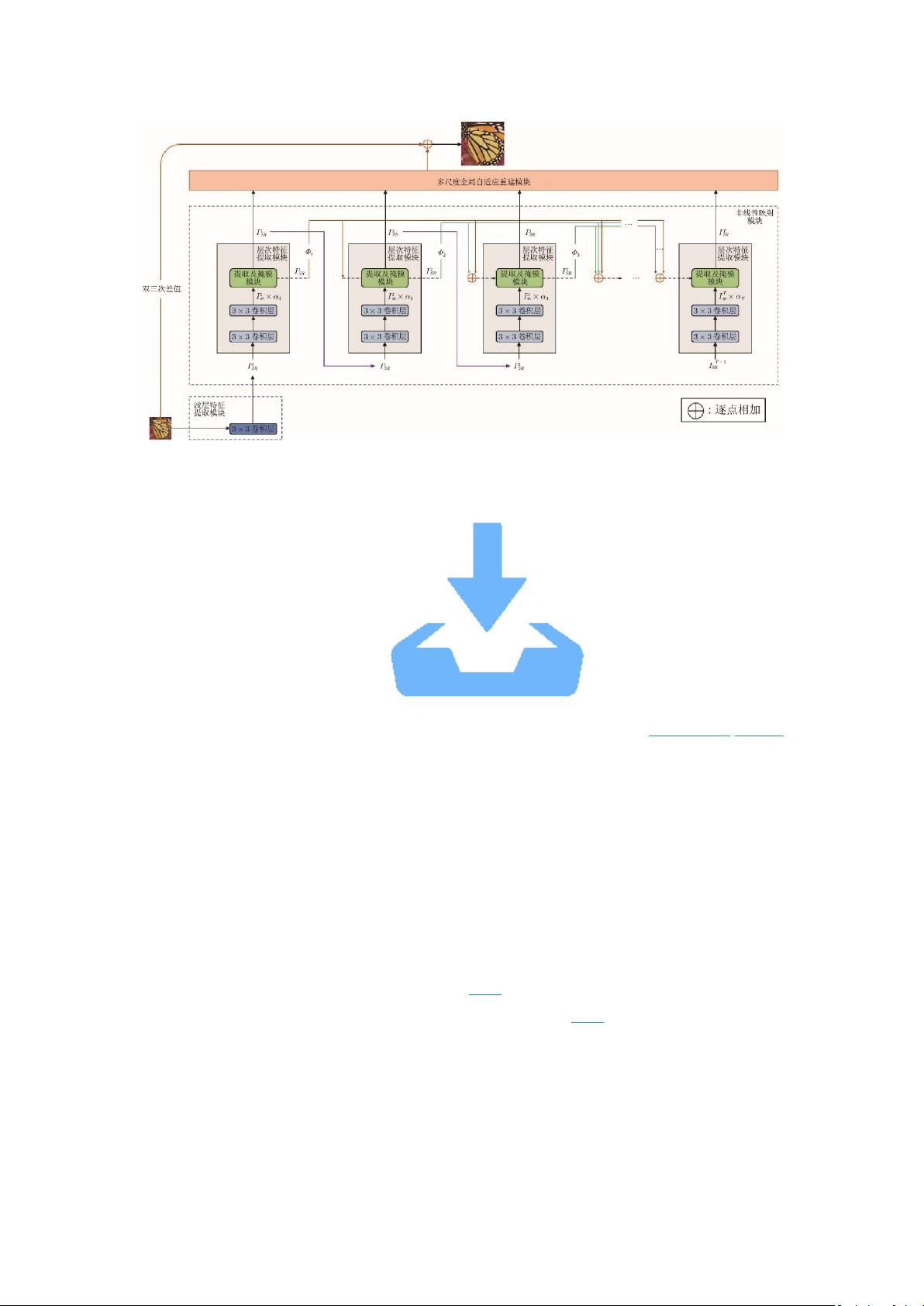

本文 ACAN 网络模型主要包括: 浅层特征提取模块(Shallow features extract block,

SFEB)、非线性映射模块(Non-linear mapping block, NLMB)、多尺度全局自适应重建模块和

全局残差连接, 如图 1 所示. SFEB 是一个 3 × 3 卷积层, 提取输入 LR 图像的浅层特征, 并

将提取的特征输入到 NLMB 模块. 本文使用的所有大小的卷积层的尾部都伴随着激活层,

并且使用 PReLU 作为所有激活层的激活函数, 后文不再详细说明. 受 SRFBN

[5]

的启发, 本

文在 NLMB 中采用类似结构, 并在层次特征提取模块(Hierarchical features extract block,

HFEB)之间参数共享, 以减少参数量. NLMB 是 HFEB 的多次递归, 在 SFEB 的基础上进一

步进行深层特征的提取. HFEB 由 2 个 3 × 3 的卷积层和一个提取及掩模(Extract-and-mask,

EM)模块组成. 由于本文设计的 ACR 连接, 第 1 个 HFEB 的输入仅为 SFEB 的输出, 之后

递归的每一次, HFEB 的输入都包含两个部分: 1)上一层 HFEB 的输出; 2)前面所有 HFEB 的

输出与对应的自适应参数相乘后的和, 并直接输入到当前 HFEB 的 EM 模块中. MGAR 模

块则接收 NLMB 所有输出重建残差图像; 最后, 全局残差连接产生双三次插值的 LR 图像,

与残差图像相加之后即为重建的 HR 图像. 由于文献[21]已经指出 L2 函数作为损失函数所

谓缺点, 所以本文使用 L1 损失函数, 如下式所示:

图 1 自适应级联的注意力网络架构(ACAN)

Fig. 1 Adaptive cascading attention network architecture (ACAN)

下载: 全尺寸图片 幻灯片

$$ Loss(\hat{I}, I) = {\begin{Vmatrix} \hat{I} - I \end{Vmatrix}}_1 $$

(1)

式中, $ \hat{I} $和$ I $分别代表模型产生的 HR 图像和真实的 HR 图像.

第 2.1 ~ 2.3 节详细介绍 HFEB、EM 模块和 MGAR 模块.

2.1 层次特征提取模块(HFEB)

HFEB 的重要特征是: 每个 HFEB 的输入来源不同. 由于信息在流动过程中会不断损

耗, 因此希望使用跳跃连接解决这个问题. 为了有效地进行特征重用, 同时考虑参数量的问

题, 最终搭建了自适应级联残差(ACR)连接, 如图 1 所示. ACR 连接结构上类似于级联连接,

但本质上仍为残差连接, 并通过自适应参数控制信息流动. 由图 1 可知, 由于 ACR 连接,

除第 1 个 HFEB 的输入只接收 SFEB 的输出外, 之后的每个 HFEB 的输入都包括两个部分:

1) 上一层 HFEB 的输出; 2) 前面所有 HFEB 的输出与对应的自适应参数相乘后的和.

在第$ t $个 HFEB 中, 第 1 部分输入(即第$ t-1 $个 HFEB 的输出), 先经过两个 3 × 3 的

卷积层, 然后将输出乘上对应的自适应参数, 并与第 2 部分输入相加, 再输入到其中的 EM

模块进行高频信息的定位与提取. 第$ t $个 HFEB 的表达式如下:

$$ I_{SR}^{t} = f_{HFEB}(I_{inter\_in}^{t},I_{SR}^{t-1}) $$

(2)

式中, $ f_{HFEB} $表示 HFEB, $ I_{SR}^{t-1} $和$ I_{inter\_in}^{t} $分别为第$ t $个

HFEB 的第 1 部分输入和第 2 部分输入, $ I_{SR}^{t} $为第$ t $个 HFEB 的输出.

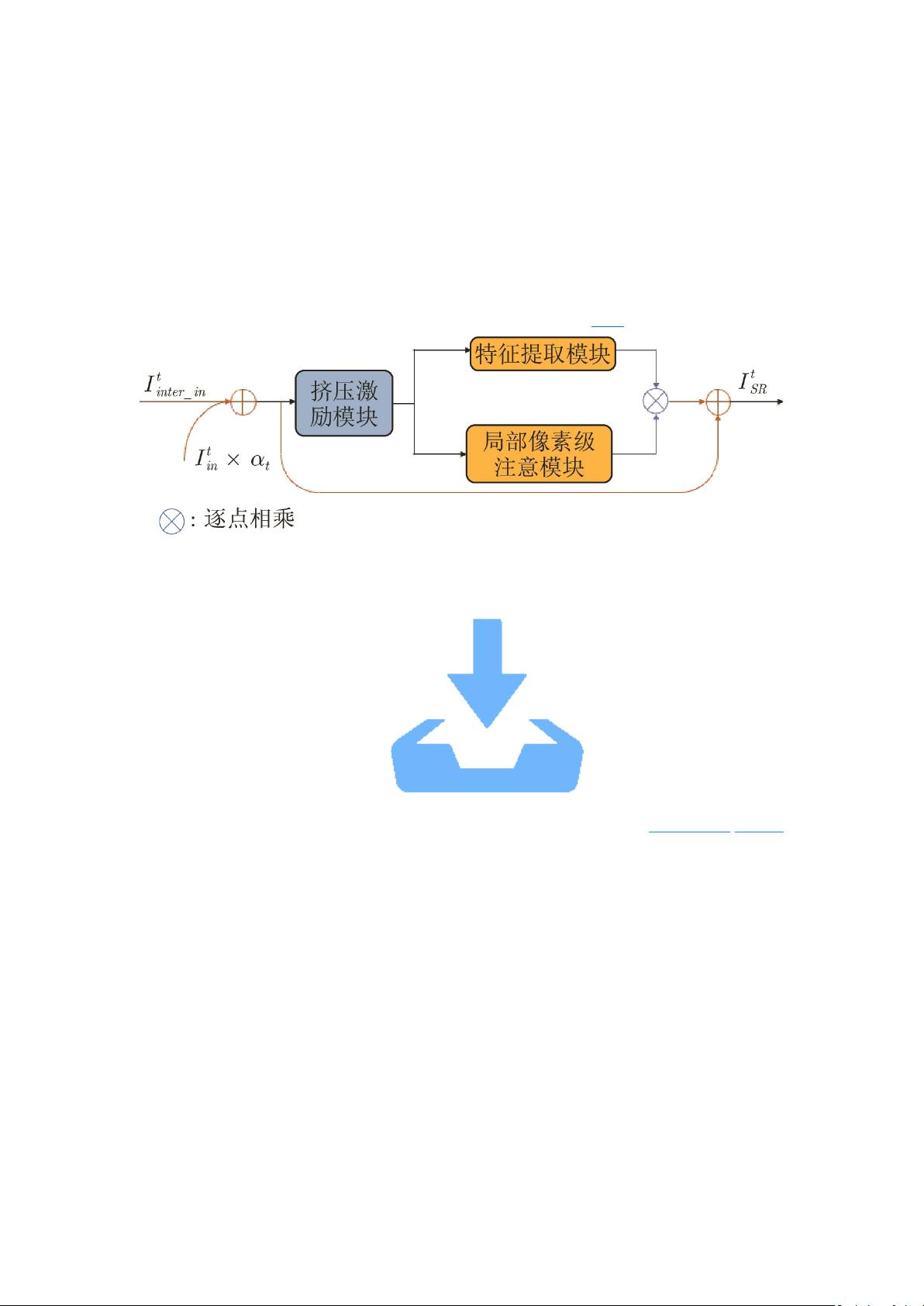

2.2 提取及掩模(EM)模块

在每个 HFEB 中, 使用 EM 模块选择和提取高频特征信息. EM 模块主要由特征预处理

单元、特征提取模块和局部像素级注意力模块 3 个部分组成, 如图 2 所示.

图 2 提取及掩膜模块

Fig. 2 The extract and mask block

下载: 全尺寸图片 幻灯片

如前所述, 第$ t $个 EM 模块的输入来自两部分: 1)当前 HFEB 中, 经过两个 3 × 3 卷积

层的输出$ I_{in}^{t} $, 乘上对应的自适应参数$ \alpha_{t} $后的积; 2)前面所有 HFEB 的

输出与对应的自适应参数相乘后的和$ I_{inter\_in}^{t} $. 二者之和为当前 EM 模块的输入.

EM 模块的输入可表示如下:

$$ I_{inter\_in}^{t} = \sum\limits_{i = 1}^{t-1}\Phi_{i}^{t-i} \times I_{SR}^{i} $$

(3)

$$ I_{sum\_in}^t = I_{inter\_in}^{t} + \alpha_{t} \times I_{in}^{t} $$

(4)

式中, $ I_{sum\_in}^{t} $是第$ t $个 EM 模块最终的输入, $ I_{SR}^{i} $是第$ i $个

EM 模块输出, 同时也是第$ i $个 HFEB 的输出, $ \Phi_{i}^{t-i} $是第$ i $个 HFEB 输出输

入到第$ t $个 EM 模块时, 对应的自适应参数.

为了缓解梯度消失的问题, 在 EM 模块外增加了局部残差连接. 第$ t $个 HFEB 中 EM

模块的输出可表示如下:

剩余20页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3563

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功