没有合适的资源?快使用搜索试试~ 我知道了~

改进特征引导消歧的偏标记学习算法.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 137 浏览量

2022-12-15

14:16:17

上传

评论

收藏 1.1MB DOCX 举报

温馨提示

试读

16页

改进特征引导消歧的偏标记学习算法.docx

资源推荐

资源详情

资源评论

监督学习是机器学习中被研究的最为广泛的一种学习框架

[1]

,在这种学习框架下,每

个学习示例都有明确的标记信息,是使训练得到的模型具有强泛化性能的前提。而真实世

界的情景更为复杂,由于标记成本高、真实标记难以获得等原因,常常无法得到明确的标

记信息。如何在弱监督条件下进行学习,已经成为机器学习领域的热门研究问题

[2]

。

偏标记学习属于弱监督学习的一种,属于不准确监督,即给定的标签不总是真

[3-5]

。在

偏标记学习领域,每个训练示例与一系列的候选标签集相关联,其中只有一个标签是真实

的标签,其余的标签为伪标签

[6-7]

。偏标记学习算法是通过有干扰的数据训练来习得分类模

型,在现实生活中许多场景都存在类似情况,所以该领域具有很高的研究价值

[8]

。如在互

联网搜索引擎中,对一个关键词进行搜索时,会出现许多相关程度不高的图片,这是由于

该图片的标签不止一个

[9-10]

,这种场景就适于用偏标记学习算法来解决

[11]

,通过对带有干扰

的标签进行学习,最终得到更高的识别精度,减少了在不考虑伪标签干扰情况下所带来的

损失。偏标记学习是对传统分类学习的一种延伸扩展,具有非常广阔的发展空间和应用前

景,在图像分类、医疗诊断、文本挖掘、医学图像处理等领域也有相应的应用。

1. 理论分析与设计

1.1 特征引导消歧

文献[12]提出了一种基于特征感知消歧的偏标记学习算法,利用特征空间的潜在信

息,将偏标记学习问题转换成多输出回归问题。该算法分为 2 个阶段:第一阶段是消歧,

通过对样本在特征空间的流形结构进行学习得到结构信息,并利用结构信息在候选标记集

合上生成归一化的标记置信度信息;第二阶段是预测模型的生成归纳,利用第一阶段的信

息来学习一个基于正则化的多输出回归模型,最终得到回归模型在多个标记中输出值最大

的一个所对应的标记。

1.2 改进特征引导消歧方法

以往的消歧策略是把学习的重心放在标签信息空间

[13]

,忽视了特征信息与标签之间的

联系,未对已有的信息进行充分利用。作为一种将样本特征之间的相关性充分利用和结合

的方法,改进特征引导消歧方法弥补了特征信息欠拟合的弱点,使偏标记学习过程中消歧

的效果得到了改善

[14-15]

。但是在衡量样本相关度的过程中,仅采用一种最小二乘法来计算

权重矩阵,使相关度的计算过程存在单一性。因此,将示例的相似性进行综合考量,对特

征引导消歧方法做出改进,并采用集成学习的方法对分类模型的生成进行优化,提出了改

进特征引导消歧的集成学习偏标记算法,简称 PL-FGD。

1.2.1 构建特征相似度矩阵

每个样本 x

i

都由对应的特征空间 y 和拥有多个标签集合的空间 l 组成,偏标记学习系

统的目标是获得一个输出正确标签的多分类器 h。消歧思想第一步是构造一个样本关联度

矩阵,获得特征空间的结构信息,为了得到不同示例特征之间的关联度,首先要生成一个

置信度矩阵,其能够反映出第 j 个样本和第 i 个样本的相似度。对于偏标记样本,假设当

样本间的特征相似度越高,样本间具有相同标签的可能性就越高。基于此假设,用特征权

重矩阵来定义示例样本之间的特征关联性。样本特征空间 X{x

1

, x

2

, …, x

m

}中的每个样本 x

i

都有一个基于 K

NN

构建的 k 近邻样本矩阵 N

i

,用于存放第 i 个样本的紧邻样本序号,近邻

样本数由参数 k 控制,通过计算最小二乘式得到样本之间的权重矩阵,权重矩阵的计算可

表示为

minw∑j=1m‖xi−∑(xi,xj∈X)wijxj‖,

(1)

为了保证矩阵 W 是严格的对称矩阵, 需满足

。W=W+WT。

(2)

x 从样本的特征空间分布中获得,权重矩阵中的 w

ij

表示示例 x

i

与示例 x

j

之间的相似

度,该值越大,则对应的 2 个样本之间相似度越高。与已有的消歧算法不同的是,考虑到

权重矩阵在构建不同样本的特征关联过程中尤为重要,为了使权重矩阵在算法中具有更好

的表现,用加权最小二乘法对权重矩阵进行优化处理。首先将通过加权最小二乘法得到的

权重矩阵视为迭代初值,回代计算后求出初始残差,将初始残差标准化;然后将标准残差

代入权重初值进行迭代计算,返回以上步骤,并依次进行迭代;当相邻两步的回归系数差

值的绝对值满足临界条件时,迭代结束。

1.2.2 构建标签相似度矩阵

偏标记学习领域存在标签信息利用不充分的问题

[16]

,而在提出的假设中,不同示例标

签之间可以利用的信息也对解决该领域问题起重要作用。标签作为对样本特征的一种描述

和定义,也反映了样本之间的联系,利用标签信息进行相似度计算能够一定程度缓解数据

稀疏性问题。考虑到标签信息之间也存在与样本特征之间相似的关联性,用一个相似度矩

阵度量候选标签集之间的相似度,以此达到在消歧阶段对标签信息充分利用的目的。为了

获得可以将标签个体联系起来的相似度矩阵,用皮尔逊相关系数度量标签集合间的相关

度,相关系数越大,表示二者间的关联性越强,反之则关联性越弱。

2 个样本标签间的皮尔逊相关系数定义为 2 个变量之间的协方差与标准差的商,可表

示为

ρX,Y=cov(X,Y)σXσY=E[(X−μX)(Y−μY)]σXσY,

(3)

通过估算样本的协方差和标准差得到皮尔逊相关系数,可表示为

。sim(L,Lk)=∑i=1s(Li−L¯)(Lki−L¯k)∑i=1s(Li−L¯)2×∑i=1s(Lki−L¯k)2。

(4)

皮尔逊相关系数可用于计算 2 个向量之间的相对距离,反映标签之间的线性相关度。

通过计算每个标签与近邻样本标签之间的皮尔逊相关系数,可得到一个矩阵,存放能够代

标标签相似度的数值,取值范围为(-1,1),当 2 个样本之间呈正相关时,数值为正;否则

为负。L 表示某样本标签,L

k

表示某样本的近邻样本标签,L

i

表示该样本标签中的第 i 个标

签,L

ki

表示该样本的第 k 个近邻样本标签集中的第 i 个标签,L 表示该样本的平均标签

数,L

k

表示第 k 个近邻样本的平均标签数。根据式(5)对相关系数进行标准化处理,使其最

终结果在区间(0,1),

。sim(L,Lk)=sim(n,j)−min1⩽n⩽m1⩽j⩽k{sim(n,j)}max1⩽n⩽m1⩽j⩽k{sim(n,j)}−min1⩽n⩽m1⩽j⩽k{sim(n,j)}。

(5)

通过特征信息和标签信息得到的样本之间的相似度可作为消歧的重要参考依据,将样

本之间的相似度定义为 S,样本之间的综合相似度系数可表示为

S=αminw∑j=1m‖xi−∑(xi,xj∈X)wijxj‖+(1−α)sim(L,Lk),

(6)

其中,α 为模型参数,用于调节特征权重和标签相似度之间的比例,使样本之间的相

似程度更符合真实样本集的情况。用显信度矩阵得到的最终计算结果为 F= [f

n, j

]

m×k

, 每行

F

n

=[f

n, 1

, f

n, 2

, …, f

n, k

]表示各个标记作为示例 x

i

的真实标记的置信度,可表示为

。minF,W∑j=1mα‖xi−∑(xi,xj∈X)wijxj‖∑j=1,j≠im‖Fi−Fj‖+(1−α)sim(L,LK)∑j=1,j≠im‖Fi−Fj‖。

(7)

基于同类样本之间的相似度越高,置信度的差异应当越小这一原则,可根据置信度矩

阵得到最终消歧后的训练数据集 D^={(Xi,yi)∣1⩽i⩽m},y

i

为消歧后示例 x

i

的标记。

1.2.3 生成预测模型

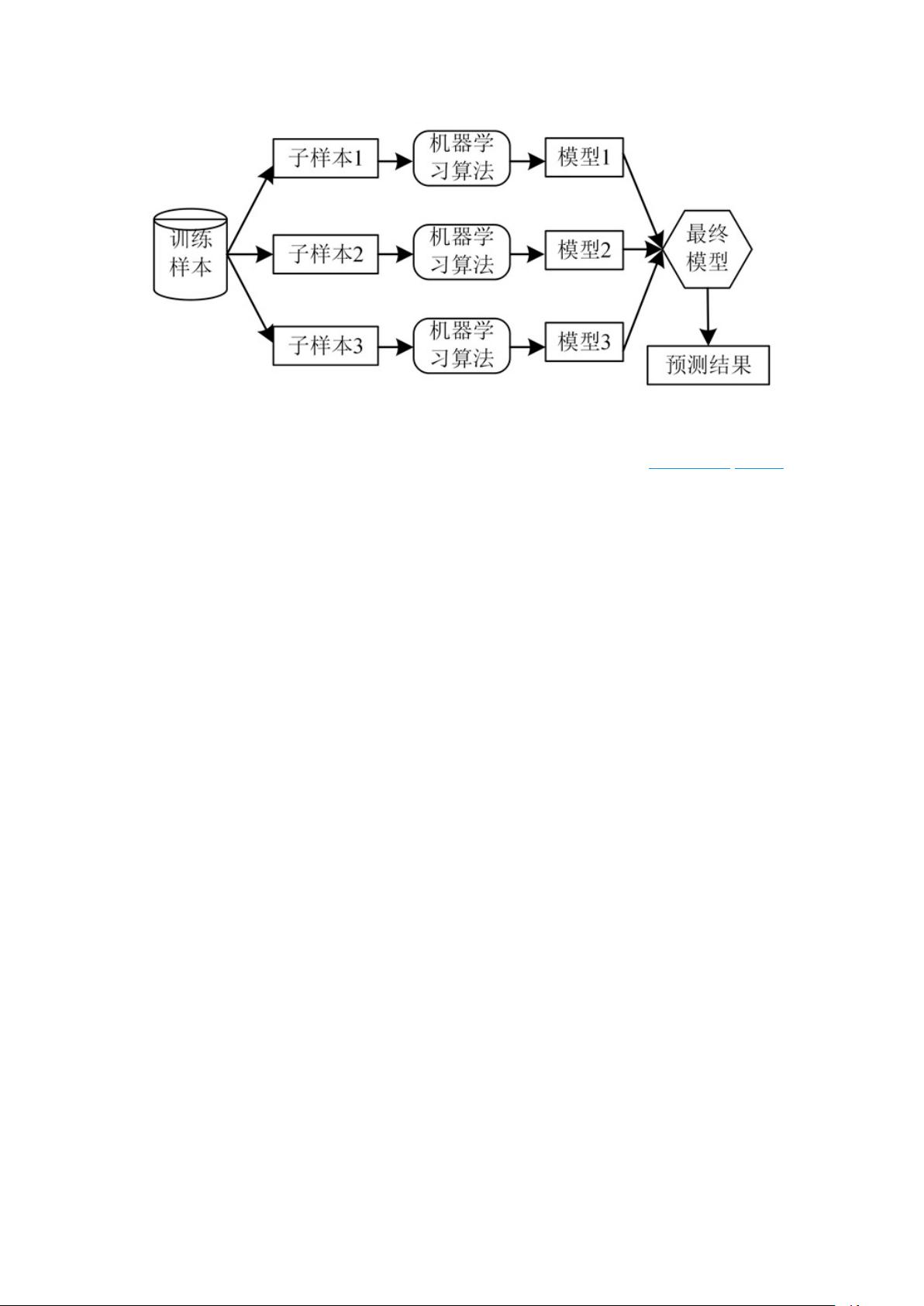

为了提高模型的分类精度,PL-FGD 在学习框架中利用了集成学习中的 bagging 策

略,使用 CART 树

[17]

来实现分类决策树的构建。

集成学习是由多个分类器组成的学习系统,通过将多个学习器进行结合,常可获得比

单一学习器显著优越的泛化性能,从而得到更好的结果

[18]

。一般集成学习方法可分为 2

种,一种是个体学习器间存在着强依赖的 Adaboost 算法,另一种是单个学习器之间相互独

立,同时可并行运算,如随机森林算法

[19]

。PL-FGD 采用的集成方法是多个学习器的结合

策略,学习器的结合具有如下好处:首先,多个学习器的结合比单个学习器有更好的泛化

性能

[20]

,可通过多个学习器共同发挥作用来解决过拟合的问题,且参数很少,对于回归和

分类都适用;其次,通过多次运行可降低陷入局部极小点的风险,也无需事先做特征选

择,每次只随机选取几个特征来训练;最后,通过学习器的结合,样本相应的假设空间有

所扩大,实现了对数据的最大化利用,有效性更高。图 1 为所建立的分类模型的流程示意

图。

图 1 分类模型的流程示意图

下载: 全尺寸图片 幻灯片

根据 A 是否在某个结点处被划分为 2 个样本集合 D

1

和 D

2

,在特征 A 的条件下,集合

D 的基尼指数被定义为

。Gini(D,A)=|D1||D|Gini(D1)+|D2||D|Gini(D2) 。

(8)

如何确定叶子节点的预测值是构建 cart 树的关键,将决策树视为一个分段函数,分段

的依据是某个属性的基尼系数值,在节点处,根据每个叶子结点确定一个分段区间,叶子

节点的输出即为函数在该节点的值。

1.3 本算法流程

PL-FGD 算法被分为 2 个阶段,第一阶段是用改进的特征引导方法对偏标记数据进行

消歧处理;第二阶段是采用集成学习中的 bagging 策略构建分类模型,并使用 CART 决策

树作为单个分类器对划分后的数据子集进行训练。详细的过程如下:在消歧阶段,首先对

不同类别的示例采用最小二乘的方法进行权重计算;再采用更适用于多维空间的皮尔逊相

关系数计算标签之间的相似度,解决示例之间相似度计算中的单一性问题;最终得到迭代

后的置信度矩阵,实现对不同类别示例消歧的目的,并得到用于分类模型的输入数据。在

分类阶段,采用集成学习的方法预测真实标记,同时将 Cart 树作为弱分类器构成单个决策

树,对划分好的数据进行训练,将其与 bagging 算法结合。在 UCI 数据集和偏标记数据集

上的实验结果表明,本算法表现出更高的分类准确率。算法流程如算法 1 所示。

算法 1 PL-FGD 算法流程

输入:

D:输入样本训练集{x

i

, S

i

| 1≤i≤ m}

k: 近邻样本个数

λ, μ: 函数的模型参数

剩余15页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3895

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功