基于多维度和多模态信息的视频描述方法.docx

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

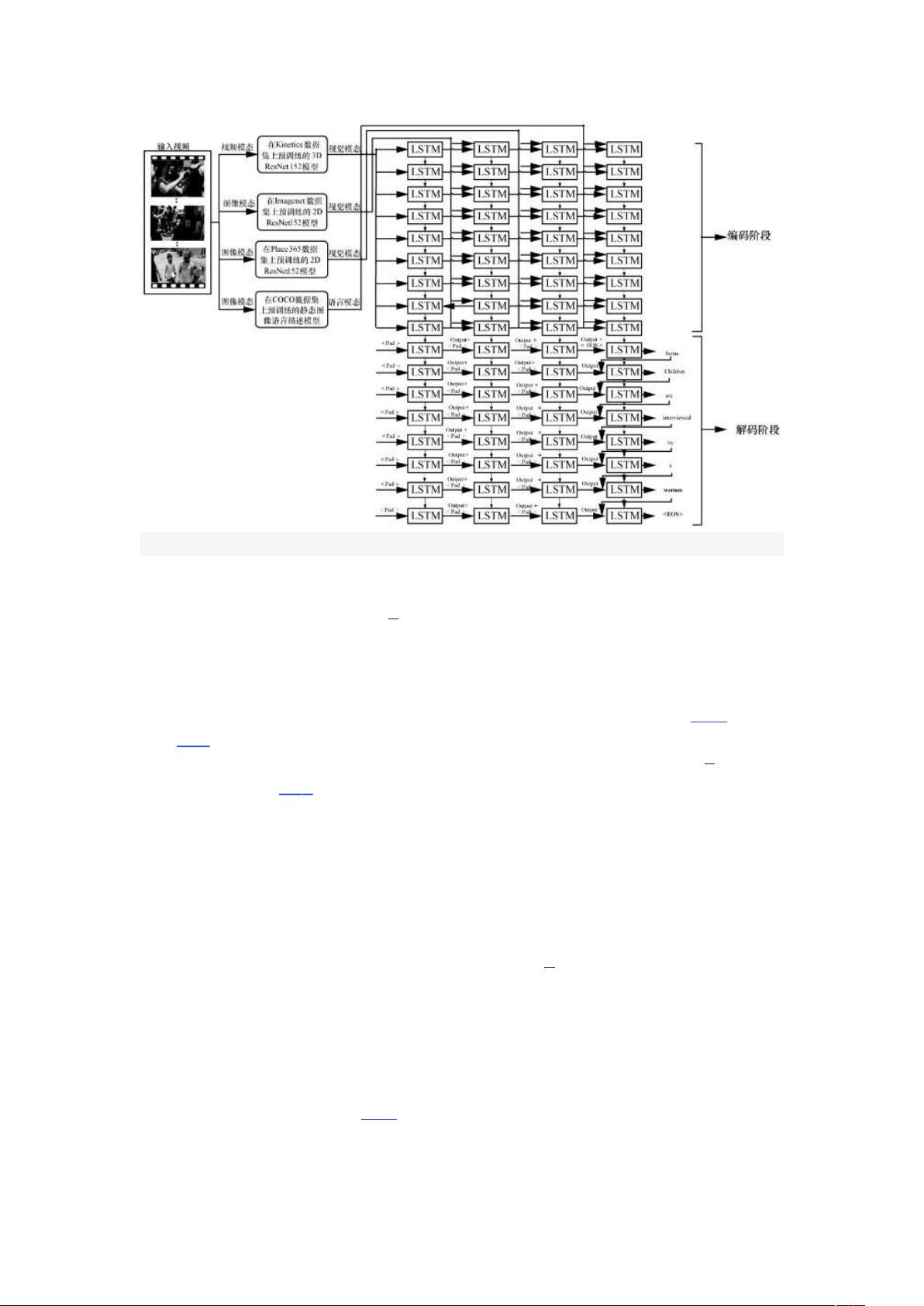

视频描述技术是当前人工智能领域的热点,它涉及到计算机视觉和自然语言处理两个关键领域,旨在将视频内容转换成人类可理解的自然语言描述。随着大数据、计算能力及机器学习模型的不断进步,视频描述的研究得到了广泛关注,尤其在视频检索、视频标注、行为识别、人机交互和视频内容讲解等方面具有广泛应用。 传统视频描述方法主要基于模板,如SVO和SOVP结构,这些方法虽然能生成语法正确的描述,但受限于预定义的模板和视觉类别,导致生成的句子形式和内容僵化,缺乏灵活性和多样性。相比之下,基于深度学习的方法利用循环神经网络(RNN),特别是长短期记忆网络(LSTM),通过CNN提取图像特征,然后进行编码和解码,生成语言描述。然而,这种方法的视觉特征单一,描述不丰富,且未充分考虑视频的时空动态和场景上下文。 为解决这些问题,一些研究引入了递归编码器和注意力机制,结合预训练的深度卷积神经网络(CNN)来提取关键帧的视觉特征,随后输入LSTM进行编码。另一些研究则探索了多模态融合,结合音频特征来增强描述的丰富性。尽管这些方法有所进步,但它们往往忽视了视频中的静态、动态和语义信息,以及物体、背景和时空维度的关系。 针对上述挑战,本文提出了一种改进的视频描述方法,其核心贡献包括: 1) **多源域预训练模型**:利用多个预训练模型从视频的不同维度(如物体、背景和时空动态)提取静态、动态和语义信息,以提高语言描述的准确性。 2) **多模态信息融合**:对视频的关键帧进行语言描述,并整合视觉模态和语言模态的信息,以增加模型生成语言的多样性。 在实现过程中,本文的方法分为编码和解码两个阶段。编码阶段中,首先对输入视频进行预处理,提取图像模态和视频模态的特征。接着,2D CNN用于处理静态图像,3D CNN用于处理动态视频片段。为了充分利用关键帧的语义信息,借鉴现有方法提取关键帧的语义,并通过多层LSTM进行编码。解码阶段,利用LSTM对编码后的信息进行解码,生成视频的自然语言描述。 实验在微软视频描述(MSVD)和微软视频到文本研究(MSR-VTT)数据集上进行,通过多种评估指标验证了该方法的有效性,显示出了较好的性能。 本文的方法致力于克服基于深度学习的视频描述方法的局限性,通过多维度和多模态信息的融合,提高了视频描述的准确性和多样性,为视频理解与自然语言生成的研究提供了新的视角和思路。

剩余13页未读,继续阅读

2301_803610952023-10-24支持这个资源,内容详细,主要是能解决当下的问题,感谢大佬分享~

2301_803610952023-10-24支持这个资源,内容详细,主要是能解决当下的问题,感谢大佬分享~

- 粉丝: 4513

- 资源: 1万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- springboot项目高校宣讲会管理系统.zip

- springboot项目工作量统计系统.zip

- springboot项目果蔬作物疾病防治系统.zip

- springboot项目共享书角图书借还管理系统.zip

- springboot项目航班进出港管理系统.zip

- springboot项目滑雪场管理系统.zip

- springboot项目基于Hadoop的物品租赁系统的设计与实现 a.zip

- springboot项目基于Java Web的考编论坛网站的设计与实现.zip

- springboot项目基于html+css的在线英语阅读分级平台.zip

- springboot项目基于javaweb的城乡居民基本医疗信息管理系统.zip

- springboot项目基于java的物资综合管理系统的设计与实现.zip

- springboot项目基于javaweb的宠物猫认养系统.zip

- springboot项目基于java的美食信息推荐系统的设计与实现.zip

- springboot项目基于java敬老院管理系统_.zip

- springboot项目基于java的综合小区管理系统.zip

- springboot项目基于java国产动漫网站设计和实现.zip

信息提交成功

信息提交成功