没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

1 引言

深度学习

[1

]

作为一种训练深层神经网络的机器学习算法,被广泛应用于图像

[2

,3

,4

]

、语音

[5

,6

]

、自然语言处理

[7

,8

]

、大数据特征提取

[9

,10

]

等方面。生成式网络是深度

学习的重要组成部分,在无监督情况下可以获取数据的高阶特性,主要包括深

度 置 信 网 络

[11

]

、 受 限 玻 尔 兹 曼 机

[12

]

、 自 编 码 器

[13

]

和 生 成 对 抗 网 络

(GAN,generative adversarial network)

[14

]

等。

GAN 不同于其他生成式模型,其避免了马尔可夫计算、变分下限和近似推

断的复杂性,大大提高了应用效率;GAN 通过对抗学习生成逼真样本,在图像

合成

[15

,16

,17

]

、修复

[18

,19

,20

]

、分类

[21

,22

,23

]

、转换

[24

,25

,26

]

等任务中表现出色。但是 GAN

在训练和优化过程中存在着一些问题

[27

,28

]

。例如,对抗训练过程中生成器与判别

器之间需要很好的平衡,如果生成器退化且判别器误判,会导致模式崩塌问题 ,

使生成的图像单一;梯度下降在非凸函数的情况下很难达到纳什均衡;当真实

样本分布和生成样本分布没有重叠或重叠可忽略时,延森 -香农(JS,Jensen-

Shannon)散度接近定值,容易出现梯度消失问题。

针对 GAN 存在的问题,研究者们提出了有效的改进方法

[29

,30

]

。Radford 等

[31

]

采用卷积和解卷积的方式代替全连接结构,并使用归一化提升训练的稳定性,

可以生成多样化图像,但是仍需要平衡训练生成器和判别器。Salimans 等

[32

]

提

出增加判别器中间层的输出作为优化目标之一,虽然不能保证达到均衡,但提

高了网络的稳定性。Arjovsky 等

[33

]

通过理论分析说明了 JS 散度判断 2 个无重

叠 或 重 叠 可 忽 略 分 布 的 功 能 受 限 问 题 。 因 此 , Wesserstein 生 成 对 抗 网 络

(WGAN,Wesserstein GAN)

[34

]

引入 Wesserstein 距离,在连续的约束下改进

损失函数,解决了梯度消失等训练不稳定问题,从而生成丰富多样的样本。为

了解决模式崩塌问题,Ghosh 等

[35

]

提出了包含多个生成器和一个判别器的多主

体、多样化生成对抗网络,在判定真假样本的同时找到制造假样本的生成器并

优 化 。 Mao 等

[36

]

提 出 了 最 小 二 乘 生 成 对 抗 网 络 ( LSGAN,least squares

GAN),使用最小二乘损失函数代替交叉熵损失,使图像分布尽可能地接近决

策边界,提高图像质量。Chen 等

[37

]

提出了一种基于感知损失函数的生成对抗网

络,使用密集块构建生成器,生成更自然、更真实的图像。 Tan 等

[38

]

提出了一种

提高图像质量的新策略,将损失函数的梯度从分类识别器反向传播到生成器,

同 时 反 馈 标 签 信 息 , 使 生 成 器 能 够 更 有 效 地 学 习 , 生 成 高 质 量 的 图 像 。

Kancharla 等

[39

]

提出了基于多尺度结构相似度指标的生成对抗网络,将结构相似

度作为 GAN 中鉴别器损失函数的约束,保证局部结构的完整性,提高生成样本

的视觉质量。

以上基于生成对抗网络的改进方法大致上可以分为 2 类:一类是为了缓解

网络训练中出现的梯度消失、模式崩塌等问题,另一类是针对提高图像生成的

质量进行改进。但是,很少研究工作考虑到不同输入噪声对图像生成质量的影

响。文献[40

]表明不同分布在数据拟合效果上具有一定的差异性,因而不同的噪

声分布对生成样本质量有一定的影响。不同度量方法对计算分布间差异的准确

性有直接影响,欧氏距离、L1 范数等只考虑绝对距离,忽视了相对距离。对于

反映不同分布之间的距离,相对距离更有实际意义,卡方散度和熵可以有效反

映相对距离。相比于熵,卡方散度没有对数和指数运算,其计算复杂度小,运

算速度较快。此外,卡方散度还具有稀疏不变性和量化敏感性

[41

]

,利于衡量不同

分布间细微的差异。因此,有必要将卡方散度用于生成对抗网络中展开研究。

为了解决不同分布噪声下网络生成样本质量差异明显、稳健性差的问题,

本 文 提 出 了 一 种 噪 声 稳 健 性 的 卡 方 生 成 对 抗 网 络 ( CSGAN,chi-square

generative adversarial network )。该网络结合卡方散度稀疏不变性和量化敏

感性的优势,构建网络优化的目标函数,引入卡方散度值作为评估生成样本和

真实样本分布差异的依据,促进生成器和判别器在对抗中不断优化,使不同噪

声下的生成样本分布能够尽量拟合真实样本分布,增强网络的稳健性。

2 相关工作

在大数据背景下,无监督的生成对抗网络得到广泛关注。同时,许多基于

生成对抗网络的改进方法被提出,例如条件生成对抗网络

[42

]

、深度卷积生成对抗

网 络

[43

]

、 能 量 生 成 对 抗 网 络

[44

]

等 。 下 面 详 细 介 绍 经 典 生 成 对 抗 网 络 和

Wasserstein 生成对抗网络。

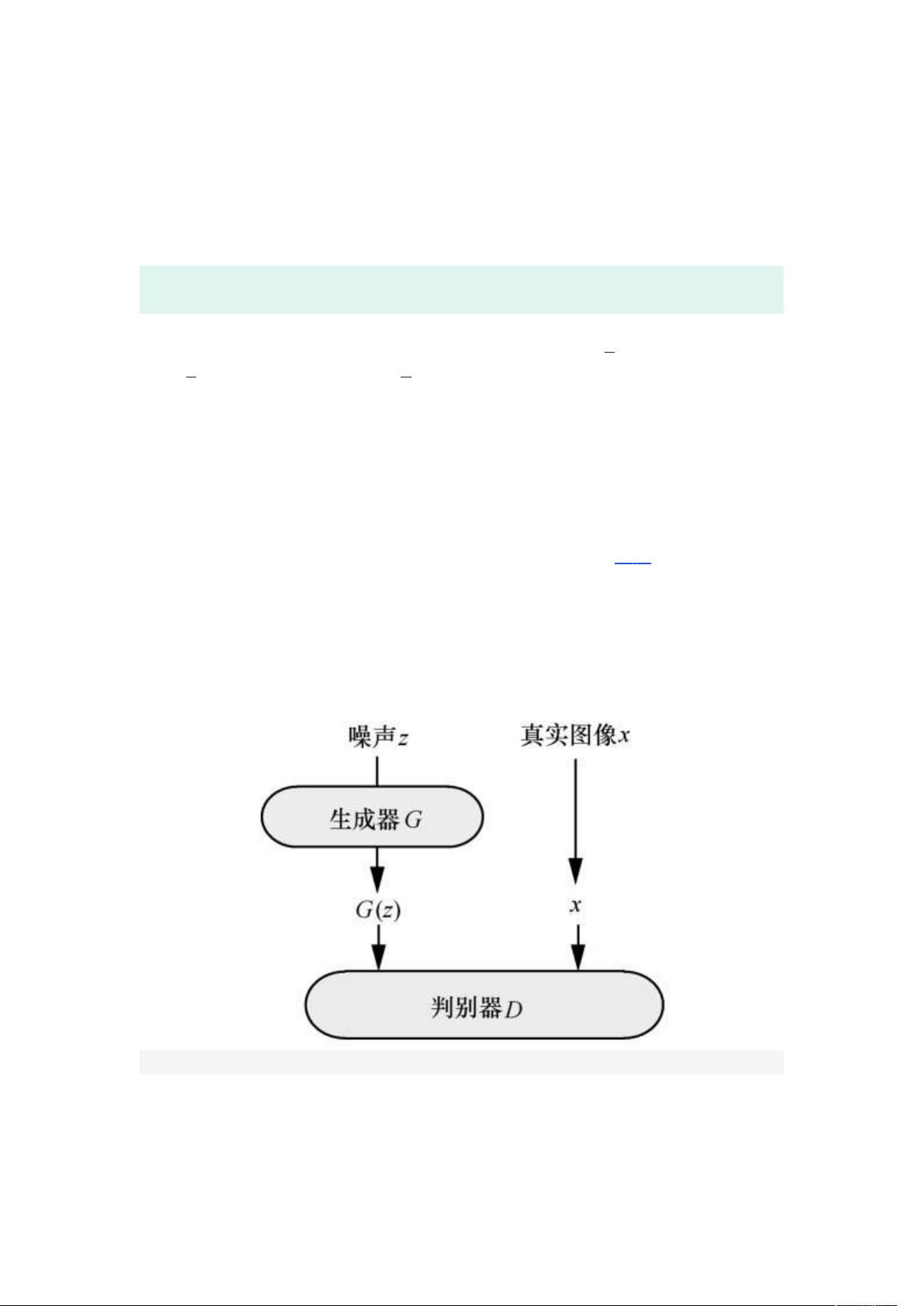

2.1 经典生成对抗网络

经典生成对抗网络是一种典型的生成式网络,通过对抗学习并使用随机梯

度下降法进行优化。这有效避免了马尔可夫链的反复使用,不需要进行变分下

限和近似推断,改善了生成式模型的训练难度和效率。如图

1

所示,生成对抗

网络由以下两部分组成:生成器 G 和判别器 D。生成器获取真实样本的分布,

并根据所获取的分布重构样本;判别器相当于二分类器,用于判断输入数据来

自真实样本还是由生成器产生的样本。GAN 的基本思想是训练生成器 G 和判别

器 D,通过讨论极小极大化博弈问题寻求全局最优解,达到纳什均衡。

图 1

图 1生成对抗网络

生成器学习真实样本 x 的分布 p

d

,输入服从分布 p

z

(z)的噪声 z,该噪声通过

生成器映射到一个新的数据分布 p

g

,得到 G(z)。然后,将真实样本 x 与 G(z)共

同输入判别器 D 中,通过 D(x)表示输入的 2 个数据属于真实样本的概率并输出。

初始状态下,真实样本的 D(x)值趋近于 1,而生成样本的 D(x)值趋近于 0;训练

D 最大限度地正确区分生成样本和真实样本,同时训练 G 混淆判别器 D,使其

不能区分数据的来源。D 和 G 的训练是关于值函数 V(G,D)的极小极大化博弈问

题,如式(1)所示。

minGmaxDV(D,G)=Ez~pz(z)[log(1−D(G(z)))]+minG:maxD:V(D,

G)=Ez~pz(z)[log(1−D(G(z)))]+

Ex~pd(x)[logD(x)] (1)::::::::::::::::::::::::::::::::E

x~pd(x)[logD(x)] (1)

训练初期,当生成器 G 的效果较差时,生成样本与真实训练的样本明显不

同,判别器 D 可以轻松判别生成样本为假图像。为了增加梯度信息,生成器 G

选择最大化 log D(G(z))代替最小化 log(1-D(G(z)))进行训练。当训练样本足够

多时,对抗问题的全局最优解为 p

d

:= p

g

,D∗(x)=12D*(x)=12,即真实样本分

布与生成样本分布重合,网络达到纳什均衡状态。

2.2 Wasserstein 生成对抗网络

经典的 GAN 模型通过计算 JS 散度,比较 p

g

和 p

d

之间的距离,要求 2 个

分布有重叠,但低维与高维之间有微小重叠或完全没有重叠的可能性非常大。

因此,生成器存在无法逼近真实样本和模型崩塌的问题。 Arjovsky 等

[34

]

从数据

分布相似性度量入手对 GAN 进行改进,提出 Wasserstein 生成对抗网络。通过

将经典 GAN 中对概率分布的距离度量 JS 散度替换为 Wasserstein 距离,对于

GAN 算法进行部分调整,优化了经典 GAN 训练过程不稳定、训练后期生成器

梯度消失、模型崩溃的问题,如式(2)所示。

W(pd,pg)=sup∥f∥L≤1Ex~pd[f(x)]−Ex~pg[f(x)]

(2)W(pd,pg)=sup‖f‖L≤1:Ex~pd[f(x)]−Ex~pg[f(x)] (2)

WGAN 与经典 GAN 相比做了部分调整,具体如下。生成器和判别器的目标

函数不取对数形式,采用 RMSProp 优化算法,判别器最后一层去掉 Sigmoid

激活函数;判别器参数更新后,通过截断方式将权重限定在一个固定区间,避

免梯度消失。

3 卡方生成对抗网络

3.1 网络设计

不同评估方法会对计算不同分布间差异的准确性造成直接影响。欧氏距离 、

L1 范数等考虑生成样本分布和真实样本分布之间的绝对距离,忽视了相对距离;

卡方散度和熵可以有效反映不同分布之间的相对距离。对于计算不同分布之间

的差异,相对距离往往更有实际意义。

卡 方 散 度 是 F 散 度 的 一 种 形 式 , 衡 量 2 个 分 布 , 即 P=(p1,p2,

⋯,pn)P=(p1,p2,⋯,pn)和 Q=(q1,q2,⋯,qn)Q=(q1,q2,⋯,qn):差 异 的 大 小 , 其

被定义为

χ2(P∥Q)=∑i=1n(pi−qi) 2qi=∑i=1n(pi) 2qi−1

(3)χ2(P‖Q)=∑i=1n(pi−qi) 2qi=∑i=1n(pi) 2qi−1 (3)

该 散 度 满 足 非 负 性 , 当 且 仅 当 P 和 Q 完 全 相 同 时 ,

χ2(P∥Q)=0χ2(P‖Q)=0 。 相 比 于 熵 , 如 GAN 中 典 型 的 交 叉 熵

D(P∥Q)=∑i=1npilogpiqiD(P‖Q)=∑i=1npilogpiqi,卡方散度没有对数和指数运

算,其计算复杂度小,运算速度较快。卡方散度 χ2(P∥Q)χ2(P‖Q):与交叉熵

D(P∥Q)D(P‖Q):的关系满足 0≤D(P∥Q)≤χ2(P∥Q)0≤D(P‖Q)≤χ2(P‖Q),表明

基于卡方散度的方法比交叉熵法有更好的抗噪性能

[45

]

。

此外,卡方散度具有量化敏感性和稀疏不变性

[41

]

。量化敏感性表现为卡方距

离对不同输入与标准模板之间的细微差异是敏感的。由于不同噪声服从不同的

概率分布,当 z 服从参数为 λ 的泊松分布,且 λ 充分大时,z 渐近服从正态分布

N(λ,λ);当 z 服从参数为 α 和 β 的伽马分布,且 α 趋于无穷大时,z 渐近服从正

态分布 N(αβ,αβ2)N(αβ,αβ2)。虽然不同分布在极限条件下存在一定的关系,但

是一般情况下很难达到极限条件。因此,不同输入噪声拟合出的生成样本分布

具有一定的差异,即其与真实样本分布的距离也各不相同;卡方散度的量化敏

感性可以度量不同噪声下生成样本分布与真实样本分布的差异,有利于减小不

同噪声对生成样本分布的影响,因此使用卡方散度有助于缓解不同输入噪声下

的稳健性问题。

卡方散度的稀疏不变性的定义是整体距离等于局部最优距离。由于真实样

本中可能存在一些质量较差或不服从整体分布的独立样本,如果生成样本分布

无限拟合真实样本分布,会产生独立样本,影响判别器和生成器的训练。此时,

卡方散度的稀疏不变性有利于从整体数据中忽略独立样本,使用局部最优样本

分布来代替整体分布。所以,将卡方散度作为样本分布差异的评价依据,可以

降低对真实样本质量的要求,同时避免生成一些质量较差的独立样本。

因此,基于卡方散度构建卡方生成对抗网络的目标函数,如式 (4)所示。根

据极大极小值原理,判别器 D 希望生成器生成的图像质量较差,从而轻易地判

别出真实样本和生成样本。生成器 G 根据判别器的反馈优化自身,直到可以混

淆判别器的判断。

maxGminDK(D,G)=Ez~pz(z)[D2(G(z))]−Ex~pd(x)[D(x)]

(4)maxGminD:K(D,G)=Ez~pz(z)[D2(G(z))]−Ex~pd(x)[D(x)] (4)

剩余19页未读,继续阅读

资源评论

罗伯特之技术屋

- 粉丝: 3961

- 资源: 1万+

下载权益

C知道特权

VIP文章

课程特权

开通VIP

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- java-leetcode题解之第111题二叉树的最小深度.zip

- java-leetcode题解之第110题平衡二叉树.zip

- java-leetcode题解之第109题有序链表转换二叉搜索树.zip

- java-leetcode题解之第108题将有序数组转换为二叉搜索树.zip

- java-leetcode题解之第107题二叉树的层序遍历II.zip

- java-leetcode题解之第102题二叉树的层序遍历.zip

- java-leetcode题解之第103题二叉树的锯齿形层序遍历.zip

- java-leetcode题解之第104题二叉树的最大深度.zip

- java-leetcode题解之第173题二叉搜索树迭代器.zip

- java-leetcode题解之第100题相同的树.zip

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功