没有合适的资源?快使用搜索试试~ 我知道了~

Searching for MobileNetV3

需积分: 10 2 下载量 68 浏览量

2022-11-01

16:20:41

上传

评论

收藏 2.27MB PDF 举报

温馨提示

试读

18页

Searching for MobileNetV3翻译

资源推荐

资源详情

资源评论

探索 MobileNetV3

摘要

我们提出了基于互补搜索技术下一代 MobileNet,并设计了新的网络结构。

通过结合硬件网络架构搜索(NAS)和 NetAdapt 算法,MobileNetV3 被调优为移动

电话 CPU,然后通过新的架构进行改进。本文开始探索自动搜索算法和网络设计

如何协同工作,以利用互补的方法改善整体技术水平。通过这个过程,我们为发

布了两个新的 MobileNet 模型:MobileNetV3-Large 和 MobileNetV3-Small,它们针

对高和低质量资源的使用。然后将这些模型应用到目标检测和语义分割任务中。

针对语义分割(或任何密集像素预测)的任务,我们提出了一种新的高效 分割解

码器 Lite Reduced Atrous Spatial Pyramid Pooling (LR-ASPP)。我们实现了移动分类、

检测和分割的最新成果。与 MobileNetV2 相比,MobileNetV3-Large 在 ImageNet

分类上的准确率提高了 3.2%,同时减少了 20%的延迟。MobileNetV3-Small 是与

具有相同延迟的 MobileNetV2 模型相比,精度提高了 6.6%。MobileNetV3-Large

检测速度比 MobileNetV2 COCO 检测的准确率快 25%以上。MobileNetV3-Large

LRASPP 比 MobileNetV2 R-ASPP 快 34%,在城市景观分割的精度相似。

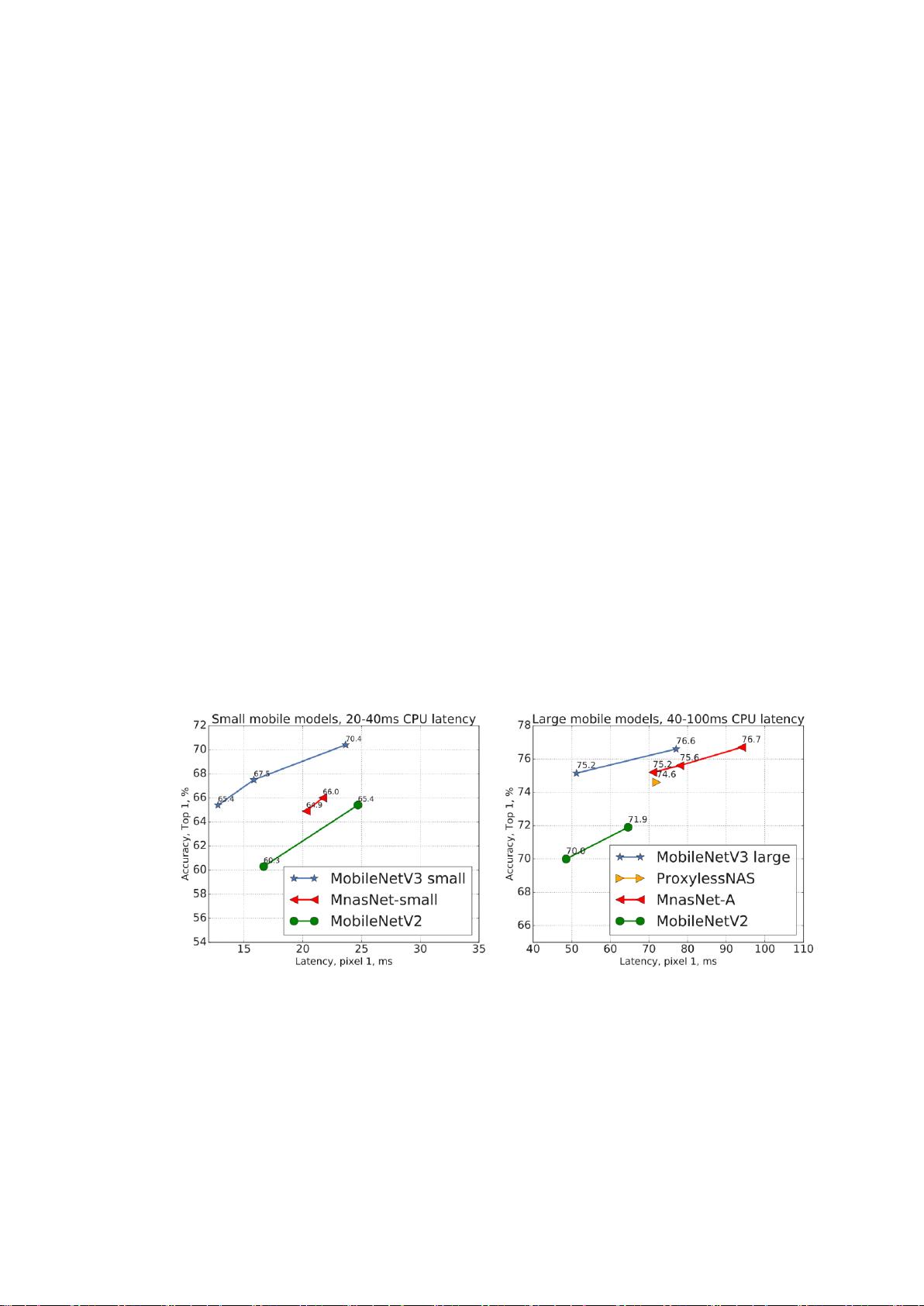

图 1.Pixel 1 延迟和 top-1 ImageNet 精度之间的权衡。所有型号均使用输入分

辨率 224。V3 大和 V3 小使用乘数 0.75,1 和 1.25 来表示最优边界。使用 TFLite[1]

在同一设备的单个大核上测量所有延迟。MobileNetV3-Small 和 Large 是我们提

出的下一代移动模型。

图 2.MAdds 和顶级精度之间的权衡。这允许比较针对不同硬件或软件框架

的模型。所有 MobileNetV3 都用于输入分辨率 224,并使用乘数 0.35,0.5,0.75,1 和

1.25。其他部分见第 6 节。最好用彩色观看。

1.介绍

高效的神经网络在移动应用程序中变得无处不在,使全新的设备上体验成为

可能。它们也是保护个人隐私的关键因素,允许用户在不需要将数据发送到服务

器进行评估的情况下获得神经网络的好处。神经网络效率的进步不仅通过更高的

准确性和更低的延迟改善了用户体验,而且通过降低功耗来帮助保护电池寿命。

本文描述了我们所采用的开发方法 MobileNetV3 大型和小型模型,以发布下

一代高精度高效的神经网络模型,为设备上的计算机视觉提供动力。新的网络推

动了技术的发展,并展示了如何将自动搜索与新架构的进步相结合,以建立有效

的模型。

本文的目标是开发最佳的移动计算机视觉体系结构,以优化移动设备上的精

度和延迟。为此,我们引入了(1)互补搜索技术,(2)适用于移动环境的新的高效非

线性版本,(3)新的高效网络设计,(4)新的高效分割解码器。我们做了充分的实

验,证明了在广泛的用例和移动设备上评估每种技术的功效和价值。

本文组织如下。我们从第 2 节的相关工作讨论开始。第 3 节回顾了用于移动

模型的高效构建块。第 4 节回顾了体系结构搜索以及 MnasNet 和 NetAdapt 算法

的互补性。第 5 部分介绍了通过联合搜索得到的模型的效率提高的新架构设计。

第 6 节为分类、检测和分割提供了大量的实验,以证明有效性并理解不同部分的

贡献。第 7 节是结论和今后的工作。

2.相关工作

设计深度神经网络体系结构,在准确性和效率之间进行最优平衡是近年来一

个热门的研究领域。新颖的手工结构和算法神经结构搜索都在这一领域的发展中

发挥了重要作用。SqueezeNet[22]广泛使用 1x1 卷积和减少和扩展模块,主要专

注于减少参数的数量。最近的工作将重点从减少参数转移到减少操作数量

(MAdds)和实际测量的延迟上来。MobileNetV1[19]采用深度可分离卷积,大大提

高了计算效率。 MobileNetV2[39]在此基础上进行了扩展,引入了具有反向残差

和线性 bottleneck 的资源高效块。ShuffleNet[49]利用组卷积和通道混洗操作来进

一步减少 MAdds。CondenseNet[21]在训练阶段学习组卷积,以保持层之间有用

的密集连接,以便特征再利用。ShiftNet[46]提出了交替使用点卷积的转换运算,

以取代昂贵的空间卷积。

为了实现架构设计过程的自动化,首先引入强化学习(RL)来搜索具有竞争性

精度的高效架构[53,54,3,27,35]。一个完全的结构搜索空间可以成倍增长,而且难

以处理。一个完全可配置的搜索空间可以成倍增长,而且难以处理。最近,[43]

探索了一个块级层次搜索空间,允许在网络的不同分辨率块上使用不同的层结构。

为降低搜索的计算成本,[28,5,45]采用可微架构搜索框架,并基于梯度进行优化。

[48, 15, 12]着眼于使现有网络适应受约束的移动平台,提出了更有效的自动化网

络简化算法。

量化[23,25,47,41,51,52,37]是通过降低精度算法来提高网络效率的另一项重

要的补充结果。最后,知识蒸馏[4,17]提供了一种额外的补充方法,在大型“教师”

网络的引导下,生成小型精确的“学生”网络。

3.高效的移动构建块

移动模型建立在越来越高效的构建模块上。MobileNetV1[19]引入深度可分

离卷积作为传统卷积层的有效替代。深度可分卷积将空间滤波与特征生成机制分

离,有效地分解了传统卷积。深度可分离卷积由两个独立的层定义:用于空间滤

波的轻量级深度卷积和用于特征生成的较大的 1x1 点卷积。

MobileNetV2[39]引入了线性 bottleneck 和反向残差结构,以便利用问题的低

秩性质来制作更高效的层结构。该结构如图 3 所示,由一个 1x1 展开卷积、接着

是深度卷积和一个 1x1 投影层定义。当且仅当输入和输出具有相同数量的通道

时,用残差连接它们。这种结构在输入和输出处保持了紧凑的表示,同时在内部

扩展到高维特征空间,以增加非线性全通道转换的表现力。

MnasNet[43]建立在 MobileNetV2 结构的基础上,在 bottleneck 结构中引入了

基于挤压和激励的轻量级注意模块。注意,与[20]中提出的基于 ResNet 的模块相

比,挤压和激励模块集成在不同的位置。该模块被放置在扩展中的深度过滤器之

后,以便将注意力应用到最大的特征表示上,如图 4 所示。

图 3.MobileNetV2[39]层(反向残差和线性 bottleneck)。每个块由狭窄的输入

和输出(bottleneck)组成,没有非线性,然后扩展到更高维度的空间和投影到输出。

残余连接 bottleneck (而不是扩展)。

图 4.MobileNetV2 +Squeeze-and-Excite [20]。与 [20]相比,我们在残余层中施

加挤压和激励。我们使用不同的非线性取决于层,见章节 5.2 的细节。

对于 MobileNetV3,我们使用这些层的组合作为构建块,以便构建最有效的

模型。层也升级了修正的 swish 非线性[36,13,16]。挤压和激励以及 swish 非线性

都使用了 sigmoid,这在定点算法中计算效率低,且难以保持精度,因此我们将

其替换为第 5.2 节中讨论的 sigmoid[2,11]。

4. 网络搜索

剩余17页未读,继续阅读

资源评论

长沙有肥鱼

- 粉丝: 1w+

- 资源: 15

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 三维装箱问题(Three-Dimensional Bin Packing Problem,3D-BPP)是一个经典的组合优化问题

- 以下是一些关于Linux线程同步的基本概念和方法.txt

- 以下是一个简化的示例,它使用pygame库来模拟烟花动画的框架.txt

- Linux线程同步机制深度解析与实用指南.zip

- PTA题库C语言解题策略与实战.rar

- SVPWM控制技术的simulink建模与仿真【包括simulink模型,参考文献,操作步骤】

- AI高清修复图片画质易语言易语言源码易语言填表

- 映射窗口.ec易语言易语言模块CPU占用0%游戏监控窗口监控

- 易语言 361窗口模块高效、便捷、自封装、自用

- 易语言 窗口排列 模块 ,简单、高效、体积小

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功