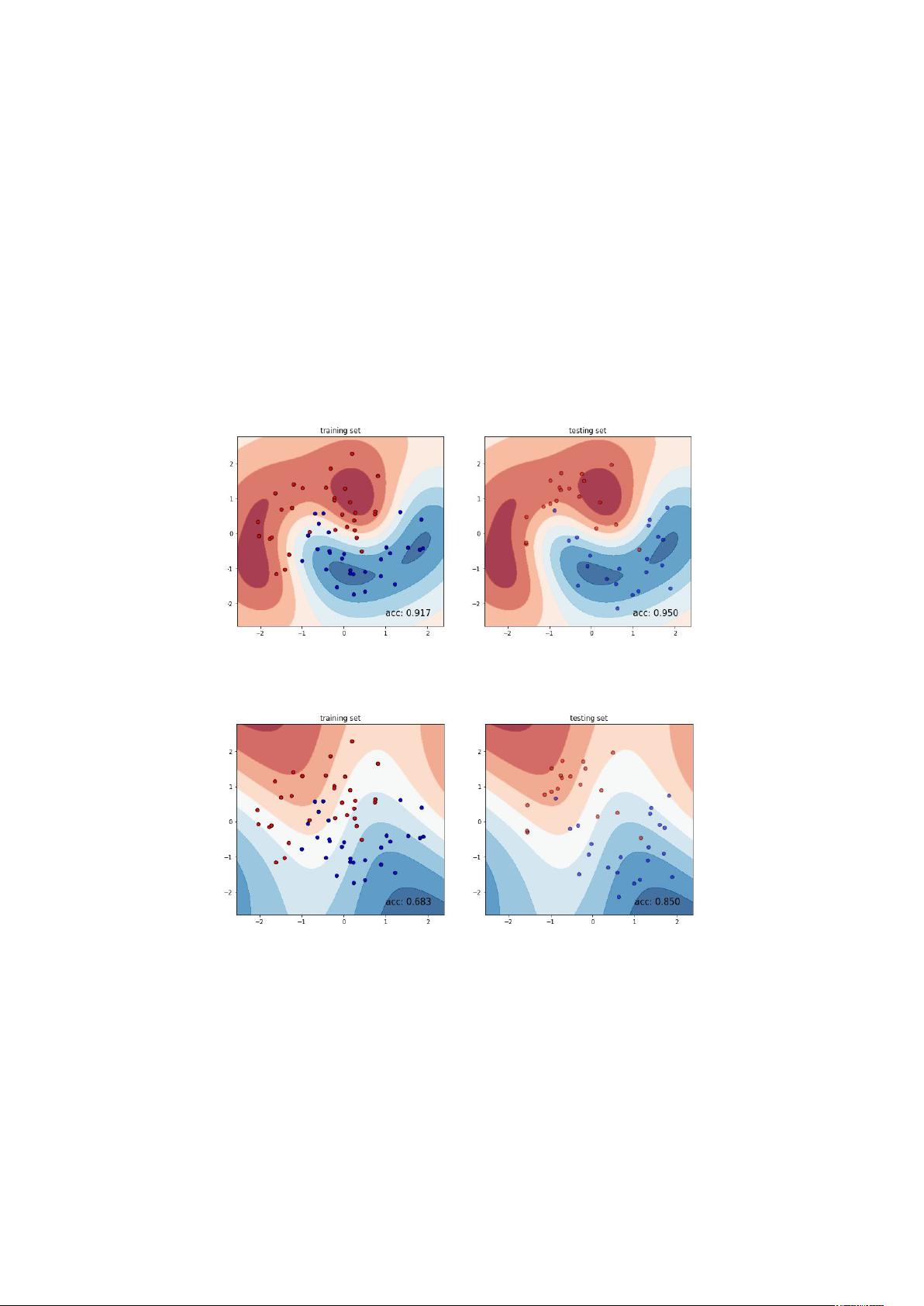

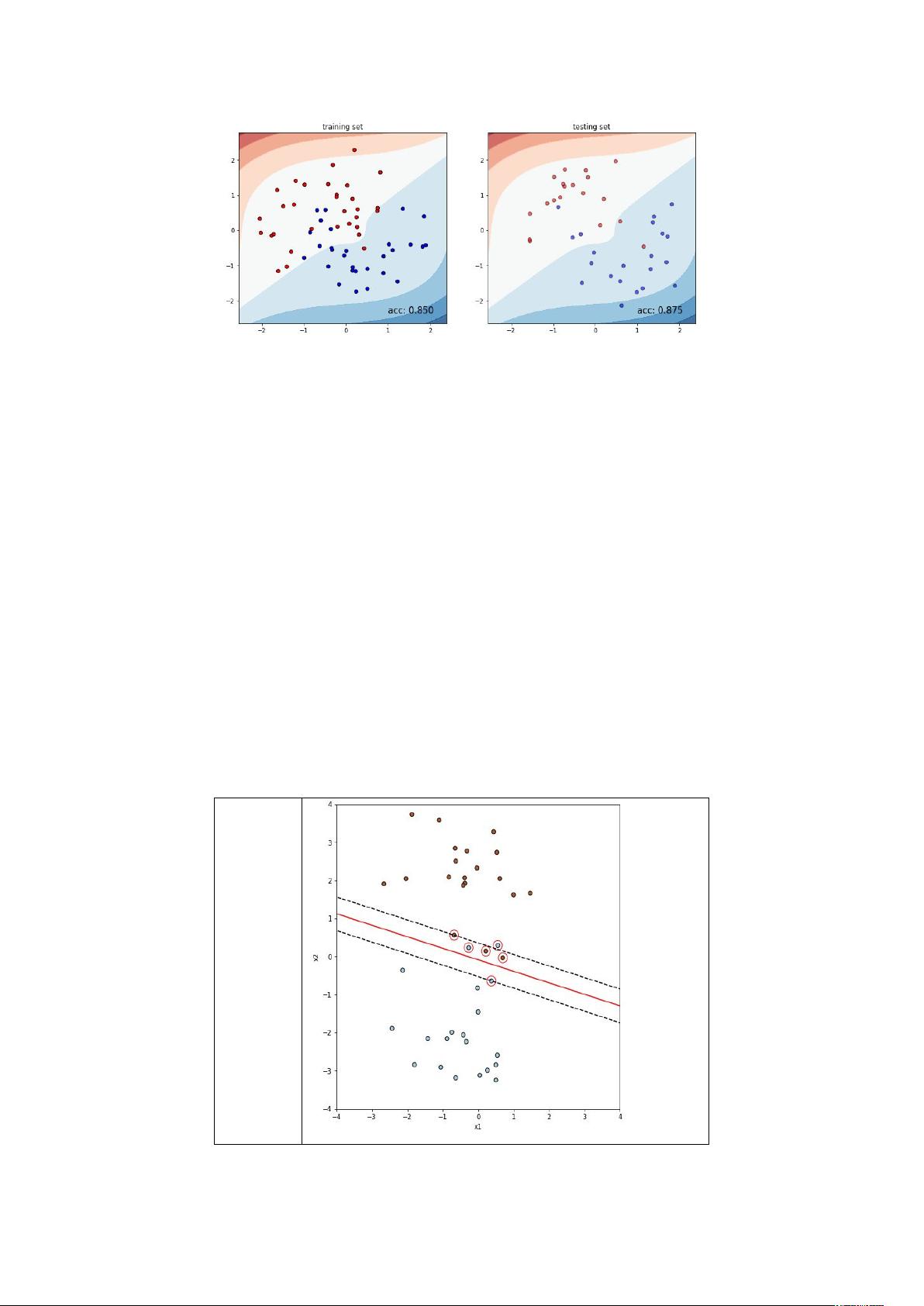

《机器学习》后三次实验报告主要探讨了支持向量机(SVM)和贝叶斯分类器的应用。实验深入分析了不同核函数、参数调整以及评估标准对模型性能的影响。 一、支持向量机(SVM) 1.1 SVM实验: - SVM的核心在于核函数,如高斯核(RBF)、sigmoid核和多项式核。高斯核常用于非线性分类,通过映射数据至高维空间,使得原本线性不可分的数据变得可分。 - 实验中调整了正则化参数C,C越大,模型对错误分类的容忍度越小,反之则越大。这体现了SVM的软间隔概念,允许一定程度的误分类以防止过拟合。 - SVM被应用于spambase垃圾邮件分类任务,通过比较不同核函数与C值的组合,发现线性核在某些情况下(如C=1)表现优于其他核函数,特别是在查准率和查全率上。 - SVM还在kaggle房价预测问题中被应用,评估指标为均方根误差(RMSE)和平均绝对值误差(MAE),结果显示线性核在C=1时的预测误差较小。 1.2 结果评价标准: - 精度、查准率、查全率和F1值是衡量分类任务性能的关键指标。 - MAE和RMSE用于回归任务,分别衡量预测值与真实值的平均绝对误差和平方误差的均方根,数值越小表示预测效果越好。 二、贝叶斯分类器 2.1 贝叶斯分类实验: - 使用sklearn库的GaussianNB、BernoulliNB和MultinomialNB进行spambase分类任务。实验表明,针对二元离散或稀疏特征,BernoulliNB在精度、查准率和查全率上表现最优。 - 高斯朴素贝叶斯(GaussianNB)适用于特征近似正态分布的情况,多项式朴素贝叶斯(MultinomialNB)适合多类别离散特征,而伯努利朴素贝叶斯(BernoulliNB)适合二元离散特征。 - 通过构建自定义的高斯朴素贝叶斯模型和拉普拉斯修正的朴素贝叶斯分类器,可以进一步优化模型性能。 总结,SVM和贝叶斯分类器在机器学习中扮演着重要角色。SVM通过核函数和参数调整实现非线性分类,而贝叶斯分类器则依据特征分布选择合适的模型。在实际应用中,应结合具体任务和数据特性选择合适的算法,并通过实验调整参数以优化模型性能。

剩余11页未读,继续阅读

- 粉丝: 1w+

- 资源: 10

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功