本文档记录了周志华《机器学习》

山软智库©

机器学习

编写

许逸初

沈珈莹

聂义莹

本文档记录了周志华《机器学习》

3,4,5,6,7,11

章的知识见解

不足之处,欢迎反馈!

章的知识见解

。

第3章-线性模型

本章概述

本章讲解的是线性模型,首先介绍了线性模型的基本定义和它的特点,并介绍了线性模

型在回归和分类任务上如何使用。就线性判别分析这一经典模型介绍了其思想。接着,

我们将二分类学习拓展到多分类学习,针对类别不平衡问题,给出了现在常用的方法。

3.1 基本定义

3.1.1 线性模型的形式

线性模型:试图学得一个(通过属性的线性组合来预测输出值的)函数。

一般形式

是由d个属性描述的示例,其中 是 在第 个属性上

的取值。

向量形式

其中 . 和 经过学习确定,整个线性模型也就得到

了。

3.1.2 线性模型的特点

形式简单、易于建模

具有可解释性

非线性模型的基础

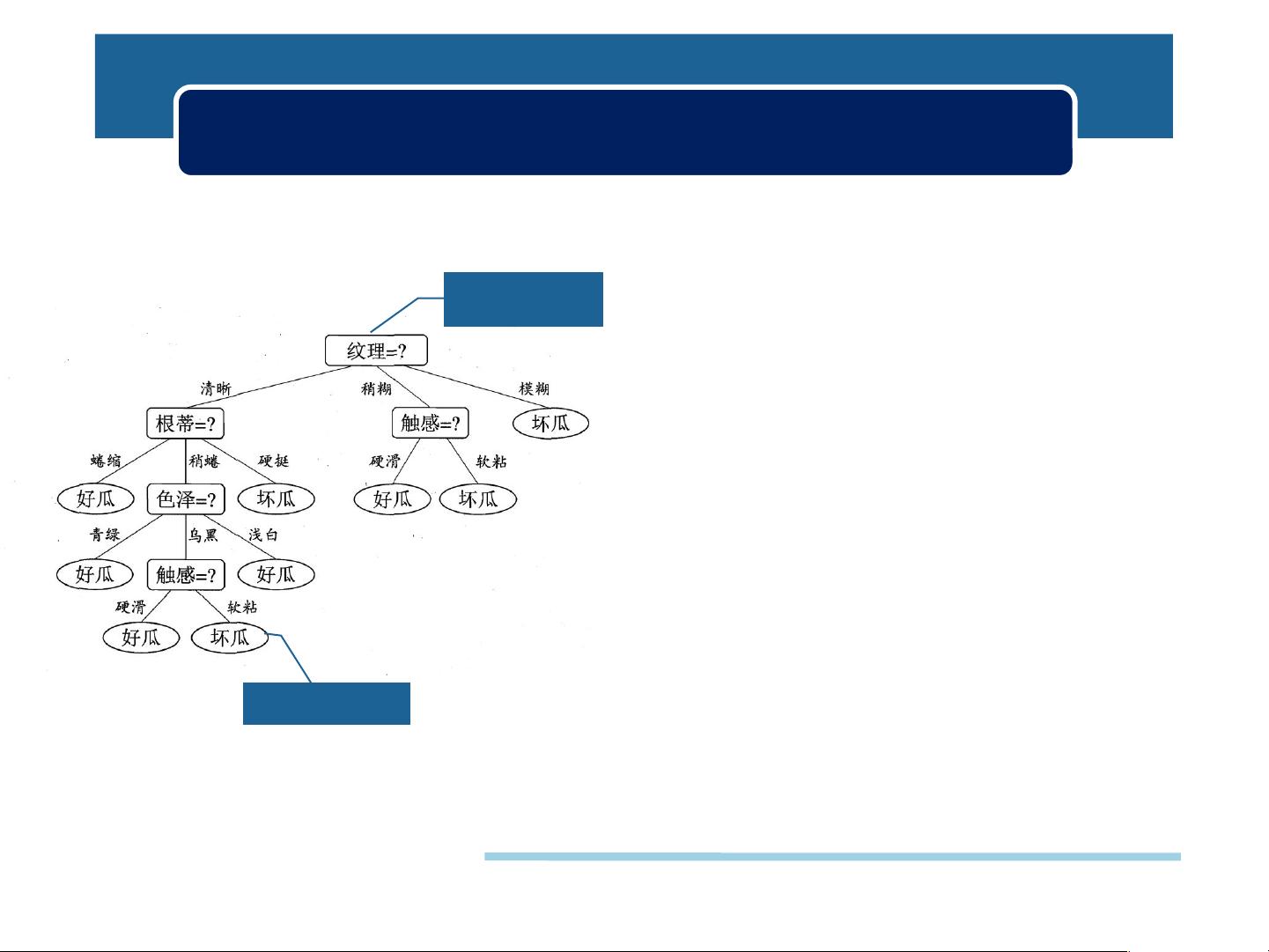

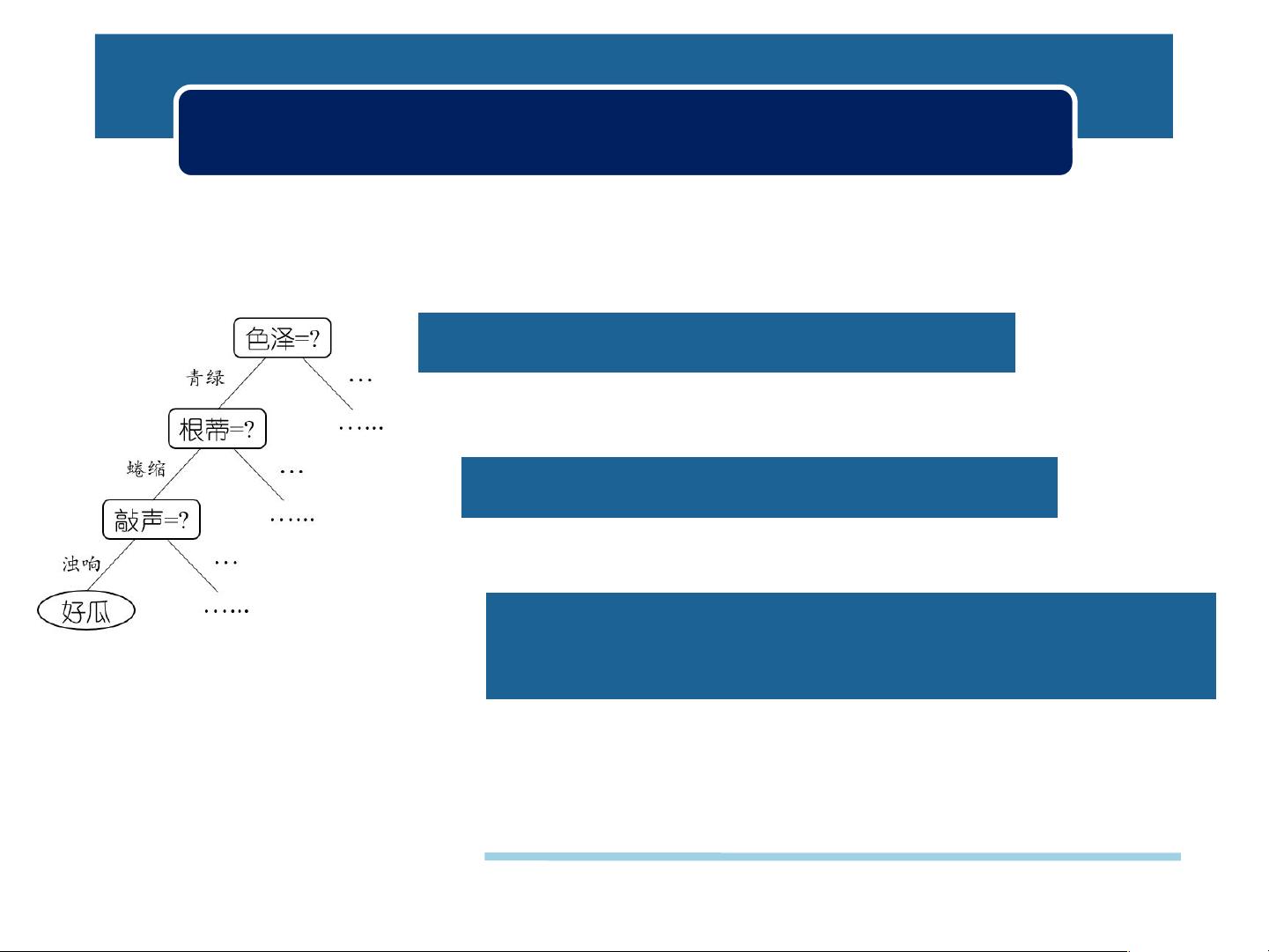

例:

在西瓜问题中,综合考虑色泽、根蒂和敲声来判断西瓜好不好。使用线性模型建

模,得到一个函数 。

接下来根据示例来学习出最优的 和 。假设,我们得到最好的函数是

。其中根蒂的系数最大,表明根蒂最要

f(x) = w

x

+

1 1

w

x

+

2 2

… + w

x

+

d d

b

x = x

; x

; … ; x(

1 2 d

) x

i

x i

f(x) = w x +

T

b

w = (w

; w

; ⋯ ; w

)

1 2 d

w b

f(x) = w

x

+

色泽 色泽

w

x

+

根蒂 根蒂

… + w

x

+

敲声 敲声

b

w b f(x) =

0.2 ⋅ x

+

色泽

0.5 ⋅ x

+

根蒂

0.3 ⋅ x

+

敲声

1

紧;而敲声的系数比色泽大,说明敲声比色泽更重要。每个特征前的系数决定了该特征

在任务中的影响力。

思考:基于线性模型的结果,我们再做非线性变换,整个模型的表达能力就更强

了。

本章介绍几种经典的线性模型。从回归任务开始,再讨论二分类和多分类任务。

分类问题 回归问题

机器学习类别 监督学习/非监督学习 监督学习/非监督学习

输入变量 离散或连续 离散或连续

输出值 离散值(个数=类别) 连续值

学习模型 决策线/面 拟合线/面

3.2 线性回归

给定数据集 ,其中

(一个样本分为数据 和标签 ,数据 由 个特征

组成。),“线性回归”试图学得一个线性拟合函数以尽可能地拟合数

据,并尽可能准确地预测数据。

3.2.1 单一变量的线性回归

先考虑一种最简单的情形:输入属性的数目只有一个。即数据集变为

(从 变为 ,从向量变为一个实质,因为现在只考虑输入属性为一

D = x

, y

, x

, y

, … , x

, y

{(

1 1

) (

2 2

) (

m m

)} x

=

i

x

; x

; … ; x

, y

∈(

i1 i2 id

)

i

R x

i

y

i

x

i

d

x

, x

, ⋯ , x

1 2 d

D =

{(x

, y

)}

i i

i=1

m

x x

个。)

属性处理:对于一个属性,

若属性值间存在“有序”关系,可通过连续化将其转化为连续值。如:“身高”的取

值“高”,“中”,“矮”,存在序列关系,可以转换为2,1,0。

若属性值间不存在“有序”关系,假设有k个属性值,则通常转化为k维向量,如:“瓜

类”的取值“西瓜”,“南瓜”,“黄瓜”,可以转换为(0,0,1),(0,1,0),(1,0,0)。

单一变量的线性回归目标

如何确定参数 和 :我们采用均方误差作为回归问题的性能度量,使均方误差最小化,

便得到想要的 和 ,即

上式解释: 表示求使右边的求和式最小的参数 和 ,这是我们想要确定的参

数。 为预测值, 为标签。(真实值)

基于均方误差最小化来进行模型求解的方法称为“最小二乘法”。在线性回归中,最小二

乘法就是为了找到一条直线,使所有样本到直线上的欧式距离之和最小。(二维空间是

找直线,三维空间是找平面)

f(x) = wx

+

i

b 使得 f x

≃(

i

) y

i

w b

w b

w , b(

∗ ∗

) =

f x

− y

(w,b)

arg min

i=1

∑

m

( (

i

)

i

)

2

=

y

− wx

− b

(w,b)

arg min

i=1

∑

m

(

i i

)

2

(w,b)

arg min w b

f(x

)

i

y

i

线性回归模型的最小二乘“参数估计”

将 分别对 和 求导,得到

令导数为0,分别得到闭式解(见公式下面的解释)

其中 为 的均值。

闭式解:又称为解析解,在数学上,若一个方程或方程组存在的某些解,可以用有限次

初等函数运算的组合表达,即称这个解为闭式解。为什么又叫做闭式解呢?因为初等函

数运算集合具有闭包性质。

上面的 和 即为闭式解,通过给自变量代入数值,就能将 和 解出来。

3.2.2 多变量的线性回归

E

(w,b)

w b

∂w

∂E

(w,b)

∂b

∂E

(w,b)

= 2 w

x

−

y

− b x

(

i=1

∑

m

i

2

i=1

∑

m

(

i

)

i

)

= 2 mb −

y

− wx

(

i=1

∑

m

(

i i

))

w

b

=

x

−

x

∑

i=1

m

i

2

m

1

(∑

i=1

m

i

)

2

y

x

−∑

i=1

m

i

(

i

xˉ)

=

y

− wx

m

1

i=1

∑

m

(

i i

)

=xˉ

x

m

1

∑

i=1

m

i

x

w b w b

- 1

- 2

- 3

- 4

前往页