根据提供的文档内容,我们可以深入探讨以下几个关键的知识点:

### 一、Transformer 训练显存占用回顾

在深度学习领域,Transformer 模型因其在自然语言处理任务中的卓越表现而备受关注。对于这类模型而言,训练阶段的显存管理至关重要。

- **Transformer 结构概述**:

- **Self-attention 层**:这是 Transformer 模型的核心组成部分之一,负责捕捉序列中不同位置之间的依赖关系。

- **MLP 层**:即多层感知机层,通常包含两层全连接层,用于对 Self-attention 层的输出进行非线性变换。

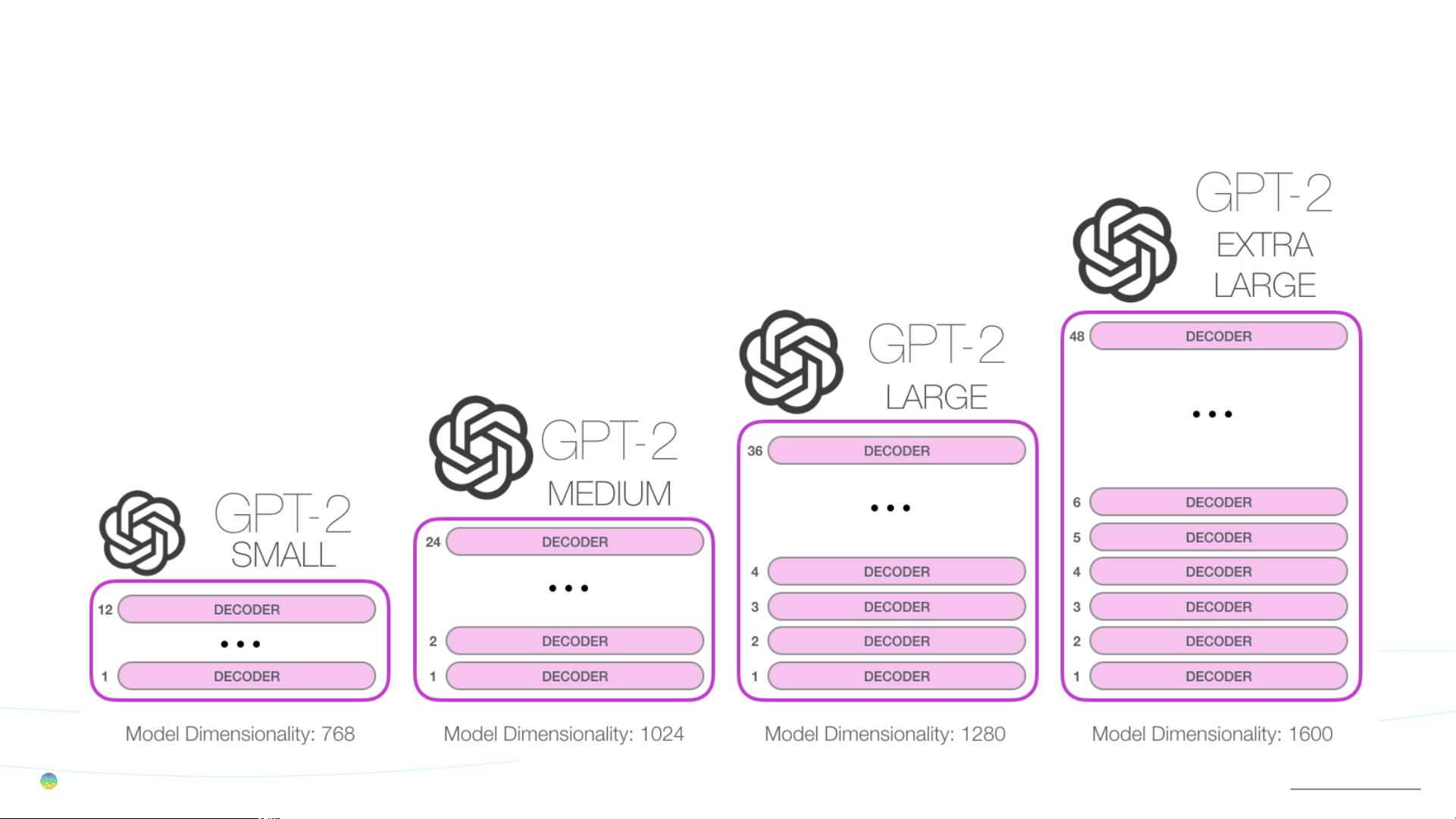

- **模型参数量与模型大小的关系**:

- 举例来说,LLAMA-6B 模型具有 4096 的隐藏层维度和 32 层,实际参数量约为 4509446700,如果使用 FP16 格式存储,则模型大小约为 12GB。

- 类似地,随着模型规模的增加,如 LLAMA-13B 和 LLAMA-33B,其参数量和所需显存也会相应增加。

- 最大的 LLAMA-65B 模型拥有 8192 的隐藏层维度和 80 层,参数量达到了 64424509440,使用 FP16 存储时,模型大小达到了 120GB。

- **模型存储格式的影响**:

- **FP16** 和 **BF16**:这两种格式均使用 2 个字节存储一个数值,能够显著减少显存占用。

- **FP32**:使用 4 个字节存储一个数值,在模型训练阶段更为常见,因为它能提供更高的数值精度。

### 二、大模型训练内存占用分析

- **模型训练阶段的内存消耗**:

- **模型参数**:包括权重参数和梯度参数,通常采用 half precision (FP16 或 BF16) 存储,每项占用 2 字节。

- **优化器状态**:如 Adam 优化器的状态,使用 FP32 存储,每项占用 4 字节。

- **激活值**:在正向传播过程中计算得到,并在反向传播时用于计算梯度,这部分数据同样占据了一定的显存空间。

- **内存占用比例**:

- 在 BERT-Base 模型的训练过程中,模型参数和优化器状态占用了大约 10% 的显存,而激活值占用了剩余的大部分显存(约 88%)。

### 三、大模型推理显存分析

- **推理阶段显存占用特点**:

- 与训练阶段相比,推理阶段不涉及梯度计算或优化器状态更新,因此这部分显存可以节省下来。

- 推理阶段主要占用显存的是模型参数本身以及少量其他开销。

- **KV Cache 的原理与应用**:

- **KV Cache 的作用**:在自注意力机制中,查询向量(Q)、键向量(K)和值向量(V)构成了 KV Cache 的基础。通过缓存这些向量,可以显著提高解码速度并减少显存占用。

- **实现方法**:通常情况下,对于每个输入序列,KV Cache 会将前一时刻的 K 和 V 向量存储起来,以便在后续时刻快速检索。

- **输入数据的处理**:

- 除了模型参数和 KV Cache 外,输入数据本身也需要被加载到显存中。这部分数据的大小取决于输入序列的长度和批量大小。

对于大模型的训练和推理阶段,显存管理是一项至关重要的任务。合理利用 KV Cache 和高效的数据表示格式(如 FP16 或 BF16),可以在确保模型性能的同时减少显存占用。此外,了解不同阶段内存占用的特点有助于开发者更好地优化资源分配策略。