没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

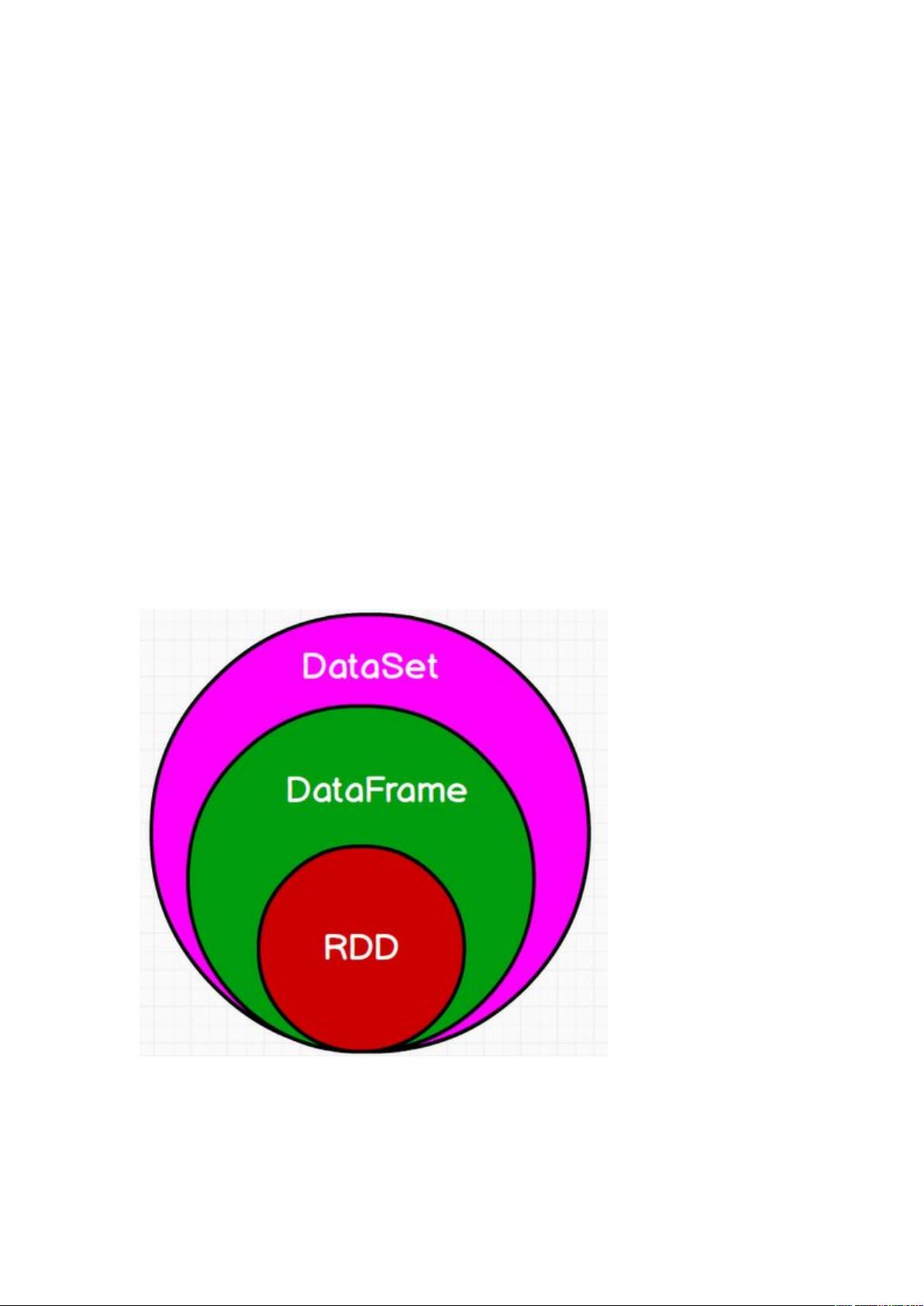

spark 三大数据结构

1. Rdd

1.1 定义

数据集:存储的是数据的计算逻辑

分布式:数据的来源$计算$数据的存储

弹性:

血缘(依赖关系):spark 可以通过特殊的处理方案简化依赖关系

计算:spark 是基于内存的,所以性能非常高,可以和磁盘进行灵活切换

分区:spark 在创建默认分区后,可以通过指定的算子来改变分区数量

容错:spark 在执行计算时,如果发生错误,需要进行容错重试处理

数量

Spark 中数量,Executor:可以通过提交应用的参数进行设定

Paron:默认情况下,读取文件采用的是 hadoop 的切片规则,如果读取内存中的数据,

可以根据特定的算法进行设定,可以通过其他算子改变。

多个阶段的场合,下一个阶段的分区数量取决于上一个阶段最后 RDD 的分区数,但是可以

在相应的算子中进行修改

Stage:1(ResultStage)+Shue 依赖的数量(ShueMapStage),划分阶段的目的就是为了任务

执行的等待,因为 Shue 的过程需要落盘

Task:原则上是一个分区一个任务,但是实际应用中,可以动态调整

1.2 创建

从内存中创建

从存储中创建

从其他 rdd 创建

1.3 属性

分区

依赖关系

分区器

优先位置

计算函数

1.4 使用

转换:单 value 类型,双 value 类型,k-v 类型

行动:runjob

2 广播变量:分布式共享只读数据

3 累加器:分布式共享只写数据

sparksql 概述

什么是 SparkSql

是用来处理结构化数据的模块,它提供了两个变成抽象, 和 并

且作为分布式 查询引擎的作用

我们已经学习了 ,它是将 转换成 然后提交到集群上执行,大大简化

了编写 程序的复杂性,由于 这种计算模型执行效率比较慢,所以

应运而生,它是将 转换成 然后提交到集群中执行,执行效率非常快

spark SQL 特点

易整合

统一的数据访问方式

兼容

标准的数据连接

DataFrame DataSet

表述的是结构, 数据集

简单理解 数据本身加上了结构就是 ,数据结构加上了类,属性就是

剩余19页未读,继续阅读

资源评论

weixin_41801538

- 粉丝: 2

- 资源: 2

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 农村信用社联合社计算机信息系统投产与变更管理办.docx

- 农村信用社联合社计算机信息系统数据管理办法.docx

- 利用SPSS作临床效度分析线上计算网站介绍-医学研究部统计谘.(医学PPT课件).ppt

- 利用Zabbix监控mysqldump定时备份数据库状态.docx

- 利用计算机解决问题的基本过程.doc

- 化工铁路通信工程总结.doc

- 北京大学网络教育软件工程作业.docx

- 医药公司(连锁店)计算机操作规程未新系统的自行按照旧制修改-新系统过制的编号加修模版.doc

- 医药公司(连锁店)计算机系统操作规程模版.doc

- 医药连锁门店计算机系统的操作和管理程序未新系统的自行按照旧制修改-新系统过制的编号加修模版.docx

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功