实现设备智能 从数据中心到边缘的AI芯片设计.pdf

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

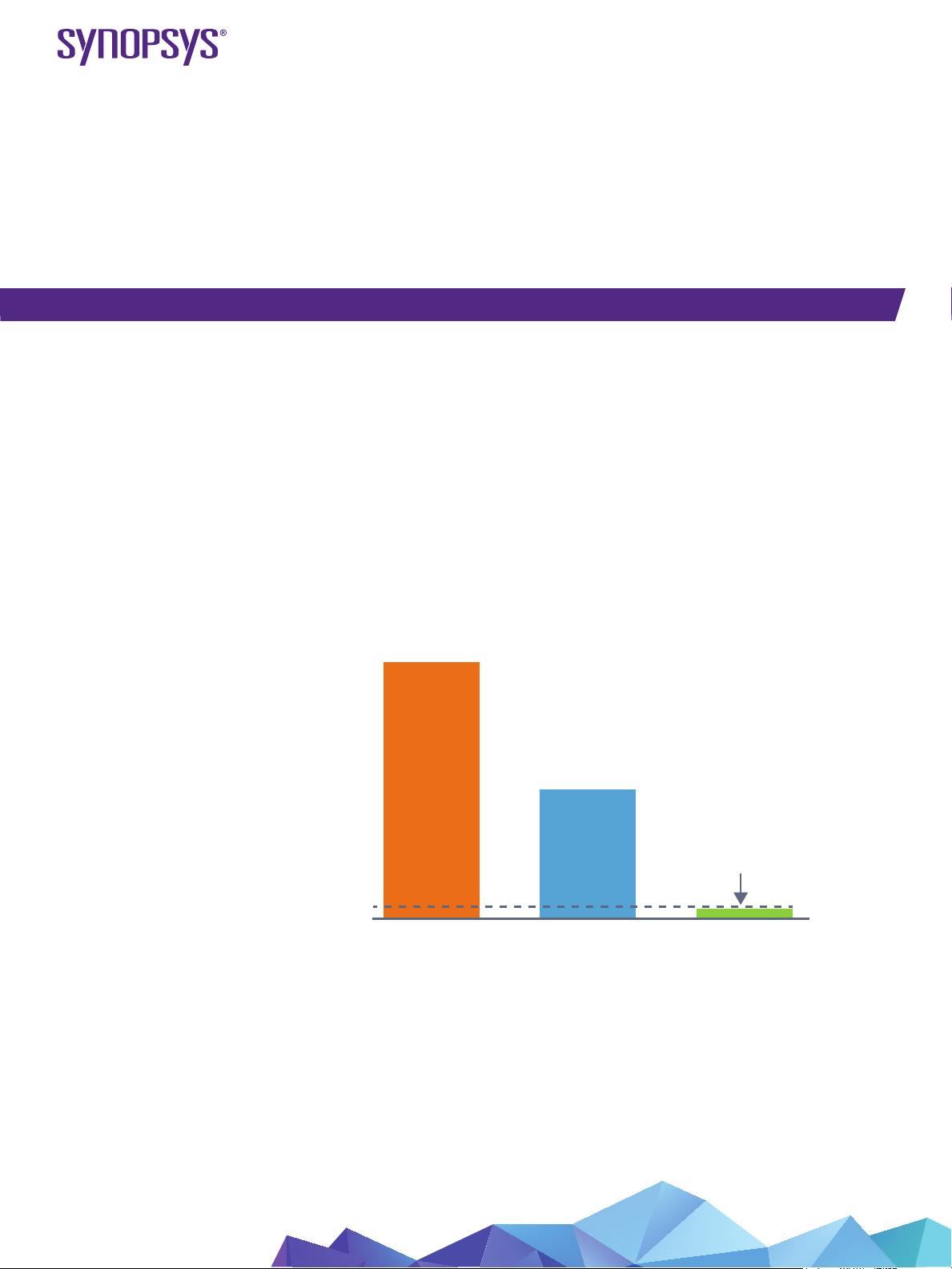

### 实现设备智能:从数据中心到边缘的AI芯片设计 #### 一、人工智能与AI芯片的发展背景 随着人工智能(AI)技术的迅速发展,尤其是在机器学习(Machine Learning, ML)和深度学习(Deep Learning, DL)领域的突破,AI已经开始深刻地改变我们的生活和社会。从自动驾驶汽车到智能家居系统,再到医疗健康领域,AI的应用越来越广泛。这种技术进步不仅催生了对更高效、更节能的硬件需求,也促进了AI芯片设计的快速发展。 #### 二、AI芯片的关键任务:训练与推理 AI芯片的设计主要围绕两个核心任务展开:训练(Training)和推理(Inference)。 - **训练**:涉及大量的数据处理和模型优化过程,通常在数据中心进行,利用大规模的并行计算资源。 - **推理**:则是将训练好的模型应用于实际场景,比如识别图像中的对象。推理可以在边缘设备上完成,如智能手机、监控摄像头等,以实现快速响应和隐私保护。 #### 三、AI加速器的兴起 为了应对日益增长的计算需求,AI加速器应运而生。这些高度专用的处理器能够有效地管理训练和推理所需的计算密集型任务,相较于传统的CPU和GPU,在能耗比、计算性能等方面展现出显著优势。 - **数据中心中的AI加速器**:在数据中心中,AI加速器利用高度并行的计算架构,可以处理数千万甚至数亿个神经元的训练任务,同时保持较低的功耗。 - **边缘设备上的AI加速器**:随着智能手机等移动设备的大规模普及,小型化的AI加速器成为了关键组件,能够在几毫秒内完成复杂的计算任务,支持实时交互式应用。 #### 四、AI加速器的技术挑战 尽管AI加速器为AI技术的发展带来了革命性的变化,但在设计过程中也面临着诸多挑战: - **算法与硬件架构的匹配**:AI算法种类繁多,且不断演变,如何将这些算法高效地映射到硬件上是设计过程中的难点之一。 - **高性能与低功耗**:在确保高计算性能的同时,还需要控制功耗,这对物理设计提出了极高的要求。 - **内存带宽与延迟**:在AI计算中,数据传输的速度直接影响到整体性能,因此高效的内存管理和数据流控制至关重要。 - **多样化的需求**:不同的应用场景对AI芯片有着不同的需求,例如在边缘设备上,实时性和功耗更为关键;而在数据中心,则更加注重计算能力和扩展性。 #### 五、多样化的架构 为了解决上述挑战,业界提出了各种异构计算架构。这些架构不仅包含了针对AI任务优化的加速器,还包括其他必要的组件,如应用程序处理器、图像信号处理器、音频处理器等,以满足不同应用场景的需求。 - **数据中心架构**:强调大规模并行计算能力和高带宽内存访问,通常采用多核CPU、GPU、FPGA或专门设计的ASIC。 - **边缘设备架构**:更加注重低功耗、实时处理能力和小型化设计,常见的解决方案包括集成AI加速器的SoC(System-on-a-Chip)。 #### 六、总结 随着AI技术的不断发展,AI芯片的设计变得越来越重要。从数据中心到边缘设备,AI加速器的创新设计不仅推动了技术的进步,也为未来的人工智能应用奠定了坚实的基础。面对不断变化的技术需求和挑战,持续的研发投入和技术创新将是推动AI芯片设计向前发展的关键力量。

- 粉丝: 5245

- 资源: 2万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功