没有合适的资源?快使用搜索试试~ 我知道了~

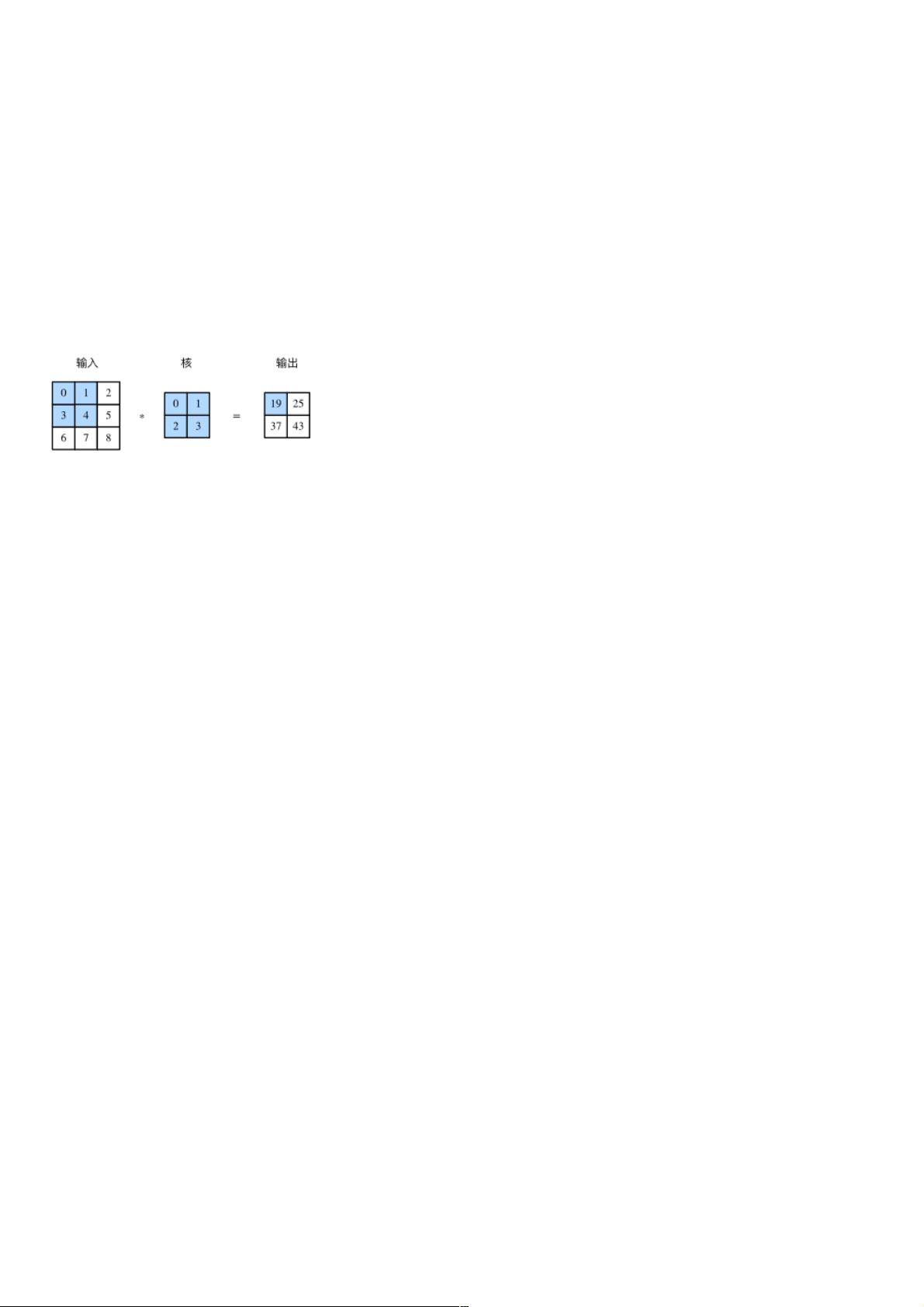

卷积神经网络基础 本节我们介绍卷积神经网络的基础概念,主要是卷积层和池化层,并解释填充、步幅、输入通道和输出通道的含义。 二维卷积层 本节介绍的是最常见的二维卷积层,常用于处理图像数据。 二维互相关运算 二维互相关(cross-correlation)运算的输入是一个二维输入数组和一个二维核(kernel)数组,输出也是一个二维数组,其中核数组通常称为卷积核或过滤器(filter)。卷积核的尺寸通常小于输入数组,卷积核在输入数组上滑动,在每个位置上,卷积核与该位置处的输入子数组按元素相乘并求和,得到输出数组中相应位置的元素。图1展示了一个互相关运算的例子,阴影部分分别是输入的第一个计算区域、核

资源推荐

资源详情

资源评论

pytorch-卷积神经网络基础卷积神经网络基础

卷积神经网络基础卷积神经网络基础

本节我们介绍卷积神经网络的基础概念,主要是卷积层和池化层,并解释填充、步幅、输入通道和输出通道的含义。

二维卷积层二维卷积层

本节介绍的是最常见的二维卷积层,常用于处理图像数据。

二维互相关运算二维互相关运算

二维互相关(cross-correlation)运算的输入是一个二维输入数组和一个二维核(kernel)数组,输出也是一个二维数组,其

中核数组通常称为卷积核或过滤器(filter)。卷积核的尺寸通常小于输入数组,卷积核在输入数组上滑动,在每个位置上,卷

积核与该位置处的输入子数组按元素相乘并求和,得到输出数组中相应位置的元素。图1展示了一个互相关运算的例子,阴影

部分分别是输入的第一个计算区域、核数组以及对应的输出。

图1 二维互相关运算

下面我们用corr2d函数实现二维互相关运算,它接受输入数组X与核数组K,并输出数组Y。

import torch

import torch.nn as nn

def corr2d(X, K):

# 这里的corr2d是二维互运算

# x是二维数组,也就是需要卷积的数组

# k是卷积和

H, W = X.shape

h, w = K.shape

Y = torch.zeros(H - h + 1, W - w + 1)

for i in range(Y.shape[0]):

for j in range(Y.shape[1]):

Y[i, j] = (X[i: i + h, j: j + w] * K).sum()

return Y

构造上图中的输入数组X、核数组K来验证二维互相关运算的输出。

X = torch.tensor([[0, 1, 2], [3, 4, 5], [6, 7, 8]])

K = torch.tensor([[0, 1], [2, 3]])

Y = corr2d(X, K)

print(Y)

# 符合计算结果

tensor([[19., 25.],

[37., 43.]])

二维卷积层二维卷积层

二维卷积层将输入和卷积核做互相关运算,并加上一个标量偏置来得到输出。卷积层的模型参数包括卷积核和标量偏置。

class Conv2D(nn.Module):# 默认继承

def __init__(self, kernel_size):

super(Conv2D, self).__init__()

self.weight = nn.Parameter(torch.randn(kernel_size))# 卷积核

self.bias = nn.Parameter(torch.randn(1))

# print(self.bias)给每个维度都加上偏执

def forward(self, x):

# print(corr2d(x, self.weight),1)

# print(corr2d(x, self.weight) + self.bias,2)

return corr2d(x, self.weight) + self.bias# 卷积之后加上偏执

下面我们看一个例子,我们构造一张6×86 imes 86×8的图像,中间4列为黑(0),其余为白(1),希望检测到颜色边缘。

我们的标签是一个6×76 imes 76×7的二维数组,第2列是1(从1到0的边缘),第6列是-1(从0到1的边缘)。

X = torch.ones(6, 8)

资源评论

weixin_38750406

- 粉丝: 6

- 资源: 894

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功