没有合适的资源?快使用搜索试试~ 我知道了~

Centos 7 部署 OpenStack_Rocky版高可用集群3-1

9 下载量 77 浏览量

2021-01-20

12:34:49

上传

评论 1

收藏 726KB PDF 举报

温馨提示

试读

20页

Centos 7 部署 OpenStack_Rocky版高可用集群3-1 文章目录Centos 7 部署 OpenStack_Rocky版高可用集群3-11、前期准备1.1 软硬件准备1.1.1组件1.1.2 网络拓扑(逻辑)1.1.3 物理拓扑(部分参考)1.2 配置hosts文件(集群所有电脑配置)1.3 节点间设置免密互相登陆1.4 配置NTP服务1.4.1 在控制节点进行配置(cont01、cont02、cont03)1.4.2 在其他节点上安装NTP软件(mon01、comp01、comp02、comp03)1.5 系统初始设置1.5.1 所有节点关闭防火墙和selinux2、部署

资源详情

资源评论

资源推荐

Centos 7 部署部署 OpenStack_Rocky版高可用集群版高可用集群3-1

Centos 7 部署部署 OpenStack_Rocky版高可用集群版高可用集群3-1

文章目录文章目录Centos 7 部署 OpenStack_Rocky版高可用集群3-11、前期准备1.1 软硬件准备1.1.1组件1.1.2 网络拓扑(逻辑)1.1.3 物理拓扑(部分参考)1.2 配置hosts文件(集群所有电脑配置)1.3 节点

间设置免密互相登陆1.4 配置NTP服务1.4.1 在控制节点进行配置(cont01、cont02、cont03)1.4.2 在其他节点上安装NTP软件(mon01、comp01、comp02、comp03)1.5 系统初始设置1.5.1 所有

节点关闭防火墙和selinux2、部署MariaDB Galeria集群2.1 控制节点安装mariadb(cont01、cont02、cont03)2.1.1 控制节点添加mariadb-10.4.11的yum源2.1.2 控制节点yum安装mariadb软件包并开启

服务2.1.3 控制节点数据库安全设置、登陆数据库设置密码并授权2.1.4 配置MariaDB Galeria 集群 (控制节点全修改配置文件/etc/my.cnf.d/server.cnf)2.1.5 控制节点停止mariadb.service2.1.6 启动初

始化集群2.2 登录数据库,查看集群状态2.3 每个控制节点/usr/bin 目录下面编辑心跳检测clustercheck脚本3、部署xinetd服务3.1 控制节点安装xinetd服务,用于监控Galera服务(cont01、cont02、

cont03)3.2 控制节点创建xinetd配置文件3.3 控制节点修改/etc/services3.4 控制节点启动xinetd服务(cont01、cont02、cont03)3.5 故障场景的恢复4、部署rabbitmq消息队列4.1、所有控制节点安装

rabbitmq和erlang软件包(cont01、cont02、cont03、~~mon01~~)4.2 查看集群状态4.3 编辑rabbitmq变量文件4.4 查看rabbitmq插件4.5 所有node开启rabbitmq的web管理页面4.6 查看rabbitmq插件

是否加载成功(成功后前面有E)4.7 访问:http://192.168.10.22:15672/4.8 所有node修改guest密码为adminrabbitmq(默认用户为:guest 密码为:guest)4.9 cont02添加一个openstack的用户,并设

密码为adminopenstack。并设置权限成为管理员(成集群后,cont02和cont03上也可以登录)4.10 发送cont01上的erlang.cookie到其他节点配置集群4.11 cont01、cont03、mon01停止应用,并ram的

方式加入cont01节点,之后重启应用(先查看cont01集群名字)4.12 检测集群状态4.13 为了保持rabbitmq的消息一致性,可以设置消息镜像模式策略 所有节点执行4.14 RabbitMQ注意小计(故障恢

复提示):5、部署PCS5.1 安装pcs+pacemaker+corosync (cont01、cont02和 cont03)5.2 设置集群密码,而且三个节点密码需一直为:pcs#typora5.3 控制节点创建配置文件corosync.conf5.4 配

置集群,设置集群互相认证5.5 配置节点认证5.6 创建集群5.7 启动集群并查看集群状态5.8 检验corosync状态5.9 创建集群VIP (预设VIP地址为192.168.10.20)6、部署Haproxy6.1 所有控制节点安

装Haproxy,并保持相同的配置,对于配置文件,建议根据实际情况进行优化。6.1.1安装并配置haproxy6.2 配置Haproxy能监控Galera数据库集群6.3 开启haproxy,并自启动(cont01、cont02、

cont03)6.4 登陆http://192.168.10.20:8789/ 检测状态 默认账户:admin 密码:admin7、部署Keystone7.1 控制节点安装Enable the OpenStack repository(cont01和cont02)7.2 控制节点安装 SQL

database(cont01和cont02)7.3 安装Memcached (cont01、cont02和cont03)7.4 configure the Identity service7.5 Install and configure components7.6 Configure the Apache HTTP server [cont0$表示

cont01、cont02和cont03]7.7 Create a domain, projects, users, and roles

1、前期准备、前期准备

1.1 软硬件准备软硬件准备

控制主机三台(三网卡)+计算节点三台(双网卡、兼分布式存储OSD)+存储节点一台(双网卡部署MOD)

1.1.1组件组件

组件组件 版本版本 备注备注

CentOS

CentOS Linux release 7.7.1908

(Core)

Openstack Rocky

Ceph

ceph version 12.2.12 luminous

(stable)

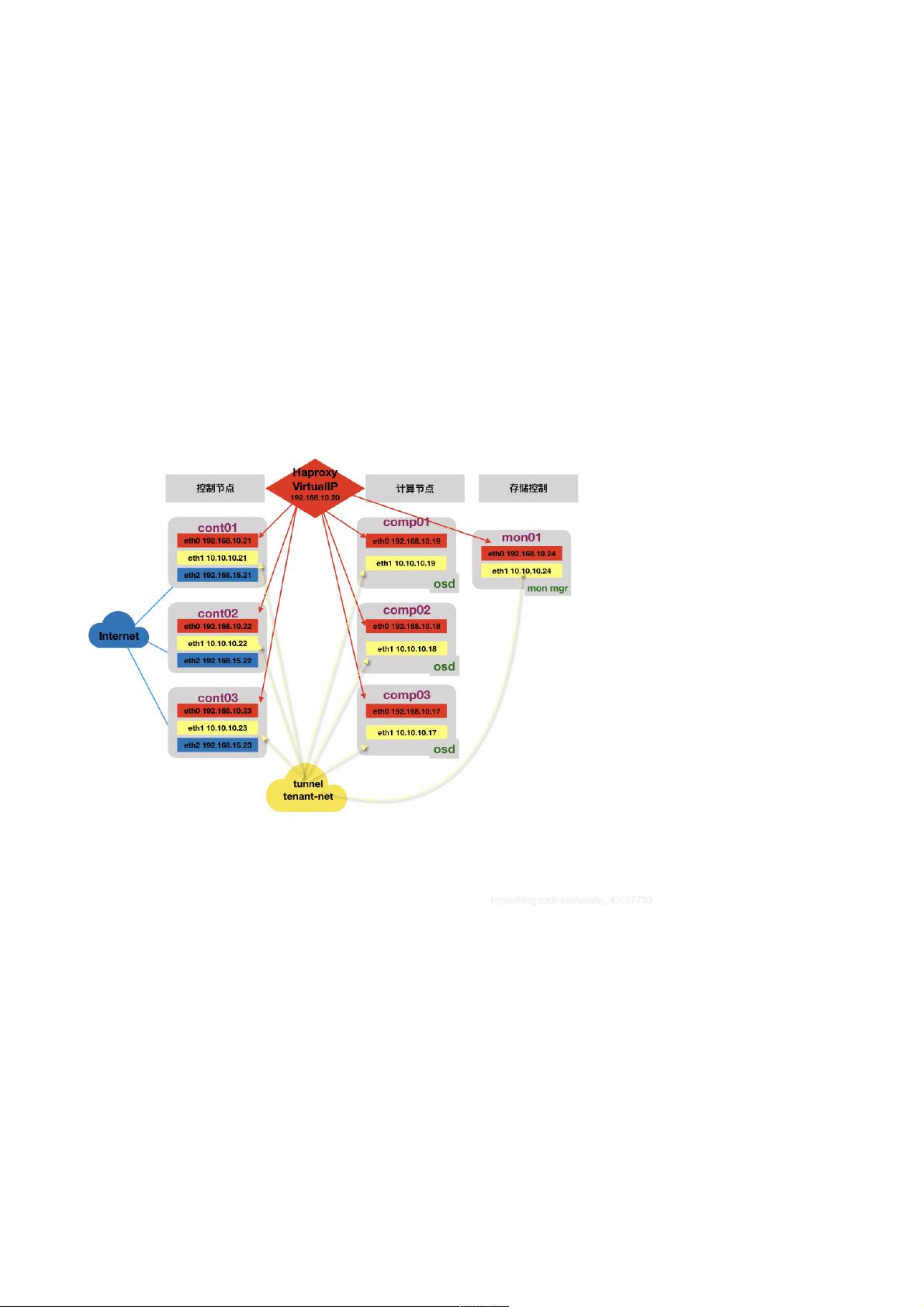

1.1.2 网络拓扑(逻辑)网络拓扑(逻辑)

1.控制节点(cont01、cont02、cont03)运行MariaDB galeria,Haproxy,pacemaker,corosync,keystone, glance,horizon,nova&neutron&cinder管理相关组件和openstack相关的基础服务

2.计算节点(comp01、comp02、comp03)运行Nova-compute,neutron-openswitch-agent,ceph-osd等

3.存储控制节点(mon01)运行ceph-mon,ceph-mgr(如生产环境,建议也采用三个节点部署)

4.控制节点网络:

管理网络–>eth0:192.168.10.0/24 用于对openstack集群host os,api等网络管理

租户隧道VM网络–>eth1:10.10.10.0/24 用于集群内部的guest os之间的数据交换,采用vxlan/gre等方式

外部External网络–>eth2:主要用户计算节点访问internet/外部的floating ip

ps:此处的管理网络合并Management网络+API网络

5.计算节点网络:

管理网络–>eth0:192.168.10.0/24 用于对openstack集群host os,api等网络管理,

租户隧道网络–>eth1:10.10.10.0/24 用于集群内部的guest os之间的数据交换,采用vxlan/gre等方式

6.前端采用Haproxy做高可用,数据库采用MariaDB galeria,存储采用ceph分布式存储集群

7.无状态的服务,如xxx-api,采取active/active的模式运行;有状态的服务,如neturon-xxx-agent,cinder-volume等,建议采取active/passive的模式运行(因前端采用haproxy,客户端的多次请求可

能会被转发到不同的控制节点,如果客户端请求被负载到无状态信息的控制节点,可能会导致操作请求失败);自身具有集群机制的服务,如rabbitmq,memcached等采用本身的集群机制。

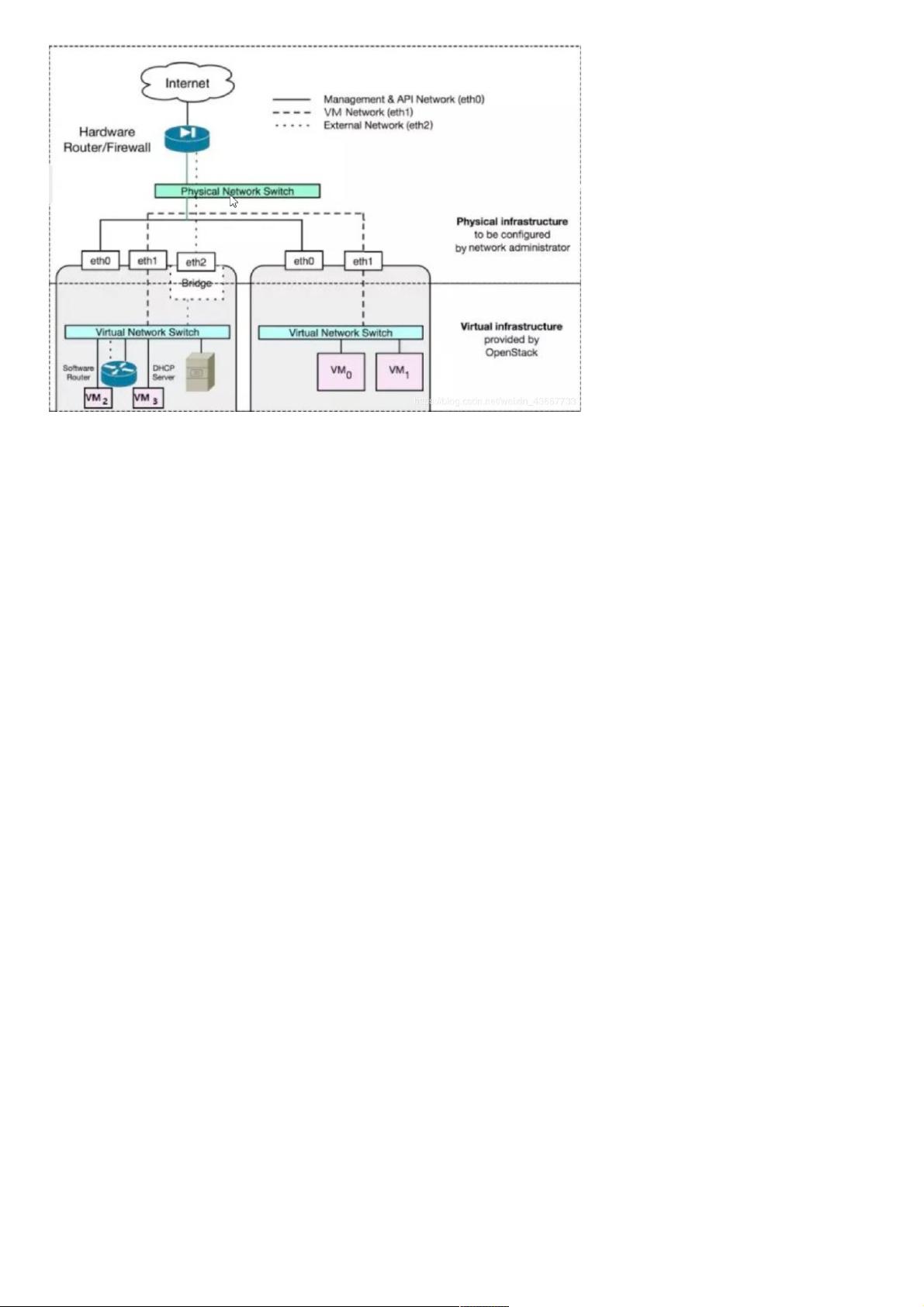

1.1.3 物理拓扑(部分参考)物理拓扑(部分参考)

1.2 配置配置hosts文件文件(集群所有电脑配置集群所有电脑配置)

[root@cont02:/root]# vim /etc/hosts

192.168.10.21 cont01

192.168.10.22 cont02

192.168.10.23 cont03

192.168.10.20 VirtualIP

192.168.10.24 mon01

192.168.10.19 comp01

192.168.10.18 comp02

192.168.10.17 comp03

[root@cont02:/root]# scp /etc/hosts cont02:/etc/

[root@cont02:/root]# scp /etc/hosts cont03:/etc/

[root@cont02:/root]# scp /etc/hosts mon01:/etc/

[root@cont02:/root]# scp /etc/hosts comp01:/etc/

[root@cont02:/root]# scp /etc/hosts comp02:/etc/

[root@cont02:/root]# scp /etc/hosts comp03:/etc/

1.3 节点间设置免密互相登陆节点间设置免密互相登陆

[root@cont01:/root]# ssh-keygen

ssh-copy-id cont02

ssh-copy-id cont03

ssh-copy-id mon01

ssh-copy-id comp01

ssh-copy-id comp02

ssh-copy-id comp03

[root@cont02:/root]# ssh-keygen

ssh-copy-id cont01

ssh-copy-id cont03

ssh-copy-id mon01

ssh-copy-id comp01

ssh-copy-id comp02

ssh-copy-id comp03

[root@cont03:/root]# ssh-keygen

ssh-copy-id cont01

ssh-copy-id cont02

ssh-copy-id mon01

ssh-copy-id comp01

ssh-copy-id comp02

ssh-copy-id comp03

1.4 配置配置NTP服务服务

1.4.1 在控制节点进行配置(在控制节点进行配置(cont01、、cont02、、cont03))

[root@cont02:/root]# yum install system-config-date -y

[root@cont02:/root]# vim /etc/chrony.conf

3 server 0.centos.pool.ntp.org iburst

4 server 192.168.10.21 iburst

5 server 192.168.10.22 iburst

6 server 192.168.10.23 iburst

25 # Allow NTP client access from local network.

26 allow 192.168.0.0/16

[root@cont02:/root]# scp /etc/chrony.conf cont01:/etc/chrony.conf

[root@cont02:/root]# scp /etc/chrony.conf cont03:/etc/chrony.conf

[root@cont01:/root]# systemctl enable chronyd && systemctl restart chronyd

[root@cont01:/root]# systemctl status chronyd

[root@cont02:/root]# systemctl enable chronyd && systemctl restart chronyd

[root@cont02:/root]# systemctl status chronyd

[root@cont03:/root]# systemctl enable chronyd && systemctl restart chronyd

[root@cont03:/root]# systemctl status chronyd

[root@cont01:/root]# chronyc sources

210 Number of sources = 3

MS Name/IP address Stratum Poll Reach LastRx Last sample

===============================================================================

^? cont02 0 7 0 - +0ns[ +0ns] +/- 0ns

^? cont03 0 7 0 - +0ns[ +0ns] +/- 0ns

^* 119.28.206.193 2 6 37 21 +197us[+1847us] +/- 55ms

[root@cont02:/root]# chronyc sources

210 Number of sources = 3

MS Name/IP address Stratum Poll Reach LastRx Last sample

===============================================================================

^? cont01 0 7 0 - +0ns[ +0ns] +/- 0ns

^? cont03 0 7 0 - +0ns[ +0ns] +/- 0ns

^* 162.159.200.123 3 6 37 51 +2273us[ +143us] +/- 121ms [root@cont03:/root]# chronyc sources

210 Number of sources = 3

MS Name/IP address Stratum Poll Reach LastRx Last sample

===============================================================================

^? cont01 0 8 0 - +0ns[ +0ns] +/- 0ns

^? cont02 0 8 0 - +0ns[ +0ns] +/- 0ns

^? tick.ntp.infomaniak.ch 0 8 0 - +0ns[ +0ns] +/- 0ns [root@cont02:/root]# ssh cont01 'date'; ssh cont03 'date' ; date

Tue Feb 11 20:32:16 CST 2020

Tue Feb 11 20:32:16 CST 2020

Tue Feb 11 20:32:16 CST 2020

1.4.2 在其他节点上安装在其他节点上安装NTP软件(软件(mon01、、comp01、、comp02、、comp03))

[root@mon01:/root]# yum install chrony -y

[root@comp01:/root]# yum install chrony -y

[root@comp02:/root]# yum install chrony -y

[root@comp03:/root]# yum install chrony -y

[root@mon01:/root]# vim /etc/chrony.conf

3 server 192.168.10.22 iburst

4 server 192.168.10.21 iburst

5 server 192.168.10.23 iburst

6 #server 3.centos.pool.ntp.org iburst

[root@comp01:/root]# vim /etc/chrony.conf

3 server 192.168.10.22 iburst

4 server 192.168.10.21 iburst

5 server 192.168.10.23 iburst

6 #server 3.centos.pool.ntp.org iburst [root@comp02:/root]# vim /etc/chrony.conf

3 server 192.168.10.22 iburst

4 server 192.168.10.21 iburst

5 server 192.168.10.23 iburst

6 #server 3.centos.pool.ntp.org iburst

[root@comp03:/root]# vim /etc/chrony.conf

3 server 192.168.10.22 iburst

4 server 192.168.10.21 iburst

5 server 192.168.10.23 iburst

6 #server 3.centos.pool.ntp.org iburst

[root@mon01:/root]# systemctl enable chronyd && systemctl restart chronyd

[root@mon01:/root]# systemctl status chronyd

[root@comp01:/root]# systemctl enable chronyd && systemctl restart chronyd

[root@comp01:/root]# systemctl status chronyd

[root@comp02:/root]# systemctl enable chronyd && systemctl restart chronyd

[root@comp02:/root]# systemctl status chronyd

[root@comp03:/root]# systemctl enable chronyd && systemctl restart chronyd

[root@comp03:/root]# systemctl status chronyd [root@mon01:/root]# chronyc sources

210 Number of sources = 3

MS Name/IP address Stratum Poll Reach LastRx Last sample

===============================================================================

^? cont02 0 7 0 - +0ns[ +0ns] +/- 0ns

^? cont01 0 7 0 - +0ns[ +0ns] +/- 0ns

^? cont03 0 7 0 - +0ns[ +0ns] +/- 0ns

[root@mon01:/root]# timedatectl

Local time: Wed 2020-01-15 11:22:23 CST

Universal time: Wed 2020-01-15 03:22:23 UTC

RTC time: Wed 2020-01-15 03:22:24

Time zone: Asia/Shanghai (CST, +0800)

NTP enabled: yes

NTP synchronized: no

RTC in local TZ: no

DST active: n/a

[root@comp01:/root]# chronyc sources

210 Number of sources = 3

MS Name/IP address Stratum Poll Reach LastRx Last sample

===============================================================================

^? cont02 0 7 0 - +0ns[ +0ns] +/- 0ns

^? cont01 0 7 0 - +0ns[ +0ns] +/- 0ns

^? cont03 0 7 0 - +0ns[ +0ns] +/- 0ns

[root@comp01:/root]# timedatectl

Local time: Wed 2020-01-15 11:22:24 CST

Universal time: Wed 2020-01-15 03:22:24 UTC

RTC time: Wed 2020-01-15 03:22:24

Time zone: Asia/Shanghai (CST, +0800)

NTP enabled: yes

NTP synchronized: no

RTC in local TZ: no

DST active: n/a

[root@comp02:/root]# chronyc sources

210 Number of sources = 3

MS Name/IP address Stratum Poll Reach LastRx Last sample

===============================================================================

^? cont02 0 7 0 - +0ns[ +0ns] +/- 0ns

^? cont01 0 7 0 - +0ns[ +0ns] +/- 0ns

^? cont03 0 7 0 - +0ns[ +0ns] +/- 0ns

[root@comp02:/root]# timedatectl

Local time: Wed 2020-01-15 11:22:24 CST

Universal time: Wed 2020-01-15 03:22:24 UTC

RTC time: Wed 2020-01-15 03:22:24

Time zone: Asia/Shanghai (CST, +0800)

NTP enabled: yes

NTP synchronized: no

RTC in local TZ: no

DST active: n/a

1.5 系统初始设置系统初始设置

1.5.1 所有节点关闭防火墙和所有节点关闭防火墙和selinux

systemctl stop firewalld && systemctl disable firewalld

setenforce 0

sed -i 's/SELINUX=enforcing/SELINUX=permissive/' /etc/selinux/config

1.5.2 所有节点编辑limits.conf和sysctl.conf文件

cat >>/etc/security/limits.conf<>/etc/sysctl.conf<<eof

fs.file-max=655350

net.ipv4.ip_local_port_range = 1025 65000

net.ipv4.tcp_tw_recycle = 1

net.ipv4.ip_nonlocal_bind = 1

eof

sysctl -p

2、部署、部署MariaDB Galeria集群集群

2.1 控制节点安装控制节点安装mariadb(cont01、、cont02、、cont03)

Galera是Galera Cluster,是一种为数据库设计的新型的、数据不共享的、高度冗余的高可用方案,galera mariadb就是集成了Galera插件的MariaDB集群,Galera本身是具有多主特性的,所以galera

mariadb不是传统的主备模式的集群,而是多主节点架构。

2.1.1 控制节点添加控制节点添加mariadb-10.4.11的的yum源源

[root@cont01:/root]# vim /etc/yum.repos.d/mariadb.repo

[mariadb] name = MariaDB

baseurl = http://mirror.netinch.com/pub/mariadb//mariadb-10.4.11/yum/centos7-amd64/

gpgcheck = 0

enabled = 1

剩余19页未读,继续阅读

weixin_38732811

- 粉丝: 6

- 资源: 958

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0