没有合适的资源?快使用搜索试试~ 我知道了~

nlp中的实体关系抽取方法总结

32 下载量 24 浏览量

2021-02-24

02:21:31

上传

评论 1

收藏 1.75MB PDF 举报

温馨提示

试读

18页

Q1:与联合抽取对比,Pipeline方法有哪些缺点?Q2:NER除了LSTM+CRF,还有哪些解码方式?如何解决嵌套实体问题?Q3:Pipeline中的关系分类有哪些常用方法?如何应用弱监督和预训练机制?怎么解决高复杂度问题、进行one-pass关系分类?Q4:什么是关系重叠问题?Q5:联合抽取难点在哪里?联合抽取总体上有哪些方法?各有哪些缺点?Q6:介绍基于共享参数的联合抽取方法?Q7:介绍基于联合解码的联合抽取方法?Q8:实体关系抽取的前沿技术和挑战有哪些?如何解决低资源和复杂样本下的实体关系抽取?如何应用图神经网络?彩蛋:百度2020关系抽取比赛的baseline可以采取哪些方法?实体

资源推荐

资源详情

资源评论

nlp中的实体关系抽取方法总结中的实体关系抽取方法总结

Question List

Q1:与联合抽取对比,Pipeline方法有哪些缺点?

Q2:NER除了LSTM+CRF,还有哪些解码方式?如何解决嵌套实体问题?

Q3:Pipeline中的关系分类有哪些常用方法?如何应用弱监督和预训练机制?怎么解决高复杂度问题、进行one-pass关系分

类?

Q4:什么是关系重叠问题?

Q5:联合抽取难点在哪里?联合抽取总体上有哪些方法?各有哪些缺点?

Q6:介绍基于共享参数的联合抽取方法?

Q7:介绍基于联合解码的联合抽取方法?

Q8:实体关系抽取的前沿技术和挑战有哪些?如何解决低资源和复杂样本下的实体关系抽取?如何应用图神经网络?

彩蛋:百度2020关系抽取比赛的baseline可以采取哪些方法?

实体关系抽取(Entity and Relation Extraction,ERE)是信息抽取的关键任务之一。ERE是级联任务,分为两个子任务:实

体抽取和关系抽取,如何更好处理这种类似的级联任务是NLP的一个热点研究方向。

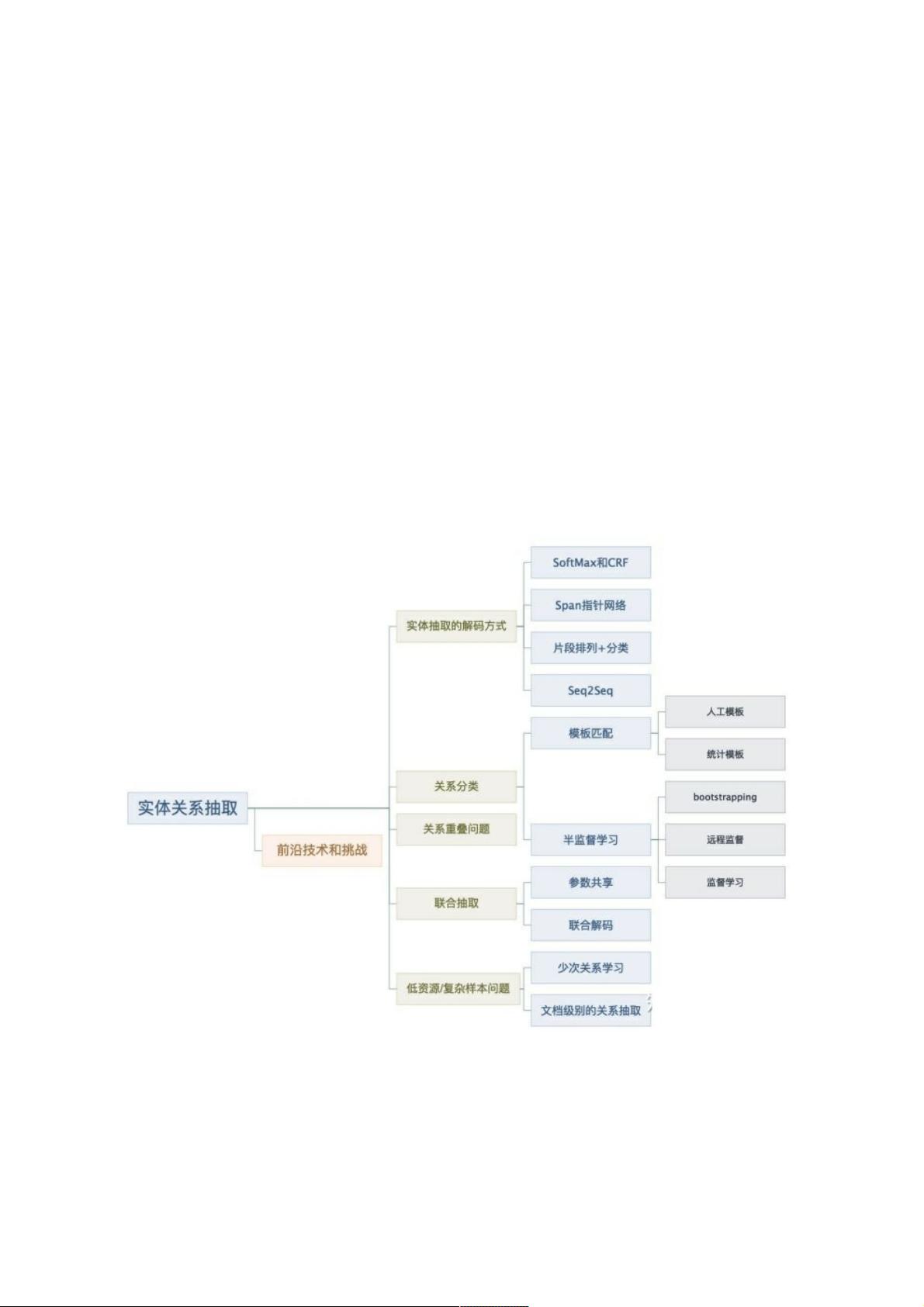

本文结构

Q1:与联合抽取对比,Pipeline方法有哪些缺点?

Pipeline方法指先抽取实体、再抽取关系。相比于传统的Pipeline方法,联合抽取能获得更好的性能。虽然Pipeline方法易于实

现,这两个抽取模型的灵活性高,实体模型和关系模型可以使用独立的数据集,并不需要同时标注实体和关系的数据集。但存

在以下缺点:

误差积累:实体抽取的错误会影响下一步关系抽取的性能。

实体冗余:由于先对抽取的实体进行两两配对,然后再进行关系分类,没有关系的候选实体对所带来的冗余信息,会提升错误

率、增加计算复杂度。

交互缺失:忽略了这两个任务之间的内在联系和依赖关系。

(基于共享参数的联合抽取方法仍然存在训练和推断时的gap,推断时仍然存在误差积累问题,可以说只是缓解了误差积累问

题。)

Q2:NER除了LSTM+CRF,还有哪些解码方式?如何解决嵌套实体问题?

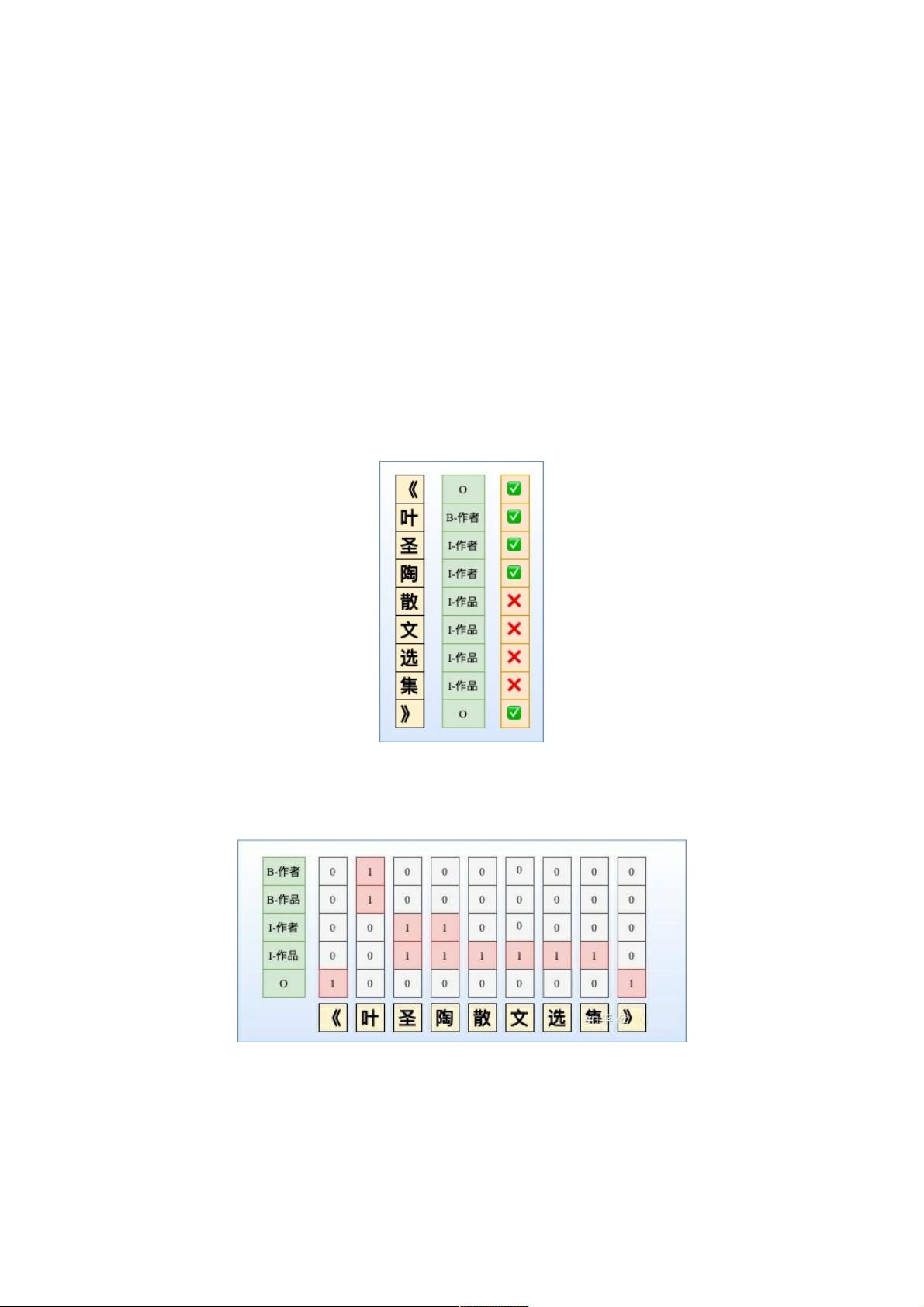

虽然NER是一个比较常见的NLP任务,通常采用LSTM+CRF处理一些简单NER任务。NER还存在嵌套实体问题(实体重叠问

题),如「《叶圣陶散文选集》」中会出现两个实体「叶圣陶」和「叶圣陶散文选集」分别代表「作者」和「作品」两个实

体。而传统做法由于每一个token只能属于一种Tag,无法解决这类问题。笔者尝试通过归纳几种常见并易于理解的 实体抽取

解码方式 来回答这个问题。

1、序列标注:SoftMax和CRF

本质上是token-level 的多分类问题,通常采用CNNs/RNNs/BERT+CRF处理这类问题。与SoftMax相比,CRF进了标签约束。

对这类方法的改进,介绍2篇比较有价值的工作:

针对CRF解码慢的问题,LAN[1]提出了一种逐层改进的基于标签注意力机制的网络,在保证效果的前提下比 CRF 解码速度更

快。文中也发现BiLSTM-CRF在复杂类别情况下相比BiLSTM-softmax并没有显著优势。

由于分词边界错误会导致实体抽取错误,基于LatticeLSTM[2]+CRF的方法可引入词汇信息并避免分词错误(词汇边界通常为

实体边界,根据大量语料构建词典,若当前字符与之前字符构成词汇,则从这些词汇中提取信息,联合更新记忆状态)。

但由于这种序列标注采取BILOU标注框架,每一个token只能属于一种,不能解决重叠实体问题,如图所示。

基于BILOU标注框架,笔者尝试给出了2种改进方法去解决实体重叠问题:

改进方法1:采取token-level 的多label分类,将SoftMax替换为Sigmoid,如图所示。当然这种方式可能会导致label之间依赖

关系的缺失,可采取后处理规则进行约束。

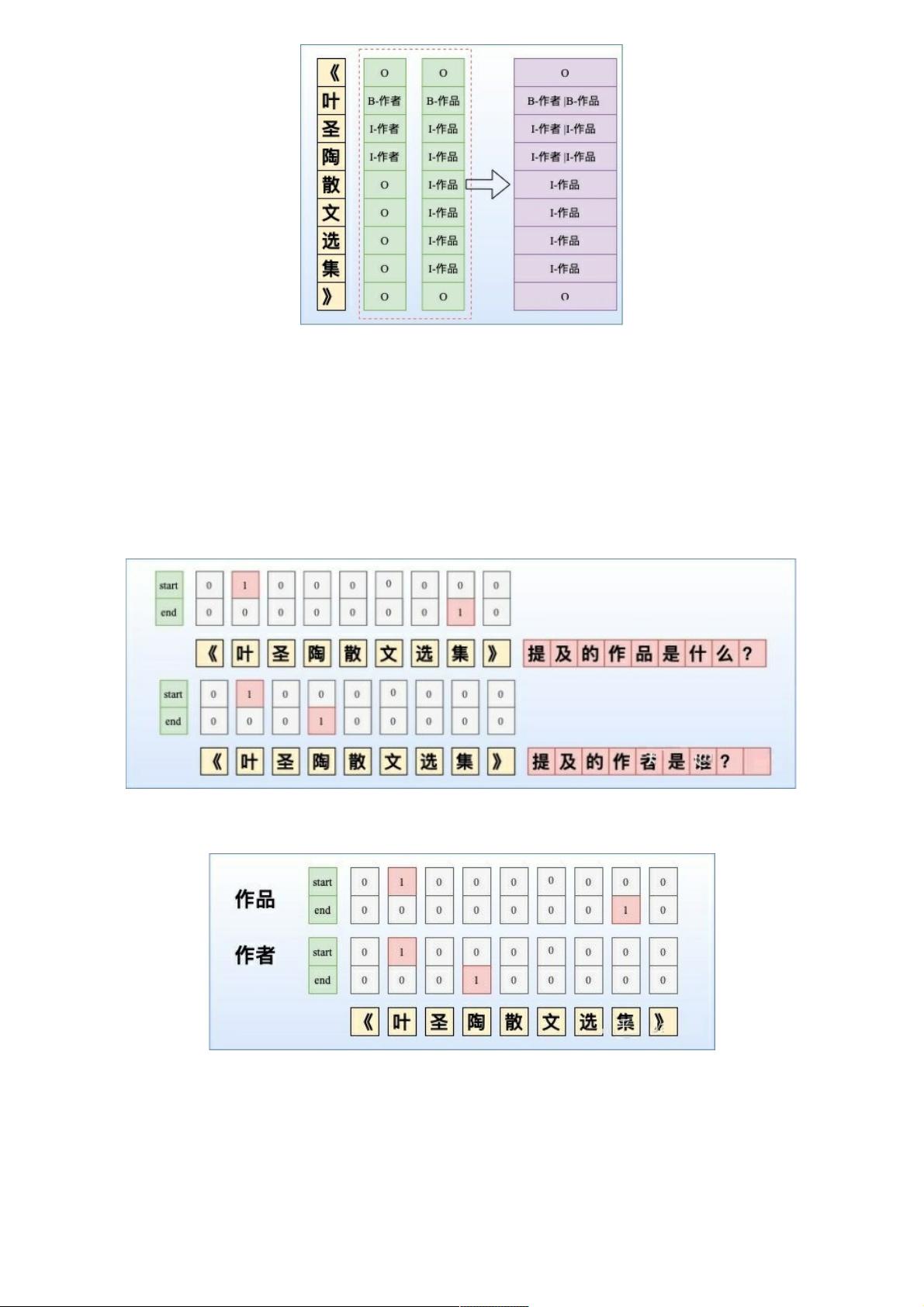

改进方法2:依然采用CRF,但设置多个标签层,对于每一个token给出其所有的label,然后将所有标签层合并。显然这可能

会增加label数量[3],导致label不平衡问题。基于这种方式,文献[4]也采取先验图的方式去解决重叠实体问题。

2、Span抽取:指针网络

指针网络(PointerNet)最早应用于MRC中,而MRC中通常根据1个question从passage中抽取1个答案片段,转化为2个n元

SoftMax分类预测头指针和尾指针。对于NER可能会存在多个实体Span,因此需要转化为n个2元Sigmoid分类预测头指针和尾

指针。

将指针网络应用于NER中,可以采取以下两种方式:

第一种:MRC-QA+单层指针网络。在ShannonAI的文章中[5],构建query问题指代所要抽取的实体类型,同时也引入了先验

语义知识。如图所示,由于构建query问题已经指代了实体类型,所以使用单层指针网络即可;除了使用指针网络预测实体开

始位置、结束位置外,还基于开始和结束位置对构成的所有实体Span预测实体概率[6]。此外,这种方法也适合于给定事件类

型下的事件主体抽取,可以将事件类型当作query,也可以将单层指针网络替换为CRF。

第二种:多层label指针网络。由于只使用单层指针网络时,无法抽取多类型的实体,我们可以构建多层指针网络,每一层都

对应一个实体类型。

需要注意的是:

1)MRC-QA会引入query进行实体类型编码,这会导致需要对愿文本重复编码输入,以构造不同的实体类型query,这会提升

计算量。

2)笔者在实践中发现,n个2元Sigmoid分类的指针网络,会导致样本Tag空间稀疏,同时收敛速度会较慢,特别是对于实体

span长度较长的情况。

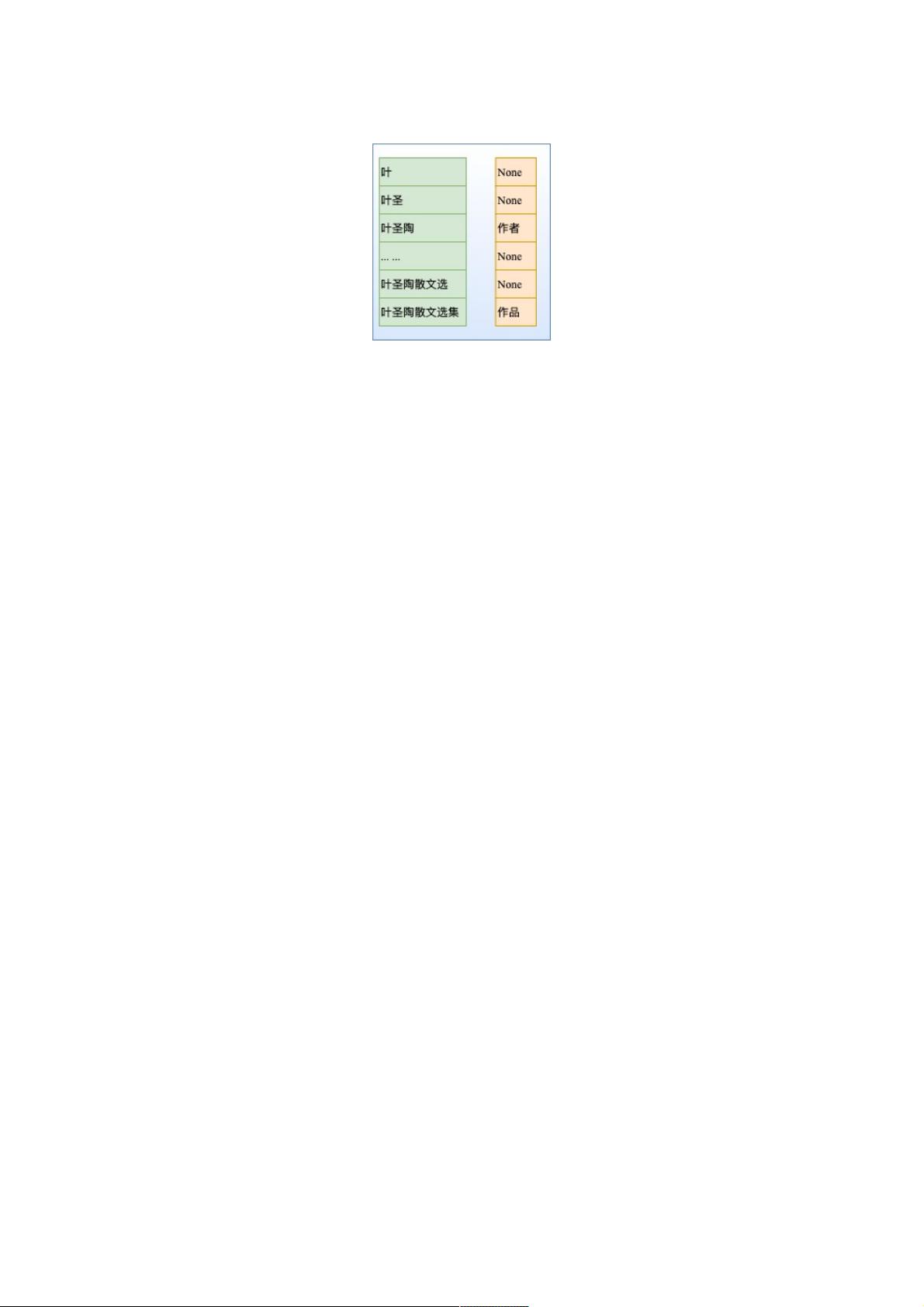

3、片段排列+分类

上述序列标注和Span抽取的方法都是停留在token-level进行NER,间接去提取span-level的特征。而基于片段排列的方式[7],

显示的提取所有可能的片段排列,由于选择的每一个片段都是独立的,因此可以直接提取span-level的特征去解决重叠实体问

题。

对于含T个token的文本,理论上共有 [公式] 种片段排列。如果文本过长,会产生大量的负样本,在实际中需要限制span长度

并合理削减负样本。

需要注意的是:

实体span的编码表示:在span范围内采取注意力机制与基于原始输入的LSTM编码进行交互。然后所有的实体span表示并行

的喂入SoftMax进行实体分类。

这种片段排列的方式对于长文本复杂度是较高的。

4、Seq2Seq:

ACL2019的一篇paper中采取Seq2Seq方法[3],encoder部分输入的原文tokens,而decoder部分采取hard attention方式one-

by-one预测当前token所有可能的tag label,直至输出<eow> (end of word) label,然后转入下一个token再进行解码。

Q3:Pipeline中的关系分类有哪些常用方法?如何应用弱监督和预训练机制?怎么解决高复杂度问题、进行one-pass关系分

类?

(注:Pipeline方法中,关系抽取通常转化为一个分类问题,笔者这里称之为「关系分类」)

1、模板匹配:是关系分类中最常见的方法,使用一个模板库对输入文本两个给定实体进行上下文匹配,如果满足模板对应关

系,则作为实体对之间的关系。常见的模板匹配方法主要包括:

人工模板:主要用于判断实体间是否存在上下位关系。上下位关系的自然语言表达方式相对有限,采用人工模板就可以很好完

成关系分类。但对于自然语言表达形式非常多的关系类型而言,这就需要采取统计模板。

统计模板:无须人工构建,主要基于搜索引擎进行统计模板抽取。具体地,将已知实体对作为查询语句,抓取搜索引擎返回的

前n个结果文档并保留包含该实体对的句子集合,寻找包含实体对的最长字串作为统计模板,保留置信度较高的模板用于关系

分类。

基于模板匹配的关系分类构建简单、适用于小规模特定领域,但召回率低、可移植性差,当遇到另一个领域的关系分类需要重

新构建模板。

2、半监督学习

bootstrapping(自举):利用少量的实例作为初始种子集合,然后在种子集合上学习获得关系抽取的模板,再利用模板抽取

更多的实例,加入种子集合中并不断迭代。

bootstrapping比较常见的方法有DIPRE和Snowball。和DIPRE相比,Snowball通过对获得的模板pattern进行置信度计算,一

定程度上可以保证抽取结果质量。

bootstrapping的优点构建成本低,适合大规模的关系任务并且具备发现新关系的能力,但也存在对初始种子较为敏感、存在

语义漂移、准确率等问题。

远程监督:其主要的基本假设是,如果一个实体对满足某个给定关系,那么同时包含该实体对的所有句子(构成一个Bag)都

可能在阐述该关系。可以看出,该假设是一个非常强的假设,实际上很多包含该实体对的句子并不代表此种关系,会引入大量

噪声。为了缓解这一问题,主要采取「多示例学习」、「强化学习」和「预训练机制」:

(1)多示例学习:主要基于Bag的特征进行关系分类,主要代表文献包括PCNN[8]、Selective Attention over Instances[9]、

Multi-label CNNs[10]、APCNNs[11],其中Bag的表示主要方式和池化方式为:

剩余17页未读,继续阅读

资源评论

weixin_38618819

- 粉丝: 4

- 资源: 894

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功