没有合适的资源?快使用搜索试试~ 我知道了~

Paddle源码阅读报告-第二组-05081

需积分: 0 0 下载量 179 浏览量

2022-08-08

18:00:55

上传

评论

收藏 2.5MB DOCX 举报

温馨提示

试读

30页

1.fc:构建全连接层2.embedding:取出自己的embedding数据中的对应索引数据3.linear_chain_crf:实现了线性链条件随机场(li

资源详情

资源评论

资源推荐

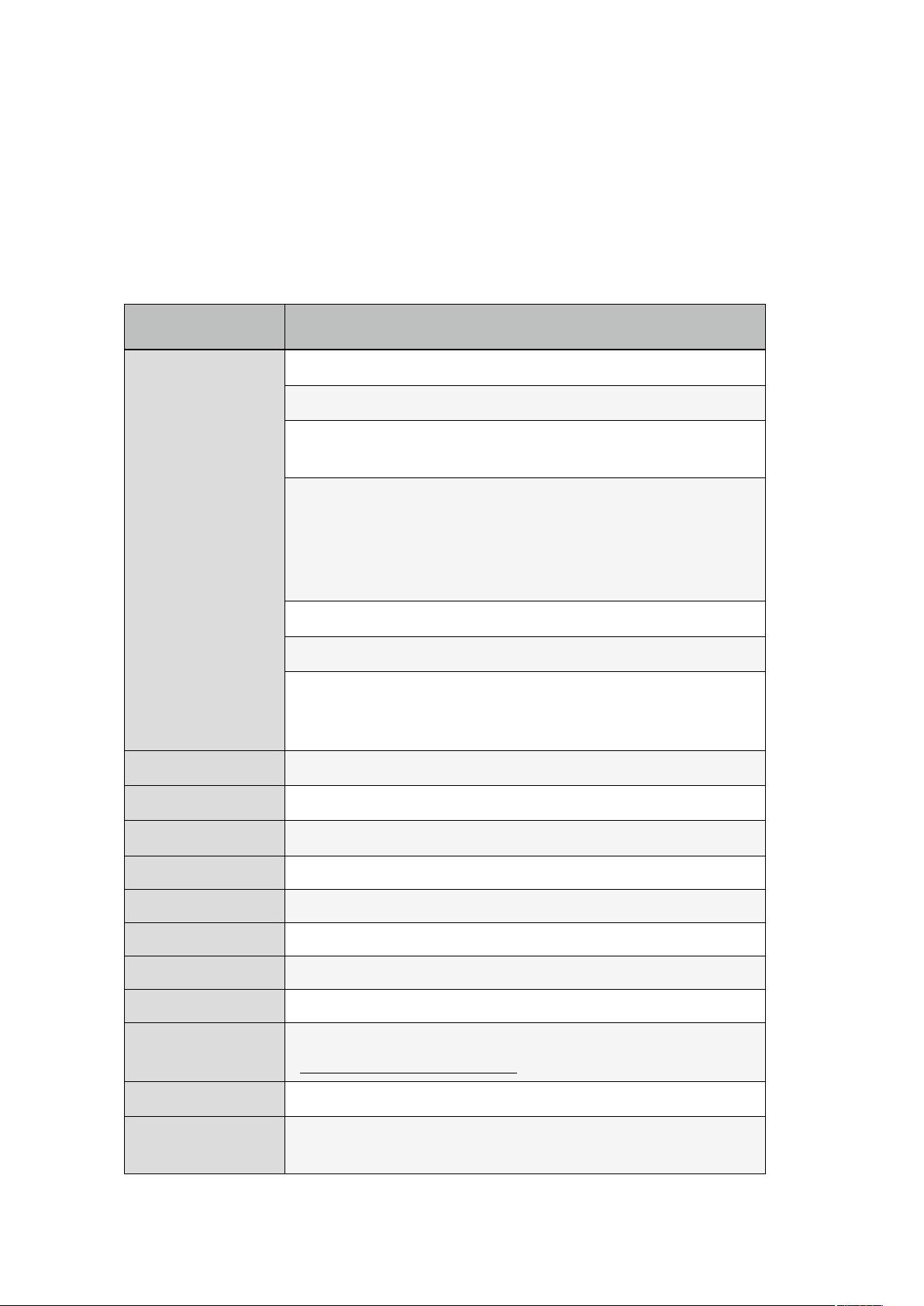

Paddle 模块介绍和分析

倪子烜:

1.代码总结与梳理:

要求:文字分条目列出,描述不少于 200 字,模块不少于 7 个

代码整体认识描述

代码模块或主要组成总结

1.fc:构建全连接层

2.embedding:取出自己的 embedding 数据中的对应索引数据

3.linear_chain_crf:实现了线性链条件随机场(linear chain CRF)的前

向—反向算法,主要用于 NLP。

4.crf_decoding:该层读取由 linear_chain_crf 学习的 emission feature

weights(发射状态特征的权重)和 transition feature weights (转移特

征的权重) 进行解码。 本层实现了 Viterbi 算法,可以动态地寻找隐藏

状态最可能的序列,该序列也被称为 Viterbi 路径(Viterbi path),从

而得到观察标签 (tags) 序列。

5.cos_sim:实现了余弦相似度算子(Cosine Similarity Operator)

6.dropout:实现 dropout 操作。

fluid.layers.nn 函数库

主要功能就是定义了

神经网络中的大量计

算操作(op),其中总

共有 147 个函数。

7.chunk_eval:计算语块识别(chunk detection)的准确率、召回率和

F1 值,常用于命名实体识别(NER,语块识别的一种)等序列标注任

务中。

8.softmax:实现 softmax 操作。

9.conv2d:~

10.conv3d:~

11.pool2d:~

12.pool3d:~

13.adaptive_pool2d:~

14.adaptive_pool3d:~

15.batch_norm:~

16.inplace_abn:一种 activation batch normalization。

<https://arxiv.org/abs/1712.02616>

17.instance_norm:实现实例正则化

18.data_norm:数据正则化,可用作 conv2d 和 fully_connected 操作

的正则化函数

代码整体认识描述

代码模块或主要组成总结

19.layer_norm:层归一化层(Layer Normalization Layer),其可以应用

于小批量输入数据。

20.group_norm:实现 group normalization。

https://arxiv.org/abs/1803.08494

21.spectral_norm:用于计算 fc、conv1d、conv2d、conv3d 层的权重

参数的谱正则值

22.conv2d_transpose:二维转置卷积层(Convlution2D transpose

layer)

23.conv3d_transpose:三维转置卷基层

24.reduce_sum:对指定维度上的 Tensor 元素进行求和运算,并输出

相应的计算结果。

25.reduce_mean:对指定维度上的 Tensor 元素进行平均值算,并输

出相应的计算结果。

26.reduce_max:对指定维度上的 Tensor 元素求最大值运算,并输出

相应的计算结果。

27.reduce_min:对指定维度上的 Tensor 元素求最小值运算,并输出

相应的计算结果。

28.reduce_prod:对指定维度上的 Tensor 元素进行求乘积运算,并输

出相应的计算结果。

29.reduce_all:对指定维度上的 Tensor 元素进行与逻辑(&)计算,

并输出相应的计算结果。

30.reduce_any:对指定维度上的 Tensor 元素进行或逻辑(|)计算,

并输出相应的计算结果。

31.split:将输入 Tensor 分割成多个子 Tensor。

32.l2_normalize:计算欧几里得距离之和对 x 进行归一化。

33.matmul:矩阵相乘

34.topk:查找输入 Tensor 的最后一维的前 k 个最大项,返回它们的

值和索引。

35.ctc_greedy_decoder:贪婪策略解码序列

36.transpose:对输入的多维 Tensor 进行数据重排

37.im2sequence:使用 filter 扫描输入的 Tensor 并将输入 Tensor 转换

成序列

38.row_conv:行卷积(Row-convolution operator)或称之为超前卷积

(lookahead convolution)https://dyogatama.github.io/

39.multiplex:根据给定的 index 参数,该 OP 从每个输入 Tensor 中选

择特定行构造输出 Tensor。

代码整体认识描述

代码模块或主要组成总结

40.smooth_l1:计算变量 x 和 y 的 smooth L1 loss

41.one_hot:将输入(input)中的每个 id 转换为一个 one-hot 向量

42.autoincreased_step_counter:创建一个自增变量,每个迭代累加

一次,默认首次返回值为 1,默认累加步长为 1。

43.reshape:换形状

44.squeeze:会根据 axes 压缩输入 Tensor 的维度。如果指定了

axes,则会删除 axes 中指定的维度,axes 指定的维度要等于 1。如

果没有指定 axes,那么所有等于 1 的维度都会被删除。

45.unsqueeze:向输入(input)的 shape 中一个或多个位置(axes)

插入维度。

46.lod_reset:根据给定的参数 y 或 target_lod ,重设输入

x (LoDTensor) 的 LoD 信息。

47.lod_append:给 x 的 LoD 添加 level

48.lrn:实现了局部响应正则化层(Local Response Normalization

Layer),用于对局部输入区域正则化,执行一种侧向抑制(lateral

inhibition)。

49.pad:在 Tensor 上填充一个由 pad_value 给出的常数值,填充宽度

由 paddings 指定

50.pad_constant_like:使用 pad_value 填充 y ,填充到每个维度值的

数量由 x 和 y 的形状而指定

51.label_smooth:实现了标签平滑的功能。

52.roi_pool:实现了 roi 池化操作,对非均匀大小的输入执行最大池

化,以获得固定大小的特征映射

53.roi_align:实现 RoIAlign 操作。

54:dice_loss:用来比较预测结果跟标签之间的相似度,通常用于二

值图像分割,即标签为二值,也可以做多标签的分割。

55:image_resize:用于调整一个 batch 中图片的大小

56:resize_bilinear:该 OP 应用双向性插值法调整输入图片的大小,输

出形状按优先级由 actual_shape、out_shape 和 scale 指定。

57.resize_trilinear:该层对输入进行放缩,基于给定的由

actual_shape , out_shape , scale 确定的输出 shape,进

行三线插值。

58.resize_nearest:该 OP 对输入图片进行大小调整,在高度方向宽度

方向进行最邻近插值(nearest neighbor interpolation)操作。

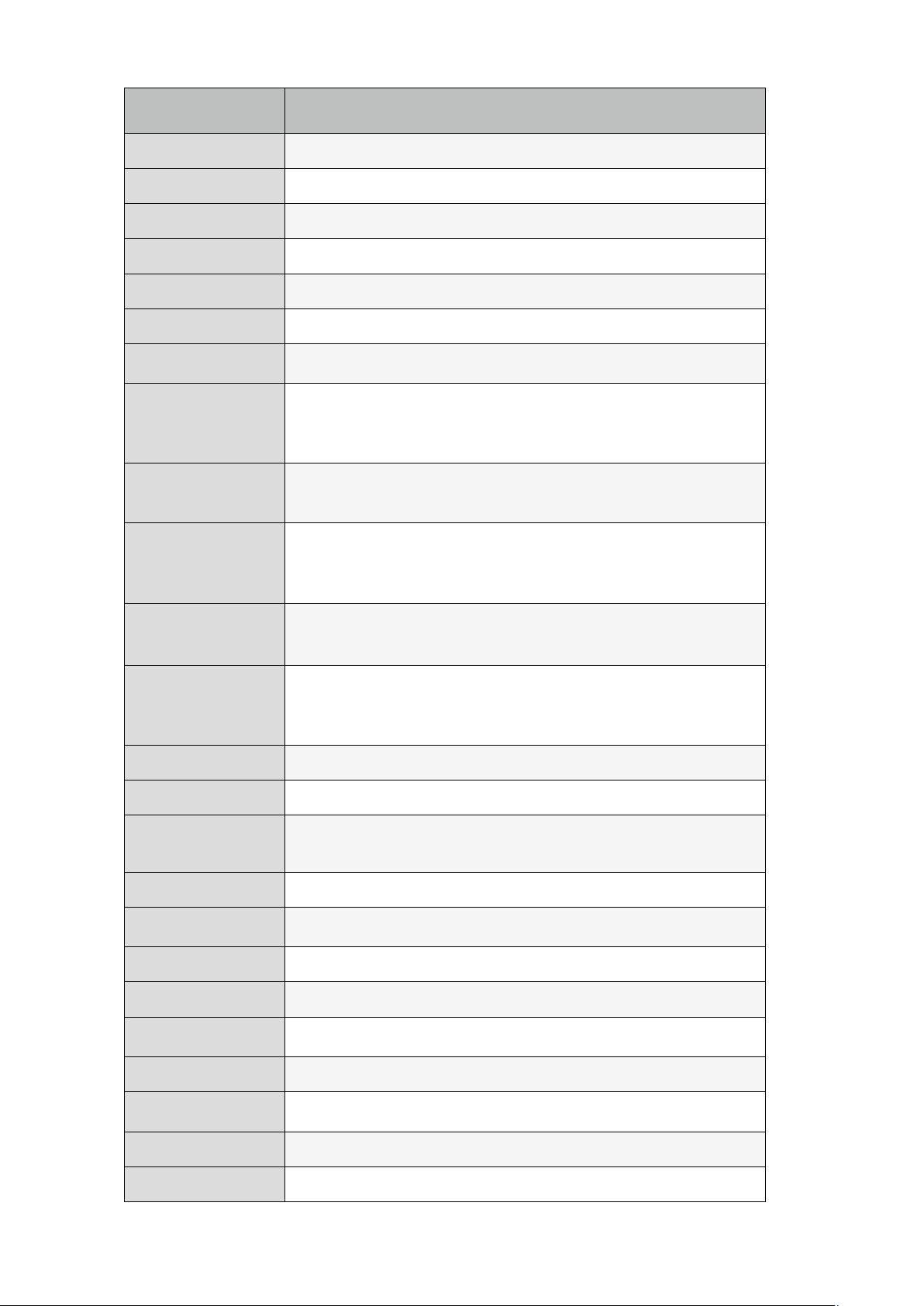

代码整体认识描述

代码模块或主要组成总结

59.image_resize_short:该 OP 用于调整一批图片的大小。输入图像的

短边将被调整为给定的 out_short_len 。输入图像的长边按比例调整大

小,最终图像的长宽比保持不变。

60.gather:根据索引 index 获取输入(input)的最外层维度的条

目,并将它们拼接在一起。

61.gather_nd:该 OP 是 gather 的高维推广,并且支持多轴同时索

引。

62.scatter:该 OP 根据 index 中的索引值将 updates 数据更新到 input

中。

63.scatter_nd_add:该 OP 通过对 Variable 中的单个值或切片应用稀

疏加法,从而得到输出的 Variable。

64.scatter_nd:该 OP 根据 index ,将 updates 添加到一个新

的张量中,从而得到输出的 Variable。

65.random_crop:该操作对 batch 中每个实例进行随机裁剪,即每个

实例的裁剪位置不同,裁剪位置由均匀分布随机数生成器决定。所有

裁剪后的实例都具有相同的维度,由 shape 参数决定。

66.log:实现 log 操作

67.relu:实现 relu 操作

68.selu:实现 SeLU 激活函数

69.mean_iou:该 OP 计算均值 IOU

70.crop:该 OP 根据偏移量(offsets)和形状(shape),裁剪输入张量。

71.crop_tensor:根据偏移量(offsets)和形状(shape),裁剪输入

(x)Tensor。

72.affine_grid:用于生成仿射变换前后的 feature maps 的坐标映射关

系。在视觉应用中,根据该 OP 得到的映射关系,将输入 feature map

的像素点变换到对应的坐标,就得到了经过仿射变换的 feature map。

73.pad2d:该 OP 依照 paddings 和 mode 属性对 input 进行 2 维

pad 。

74.elu:实现 ELU 激活层

75.relu6:实现 relu6 激活操作

76.pow:实现平方操作

77.stanh:STanh 激活算子

78.hard_sigmoid:sigmoid 的分段线性逼近激活函数,速度比

sigmoid 快。 https://arxiv.org/abs/1603.00391。

代码整体认识描述

代码模块或主要组成总结

79.swish:逐元素计算 Swish 激活函数

80.prelu:实现 prelu 操作

81.brelu:实现 BRELU 激活操作

82.leaky_relu:实现 leaky_relu 操作

83.soft_relu:~

84.flatten:输入的多维 Tensor 展平成 2-D Tensor 矩阵

85.stack:沿 axis 轴对输入 x 进行堆叠操作。

86.filter_by_instag:此函数通过 instag 来过滤 ins batch,大量属于同

样的 tags 的样本,我们可以指定我们想要的一些 tags,属于这些

tags 的样本将会被保留在输出中,其余的将会移除。

87.unstack:将单个 dim 为 D 的 Tensor 沿 axis 轴 unpack 为

num 个 dim 为 (D-1) 的 Tensor

88.expand:该 OP 会根据参数 expand_times 对输入 x 的各维

度进行复制。通过参数 expand_times 来为 x 的每个维度设置

复制次数。

89.expand_as:通过 target_tensor 的维度来为 x 的每个维度

设置广播的次数,使得 x 的维度与 target_tensor 的维度相同。

90.uniform_random_batch_size_like:此操作初始化一个变量,该变量

的随机值是从[min, max]范围内的均匀分布中采样的。用于获取输入

维度值的 input_dim_idx 将用于调整输出维度的大小。

91.gaussian_random:实现高斯随机

92.sampling_id:从输入的多项分布中进行采样。

93.gaussian_random_batch_size_like:生成数据符合高斯随机分布的

Tensor。

94.sum:求和

95.slice:沿多个轴生成 input 的切片。

96.strided_slice:与 numpy 的 slice 类似

97.shape:获得输入 Tensor 的 shape。

98.rank:用于计算输入 Tensor 的维度(秩)。

99.size:用于计算输入 tensor 的尺寸

100.scale:缩放算子

101.elementwise_add:是逐元素相加算子

102.elementwise_div:相除

剩余29页未读,继续阅读

湯姆漢克

- 粉丝: 21

- 资源: 304

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0