没有合适的资源?快使用搜索试试~ 我知道了~

chap3-线性模型1

需积分: 0 0 下载量 45 浏览量

2022-08-03

12:12:45

上传

评论

收藏 770KB PDF 举报

温馨提示

试读

26页

第 3 章线性模型正确的判断来自于经验,而经验来自于错误的判断。— Frederick P. Brooks线性模型(Linear Model)是机器学习中应用最

资源详情

资源评论

资源推荐

第 3 章 线性模型

正确的判断来自于经验,而经验来自于错误的判断。

— Frederick P. Brooks

线性模型(Linear Model)是机器学习中应用最广泛的模型,指通过样本

特征的线性组合来进行预测的模型。给定一个

d

维样本

[

x

1

,

···

, x

d

]

T

,其线性组

合函数为

f(x, w) = w

1

x

1

+ w

2

x

2

+ ··· + w

d

x

d

+ b (3.1)

= w

T

x + b, (3.2)

简单起见,这里用 f(x, w) 来

表示 f (x, w, b)。

其中 w = [w

1

, ··· , w

d

]

T

为 d 维的权重向量,b 为偏置。上一章中介绍的线性回

归就是典型的线性模型,直接用 f(x, w) 来预测输出目标 y = f(x, w)。

在分类问题中,由于输出目标 y 是一些离散的标签,而 f(x, w) 的值域为

实数,因此无法直接用 f(x, w) 来进行预测,需要引入一个非线性的决策函数

(decision function)g(·) 来预测输出目标

y = g

f(x, w)

, (3.3)

其中 f(x, w) 也称为判别函数(discriminant function)。

对于两类分类问题,g(·) 可以是符号函数(sign function)

g

f(x, w)

= sgn

f(x, w)

(3.4)

,

+1 if f(x, w) > 0,

−1 if f(x, w) < 0.

(3.5)

当 f(x, w) = 0 时不进行预测。公式 (3.5) 定义了一个典型的两类分类问题的决

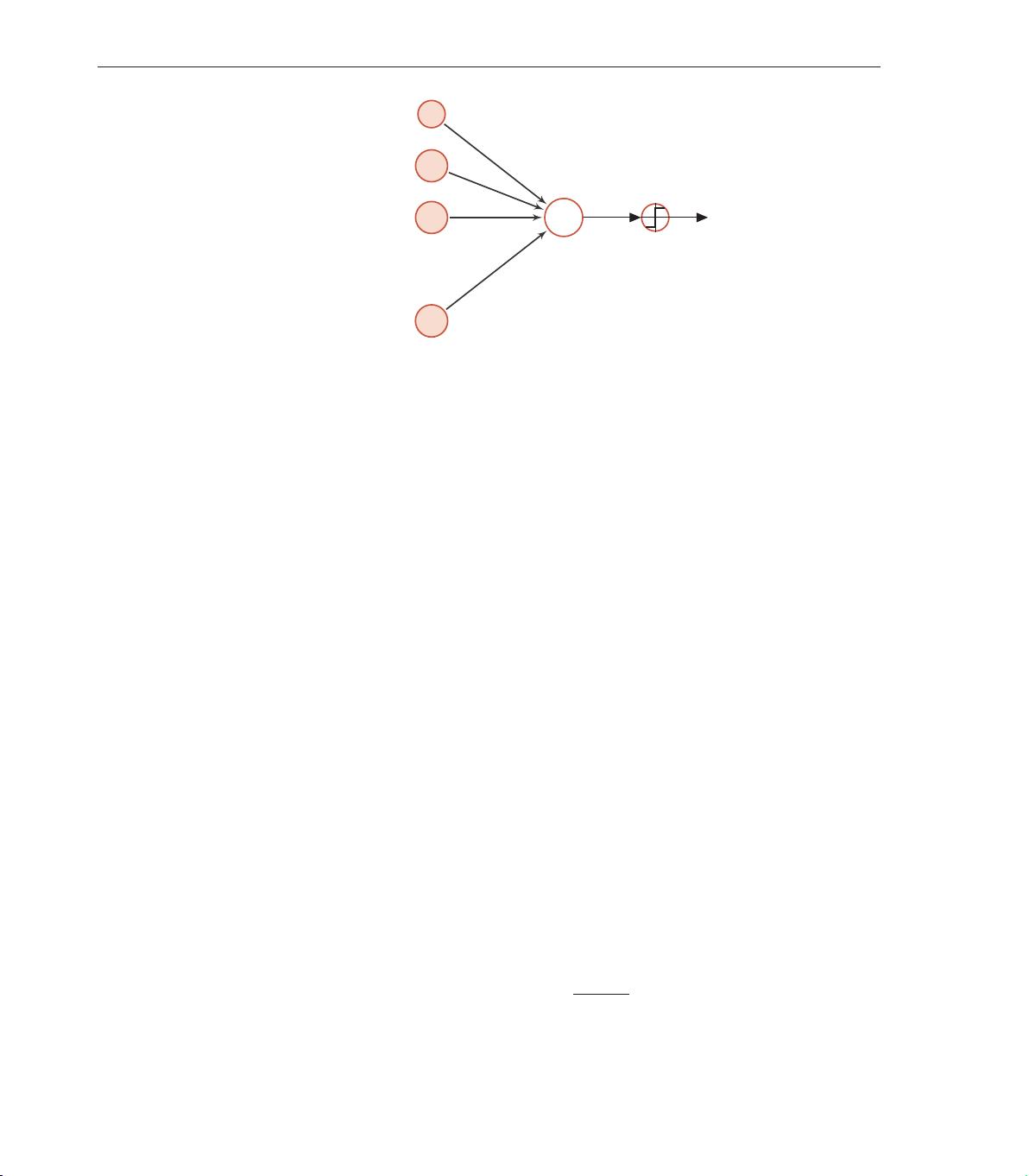

策函数,其结构如图3.1所示。

56 2019 年 4 月 4 日 第 3 章 线性模型

+/−

∑

x

2

w

2

.

.

.

x

d

w

d

x

1

w

1

1

b

图 3.1 两类分类的线性模型

在本章,我们主要介绍四种不同线性分类模型:logistic 回归、softmax 回

归、感知器和支持向量机,这些模型区别主要在于使用了不同的损失函数。

3.1 线性判别函数和决策边界

从公式(3.3)可知,一个线性分类模型(Linear Classification Model)或线

性分类器(Linear Classifier),是由一个(或多个)线性的判别函数 f (x , w) =

w

T

x + b 和非线性的决策函数 g(·) 组成。我们首先考虑两类分类的情况,然后在

扩展到多类分类的情况。

3.1.1 两类分类

两类分类(Binary Classification)的类别标签 y 只有两种取值,通常可以

设为 {+1, −1}。

y 有时也会表示为 {0, 1}。

在两个分类中,我们只需要一个线性判别函数 f(x, w) = w

T

x + b。特征空

间 R

d

中所有满足 f(x, w) = 0 的点组成用一个分割超平面(hyp erplane ),称

为决策边界(decision boundary)或决策平面(decision surface)。决策边界将

超平面就是三维空间中的平

面在更高维空间的推广。d 维

空间中的超平面是 d − 1 维

的。在二维空间中,决策边界

为一个直线;在三维空间中,

决策边界为一个平面;在高

维空间中,决策边界为一个

超平面。

特征空间一分为二,划分成两个区域,每个区域对应一个类别。

所谓“线性分类模型”就是指其决策边界是线性超平面。在特征空间中,

决策平面与权重向量 w 正交。特征空间中每个样本点到决策平面的有向距离

(signed distance)为

参见习题3-2。

γ =

f(x, w)

∥w∥

. (3.6)

γ 也可以看作是点 x 在 w 方向上的投影。

图3.2给出了一个两维数据的线性决策边界示例,其中样本特征向量 x =

[x

1

, x

2

],权重向量 w = [w

1

, w

2

]。

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

3.1 线性判别函数和决策边界 2019 年 4 月 4 日 57

x

1

x

2

w

T

x + b = 0

b

∥w∥

w

图 3.2 两类分类的决策边界示例

给定 N 个样本的训练集 D = {(x

(n)

, y

(n)

)}

N

n=1

,其中 y

(n)

∈ {+1, −1},线

性模型试图学习到参数 w

∗

,使得对于每个样本 (x

(n)

, y

(n)

) 尽量满足

f(x

(n)

, w

∗

) > 0 if y

(n)

= 1,

f(x

(n)

, w

∗

) < 0 if y

(n)

= −1.

(3.7)

上面两个公式也可以合并,即参数 w

∗

尽量满足

y

(n)

f(x

(n)

, w

∗

) > 0, ∀n ∈ [1, N ]. (3.8)

定义 3.1 – 两类线性可分: 对于训练集 D =

(x

(n)

, y

(n)

)

N

n=1

,如果

存在权重向量 w

∗

,对所有样本都满足 yf(x, w

∗

) > 0,那么训练集 D

是线性可分的。

为了学习参数 w,我们需要定义合适的损失函数以及优化方法。对于两类

分类问题,最直接的损失函数为 0-1 损失函数,即

L

01

y, f(x, w)

= I

yf(x, w) > 0

, (3.9)

其中 I(·) 为指示函数。但 0-1 损失函数的数学性质不好,其关于 w 的导数为 0,

从而导致无法优化 w。

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

58 2019 年 4 月 4 日 第 3 章 线性模型

3.1.2 多类分类

多类分类(Multi-class Classification)问题是指分类的类别数 C 大于 2。多

类分类一般需要多个线性判别函数,但设计这些判别函数有很多种方式。

假设一个多类分类问题的类别为 {1, 2, ··· , C},常用的方式有以下三种:

1.“一对其余”方式:把多类分类问题转换为 C 个“一对其余”的两类分类

问题。这种方式共需要 C 个判别函数,其中第 c 个判别函数 f

c

是将类 c 的

样本和不属于类 c 的样本分开。

2.“一对一”方式:把多类分类问题转换为 C(C −1)/2 个“一对一”的两类

分类问题。这种方式共需要 C(C − 1)/2 个判别函数,其中第 (i, j) 个判别

函数是把类 i 和类 j 的样本分开。

1 ≤ i < j ≤ C

3.“argmax”方式:这是一种改进的“一对其余”方式,共需要 C 个判别函数

f

c

(x, w

c

) = w

T

c

x + b

c

, c = [1, ··· , C] (3.10)

如果存在类别c,对于所有的其他类别 ˜c(˜c = c) 都满足f

c

(x, w

c

) > f

˜c

(x, w

˜c

),

那么 x 属于类别 c。即

y =

C

arg max

c=1

f

c

(x, w

c

). (3.11)

参见习题3-3。

“一对其余”方式和“一对一”方式都存在一个缺陷:特征空间中会存在

一些难以确定类别的区域,而“argmax”方式很好地解决了这个问题。图3.3给

出了用这三种方式进行三类分类的示例,其中不用颜色的区域表示预测的类别,

红色直线表示判别函数 f(·) = 0 的直线。在“argmax”方式中,相邻两类 i 和 j

的决策边界实际上是由 f

i

(x, w

i

) − f

j

(x, w

j

) = 0 决定,其法向量为 w

i

− w

j

。

𝜔

2

𝜔

1

𝜔

3

?

𝑓

2

𝑓

1

𝑓

3

?

?

?

(a) “一对其余”方式

𝑓

23

𝑓

12

𝑓

13

?

𝜔

2

𝜔

1

𝜔

3

(b) “一对一”方式

𝑓

3

𝑓

1

𝑓

2

𝜔

2

𝜔

1

𝜔

3

(c) “argmax”方式

图 3.3 三个多类分类方式

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

剩余25页未读,继续阅读

FelaniaLiu

- 粉丝: 23

- 资源: 334

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0