没有合适的资源?快使用搜索试试~ 我知道了~

大数据工具011

需积分: 0 0 下载量 198 浏览量

2022-08-08

22:00:26

上传

评论

收藏 777KB DOCX 举报

温馨提示

试读

29页

引入了新的运行时框架——Tez,旨在消除Hive的延时和吞吐量限制。Tez通过消除不必要的task、障碍同步和对HDFS的读写作业来优化Hive job。这将优

资源详情

资源评论

资源推荐

一共 81 个,开源大数据处理工具汇总(上)

作者:大数据女神-诺蓝(微信公号:dashujunvshen)。本文是 36 大数据专稿,转

载必须标明来源 36 大数据。

本文一共分为上下两部分。我们将针对大数据开源工具不同的用处来进行分类,并且附

上了官网和部分下载链接,希望能给做大数据的朋友做个参考。下面是第一部分。

查询引擎

一、Phoenix

贡献者::Salesforce

简介:这是一个 Java 中间层,可以让开发者在 Apache HBase 上执行 SQL 查询。Phoenix

完全使用 Java 编写,代码位于 GitHub 上,并且提供了一个客户端可嵌入的 JDBC 驱

动。

Phoenix 查询引擎会将 SQL 查询转换为一个或多个 HBase scan,并编排执行以生成标

准的 JDBC 结果集。直接使用 HBase API、协同处理器与自定义过滤器,对于简单查询

来说,其性能量级是毫秒,对于百万级别的行数来说,其性能量级是秒。

Phoenix 最值得关注的一些特性有:

❶嵌入式的 JDBC 驱动,实现了大部分的 java.sql 接口,包括元数据 API

❷可以通过多部行键或是键/值单元对列进行建模

❸完善的查询支持,可以使用多个谓词以及优化的扫描键

❹DDL 支持:通过 CREATE TABLE、DROP TABLE 及 ALTER TABLE 来添加/删除列

❺版本化的模式仓库:当写入数据时,快照查询会使用恰当的模式

❻DML 支持:用于逐行插入的 UPSERT VALUES、用于相同或不同表之间大量数据传

输的 UPSERT ❼SELECT、用于删除行的 DELETE

❽通过客户端的批处理实现的有限的事务支持

❾单表——还没有连接,同时二级索引也在开发当中

➓紧跟 ANSI SQL 标准

Phoenix 官方网站>>>

二、Stinger

贡献者::Hortonworks

简介:原叫 Tez,下一代 Hive,Hortonworks 主导开发,运行在 YARN 上的 DAG 计算框

架。

某些测试下,Stinger 能提升 10 倍左右的性能,同时会让 Hive 支持更多的 SQL,其主

要优点包括:

❶让用户在 Hadoop 获得更多的查询匹配。其中包括类似 OVER 的字句分析功能,支

持 WHERE 查询,让 Hive 的样式系统更符合 SQL 模型。

❷优化了 Hive 请求执行计划,优化后请求时间减少 90%。改动了 Hive 执行引擎,增

加单 Hive 任务的被秒处理记录数。

❸在 Hive 社区中引入了新的列式文件格式(如 ORC 文件),提供一种更现代、高效

和高性能的方式来储存 Hive 数据。

❹引入了新的运行时框架——Tez,旨在消除 Hive 的延时和吞吐量限制。Tez 通过消除

不必要的 task、障碍同步和对 HDFS 的读写作业来优化 Hive job。这将优化 Hadoop 内

部的执行链,彻底加速 Hive 负载处理。

Stinger 官方网站>>>

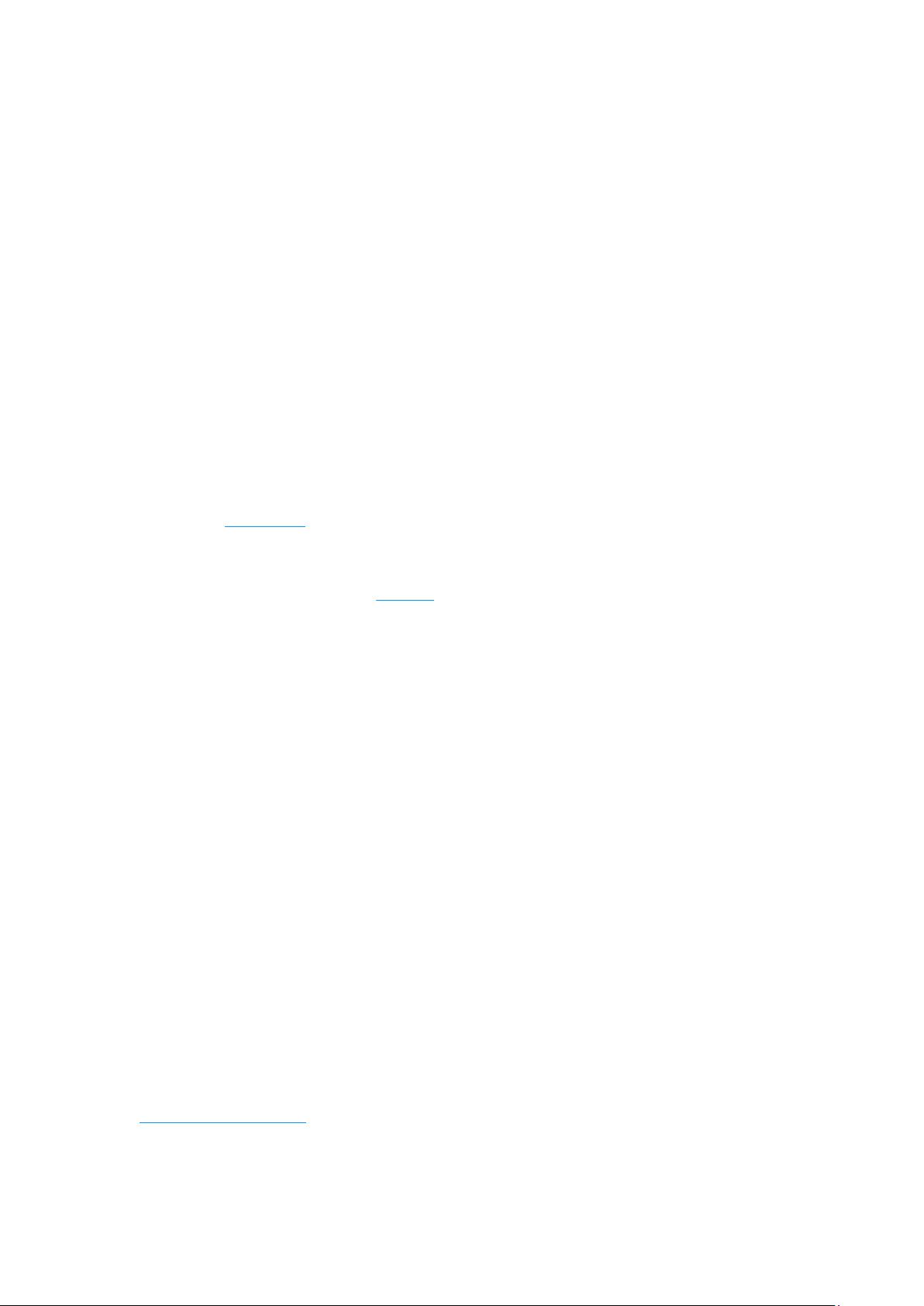

三、Presto

贡献者::Facebook

简介:Facebook 开源的数据查询引擎 Presto ,可对 250PB 以上的数据进行快速地交

互式分析。该项目始于 2012 年秋季开始开发,目前该项目已经在超过 1000 名

Facebook 雇员中使用,运行超过 30000 个查询,每日数据在 1PB 级别。Facebook

称 Presto 的性能比诸如 Hive 和 Map*Reduce 要好上 10 倍有多。

Presto 当前支持 ANSI SQL 的大多数特效,包括联合查询、左右联接、子查询以及一

些聚合和计算函数;支持近似截然不同的计数(DISTINCT COUNT)等。

github 源代码下载>>>

四、Shark

简介:Shark 即 Hive on Spark,本质上是通过 Hive 的 HQL 解析,把 HQL 翻译成 Spark

上的 RDD 操作,然后通过 Hive 的 metadata 获取数据库里的表信息,实际 HDFS 上的

数据和文件,会由 Shark 获取并放到 Spark 上运算。Shark 的特点就是快,完全兼容

Hive,且可以在 shell 模式下使用 rdd2sql()这样的 API,把 HQL 得到的结果集,继续

在 scala 环境下运算,支持自己编写简单的机器学习或简单分析处理函数,对 HQL 结

果进一步分析计算。

❶Shark 速度快的原因除了 Spark 平台提供的基于内存迭代计算外,在设计上还存在对

Spark 上进行了一定的改造,主要有

❷partial DAG execution:对 join 优化,调节并行粒度,因为 Spark 本身的宽依赖和窄

依赖会影响并行计算和速度

基于列的压缩和存储:把 HQL 表数据按列存,每列是一个 array,存在 JVM 上,避免

了 JVM GC 低效,而压缩和解压相关的技术是 Yahoo!提供的。

结来说,Shark 是一个插件式的东西,在我现有的 Spark 和 Hive 及 hadoop-client 之间,

在这两套都可用的情况下,Shark 只要获取 Hive 的配置(还有 metastore 和 exec 等关

键包),Spark 的路径,Shark 就能利用 Hive 和 Spark,把 HQL 解析成 RDD 的转换,

把数据取到 Spark 上运算和分析。在 SQL on Hadoop 这块,Shark 有别于 Impala,

Stringer,而这些系统各有自己的设计思路,相对于对 MR 进行优化和改进的思路,Shark

的思路更加简单明了些。

Shark 官方网站>>>

五、Pig

简介:Pig 是一种编程语言,它简化了 Hadoop 常见的工作任务。Pig 可加载数据、表

达转换数据以及存储最终结果。Pig 内置的操作使得半结构化数据变得有意义(如日志

文件)。同时 Pig 可扩展使用 Java 中添加的自定义数据类型并支持数据转换。

Pig 最大的作用就是对 mapreduce 算法(框架)实现了一套 shell 脚本 ,类似我们通常熟

悉的 SQL 语句,在 Pig 中称之为 Pig Latin,在这套脚本中我们可以对加载出来的数据

进行排序、过滤、求和、分组(group by)、关联(Joining),Pig 也可以由用户自定义一

些函数对数据集进行操作,也就是传说中的 UDF(user-defined functions)。

Pig 官方网站>>>

六、Cloudera Impala

贡献者::Cloudera

简介:Cloudera Impala 可以直接为存储在 HDFS 或 HBase 中的 Hadoop 数据提供快

速,交互式的 SQL 查询。除了使用相同的存储平台外, Impala 和 Apache Hive 一样

也使用了相同的元数据,SQL 语法(Hive SQL),ODBC 驱动和用户接口(Hue

Beeswax),这就很方便的为用户提供了一个相似并且统一的平台来进行批量或实时查

询。

Cloudera Impala 是用来进行大数据查询的补充工具。 Impala 并没有取代像 Hive 这

样基于 MapReduce 的分布式处理框架。Hive 和其它基于 MapReduce 的计算框架非常

适合长时间运行的批处理作业,例如那些涉及到批量 Extract、Transform、Load ,即

需要进行 ETL 作业。

Impala 提供了:

❶数据科学家或数据分析师已经熟知的 SQL 接口

❷能够在 Apache Hadoop 的大数据中进行交互式数据查询

❸ Single system for big data processing and analytics so customers can avoid

costly modeling and ETL just for analytics

Cloudera Impala 官方网站>>>

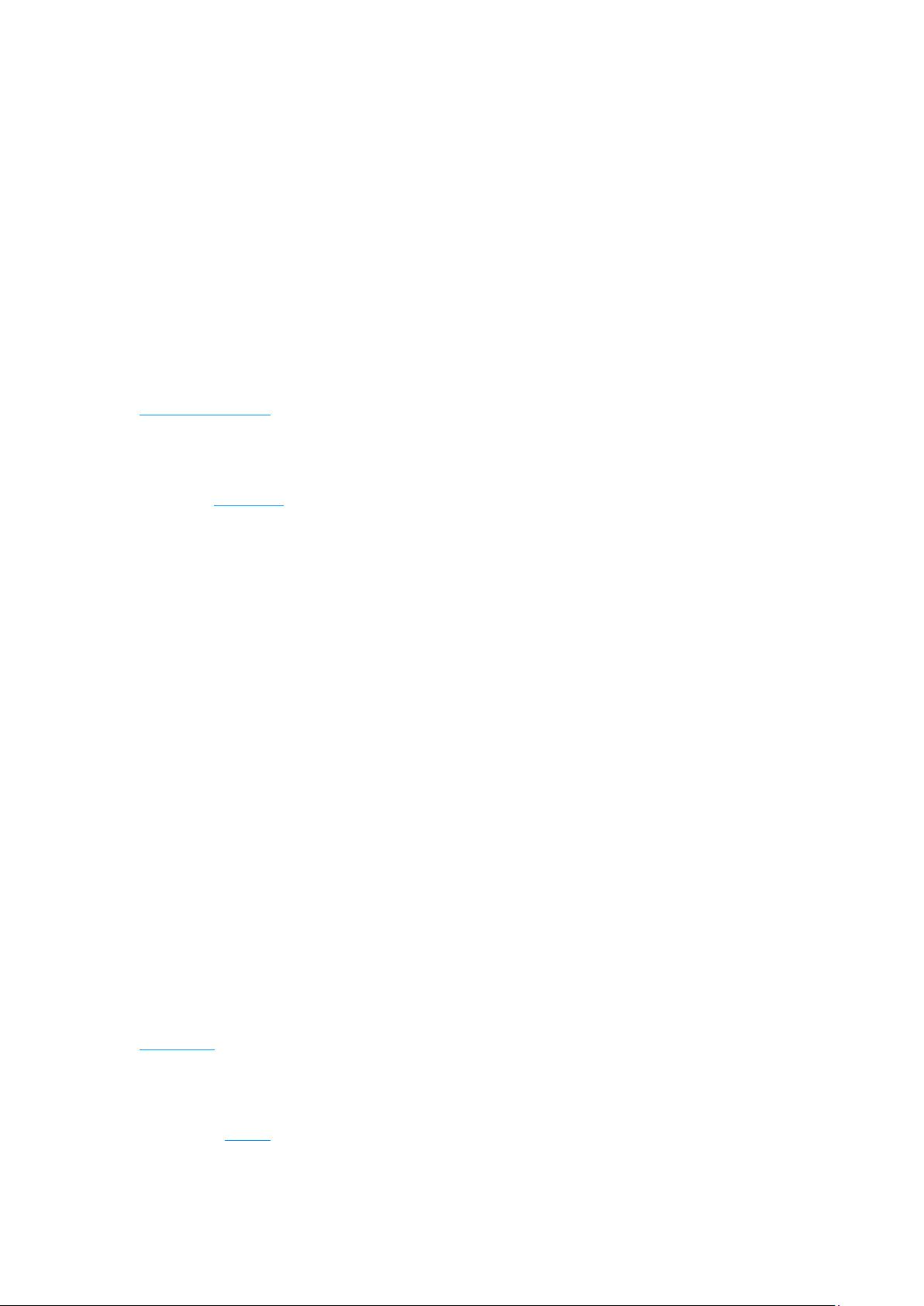

七、Apache Drill

贡献者::MapR

简介:Apache Drill 是是一个能够对大数据进行交互分析、开源的分布式系统,且基于

Google Dremel 实现,它能够运行在上千个节点的服务器集群上,且能在几秒内处理 PB

级或者万亿条的数据记录。Drill 能够帮助企业用户快速、高效地进行 Hadoop 数据查询

和企业级大数据分析。Drill 于 2012 年 8 月份由 Apache 推出。

从 Drill 官方对其架构的介绍中得知,其具有适于实时的分析和快速的应用开发、适于半

结构化/嵌套数据的分析、兼容现有的 SQL 环境和 Apache Hive 等特征。另外,Drill 的

核心模块是 Drillbit 服务,该服务模块包括远程访问子模块、SQL 解析器、查询优化器、

任务计划执行引擎、存储插件接口(DFS、HBase、Hive 等的接口)、分布式缓存模块

等几部分,如下图所示:

Apache Drill 官方网站>>>

八、Apache Tajo

简介:Apache Tajo 项目的目的是在 HDFS 之上构建一个先进的数据仓库系统。Tajo 将

自己标榜为一个“大数据仓库”,但是它好像和之前介绍的那些低延迟查询引擎类似。虽

然它支持外部表和 Hive 数据集(通过 HCatalog),但是它的重点是数据管理,提供低

延迟的数据访问,以及为更传统的 ETL 提供工具。它也需要在数据节点上部署 Tajo 特

定的工作进程。

Tajo 的功能包括:

❶ANSI SQL 兼容

❷JDBC 驱动

❸集成 Hive metastore 能够访问 Hive 数据集

❹一个命令行客户端

❺一个自定义函数 API

剩余28页未读,继续阅读

尹子先生

- 粉丝: 18

- 资源: 324

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 农村信用社联合社计算机信息系统投产与变更管理办.docx

- 农村信用社联合社计算机信息系统数据管理办法.docx

- 利用SPSS作临床效度分析线上计算网站介绍-医学研究部统计谘.(医学PPT课件).ppt

- 利用Zabbix监控mysqldump定时备份数据库状态.docx

- 利用计算机解决问题的基本过程.doc

- 化工铁路通信工程总结.doc

- 北京大学网络教育软件工程作业.docx

- 医药公司(连锁店)计算机操作规程未新系统的自行按照旧制修改-新系统过制的编号加修模版.doc

- 医药公司(连锁店)计算机系统操作规程模版.doc

- 医药连锁门店计算机系统的操作和管理程序未新系统的自行按照旧制修改-新系统过制的编号加修模版.docx

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0