5_深度计算平台 与 响应时效管理的思考_张翔1

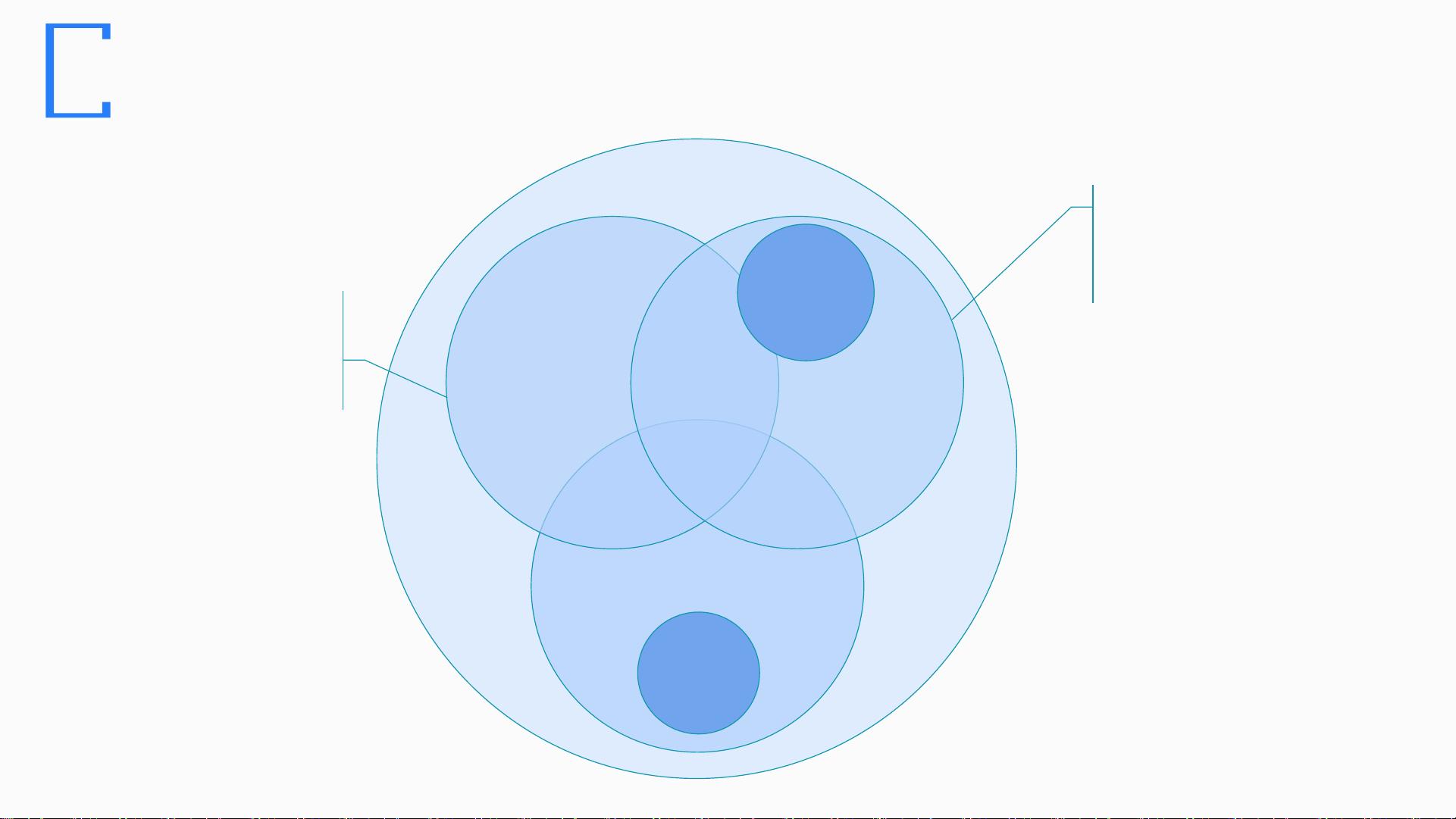

【深度计算平台与响应时效管理】的探讨主要集中在如何构建高效、灵活的计算环境来应对复杂的计算需求,尤其是在人工智能(AI)领域的应用。张翔在演讲中提到了几个关键概念和区别,包括深度计算平台与大数据平台的差异、深度计算平台与深度学习系统的联系、模型训练的分布式选型以及模型服务的生态环境。 深度计算平台与大数据平台的主要区别在于它们的核心处理方式和目标。大数据平台通常侧重于分布式存储和资源密集型操作,旨在处理大量非结构化数据,从中寻找一致性和模式。而深度计算平台则更专注于解决复杂的计算问题,利用如GPU这样的高速计算资源,提供按需而变的个性化结果。在大数据平台中,计算资源通常是集中的,而在深度计算平台中,计算需求可能更加分散且针对性强。 深度计算平台与深度学习系统的关联体现在硬件执行推理系统和学习系统上。训练阶段(Training)需要大量的训练数据和高迭代次数,对实时性的要求相对较低;而服务阶段(Serving)则需应对大量并发请求,执行复杂逻辑推理,并在高实时性约束下工作。因此,选择合适的分布式训练策略,如MapReduce、Parameter Server或MPI-Allreduce,对于优化模型训练过程至关重要。 模型服务的生态环境涉及多种硬件加速器,如GPU、CPU、FPGA、ASIC等,以及对应的计算库和框架。例如,NVIDIA的CUDA和cuBLAS库支持GPU加速,TensorFlow和MXNet等深度学习框架提供了广泛的应用支持。此外,还有各种服务部署解决方案,如TF Serving、MLFlow和Kuberflow,以及云到端的推理优化工具,如TVM。这些技术为不同规模的组织提供了在性能、成本和灵活性之间找到平衡的可能性。 AI产品经理的角色在此过程中显得尤为重要,他们需要综合考虑模型的特性、计算资源的利用以及用户任务的需求。例如,通过任务调度和缓存策略来优化模型的加载时间(如Task1-4的示例),确保在满足响应时效的同时,实现最佳的用户体验。 深度计算平台的构建和管理不仅涉及到硬件和软件的选择,还包括了模型训练的效率优化和模型服务的实时性保障。随着技术的发展,深度学习和AI系统的复杂性不断增加,如何有效管理计算资源、提升响应速度和保证服务质量,成为了当前和未来IT行业的重要课题。

剩余20页未读,继续阅读

- 粉丝: 33

- 资源: 299

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功

评论0