没有合适的资源?快使用搜索试试~ 我知道了~

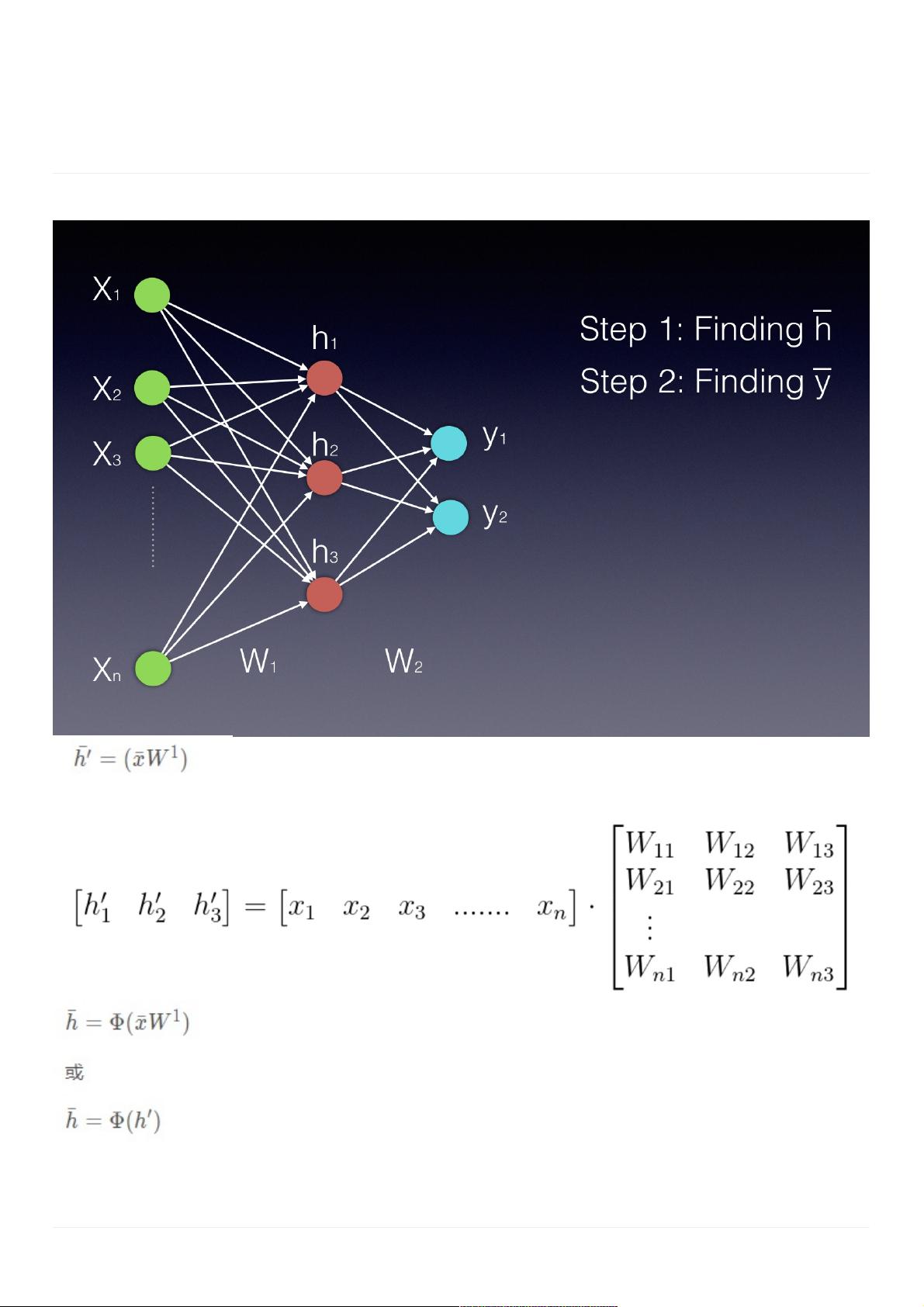

第一个是计算隐藏状态的数值,第二个是计算输出值 第一步 第一步 (请注意,此处引用的权重向量是W2 第二步 第二步

资源详情

资源评论

资源推荐

前馈前馈 _反向传播反向传播 _梯度下降梯度下降 .md to 前馈前馈 _反向传播反向传播 _梯度下降梯度下降 .pdf by

MARKDOWN-THEMEABLE-PDF

Page 1/6 © Copyright Thursday, Nov 15, 2018, 4:08 PM by COMPANYNAME

前馈

假设只有一个隐藏层,我们在计算中会需要两个步骤。第一个是计算隐藏状态的数值,第二个是计算输出值。 请注意,隐藏层和输出层都显示为向量,因为它

们都是多个单一神经元表示的。 将输入向量乘以权重矩阵W1,可以计算得到隐藏层的向量h,再通过激活函数

我们找到h'后,需要一个激活函数(Φ)来完成隐藏层数值的计算。这个激活函数可以是双曲正切、Sigmoid或ReLU函数。我们可以使用以下两个方程式来表示最终

隐藏层的向量 :

由于Wij表示权重矩阵中的权重部分,连接输入中的神经元 ii 和隐藏层的神经元 jj,我们也可以按照以下方式书写计算:(请注意,在这个例子中,我们有 nn 个输

入,只有3个隐藏的神经元)

zh222333

- 粉丝: 22

- 资源: 296

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0