没有合适的资源?快使用搜索试试~ 我知道了~

学习笔记-能量生成模型EBGAN2

需积分: 0 0 下载量 118 浏览量

2022-08-04

13:12:50

上传

评论

收藏 1.15MB PDF 举报

温馨提示

试读

11页

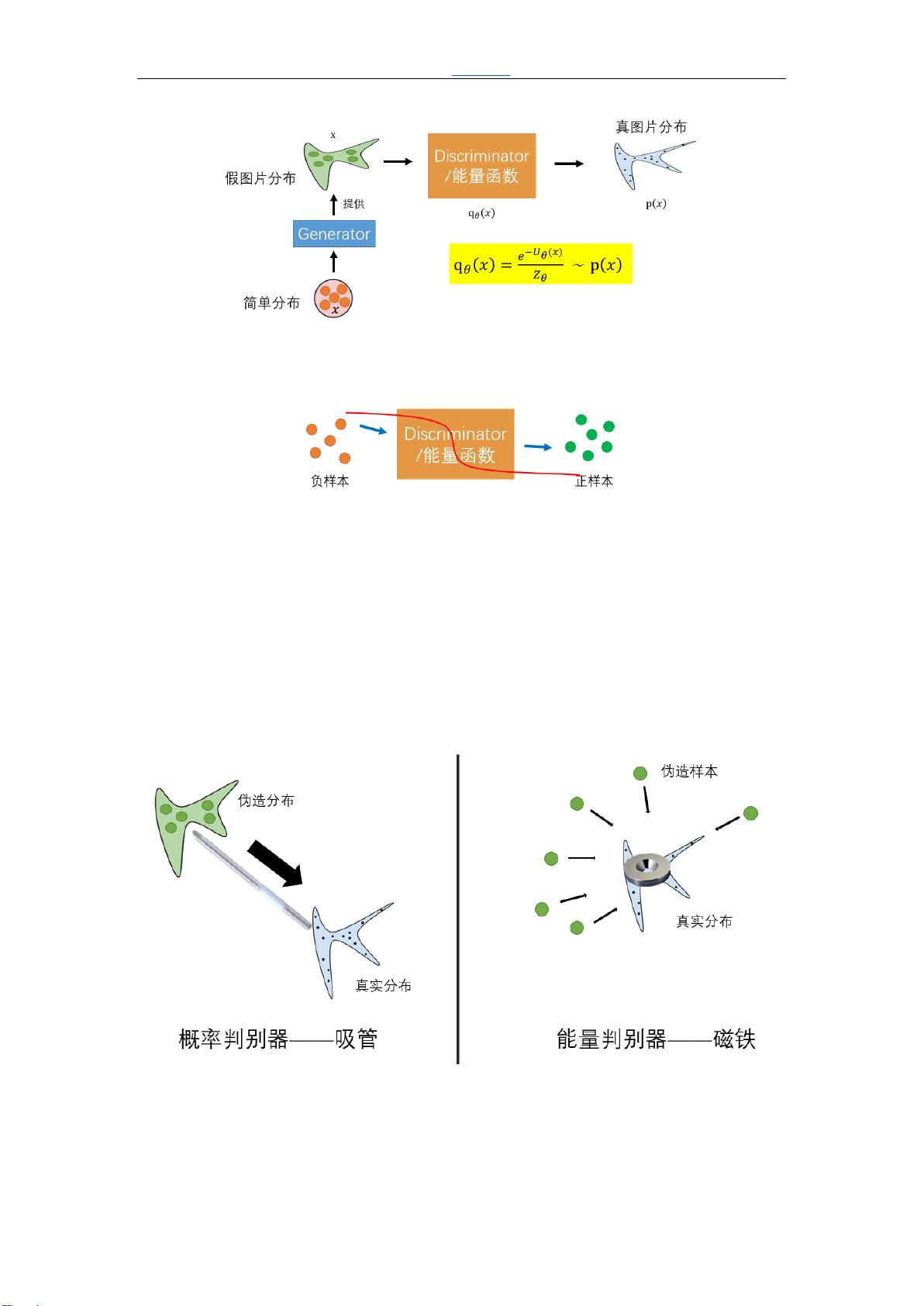

先在第三节构建更完备的理论基础,然后再在第四节求解 H(x)。3.EBM 的理论分析回到最开始生成模型在探讨的问题上:我们有一批数据 x1, x2, … , x

资源详情

资源评论

资源推荐

资料来源:www.gwylab.com

生成模型---能量视角下的生成对抗网络

目 录

1.PBM 与 EBM 的比较 ............................................................................................................................2

2.EBM 的设计思维 ....................................................................................................................................4

3.EBM 的理论分析 ....................................................................................................................................6

4.* Hφ(X)的求解 .......................................................................................................................................9

5. 致谢及引用 .......................................................................................................................................... 11

资料来源:www.gwylab.com

之前我写过一套笔记介绍一系列的 GANs,其中有一个模型叫做 EBGAN,它最有特色的

地方是它的判别器,长成下面这个样子:

当时在介绍这个判别器的作用时,是说“其不再去鉴别输入图像是来自于P

𝑑𝑎𝑡𝑎

还是P

𝑔

,

而是去鉴别输入图像的重构性高不高”。更详细点解释就是,图中 Autoencoder 是一个提前

用真实样本训练好的网络,现在要鉴别一个输入图像是真还是假,只需把这张图放入

Autoencoder 中,如果它是真实图片的话通过此 Autoencoder 重构回的图像就基本是无损的

(因为这个 Autoencoder 就是用真实样本训练出来的),而如果是假造图片的话重构图像就

会与原图差别较大,因此这个 Autoencoder 输出和输入图片的差异就能够作为这个判别器

的打分值。

其实上述的这种判别器,如果细细一想的话,会让人觉得非常奇怪,因为它不符合我们

在理论上对于GANs的认知:判别器的根本目的是要计算两个分布之间的散度(Divergence),

从而为生成器提供梯度的正确引导。但是在上述的这个判别器中,它只用到了真实样本去训

练,训练结果是无法计算出任何两个分布间的散度的,那么它该如何为生成器提供正确的引

导呢?这样的 EBGAN 究竟是如何起作用的呢?

带着困惑我去阅读了原 paper 和很多相关笔记,然后神奇地发现,我们原有对于 GANs

的认知没有错误但不充分,那是一种基于 PBM(Possibility Based Model)的认知方法,但

是其实对于 GANs 的认知还有另外一个维度,那就是把 GANs 视作一种 EBM(Energy Based

Model)模型。

下面先简要介绍一下这两种思维方法的差异。

1.PBM 与 EBM 的比较

基于概率模型(PBM)的 GANs

首先将 GANs 视作一种 PBM,也就是基于概率的模型,这是被大众普遍接受的认知方

法,因为熟悉 GANs 理论的朋友会知道,判别器的本质是计算样本 x 属于类别 y 的条件概率

P(y|x)(其中 y 只有正负两类所以判别器就是一个二分类器),生成器的本质是计算样本 x

在整个分布中的生成概率,也就是联合概率 P(xy)。那么概率的计算,需要基于样本的统计

才能实现,这意味每一个样本都需要有明确的正/负维度,也就是喂给判别器的输入非负即

正(正指真实样本,负指生成样本),无它。只有这样,判别器才能基于概率正确计算出正

负样本分布间的散度(Divergence),进而帮助生成器产生更逼近正样本的负样本出来。

资料来源:www.gwylab.com

基于能量模型(EBM)的 GANs

但是对于 EBM,也就是基于能量的模型而言,它就不需要所有样本都具有明确的正/负

维度了。因为它用一种更灵活的、称之为“能量”的东西去代替了概率计算。

能量的含义很抽象,我们不妨用一个能量函数 U(x)去衡量它,正样本本身具有最低的能

量函数,样本越远离正样本能量值就越高。并且能量具有吸引力,也就是能量值低的样本会

吸引能量值高的样本向自己靠近。后文会对能量模型有更清晰的介绍。

现在不妨比较一下两种模型的异同。在 GANs 视角下,二者都具有生成器与判别器,但

是对于 PBM 模型而言生成器是核心,而对于 EBM 模型而言判别器是核心。这是因为,在

PBM 理论中,一开始只设计了生成器,没有判别器,但是因为生成器的计算中缺失正负样

本间的散度,不得已再构造了一个判别器去学习计算这个散度,进而辅助生成器;而在 EBM

理论中,一开始只构造了判别器,没有生成器,但是因为判别器的计算中缺失负样本,不得

已再构造了一个生成器去学习提供负样本,进而辅助判别器。后文会有关于 EBM 理论的更

详细的介绍。

另外,从宏观上来看,PBM 比较依赖于正样本和负样本,而 EBM 可以不依赖于负样本。

换言之,PBM 中的判别器就好比是一根吸管(如上图),它需要明确知道正、负样本的接口

在哪,才能帮助生成器顺着这根吸管将负样本朝正样本靠近;但是 EBM 中的判别器就好比

是一块磁铁,只需把它安置在正样本上,就能借用能量的优势将周围的负样本吸引向自身。

剩余10页未读,继续阅读

断脚的鸟

- 粉丝: 19

- 资源: 301

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0