没有合适的资源?快使用搜索试试~ 我知道了~

Spark配置1.所需环境:UbuntuHadoopScala 下载地址:http://www.scala-lang.org/download/2.10

资源详情

资源评论

资源推荐

Spark 配置

1.所需环境:

1. Ubuntu

2. Hadoop

3. Scala 下载地址:http://www.scala-lang.org/download/2.10.4.html

4. JDK

5. ssh

2.前期准备工作

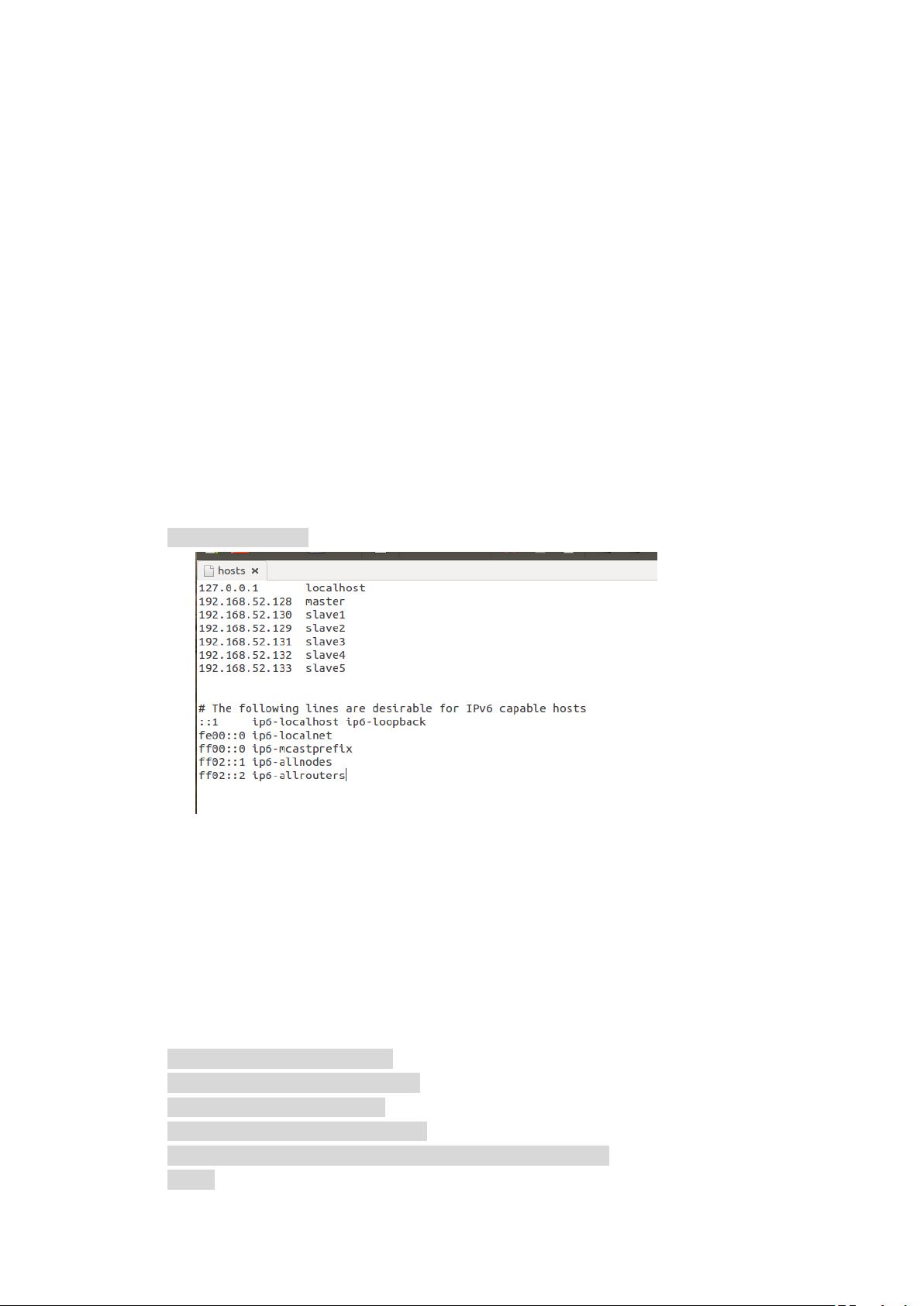

确保 spark 集群中所有机器能够互相访问,都在同一个网段内,直接修改六台机器的 hosts

文件

sudo gedit /etc/hosts

实际 IP 根据实际情况修改(第二列要与下面所述的 slaves 文件相同)

3.修改环境变量

修 改 环 境 变 量 打 开 终 端 输 入 命 令 sudo gedit /etc/profile 添 加

JDK,HADOOP,SCALA,SPARK 环境变量进去

export JAVA_HOME=/usr/java/jdk

export HADOOP_HOME=/opt/Hadoop

export SPARK_HOME=/usr/spark

export SCALA_HOME=/usr/scala-2.11.4

export CLASSPATH=$JAVA_HOME/lib:$JRE_HOME/lib:$CLASSPATH

export

不知者无胃口

- 粉丝: 26

- 资源: 328

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0