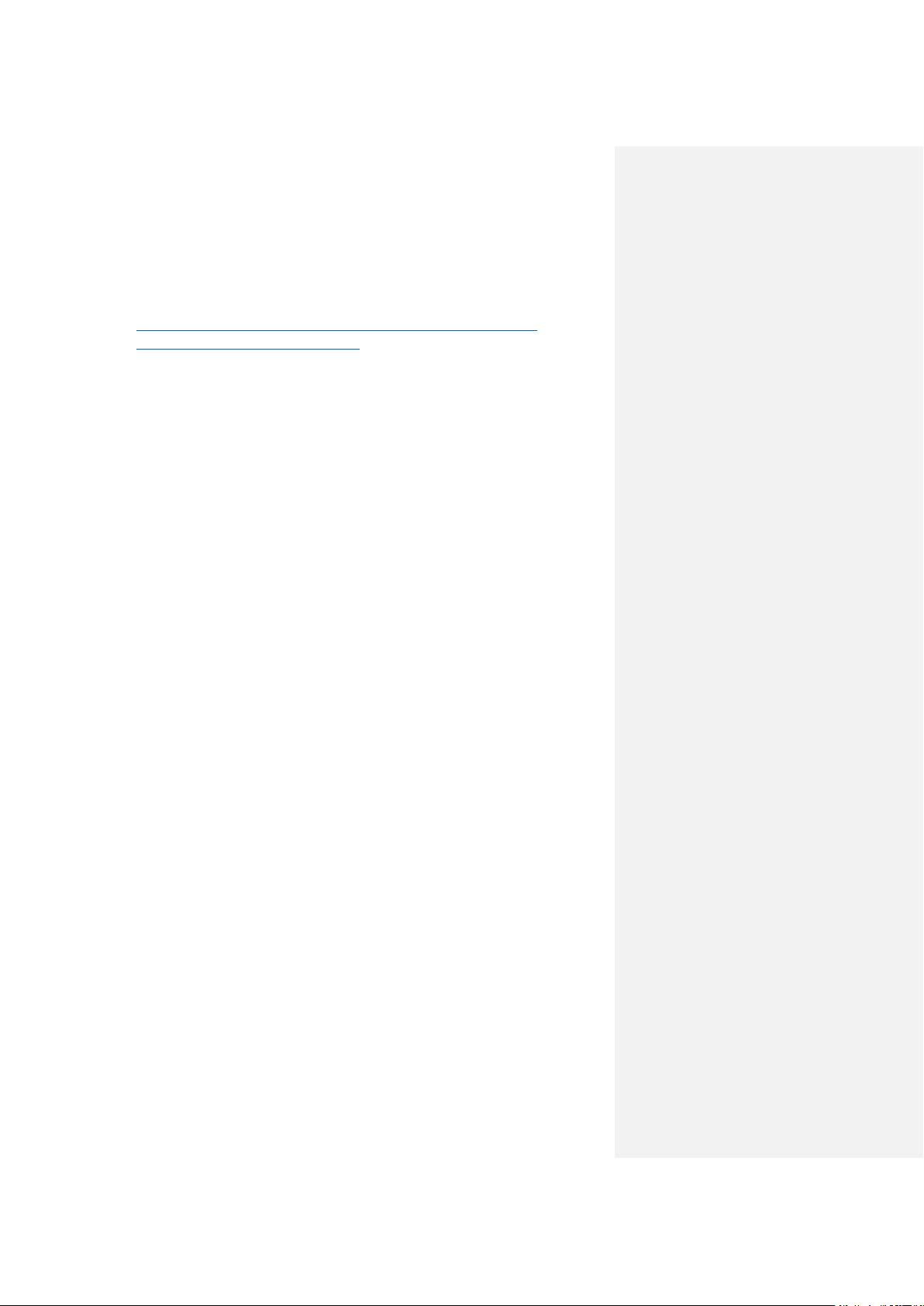

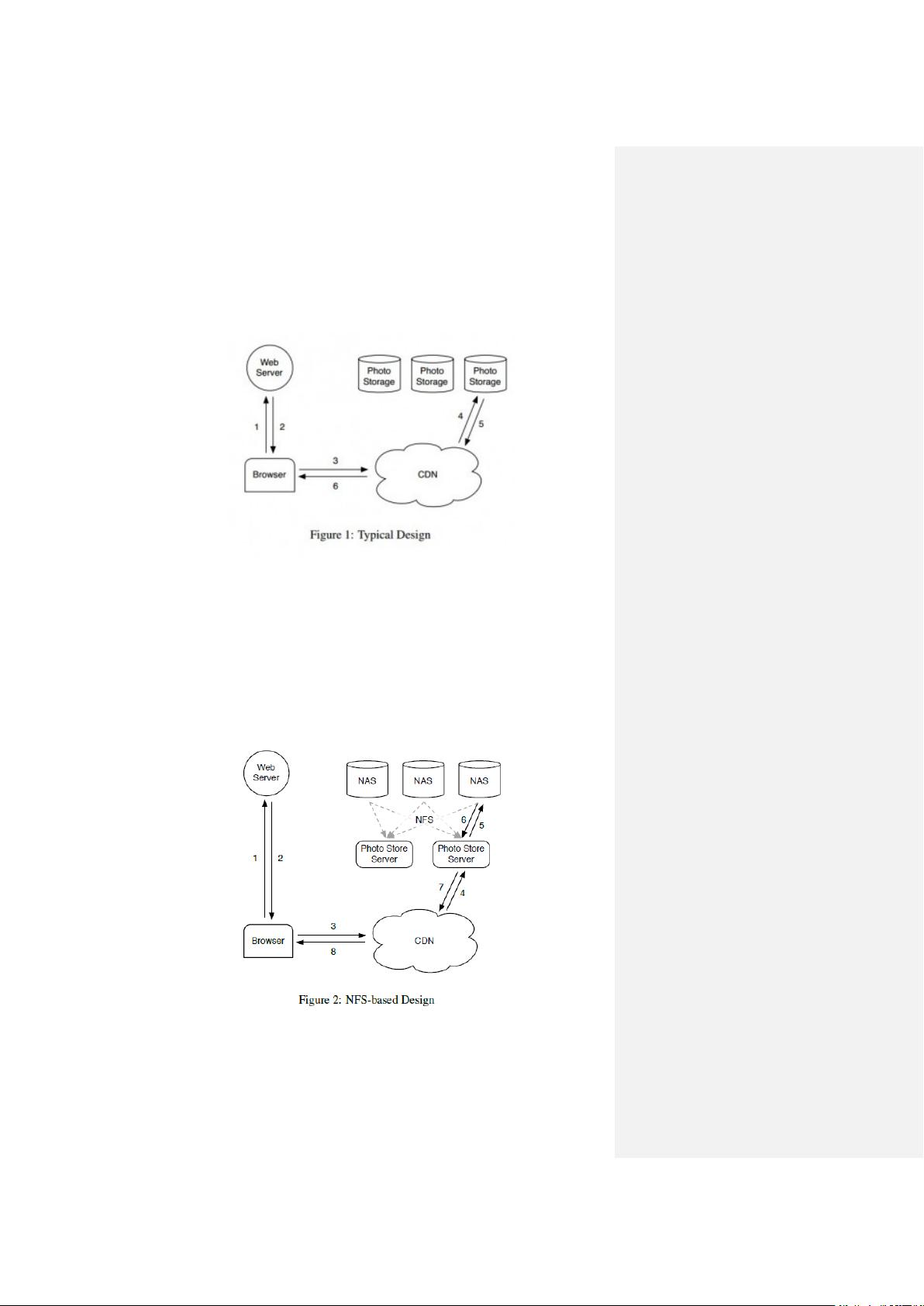

【分布式文件系统-Haystack1】是Facebook为解决大规模图片存储和访问问题而设计的一种高性能、低延迟的文件系统。Haystack的目标是优化元数据管理和提高读写效率,尤其是在处理海量小文件(如图片)的场景下。Facebook的照片服务面临巨大的挑战,例如每周新增10亿张照片,每秒约有3500次写操作,以及读操作峰值可能达到每秒百万次。 Facebook最初使用的是NAS(Network Attached Storage)和NFS(Network File System),但这种设计存在元数据查询导致过多磁盘操作的问题,影响了整体性能。Haystack的设计理念是减少每个图片的元数据,使得所有元数据查询都能在内存中完成,从而避免磁盘I/O,提升系统吞吐量。 传统POSIX文件系统的一个主要缺点是目录和每个文件的元数据,这对图片应用来说是不必要的,而且消耗了大量的存储空间。此外,文件元数据的磁盘读取成为性能瓶颈。在Haystack之前,读取一个图片通常需要多次磁盘操作,包括查找inode,读取inode,以及读取文件本身。Haystack的目标是通过减少必要的元数据并将其保留在内存中,使每个读操作最多只需一次磁盘操作,以实现高吞吐量和低延迟。 Haystack适用于“write once, read often, never modified and rarely deleted”的场景,即文件一旦写入,频繁读取,几乎不修改,很少删除。在Facebook的案例中,用户上传一张图片会生成四种尺寸的副本,每种存储三份,导致写入量远大于用户上传量。Haystack通过减少每个图片的元数据,确保系统能够高效地处理这些海量小文件的读取请求。 在原有的设计中,Web服务器、CDN和存储系统协同工作,当用户请求包含图片的页面时,Web服务器构建URL,引导浏览器从CDN或存储系统获取图片。CDN对于热门图片有很好的响应,但对于不热门的“长尾”图片,请求会直接到达存储系统。基于NFS的系统中,图片存储在NAS设备上,每次读取图片时,都需要通过NFS进行多次磁盘操作,这在处理大规模图片服务时效率低下。 Haystack的出现解决了这些问题,它减少了元数据的磁盘I/O,优化了图片的存储和检索流程,提升了用户体验。通过这种分布式文件系统,Facebook能够有效地支持其用户产生的海量图片数据,同时保持服务的高效和低成本。

剩余9页未读,继续阅读

- 粉丝: 23

- 资源: 292

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功

评论0