没有合适的资源?快使用搜索试试~ 我知道了~

作业答案合集 from csdn1

需积分: 0 0 下载量 117 浏览量

2022-08-03

13:13:31

上传

评论 1

收藏 1.29MB PDF 举报

温馨提示

试读

25页

机器学习 (周志华) 参考答案 第一章 绪论1. 表 1.1 中若只包含编号为 1,4 的两个样例,试给出相应的版本空间。假设空间指的是问题所有假设组成的空间,

资源详情

资源评论

资源推荐

机器学习 (周志华西瓜书) 参考答案 总目录

http://blog.csdn.net/icefire_tyh/article/details/52064910

假设数据集有 n 种属性,第 i 个属性可能的取值有 种,加上该属性的泛化取值 (*),所以可能的假设有 。再用空集表示没有正例,假设空间中一共

种假设。

现实问题中常面临很大的假设空间,我们可以寻找一个与训练集一致的假设集合,称之为版本空间。版本空间从假设空间剔除了与正例不一致和与反例一致的假

设,它可以看成是对正例的最大泛化。

版本空间的可以通过搜索假设空间来得到,这样需要遍历完整的假设空间。如果数据集中有正例,则可以先对一个正例进行最大泛化,得到 个假设,然后再对

这些假设进行剔除操作,可以适当精简计算量。

西瓜数据集(精简)

编号 色泽 根蒂 敲声 好瓜

1 青绿 蜷缩 浊响 是

2 乌黑 稍蜷 沉闷 否

数据集有 3 个属性,每个属性 2 种取值,一共 种假设,分别为

1. 色泽 = 青绿 根蒂 = 蜷缩 敲声 = 浊响

2. 色泽 = 青绿 根蒂 = 蜷缩 敲声 = 沉闷

3. 色泽 = 青绿 根蒂 = 稍蜷 敲声 = 浊响

4. 色泽 = 青绿 根蒂 = 稍蜷 敲声 = 沉闷

5. 色泽 = 乌黑 根蒂 = 蜷缩 敲声 = 浊响

6. 色泽 = 乌黑 根蒂 = 蜷缩 敲声 = 沉闷

7. 色泽 = 乌黑 根蒂 = 稍蜷 敲声 = 浊响

8. 色泽 = 乌黑 根蒂 = 稍蜷 敲声 = 沉闷

9. 色泽 = 青绿 根蒂 = 蜷缩 敲声 =*

10. 色泽 = 青绿 根蒂 = 稍蜷 敲声 =*

11. 色泽 = 乌黑 根蒂 = 蜷缩 敲声 =*

12. 色泽 = 乌黑 根蒂 = 稍蜷 敲声 =*

13. 色泽 = 青绿 根蒂 =* 敲声 = 浊响

14. 色泽 = 青绿 根蒂 =* 敲声 = 沉闷

15. 色泽 = 乌黑 根蒂 =* 敲声 = 浊响

16. 色泽 = 乌黑 根蒂 =* 敲声 = 沉闷

17. 色泽 =* 根蒂 = 蜷缩 敲声 = 浊响

18. 色泽 =* 根蒂 = 蜷缩 敲声 = 沉闷

19. 色泽 =* 根蒂 = 稍蜷 敲声 = 浊响

20. 色泽 =* 根蒂 = 稍蜷 敲声 = 沉闷

21. 色泽 = 青绿 根蒂 =* 敲声 =*

22. 色泽 = 乌黑 根蒂 =* 敲声 =*

23. 色泽 =* 根蒂 = 蜷缩 敲声 =*

机器学习 (周志华) 参考答案 第一章 绪论

1. 表 1.1 中若只包含编号为 1,4 的两个样例,试给出相应的版本空间。

假设空间指的是问题所有假设组成的空间,我们可以把学习过程看作是在假设空间中搜索的过程,搜索目标是寻找与训练集“匹配”的假设。

1

t

i

( + 1)

∏

i

t

i

( + 1) + 1

∏

i

t

i

2

n

3 ∗ 3 ∗ 3 + 1 = 28

24. 色泽 =* 根蒂 = 稍蜷 敲声 =*

25. 色泽 =* 根蒂 =* 敲声 = 浊响

26. 色泽 =* 根蒂 =* 敲声 = 沉闷

27. 色泽 =* 根蒂 =* 敲声 =*

28. 空集 Ø

编号 1 的数据可以删除 (不包含数据 1)

编号 1 的数据可以删除 (包含了数据 2)

所以版本空间为:

1. 色泽 = 青绿 根蒂 = 蜷缩 敲声 = 浊响

9. 色泽 = 青绿 根蒂 = 蜷缩 敲声 =*

13. 色泽 = 青绿 根蒂 =* 敲声 = 浊响

17. 色泽 =* 根蒂 = 蜷缩 敲声 = 浊响

21. 色泽 = 青绿 根蒂 =* 敲声 =*

23. 色泽 =* 根蒂 = 蜷缩 敲声 =*

25. 色泽 =* 根蒂 =* 敲声 = 浊响

一般情况下版本空间是正例的泛化,但由于数据集中只有 1 个正例,所以在版本空间中依然包含了这个样本的假设 (假设 1)。

http://blog.csdn.net/icefire_tyh/article/details/52065626

通常认为两个数据的属性越相近,则更倾向于将他们分为同一类。若相同属性出现了两种不同的分类,则认为它属于与他最临近几个数据的属性。也可以考虑同

时去掉所有具有相同属性而不同分类的数据,留下的数据就是没误差的数据,但是可能会丢失部分信息。

还是考虑二分类问题,NFL 首先要保证真是目标函数 f 均匀分布,对于有 X 个样本的二分类问题,显然 f 共有 种情况。其中一半是与假设一致的,也就

。

此时,

应该是个常数,隐含的条件就该是 (一个比较合理的充分条件) 。如果不满足, NFL

应该就不成立了 (或者不那么容易证明)。

1. 最常见的,消息推送,比如某东经常说某些商品我可能会感兴趣,然而并没有。

2. 网站相关度排行,通过点击量,网页内容进行综合分析。

3. 图片搜索,现在大部分还是通过标签来搜索,不过基于像素的搜索也总会有的吧。

2 − 8

,

10 − 12

,

14 − 16

,

18 − 20

,

22

,

24

,

26

,

28

27

2. 与使用单个合取式来进行假设表示相比,使用 “析合范式” 将使得假设空间具有更强的表示能力。若使用最多

包含 k 个合取式的析合范式来表达 1.1 的西瓜分类问题的假设空间,试估算有多少种可能的假设。

3. 若数据包含噪声,则假设空间中可能不存在与所有训练样本都一致的假设。在此情形下,试设计一种归纳偏好用

于假设选择

4. 本章 1.4 节在论述 “没有免费的午餐” 定理时,默认使用了 “分类错误率” 作为性能度量来对分类器进行评

估。若换用其他性能度量 , 试证明没有免费的午餐” 定理仍成立

l

2

X

P

(

f

(

x

) =

h

(

x

)) = 0.5

l

(

h

(

x

),

f

(

x

)) = 0.5 ∗ ∗ (

l

(

h

(

x

) =

f

(

x

)) +

l

(

h

(

x

) ≠

f

(

x

)))

∑

f

2

X

l

(

h

(

x

) =

f

(

x

)) +

l

(

h

(

x

) ≠

f

(

x

))

l

(0,0) =

l

(1,1),

l

(1,0) =

l

(0,1)

5. 试述机器学习在互联网搜索的哪些环节起什么作用

机器学习 (周志华) 参考答案 第二章 模型评估与选择

机器学习 (周志华西瓜书) 参考答案 总目录

http://blog.csdn.net/icefire_tyh/article/details/52064910

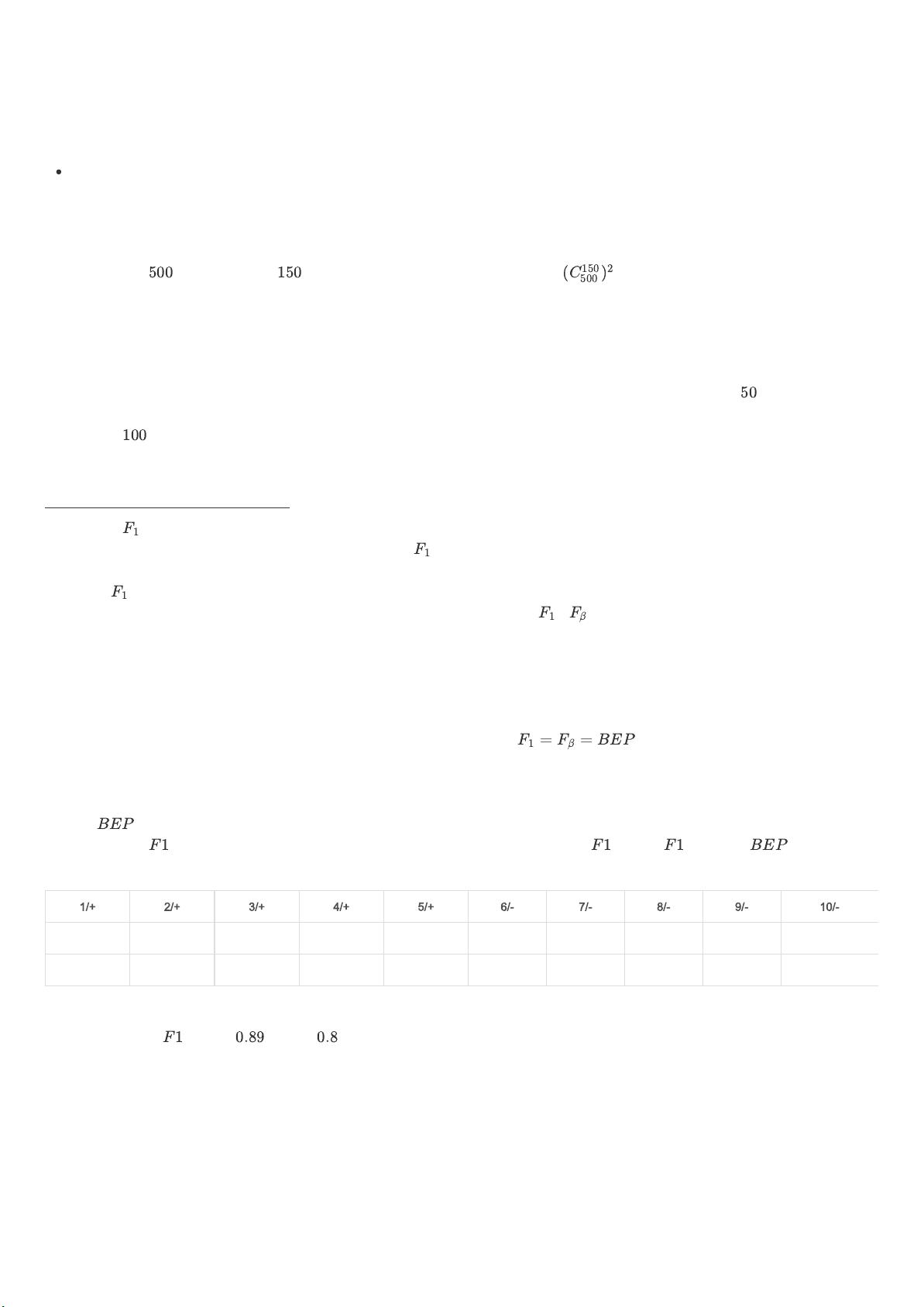

1. 数据集包含 1000 个样本,其中 500 个正例,500 个反例,将其划分为包含 70% 样本的训练集和

30% 样本的测试集用于留出法评估,试估算共有多少种划分方式。

一个组合问题,从 正反例中分别选出 正反例用于留出法评估,所以可能取法应该是 种。

2. 数据集包含 100 个样本,其中正反例各一半,假定学习算法所产生的模型是将新样本预测为训练样本

数较多的类别(训练样本数相同时进行随机猜测),试给出用 10 折交叉验证法和留一法分别对错误率进

行评估所得的结果。

10 折交叉检验:由于每次训练样本中正反例数目一样,所以讲结果判断为正反例的概率也是一样的,所以错误率的期望是 %。

留一法:如果留下的是正例,训练样本中反例的数目比正例多一个,所以留出的样本会被判断是反例;同理,留出的是反例,则会被判断成正例,

所以错误率是 %。

3. 若学习器 A 的 F1 值比学习器 B 高,试析 A 的 BEP 值是否也比 B 高。

F1 值的大小与 BEP 值并没有明确的关系。

两个分类器的 值得大小与他们的 BEP 值大小并没有明确的关系 (没去找)

这道题这里用反推,设计两个 BEP 值相同的分类器,如果他们的 值不一样,那么这道题的结论就是否定的

再加点我看了评论后的疑惑:

BEP 值就是 值吗?

BEP 值是在 P=R 时取到的,也就是 BEP=P=R。如果在计算 F 时也要定义 P=R,那么 和 将会恒等于 BEP,那么 P,R,F 在这里有什么意义

呢?

这里分两种情况:

第一就是我的理解,在计算 F1 时就是按照分类器真实的分类结果来计算 P,R,再根据 PR 计算 F1。当这个分类器正好 P=R 时,有

P=R=BEP=F1。否则 BEP 的计算不能用当前的 PR,而是通过一步一步尝试到查准率 = 查全率时,P’=R’=BEP。

第二种就是不存在我下面假设的分类器,分类器始终会在 P=R 的位置进行截断 (截断指的是分类器将所有样本按分为正例的可能性排序后,选择

某个位置。这个位置前面分类为正,后面分类为负)。但是这个可能吗?这种情况下 恒成立,分类器的评价本质将会变成了样

本的正例可能性排序,而不是最终的样本划分结果。

分类器将所有训练样本按自己认为是正例的概率排序,排在越前面分类器更可能将它判断为正例。按顺序逐个把样本标记为正,当查准率与查全率

相等时, = 查准率 = 查全率。当然分类器的真实输出是在这个序列中的选择一个位置,前面的标记为正,后面的标记为负,这时的查准率

与查全率用来计算 值。可以看出有同样的 BEP 值的两个分类器在不同位置截断可能有不同的 值,所以 值高不一定 值也高。

比如:

1/+ 2/+ 3/+ 4/+ 5/+ 6/- 7/- 8/- 9/- 10/-

1/+ 2/+ 3/+ 4/+ 6/- 5/- 7/- 8/- 9/- 10/-

1/+ 2/+ 3/+ 4/+ 6/+ 5/- 7/- 8/- 9/- 10/-

第一行是真实的测试样本编号与分类,第二三行是两个分类器对所有样本按为正例可能性的排序,以及判断的结果。显然两个分类器有相同的

BEP 值,但是他们的 值一个是 ,一个是 。

4. 试述真正例率(TPR)、假正例率(FPR)与查准率(P)、查全率(R)之间的联系。

查全率: 真实正例被预测为正例的比例

真正例率: 真实正例被预测为正例的比例

显然查全率与真正例率是相等的。

查准率: 预测为正例的实例中真实正例的比例

假正例率: 真实反例被预测为正例的比例

两者并没有直接的数值关系。

500 150

(

C

150

500

)

2

50

100

F

1

F

1

F

1

F

1

F

β

= =

BEP

F

1

F

β

BEP

F

1

F

1

F

1

BEP

F

1

0.89 0.8

5. 试证明 (2.22)

从书 页 b 图看来, 的公式不应该写的这么复杂,后来才发现原来这个图并没有正例反例预测值相等的情况。当出现这种情况时,

曲线会呈斜线上升,而不是这种只有水平和垂直两种情况。

由于一开始做题时并没有想过 ROC 曲线不可以是斜线,所以画了这张图,如果不存在正例反例预测值相等的情况,那么斜线也没必要存在。

但是在维基百科上看到一副图,貌似也存在斜线的 ROC,但是不知道含义是否和我这里写的一样。

https://en.wikipedia.org/wiki/Receiver_operating_characteristic

引用一幅有斜线的 ROC 曲线

与 一样,学习器先将所有测试样本按预测概率排序,越可能是正的排在越前面。然后依次遍历,每扫描到一个位置,里面如果只有正例,则

曲线垂直向上,如果只有反例,曲线水平往右,如果既有正例也有反例,则斜向上。如图所示

由于 与 的分母是常数,所以这里按比例扩大了坐标 (分别是真实正例和真实反例的数目倍),可以更好看出曲线走势。

可以看出一共有 个测试样本, 个正, 个反。学习器排序的结果是

。其中括号内的样本排在相同的位置。

< 是同样的效果 >

公式 累加了所有不在正例的反例数目,其中同样的位置标记为 ,在正例前面标记为 。从图中可以看出,折线每次向右 (右上) 延伸,表示

扫描到了反例,折线上方对应的面积,就是该反例后面有多少个正例,每个正例是一个正方形,对应的面积是 。同位置上的正例是个三角形,对

AUC

= 1 −

l

rank

34

AUC

ROC

BEP

ROC

TPR FPR

20 10 10

+,−,(+,+),(+,−),(+,−),(+,+),(−,−),(+,+),(−,−,−),+,−

(+,+,−,−)

与

(+,−),(+,−)

2.21 0.5 1

1

应的面积是 。计算出总面积后,由于 图的坐标是归一化的,所以总面积要除以一开始放大的倍数,也就是 。

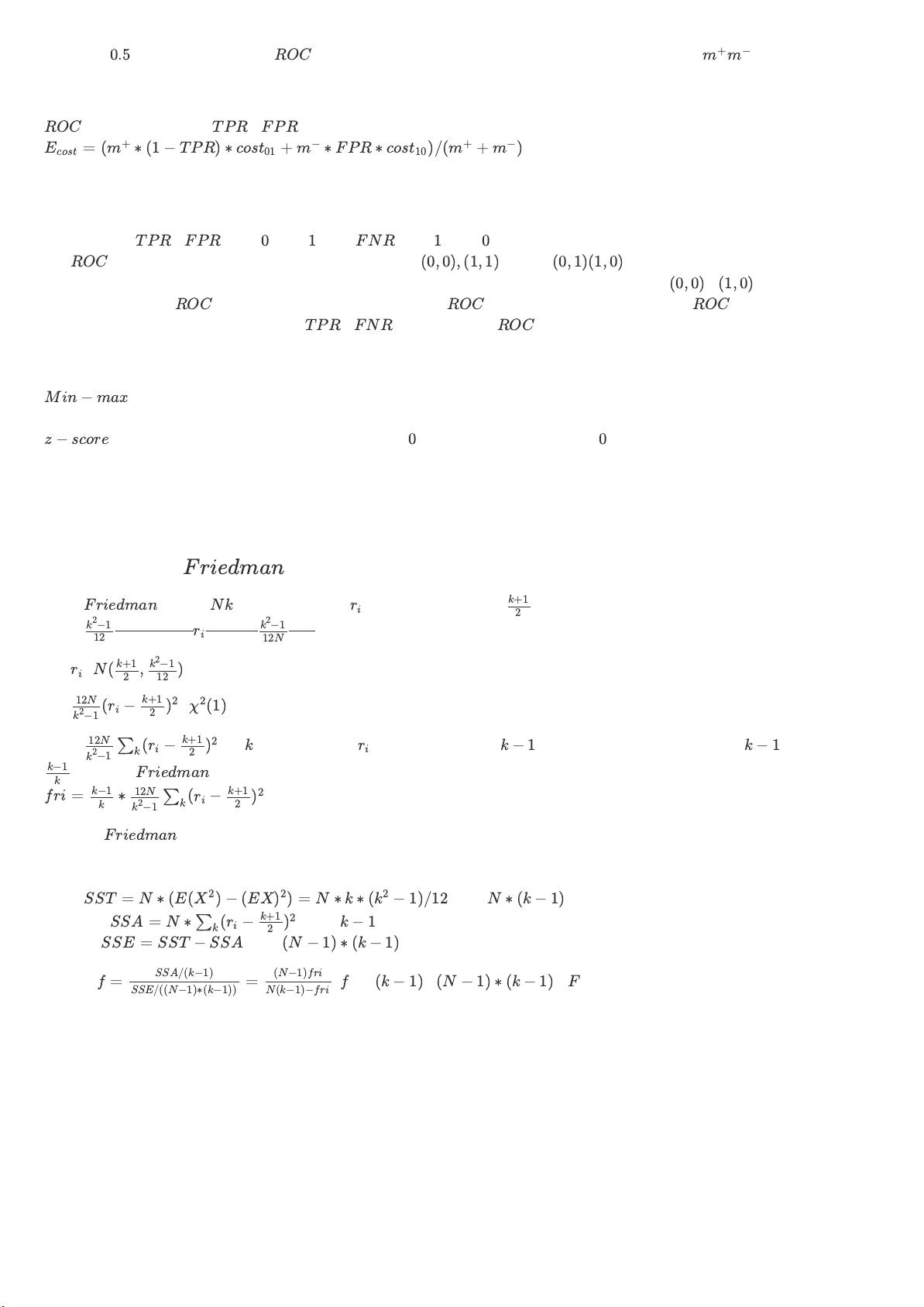

6. 试述错误率与 ROC 曲线之间的关系

曲线每个点对应了一个 与 ,此时对应了一个错误率。

学习器会选择错误率最小的位置作为截断点。

7. 试证明任意一条 ROC 曲线都有一条代价曲线与之对应,反之亦然。

由定义可以知道 与 都是由 上升到 ,那么 则是由 下降到 。

每条 曲线都会对应一条代价曲线,由于第一条代价线段的是 ,最后是 ,

所有代价线段总会有一块公共区域,这个区域就是期望总体代价,而这块区域的边界就是代价曲线,且肯定从 到 。

在有限个样本情况下, 是一条折线,此时根据代价曲线无法还原 曲线。但若是理论上有无限个样本, 是一条连续的折线,代价

曲线也是连续的折线,每个点的切线可以求出 与 ,从而得到唯一的 曲线。

8.Min-Max 规范化与 z-score 规范化如下所示。试析二者的优缺点。

规范化方法简单,而且保证规范化后所有元素都是正的,每当有新的元素进来,只有在该元素大于最大值或者小于最小值时才要重

新计算全部元素。但是若存在一个极大 (小) 的元素,会导致其他元素变的非常小(大)。

标准化对个别极端元素不敏感,且把所有元素分布在 的周围,一般情况下元素越多, 周围区间会分布大部分的元素,每当有新的元

素进来,都要重新计算方差与均值。

9. 试述卡方检验过程。

略 (……)

10. 试述在使用 检验中使用式 (2.34) 与(2.35)的区别

书上说 检验,在 比较大时,平均序值 近似于正态分布,均值为 ,

方差为 (其实我觉得 的方差是 )。

即: ~

所以 ~

统计量 由于 个算法的平均序值 是有关联的,知道其中 个就能推出最后一个,所以自由度为 , 在前面乘上

,最终得到 统计量为

猜测: 由于 统计量只考虑了不同算法间的影响,而没去考虑不同数据集 (其他方差) 所带来的影响,所以书上说这个 Friedman 统计量

太保守。

对序值表做方差分析:

总方差 自由度

算法间方差 自由度

其他方差 自由度

做统计量 , 服从 和 的 分布

0.5

ROC

m

+

m

−

ROC TPR FPR

= ( ∗ (1 −

TPR

) ∗

cos

+ ∗

FPR

∗

cos

)/( + )

E

cost

m

+

t

01

m

−

t

10

m

+

m

−

TPR FPR

0 1

FNR

1 0

ROC

(0,0),(1,1) (0, 1)(1, 0)

(0,0) (1,0)

ROC ROC ROC

TPR FNR ROC

Min

−

max

z

−

score

0 0

Friedman

Friedman Nk

r

i

k

+1

2

−1

k

2

12

r

i

−1

k

2

12

N

r

i

N

( , )

k

+1

2

−1

k

2

12

( −

12

N

−1

k

2

r

i

k

+1

2

)

2

(1)

χ

2

( −

12

N

−1

k

2

∑

k

r

i

k

+1

2

)

2

k

r

i

k

− 1

k

− 1

k

−1

k

Friedman

fri

= ∗ ( −

k

−1

k

12

N

−1

k

2

∑

k

r

i

k

+1

2

)

2

Friedman

SST

=

N

∗ (

E

( ) − (

EX

) =

N

∗

k

∗ ( − 1)/12

X

2

)

2

k

2

N

∗ (

k

− 1)

SSA

=

N

∗ ( −

∑

k

r

i

k

+1

2

)

2

k

− 1

SSE

=

SST

−

SSA

(

N

− 1) ∗ (

k

− 1)

f

= =

SSA

/(

k

−1)

SSE

/((

N

−1)∗(

k

−1))

(

N

−1)

fri

N

(

k

−1)−

fri

f

(

k

− 1) (

N

− 1) ∗ (

k

− 1)

F

剩余24页未读,继续阅读

小崔个人精进录

- 粉丝: 30

- 资源: 316

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0