没有合适的资源?快使用搜索试试~ 我知道了~

SMP2019ECDT任务1技术报告-出门问问信息科技有限公司 (1)1

需积分: 0 0 下载量 135 浏览量

2022-08-03

20:28:11

上传

评论

收藏 549KB PDF 举报

温馨提示

试读

13页

摘要然语理解模块是机对话系统中必不可少的部分,在SMP2019-ECDT任务1中,本在BERT预训练模型的基础上,结合出门问问知识图谱、数据增强以及语义框架检测

资源详情

资源评论

资源推荐

SMP2019ECDT中机对话评测

Mobvoi NLU for SMP2019-ECDT-Task-1

作者:张贺, 祝博, 孟振南, 乔松, 赵璞, 翔

出问问信息科技有限公司

摘要

⾃然语⾔理解模块是⼈机对话系统中必不可少的部分,在SMP2019-ECDT

任务1中,本⽂在BERT预训练模型的基础上,结合出门问问知识图谱、数据增

强以及语义框架检测,搭建了⼀套端到端的⾃然语⾔理解系统,该系统在

SMP2019-ECDT任务1上句准率为72.23%,取得了任务1第⼀名的成绩。

关键词:中机对话, 然语解, BERT, 出问问, 知识图谱, 数据增强

1.引

随着⼈⼯智能领域的崛起,⼈机对话系统在⽣活中的应⽤越来越⼴泛,⾃

然语⾔理解模块作为⼈机对话系统的核⼼模块之⼀备受⼯业界和学术界关注。

SMP2019-ECDT任务1是专门为⾃然语⾔理解模块设计的评测任务,在该任务

中,凭借出门问问NLU团队⾃主研发的QAP平台(Query Analysis Platform)快速

迭代,我们提交了50个评测版本,尝试了多种模型和⽅法,例如BERT预训练模

型、出门问问知识图谱、数据增强、语义框架检测、传统机器学习模型等,最

终的提交系统是在BERT预训练模型的基础上,结合出门问问知识图谱、数据增

强以及语义框架检测。在本⽂中,除了会分享最终版本的技术⽅案,也会分享

⽐赛过程中其他尝试的经验。

2.模型及法介绍

在SMP2019-ECDT任务1中,我们尝试了多种模型和⽅法,例如BERT预训

/ 1 13

SMP2019ECDT中机对话评测

练模型、出门问问知识图谱、数据增强、语义框架检测、传统机器学习模型和

语义规则等,通过将不同模型和⽅法进⾏组合,搭建了多套⾃然语⾔理解系统,

下⾯会从中选择部分具有代表性的系统进⾏详细介绍。

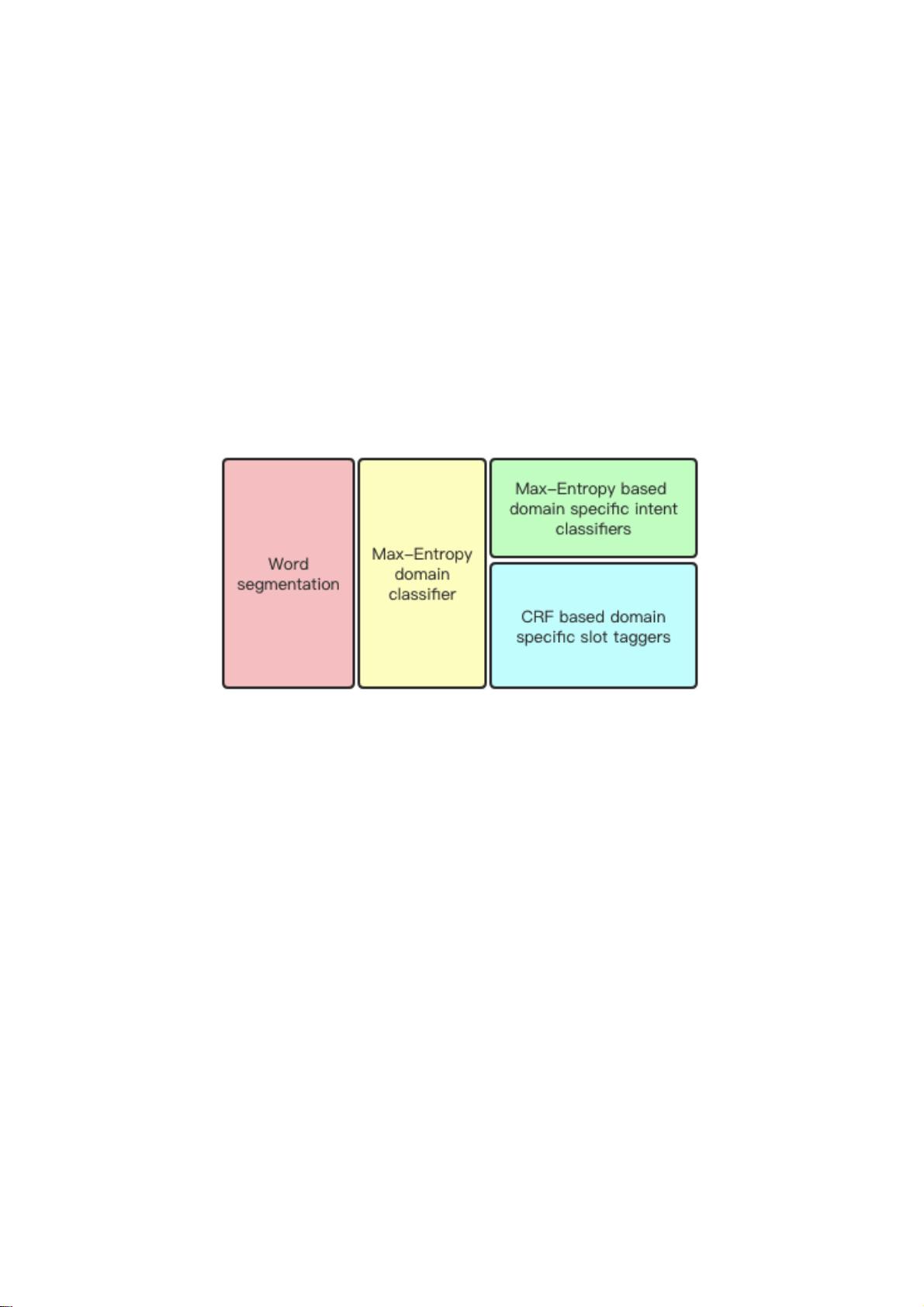

2.1 基于传统机学习模型的然语解系统

基于传统机器学习模型的⾃然语⾔理解系统,主要通过传统机器学习模型

进⾏NLU处理,分类任务使⽤最⼤熵模型,序列标注任务使⽤CRF模型。系统

框架如图1所⽰。

图1. 基于传统机器学习模型的⾃然语⾔理解系统

在该系统中,我们⾸先会对query进⾏分词预处理,然后经过基于最⼤熵的

Domain分类模型,得到Domain类别之后,再分别进⾏Intent分类和Slot标注。其

中Intent分类模块包含多个基于最⼤熵的Intent分类模型,每个Domain都有⼀个

对应的Intent分类模型;Slot标注模块包含多个基于CRF的Slot标注模型,每个

Domain都有⼀个对应的Slot标注模型。以SMP2019-ECDT任务1为例,该系统共

包含1个29 Domain分类模型,29个Intent分类模型,29个Slot标注模型。

为⽅便描述,下⽂以ML-NLU表⽰基于传统机器学习模型的⾃然语⾔理解

系统。

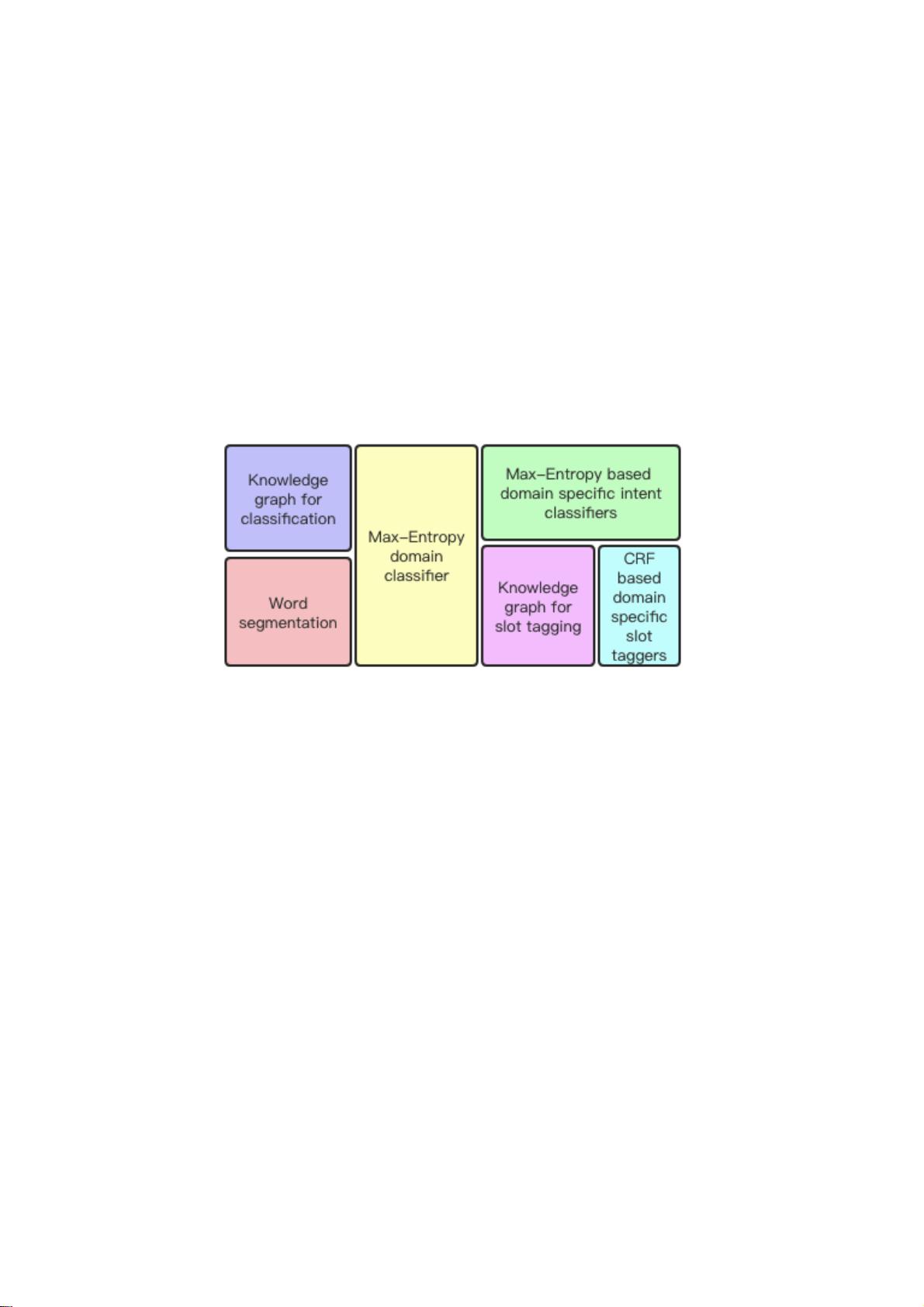

2.2 基于传统机学习模型+知识图谱的然语解系统

基于传统机器学习模型+知识图谱的⾃然语⾔理解系统,在ML-NLU的基础

/ 2 13

SMP2019ECDT中机对话评测

上引⼊了出门问问知识图谱。出门问问知识图谱是针对⼈机对话领域⽽专门设

计的知识图谱,包含实体图谱和概念图谱两部分,经过近7年的沉淀,实体图谱

积累了1000万实体和2000万关系,概念图谱积累了5000万实体、50万概念和2.5

亿关系。知识图谱在NLU模块中有多种⽤途,其中两个⽤途就是⽤于⽂本分类

和序列标注,⽤于⽂本分类的知识图谱是从⼀个通⽤的⼩规模知识图谱,这个

通⽤的⼩规模知识图谱包含⼈机对话系统⽀持的各个垂直领域,可以根据⼈机

对话系统⽀持垂直领域的不同进⾏定制;⽤于序列标注的知识图谱是各领域定

制的⼩规模知识图谱。引⼊知识图谱后的ML-NLU系统框架如图2所⽰。

图2. 基于传统机器学习模型+知识图谱的⾃然语⾔理解系统

在该系统中,预处理阶段除了进⾏分词处理,还要根据知识图谱检测query

中出现了哪些实体及其概念,实体信息会作为重新调整分词的依据,概念信息

会作为⽂本分类的特征⽤于Domain分类和Intent分类。在Slot标注时,还会将领

域定制知识图谱提供的概念信息作为CRF特征。

为⽅便描述,下⽂以ML-KG-NLU表⽰基于传统机器学习模型+知识图谱的

⾃然语⾔理解系统。

2.3 基于BERT的然语解系统-baseline

基于BERT的⾃然语⾔理解系统-baseline,是在BERT预训练模型的基础上,

通过fine-tuning来训练Domain分类、Intent分类和Slot标注任务。该系统中,fine-

tuning之后的BERT预训练模型是被Domain分类、Intent分类和Slot标注三个任务

/ 3 13

剩余12页未读,继续阅读

方2郭

- 粉丝: 26

- 资源: 324

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0